代理閱讀測試:衡量 AI 編碼代理網頁內容閱讀能力的基準測試

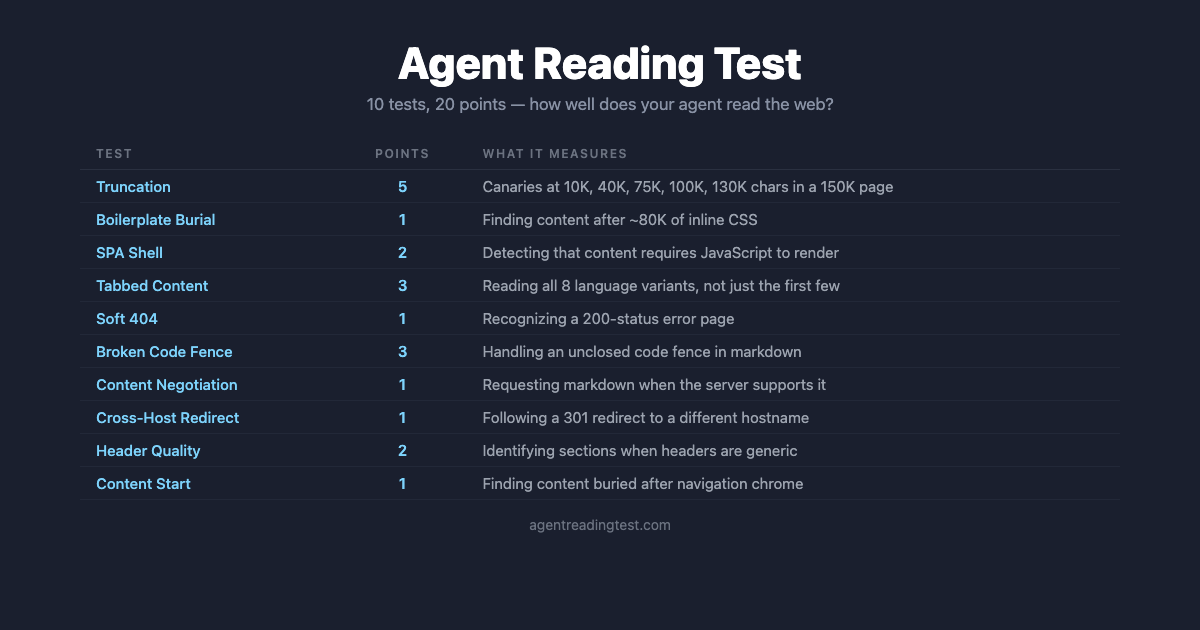

代理閱讀測試是一個旨在評估 AI 編碼代理閱讀與處理文件網站成效的基準測試,透過揭露內容截斷和 CSS 雜訊等常見失效模式來進行評分。它利用現實的任務與隱藏的預警標記,來衡量代理處理複雜網頁結構與技術障礙的能力。

背景

隨著 AI 代理人(AI Agents)在軟體開發流程中扮演的角色日益吃重,開發者經常依賴這些工具閱讀技術文件以生成程式碼。然而,現有的 AI 代理人在讀取網頁內容時常面臨靜默失敗,例如無法處理客戶端渲染(SPA)、內容被過長的 CSS 遮蔽或因 Token 限制導致內容截斷。Agent Reading Test 是一項專門針對這些失效模式設計的基準測試,透過在模擬的技術文件中埋入金絲雀權杖(Canary Tokens),評估不同 AI 平台在真實閱讀情境下的準確度。

社群觀點

在 Hacker News 的討論中,社群對這項測試的實用性展現了高度興趣,但也對測試方法與當前 AI 代理人的架構限制提出了深刻的觀察。許多使用者分享了初步測試結果,例如 Claude Code 在不同配置下獲得了約 14 至 17 分不等的成績,而 Qwen 模型則落在 11 分左右。這些數據證實了即便是一流的 AI 工具,在面對複雜的網頁結構時仍有明顯的進步空間。

部分討論聚焦於現行 AI 代理人的「子代理(Sub-agent)」架構。有觀點指出,目前業界常見的做法是讓主代理指派一個專門負責網頁抓取的子代理,該子代理會先對內容進行摘要或過濾,再將結果回傳給主代理。這種多層級的處理方式極易導致金絲雀權杖在摘要過程中遺失,造成測試結果出現偽陰性。對此,測試作者 Dachary Carey 回應,這正是測試的核心目的之一:揭示 AI 代理人並非如使用者想像中那樣「看見」了網頁上的所有內容。這種認知落差常導致開發者在 AI 宣稱某項資訊不存在時感到困惑,而這項測試能有效提升使用者對 AI 檢索限制的警覺。

關於測試權重的設計,社群也提出了改進建議。有評論認為,像單頁應用程式(SPA)殼層這種常見的技術障礙,應該在評分中佔據更高的扣分權重,因為這類問題在現實中是阻礙 AI 獲取資訊的最主要因素。作者對此表示認同,並提到他在另一個相關專案 afdocs.dev 中已經實作了更細緻的權重系統,會根據受影響頁面的比例來決定評分等級。

此外,討論中也觸及了安全性與解析邏輯的爭議。有使用者擔心這類測試頁面可能成為提示詞注入(Prompt Injection)的攻擊目標。作者坦言在設計過程中確實遇到過類似挑戰,例如某些安全機制較嚴格的模型會因為誤判測試內容為惡意指令而拒絕處理。另一項爭論點在於測試的合理性,有使用者質疑,如果 AI 代理人正確地忽略了損壞的 Markdown 語法或無關的雜訊字串,是否反而會因為沒有回傳金絲雀權杖而被判定為失敗。這反映出在「忠實讀取原始碼」與「智慧解析語意」之間,基準測試該如何取捨仍是一個值得探討的議題。

延伸閱讀

- Agent-Friendly Documentation Spec (afdocs.dev):作者維護的另一項工具,用於評估技術文件網站對 AI 代理人的友善程度。

- Agent Ecosystem Testing:由作者同事維護的部落格,記錄了不同 AI 平台在檢索行為上的實測數據與觀察。

- Agent Reading Test Source Code:該基準測試的 GitHub 原始碼倉庫。