歐洲核子研究組織將微型 AI 模型燒錄至晶片,用於大型強子對撞機數據即時篩選

歐洲核子研究組織正將極其微小的自定義人工智慧模型直接燒錄在矽晶片上,以便在奈秒級的極短時間內,對大型強子對撞機產生的海量數據進行即時篩選。

背景

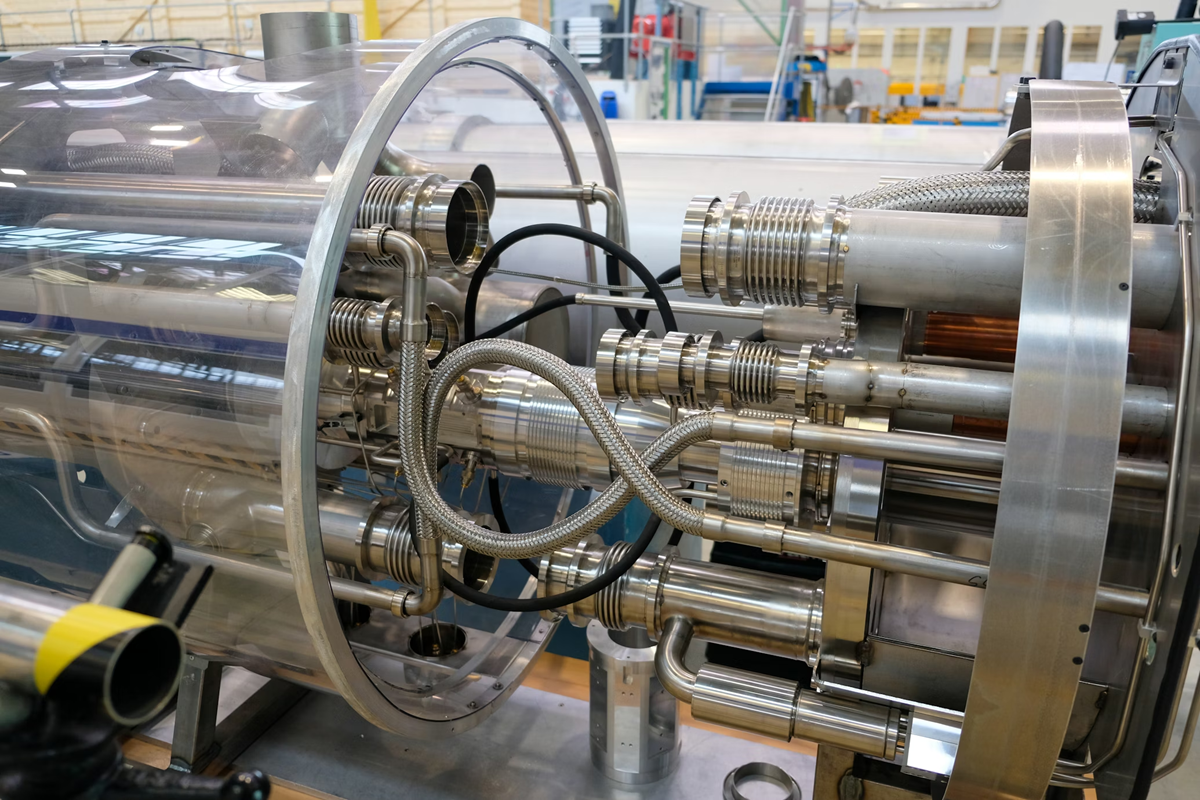

歐洲核子研究組織(CERN)的大型強子對撞機(LHC)每年產生約 40,000 EB 的原始數據,其規模遠超現有儲存技術的負荷。為了在極短的時間內篩選出具備科學價值的事件,CERN 捨棄了傳統的 GPU 運算架構,轉而開發極小型的 AI 模型並直接燒錄於 FPGA 或 ASIC 晶片中,實現在奈秒等級的硬體邊緣運算。

社群觀點

Hacker News 的討論焦點首先集中在媒體報導對「AI」一詞的定義模糊與誤用。部分讀者指出,原文在描述時一度將這些微型模型稱為「大型語言模型」(LLM),引發了社群的強烈抨擊與嘲諷。留言者普遍認為,在當前的行銷語境下,AI 已經變成一個語言泥沼,任何演算法似乎都能被冠上 AI 之名。然而,資深技術人員反駁了這種「術語純潔主義」,指出神經網路被歸類為 AI 已有數十年歷史,早在 LLM 熱潮之前,FPGA 上的神經網路應用就已經存在。甚至有觀點認為,即便只是簡單的邏輯判斷或專家系統,在學術定義上確實都屬於人工智慧的範疇。

針對技術細節,社群成員深入挖掘了 CERN 的實際架構。根據留言者提供的技術文件,CERN 使用的是一種名為 AXOL1TL 的架構,結合了變分自編碼器(VAE)與特徵提取器,而非大眾認知的生成式模型。這種設計的核心在於極致的優化,透過 HLS4ML 工具將 PyTorch 或 TensorFlow 模型轉換為硬體可執行的 C++ 代碼。討論中也提到,CERN 大量利用預先計算的查找表(Lookup Tables)來取代浮點運算,這種「硬體優先」的設計哲學是達成奈秒級延遲的關鍵。

此外,社群對於數據流失的規模感到震撼。LHC 僅保留約 0.02% 的碰撞事件,其餘數據皆永久刪除,這讓部分讀者感嘆科學研究中「數據取捨」的殘酷性。同時,也有人將 CERN 的做法與業界其他硬體加速方案進行比較,例如 Groq 或 Etched 的晶片設計。雖然兩者都強調將模型邏輯固化於硬體中以提升效能,但讀者指出 CERN 的應用場景更為極端且專一,其目的並非通用的運算加速,而是在物理實驗的最前線進行即時的「生死判斷」。

延伸閱讀

在討論過程中,社群成員分享了數個深入了解該技術的資源。包括 CERN 官方的 AXOL1TL 技術文檔,以及發表於 arXiv 的相關論文《AXOL1TL: An Anomaly Detection Algorithm for the CMS Level-1 Trigger》。此外,Dr. Thea Klaeboe Aarrestad 關於 LHC 奈秒級 AI 應用的演講影片也被多次提及,這些資源提供了比新聞報導更精確的數學與工程細節。