Transformer 電路直覺分析

這篇文章分享了我透過機械解釋性研究 Transformer 內部運作的直覺模型,重點介紹殘差流如何作為共享記憶體運作,以及注意力機制如何充當定址系統來處理資訊。

背景

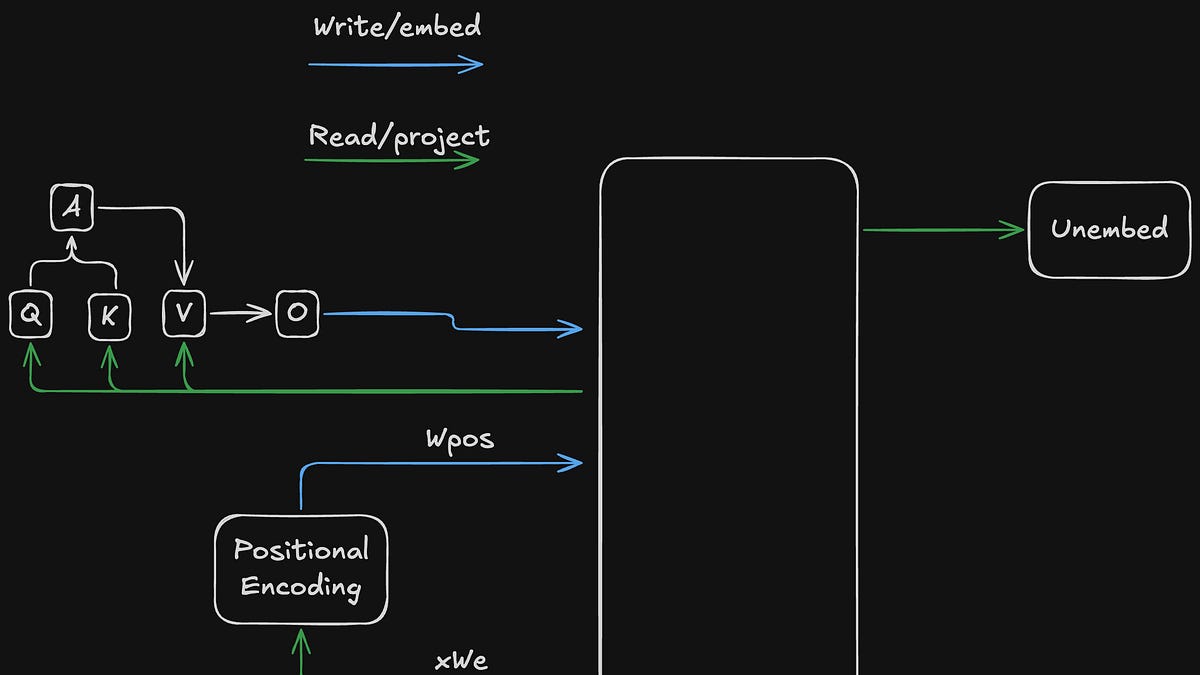

這篇文章源於作者對機械解釋性(Mechanistic Interpretability)的研究心得,旨在透過數學框架拆解 Transformer 模型(特別是僅含注意力機制的簡化模型)的運作邏輯。作者將殘差流(Residual Stream)比喻為電腦的共享記憶體,探討模型如何透過高維向量空間進行資訊的讀取與儲存,並強調理解這些底層原理對於人工智慧對齊與安全性的重要性。

社群觀點

在 Hacker News 的討論中,讀者對於將模型運作邏輯類比為電子電路的做法表示肯定,認為這種直觀的理解方式有助於消化複雜的技術細節。然而,討論的焦點很快轉向了作者在文中提出的一個爭議性觀點:即人工智慧是人類歷史上唯一一種無法從基本原理完全理解的技術。

針對這一說法,社群成員提出了強烈的質疑與反思。有觀點指出,人類歷史上充滿了許多雖然被廣泛應用、但其底層科學原理至今仍未被完全破解的發明。例如自行車的平衡機制、冰刀在冰面滑行的物理原理,甚至是醫學領域中天天使用的全身麻醉藥,人類對其運作的精確機制依然存在認知盲點。這顯示出「發明」與「理解」之間往往存在巨大的時間差。

進一步的討論則深化了對技術演進史的看法。部分評論者認為,工程師從基本原理出發來發明事物,其實是近代才出現的現象。在人類文明的大部分時間裡,技術的進步主要是透過不斷的嘗試與錯誤(Trial and Error)來達成,而非先有完善的理論指導。因此,Transformer 模型的黑盒特性在技術發展史上並非特例,而是延續了人類先製造出工具、再事後研究其原理的傳統模式。這種觀點挑戰了作者對 AI 特殊性的定義,認為我們對 AI 的不解,更多是源於其複雜度,而非其本質上與過往技術有根本性的斷裂。

延伸閱讀

在討論中,讀者特別推薦了文中提及的 A Mathematical Framework for Transformer Circuits 論文,以及 Neel Nanda 針對該論文所製作的導讀影片。此外,ARENA(AI Alignment Research Engineers Accelerator)提供的機械解釋性入門練習,也被視為將理論轉化為實作能力的關鍵資源。