Mr. Chatterbox 是一款可在個人電腦運行的維多利亞時代倫理訓練模型

Trip Venturella 推出了 Mr. Chatterbox,這是一款完全使用大英圖書館館藏且已過版權保護期的維多利亞時代文本訓練而成的語言模型,藉此探索利用公共領域數據開發人工智慧的可能性。

背景

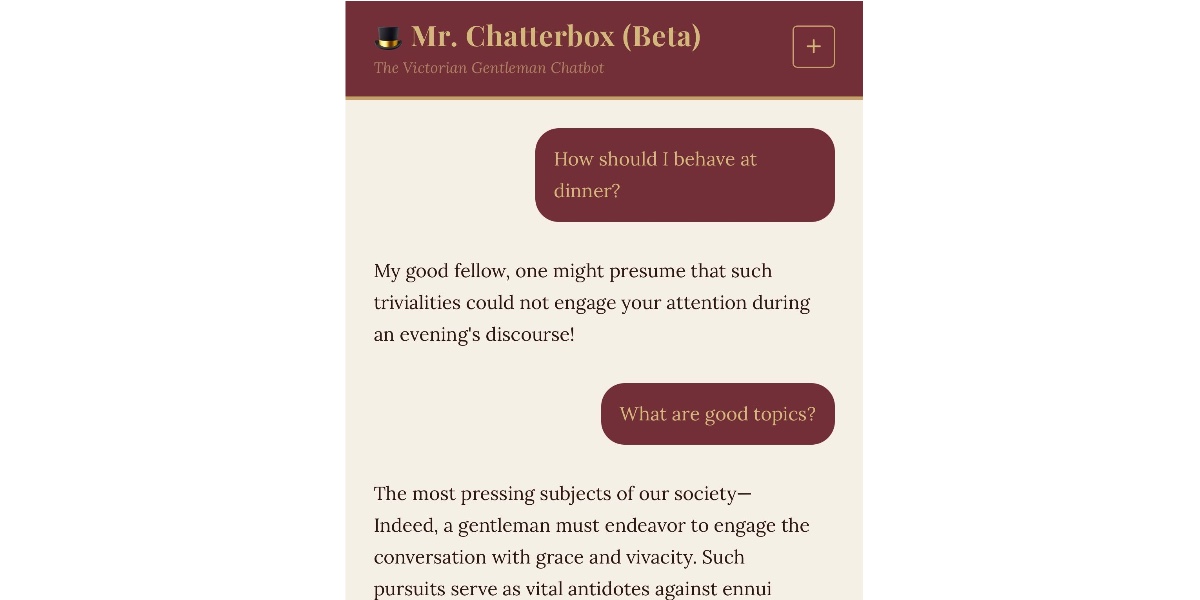

Trip Venturella 近期發布了一款名為 Mr. Chatterbox 的語言模型,其特色在於完全使用大英圖書館提供的 19 世紀維多利亞時代文本進行訓練。該模型擁有約 3.4 億個參數,規模與 GPT-2 Medium 相當,但其所有訓練數據均來自 1837 年至 1899 年間出版的公有領域書籍,旨在探索在不使用未經授權的抓取數據下,能否打造出具備特定時代風格且符合法律倫理的人工智慧。

社群觀點

Hacker News 的討論首先聚焦於該模型的實際表現,多數使用者在測試後感到失望,認為其對話邏輯極不連貫。有評論指出,這並非使用者不理解維多利亞時代的語言風格,而是模型參數規模與訓練標記數量的比例失衡,導致其產出的內容更接近隨機的馬可夫鏈而非現代意義上的大型語言模型。根據 Chinchilla 縮放定律,3.4 億參數的模型至少需要 70 億個標記才能達到理想效果,而 Mr. Chatterbox 僅使用了不到 30 億個標記,這解釋了為何它在回答倫敦地理或歷史人物等基本事實時會出現嚴重的幻覺與張冠李戴。

關於「倫理訓練」的定義在社群中引發了激烈的辯論。部分網友質疑,僅僅因為數據超出了版權保護期而合法使用,是否就能等同於「倫理」。有觀點認為,真正的倫理應建立在原作者的知情同意之上,而 19 世紀的作家顯然無法預見其作品會被用於訓練 AI。然而,反對者則主張公有領域的本質就是為了讓人類文明共享知識,若死者的權利能無限期限制生者的創作,將對文化發展造成阻礙。此外,也有人指出版權法在各國的差異,例如英國與歐盟的版權期限計算方式可能導致某些 1899 年前的作品仍受保護,這使得純粹以年代劃分法律邊界的做法存在風險。

此外,社群也觀察到一個有趣的技術矛盾:Simon Willison 雖然讚賞這款完全基於公有領域數據的模型,但他開發相關外掛程式時,卻是依賴閉源且使用大量未授權數據訓練的 Claude Code 來完成代碼編寫。這種「用不透明 AI 建立透明 AI 生態」的現象,被部分網友戲稱為一種諷刺的技術追趕。儘管目前模型表現不佳,但仍有參與者對未來持樂觀態度,認為若能結合國家檔案館的數位化公文或透過大型模型生成合成數據來擴充語料,這種特定時代背景的垂直領域模型仍具備極高的歷史研究與教育價值。

延伸閱讀

在討論過程中,有網友分享了類似的先驅計畫 TimeCapsuleLLM,該模型專注於 1800 年至 1875 年間的數據訓練。另外,關於如何利用現代 LLM 協助數位化國家檔案館(如英國 Kew 國家檔案館)的大量二戰時期手稿,也被視為未來歷史研究的重要技術方向。針對版權爭議,討論中亦提及了《彼得潘》在英國擁有的特殊永久版權案例,提醒開發者在處理歷史文本時需注意法律細節。