Vibe Coding XR:利用 XR Blocks 與 Gemini 加速 AI + XR 原型開發

Vibe Coding XR 是一個快速原型開發工作流,利用 Gemini 與開源的 XR Blocks 框架,在 60 秒內將自然語言指令轉化為具備物理感知能力且可互動的 Android XR 應用程式。

Vibe Coding XR:利用 XR Blocks 與 Gemini 加速 AI + XR 原型開發

2026 年 3 月 25 日

Ruofei Du,互動感知與圖形負責人;Benjamin Hersh,Google XR 產品經理

Vibe Coding XR 是一種快速原型開發工作流,它為 Gemini Canvas 賦予了開源 XR Blocks 框架的能力,將使用者提示詞(prompts)轉化為適用於 Android XR 的全互動、具備物理感知的 WebXR 應用程式。這讓創作者能夠在桌機模擬環境以及 Android XR 頭戴式裝置上,快速測試智慧空間體驗。

快速連結

大型語言模型(LLMs)和代理式工作流(agentic workflows)正在改變軟體工程與創意運算。我們正看到一種向「Vibe Coding」轉變的趨勢,即 LLM 直接將人類意圖轉化為可運行的程式碼。像 Gemini Canvas 這樣的工具已經讓 2D 和 3D 網頁開發成為可能。然而,擴增實境(XR)仍然難以觸及。在 XR 中開發原型通常需要拼湊破碎的感知管線、複雜的遊戲引擎以及底層感測器整合。

快速的「Vibe-coded」原型可以解決這個問題。它們幫助經驗豐富的開發者直接在頭戴裝置中測試新的 UI、3D 互動和空間視覺化。這種快速驗證可以為最終可能被捨棄的想法節省數天的工時。它也讓構建展示自然科學與力學的互動式教育體驗變得更加容易。

今天,我們宣布推出 Vibe Coding XR 來填補這一空白。此工作流將 Gemini 作為創意夥伴,並結合我們基於網頁的 XR Blocks 框架。透過將 Gemini 的長文本推理能力與專門的系統提示詞及精選的程式碼範本相結合,系統會自動處理空間邏輯。它能在 60 秒內將自然語言直接轉化為功能齊全、具備物理感知的 Android XR 應用程式。

我們的團隊將在 ACM CHI 2026 的 Google 展位進行現場演示。您也可以今天就在此處親自體驗。

觀看影片

Youtube 影片連結

Vibe Coding XR 演示影片:XR Blocks Gem 在 60 秒內將單一提示詞「創建一朵美麗的蒲公英」轉化為 Android XR 體驗。

Vibe Coding XR 工作流

在過去的一年裡,我們不斷迭代設計並改進 Vibe Coding XR 的歷程,使其變得無縫且易於使用。以下是一個範例:

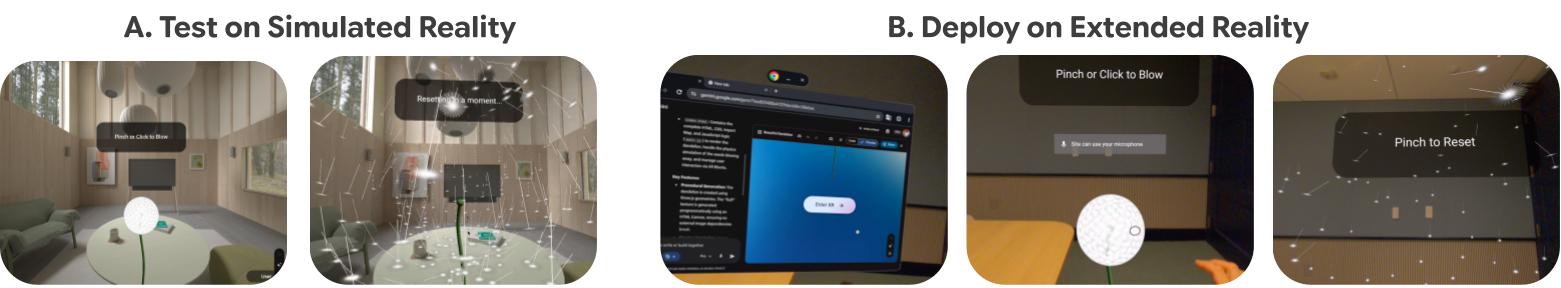

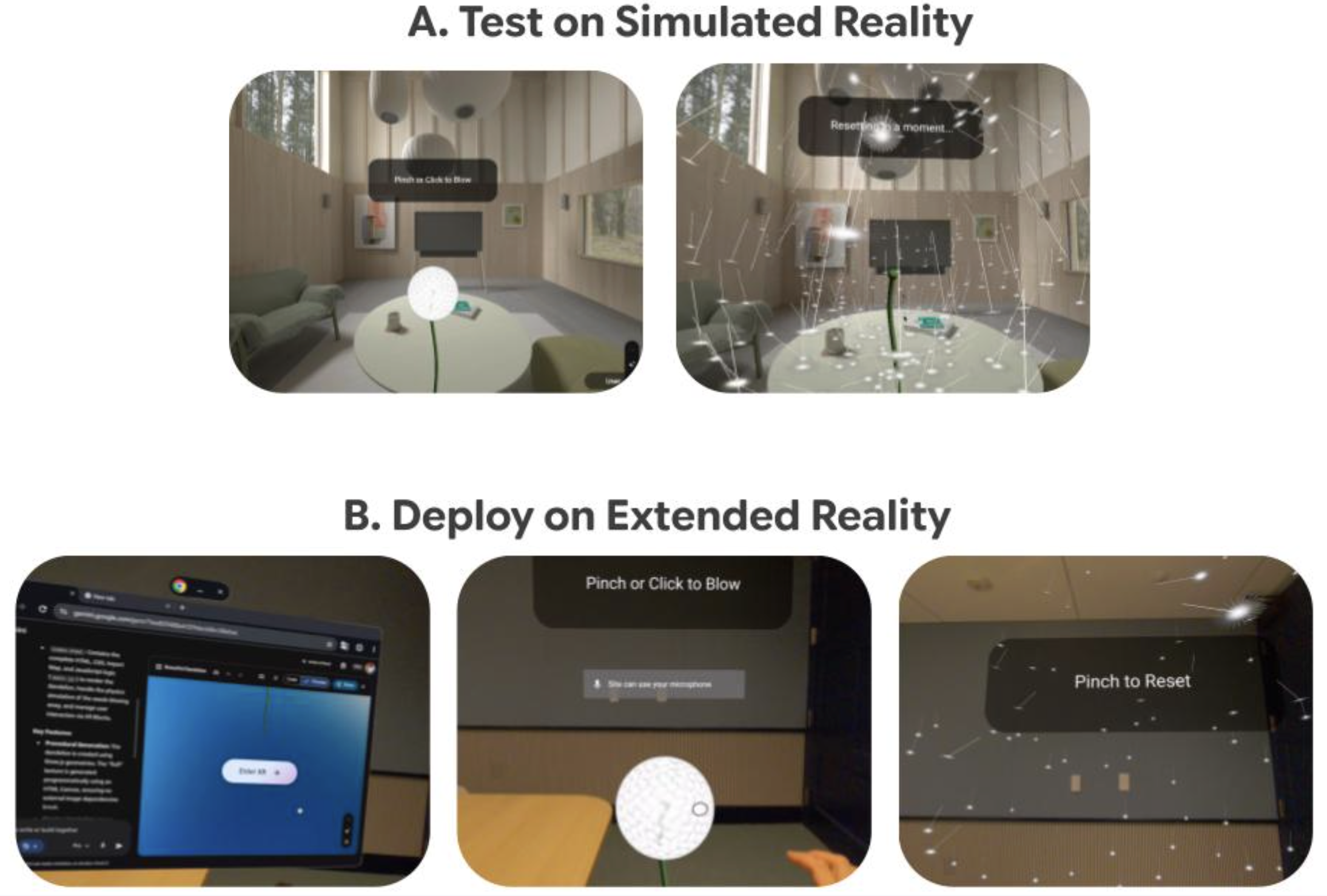

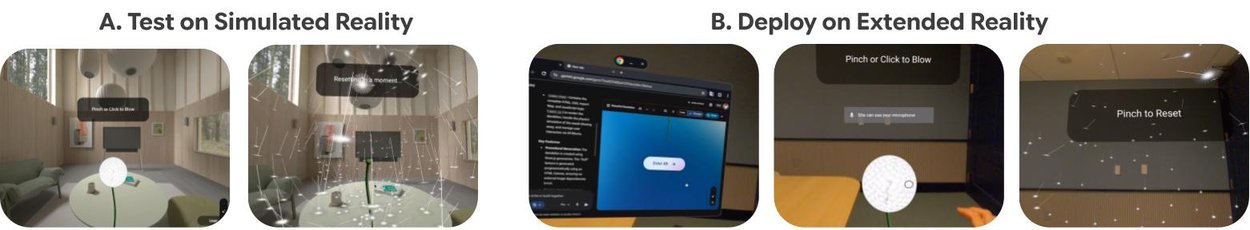

為了方便測試,我們還在桌機版 Chrome 上提供了一個「模擬實境」環境。這讓創作者在部署到 Android XR 裝置之前,能夠快速開發原型並測試互動。許多先進的感知功能(如深度感測、手部互動和物理模擬)在 Android XR 上體驗效果最佳。

我們的框架透過允許使用者 (A) 在桌機模擬實境環境中測試其「Vibe Coding」結果,以及 (B) 在具備身體與手部互動功能的 Android XR 頭戴裝置上部署相同的演示,來加速 AI + XR 原型開發。

Vibe Coding XR 技術簡介

Vibe Coding XR 利用 Gemini 的長文本能力和思考過程,使其扮演專家級 XR 設計師與工程師的角色。我們開發了專門的系統提示詞,用 XR Blocks 架構和範例來「教導」Gemini,包括房間規模(room-scale)XR 環境指南、套件管理以及 XR 互動的最佳實踐。

底層的 XR Blocks 框架構建於 WebXR、three.js 和 LiteRT.js 等易於存取的網頁技術之上。其核心引擎管理著空間運算所需的複雜子系統協作,包括環境感知、XR 互動和 AI 整合。我們的提示詞上下文包含以下組件:

應用場景:從提示詞到現實

我們透過 Vibe Coding 生成的原型範例展示了 Vibe Coding XR 工作流的多功能性:

Vibe-coded 數學家教應用程式,讓學生在 3D 空間中學習幾何。

Vibe-coded 物理實驗室應用程式,實現動手操作的物理實驗。

Vibe-coded 沉浸式化學應用程式,模擬互動式化學實驗。

Vibe-coded 薛丁格的貓應用程式,用於在 XR 中解釋量子概念。

Vibe-coded XR 排球應用程式,實現混合實境運動的快速原型開發。

Vibe-coded XR 恐龍應用程式,實現混合實境遊戲的快速原型開發。

我們使用更具體的上下文進行提示,例如使用 NASA 系外行星數據、程序化生成,或在 XR Blocks Gem 中創建高解析度紋理,並展示 Vibe Coding XR 過程中的迭代優化:

從左至右或從上至下:NASA 星圖的沉浸式視覺化、城市地圖的程序化生成、探索古埃及金字塔。

初步技術評估

評估 XR 應用程式一直是一項挑戰,很大程度上是因為它通常需要親自上機測試和主觀的人類評價。為了測試我們 Vibe Coding XR 管線的有效性,我們建立了一個用於創建 XR 應用的初步提示詞數據集:VCXR60。

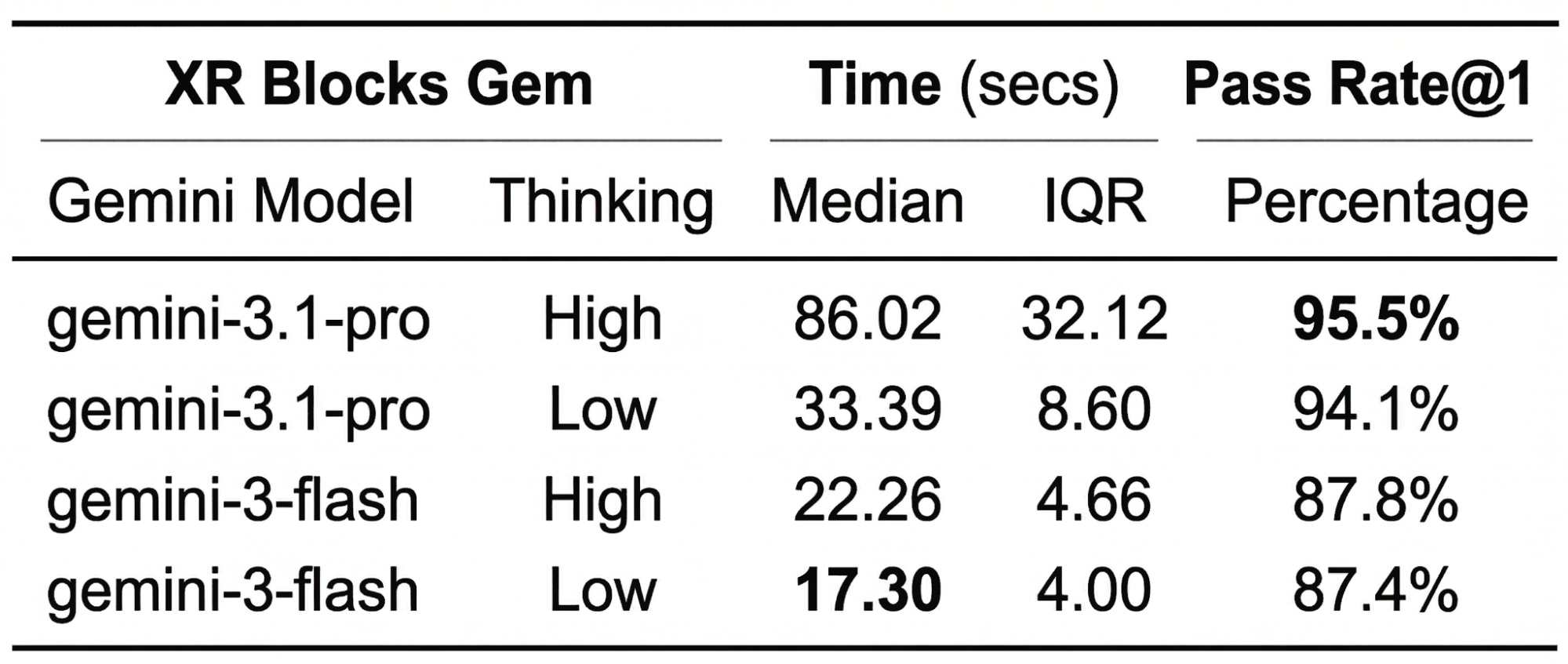

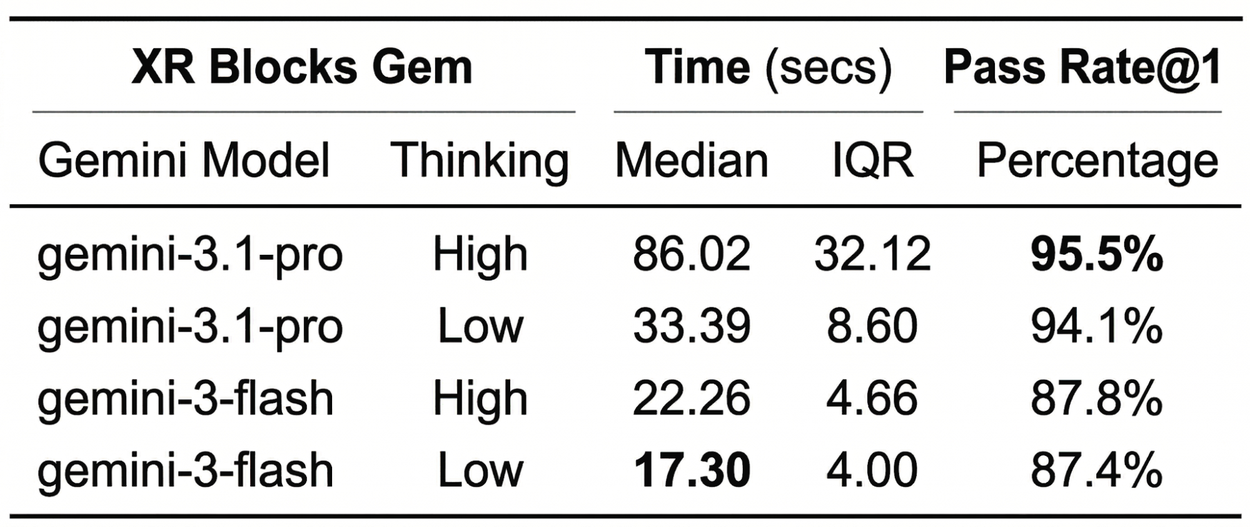

VCXR60 源自四場各一小時的內部工作坊,包含由 20 名 Google 參與者提供的 60 個獨特提示詞。利用這個數據集,我們測量了推理時間和單次成功率(one-shot success rate),特別關注在 XR Blocks 模擬實境環境中實現零錯誤執行。例如,一個簡單的提示詞「創建一朵美麗的蒲公英,當我拿起它時會隨風飄散」,在 Gemini Flash 中可能在 20 秒內完成,但與 Gemini Pro 相比,運行時出錯的機率較高,因為處理動畫和手部互動在思考過程中需要更多的 token。

早期我們發現,大多數初始錯誤源於 XR Blocks 本身的錯誤,或是對不存在或已棄用的 API 產生幻覺,成功率約為 70%。這些見解推動了為期六個月的快速迭代週期。今天,在經歷了 11 個主要版本發布後,我們很高興分享 XR Blocks Gem v0.11.0 在 VCXR60 數據集上的初步評估結果作為基準參考。

我們給開發者的首要建議:在進行進階 XR 原型開發時,使用「Pro 模式」能獲得最可靠的結果。

XR Blocks Gem 在 VCXR-60 數據集上進行 5 次運行的推理時間與單次成功率。IQR(四分位距)定義為數據第 75 百分位數與第 25 百分位數之間的差異。我們在評估中使用了 2026 年 3 月的 Gemini「預覽版」模型。

結論

Vibe Coding XR 標誌著邁向未來的重要一步,在那個未來,空間運算不再受限於技術專業知識,而是受限於創意。透過將 LLM 的推理能力與 XR Blocks 的高階抽象相結合,我們彌合了轉瞬即逝的想法與切實、具備物理感知的現實之間的鴻溝。

我們的團隊正持續致力於 XR Blocks 框架、基準測試和空間智慧的研究。我們邀請 HCI(人機互動)、AI 和 XR 社群為 Android XR 上的這個 XR Blocks 生態系統做出貢獻。您可以透過快速連結訪問開源框架並嘗試線上演示,或蒞臨 ACM CHI 2026 參觀我們的演示。

致謝

這項工作是 Google 多個團隊合作的成果。該項目的主要貢獻者包括 Ruofei Du、Benjamin Hersh、David Li、Xun Qian、Nels Numan、Zhongyi Zhou、Yanhe Chen、Xingyue Chen、Jiahao Ren、Robert Timothy Bettridge、Faraz Faruqi、Xiang 'Anthony' Chen、Steve Toh 和 David Kim。以下研究員和工程師對 XR Blocks 框架做出了貢獻:David Li 和 Ruofei Du(同等主要貢獻)、Nels Numan、Xun Qian、Yanhe Chen 和 Zhongyi Zhou(同等次要貢獻,按字母順序排列),以及 Evgenii Alekseev、Geonsun Lee、Alex Cooper、Brandon Jones、Min Xia、Scott Chung、Jeremy Nelson、Xiuxiu Yuan、Jolica Dias、Tim Bettridge、Benjamin Hersh、Michelle Huynh、Konrad Piascik、Ricardo Cabello 和 David Kim。我們進一步感謝 Gemini Canvas 和 AI Studio 團隊的支持,包括但不限於:Tim Bettridge、Yan Li、Daniel Marques、Deven Tokuno、Levent Yilmaz、Saravana Rathinam、Samuel Petit、Mike Taylor-Cai、Ammaar Reshi 和 Robert Berry。我們感謝 Mahdi Tayarani、Max Dzitsiuk、Jim Ratcliffe、Patrick Hackett、Seeyam Qiu、Coco Fatus、Alon Hetzroni、Aaron Kim、Yinghua Yang、Brian Collins、Eric Gonzalez、Nicolás Peña Moreno、Yidang Zhang、Jamie Pepper、Yuhao He、Yi-Fei Li、Ziyi Liu、Jing Jin 對我們早期提案和 WebXR 實驗的反饋與討論。我們感謝 Tim Herrmann 和 Andrew Helton 的細心審閱。我們感謝 Maryam Sanglaji、Max Spear、Adarsh Kowdle、Guru Somadder 以及 Shahram Izadi 的方向性反饋與貢獻。

快速連結

其他感興趣的文章

2026 年 3 月 24 日

2026 年 3 月 24 日

2026 年 3 月 17 日