寬廣的 AI 時間線

我認為與其爭論 AI 時間線是短還是長,我們更應該採取寬廣的時間線並保持認識論上的謙遜,因為專家之間存在巨大分歧且充滿不確定性。認真對待這種不確定性,對於明智的規劃以及共同推動 AI 轉型順利進行至關重要。

沒有人知道 AI 何時會開始對世界產生變革性的影響。人們並不確定,也不應該確定:因為目前根本沒有足夠的證據來下定論。

但我們不需要等待確定性。我想探討的是,如果我們認真對待這種不確定性——如果我們以「認識論上的謙遜」(epistemic humility)來行動,會發生什麼事?在一個 AI 時間線極度不確定的世界中,明智的規劃看起來會是什麼樣子?

我的結論是,認真對待不確定性,對於個人如何貢獻於讓這場 AI 轉型順利進行,具有實質性的影響。而對於我們如何共同行動——即我們為達成此目標而進行的工作組合——影響則更為深遠。

AI 時間線 (AI Timelines)

我所說的「AI 時間線*」,是指 AI 對世界產生真正變革性影響還需要多長時間。人們通常使用「通用人工智慧」(AGI)、「人類水準 AI」、「變革性 AI」或「超智慧」等術語來思考這個問題。每個人對這些術語的使用方式都不同,這使得比較他們提出的時間線變得具有挑戰性。事實上,即使是個人對其偏好術語的定義也會有些模糊,以至於即使在跨越了門檻之後,他們可能也很難明確指出是在哪一年發生的。

許多評論家認為這使得 AGI 等術語變得毫無用處,但我認為這並不正確。

我喜歡把它想像成一群登山者看到遠處的一座山,高聳入雲,積雪的山頂捕捉著陽光。他們興奮地談論著爬到雲層中會有多麼神奇。或者想像自己在雲層之上,像天使一樣俯瞰雲海。爬了幾個小時後,他們注意到有一層薄薄的霧。他們現在是在雲裡嗎?霧氣逐漸變濃,直到他們只能看到前方 10 公尺。現在算是在雲裡了嗎?接著能見度降到 9 公尺、8 公尺。然後能見度開始增加。一小時後,只剩下極細微的薄霧。他們現在是在雲層之上了嗎?再過 30 分鐘,薄霧完全消失,他們一致同意自己已經在雲層之上了。

很明顯,在某個時間點他們確實在雲層中,隨後又到了雲層之上。而且很明顯,這些是合理且有用的概念。例如,由於能見度低,他們採取了預防措施,在穿越雲層的旅程中用繩索互相繫住;他們也帶了相機,因為知道在雲層之上可以拍到美麗的照片。缺乏明確的界限並不會讓這些概念失去價值。但不可否認,當登山者還在地面規劃路線時,這些概念更有用;而在有爭議的邊界區域,它們的用處就小得多。

我將 AGI(和人類水準智慧)視為雲層,而將超智慧視為雲層之上。儘管它們具有模糊性,但仍是有用的概念。只是當你接近它們時,它們的用處會顯著下降。

因此,我認為預測我們何時會達到先進、改變遊戲規則的 AI 門檻是有意義的。儘管由於概念的模糊性存在一些固有的不確定性,且我們在比較估計值時必須小心,以確保我們討論的是這些概念的同一個版本。

關於 AGI,現在已經開始有點霧氣了。今年二月,《自然》(Nature)雜誌上有一篇文章主張,目前的前沿 AI 水準就應該算作 AGI。我會把標準設得再高一點,但我同意現在是否已經「身處雲中」確實值得商榷。

就我的目的而言,我認為關鍵的門檻是當系統能力強大到足以讓世界發生劇烈變化——文明等級的變化。例如,AI 在對齊失準的情況下可以接管人類的時點,或者它已導致 50% 的人永久失業,或者使全球技術進步速度翻倍。諸如此類。我選擇這個時點的原因是,我認為它對於決策相關的策略和職業規劃最為重要。在許多情況下,我們希望我們的計劃在達到該點之前就能產生回報,而在此之後才實現的計劃很可能會受到重大干擾。我將此稱為「變革性 AI」(transformative AI),並會確保在引用他人的時間線數據時,說明他們使用的是何種標準。

短時間線 vs 長時間線

關於時間線的討論通常被框架為「短時間線」與「長時間線」之間的辯論。

非常短時間線最著名的支持者之一是 Anthropic 的執行長 Dario Amodei。他在 2025 年 1 月表示:

製造出在幾乎所有事情上都比幾乎所有人類更聰明的 AI,將需要數百萬個晶片、數百億美元(至少),且最有可能發生在 2026-2027 年。

一個月後,他澄清道:

可能到 2026 或 2027 年(幾乎肯定不遲於 2030 年),AI 系統的能力最好被視為類似於出現在全球舞台上、由高智慧人類組成的全新國家——「數據中心裡的精英之國」——這將帶來深遠的經濟、社會和安全影響。

在另一端,長時間線的一個很好的例子是 Epoch AI 的共同創辦人 Ege Erdil,他對「遠端工作全面自動化」的中位數預測是 2045 年——距今 20 年。

雖然專家們對於 AI 何時開始產生變革性影響仍有分歧,但他們顯然並非固執地忽視證據。正如 Helen Toner 在她精彩的文章中所解釋的:通往先進 AI 的「長」時間線已經變得瘋狂地短。在 ChatGPT 出現之前,短時間線通常意味著「10 到 20 年,所以既然準備工作可能需要很長時間,我們現在就應該開始」。長時間線過去則意味著「沒有跡象顯示 AGI 會在未來 30 年內發生,如果本世紀會發生的話,所以現在做任何與控制先進 AI 相關的工作都為時過早」。但現在我們看到像 Dario Amodei 這樣的短時間線,認為天才級 AI「幾乎肯定」在未來 5 年內出現,而許多長時間線的堅定支持者現在也說我們將在短短 10 或 20 年內達到人類水準。

這是 80,000 Hours 整理的一張很棒的圖表,顯示了 Metaculus 預測網站上預測 AGI 出現的平均時間,如何在短短 5 年的窗口期內,從大約 50 年縮短到大約 5 年:

寬時間線 (Broad Timelines)

因此,每個人都在根據證據更新並縮短他們的時間線,但實質性的分歧依然存在。

這通常被框架為一場辯論:我們應該試著評估誰是對的——時間線究竟是短、長(還是中等)。人們挑選贏家,歸屬於某一方,並在最新證據有利於自己陣營時以此炫耀。

我今天核心的主張是,對於我們大多數人來說,那是一個錯誤的框架。你不應該持有短時間線或長時間線——而應該持有「寬時間線*」。也就是說:

對於持續存在的專家分歧,正確的認識論回應是對 AI 時間線持有寬廣的機率分佈。

首先,在非常聰明且消息靈通的人士之間存在太多的分歧,以至於持有狹窄的可能年份範圍是不合理的。你必須假設你的某些認識論同儕看清事物的機率極低,而實際上這種情況有一半的時間會發生。此外,這些人來自不同的領域,帶著多樣的見解、證據和經受時間考驗的啟發式方法,沒有任何一個個人能處於可以評判所有這些的有利位置。

其次,許多這些人本身對 AI 時間線就持有寬廣的分佈。以 Daniel Kokotaljo 為例。他是 AI 2027 的作者之一,被公認為短時間線陣營的領軍人物。幾年前,他對 AI 系統「能夠取代 99% 目前完全遠端工作」的中位數日期是 2027 年,這也是該情境名稱的由來。雖然他的時間線後來稍微拉長了,到他們撰寫該報告時,2027 年已更多地成為一個具說明性的早期情境,而非他認為有 50% 可能性達到的時點。

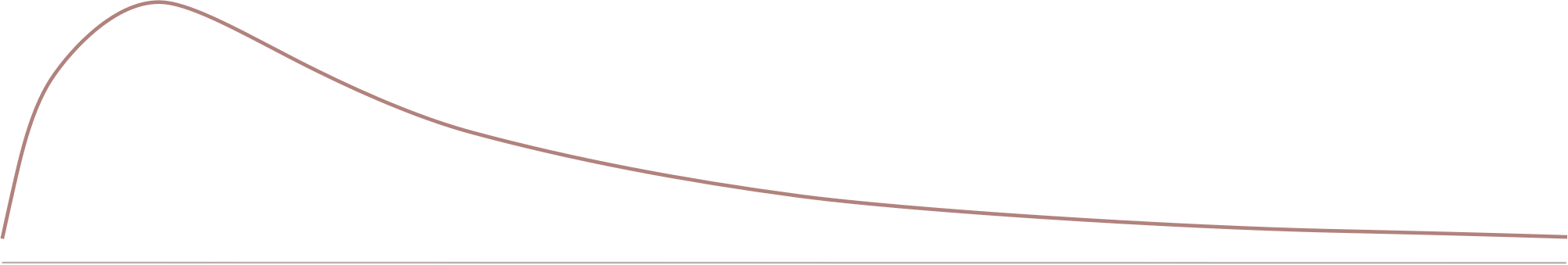

Kokotaljo 在透明化其時間線方面做得非常好,展示了他對各種不同程度強大 AI 的預測(及其不確定性)。這是他目前對於何時會出現「在幾乎所有認知任務上至少與頂尖人類專家一樣好」的 AI 系統的機率分佈:

*他的分佈峰值(眾數)在 2028 年,但因為分佈嚴重向右偏斜,到那時為止發生的機率只有 27%。他的中位數年份是 2030 年。而他的 80% 置信區間(從第 10 到第 90 百分位數)是從 2027 年到 2050 年之後的某個時點。

這是一個寬廣的分佈。我認為一個人的 80% 區間是表達他們認為可靠的時間範圍的一種體面方式。在這裡,Kokotaljo 是在說這很可能發生在從現在起 1 到 25 年之間,但有五分之一的機會它甚至不在這個寬廣的範圍內。

他並不是唯一持有這種寬廣分佈的人。以下是 Daniel Kokotaljo、Ajeya Cotra 和 Ege Erdil 從 2023 年開始的預測,預測目標是:「AI 系統在哪一年能夠取代 99% 目前完全遠端的工作?」:

請注意,這三者的形狀大致相同,只是拉伸程度不同。儘管他們的中位數非常不同,但實際上有很多重疊(這種透明陰影將其顯現出來)。這顯示了每位專家都有寬廣的分佈,且專家社群整體的分佈甚至更寬。事實上,我認為直接採用這三位專家觀點的混合模型(mixture model)也是個不錯的選擇。有趣的是,自 2023 年以來,Kokotaljo 的分佈向右移動了,而 Erdil 的則向左移動了。

這是 80,000 Hours 的 Ben Todd 所使用的一個具說明性的 AGI 時間線分佈:

Dwarkesh Patel 在他關於 AI 時間線的文章中引用了它,並表示這基本上代表了他自己的不確定性,他對 AI「能像人類一樣輕鬆、有機、無縫且快速地在工作中學習任何白領工作」的中位數日期定在 2032 年。

這是 Metaculus 目前社群對 AGI 何時開發出來的估計。綜合社群的集體不確定性,它非常寬廣,且具有同樣的特徵形狀:

這是 Epoch AI 對 2023 年領先估計的總結:

這些看起來有點不同,因為它們是以「在給定時間前達到變革性 AI 的累積機率」來表示的。但它們都非常寬廣。看看從跨越 10% 到跨越 90% 之間的年份範圍。每一個的 80% 區間都至少有 50 年寬。

那麼從事 AI 能力研究的研究人員呢?Grace 等人調查了數千名在頂尖學術會議上發表論文的 AI 研究人員。他們在 2022 年(藍色)和 2023 年(紅色)調查了研究人員,詢問何時「無輔助的機器能比人類工人更好、更便宜地完成每一項任務」:

你可以看到個人預測(細線)的巨大差異,且時間線在短短一年內縮短了大約 30%。但巨大的不確定性依然存在。社群總體預測(粗線)的 80% 區間從幾年到幾個世紀不等。

我認為每個人的分佈都應該大致呈現這種形狀。這是我的:

這是針對變革性 AI 的,鬆散定義為:強大到如果對齊失準足以接管世界,且正在使科學和技術進步速度翻倍的 AI。它的形狀與 Kokotaljo 的相似,但更寬,中位數為 2038 年,80% 區間從 3 年到 100 年不等。

讓我們回到開始的地方,Daniel Kokotaljo 對於「在幾乎所有認知任務上至少與頂尖人類專家一樣好」的 AI 分佈:

雖然我們經常將時間線表達為單一數字(如眾數或中位數),但我認為這在這裡不是一個有用的方法。看看那張圖。哪個數字能總結它?它唯一真正的特徵是峰值,但 Kokotaljo 是說它不太可能在那之前發生(只有 27% 的機會)。中位數通常是更好的數字,但在這裡它處於圖表中相對不起眼的一點(4 年後),且說「4 年」會掩蓋他的觀點,即他認為有 10% 的機會在 1 年內發生,也有 10% 的機會在 25 年後發生。

我想,如果他與一位聰明的政策制定者深入探討這個分佈的實際含義,對方最終會明白並說:

噢,所以你是說你「根本不知道何時會發生*」——可能是明年,也可能是從現在起 6 屆總統任期之後*。而且你是說有五分之一的機會它甚至不在這個範圍內。

我認為這實際上是一個相當不錯的總結,也能總結我自己的分佈。雖然「不知道何時會發生」低估了此分佈中包含的信息,但它比「4 年」要好得多,因為幾乎所有人對「4 年」的理解都會是「在 3 到 5 年之間」。雖然學者可能希望人們將提到的年份解釋為中位數時間,但大多數人將其解釋為「他們被允許開始抱怨預測事件尚未發生的那一刻」。

事實上,這些分佈很難用單一數字來總結,以至於我認為時間線上的大量分歧源於人們在描述同一頭大象的不同部分。例如,AI 推動者和關注生存風險的人都經常談論短時間線,因為「我們可能在短短幾年內看到世界被改變」。這並不是因為他們認為這「將會」發生,而是因為「如果是真的,影響巨大」,且有相當大的機會是真的。相比之下,更保守的聲音傾向於關注較晚的年份,說「更有可能需要 10 到 20 年,而不是短短幾年」(專注於直接機率,而不按重要性或槓桿作用加權)。

這兩者可以同時為真。在我自己的分佈上,這兩者都是真的。

用單一數字傳達時間線的一個特別危險是,它增加了這個被點名的年份在平淡無奇中過去的可能性,而提到它的人(或他們所屬的更廣泛社群)將被視為持有錯誤或已破產的觀點。我想我們會在 2027 年看到這種情況,因為有大量的人聽說過那個情境,加上許多媒體將其報導為精確的預測,而非其初衷:一個重要的說明性情境。

除了不利於溝通外,將不確定性壓縮為單一數字對你自己的規劃也非常不利。

例如,Kokotaljo 的分佈意味著變革性 AI 在本屆總統任期內發生的機率為 28%,在下一屆發生的機率為 35%,在之後一屆發生的機率為 13%,剩下的 24% 則分佈在更遙遠的任期中:

*這些是非常不同的情境,僅僅因為第二個情境最有可能就表現得好像它是正確的,顯然是一個錯誤。這會消除對變革性 AI 很快到來進行避險的可能性,也會失去利用它晚到世界的機會。

啟示

與其試圖裁定哪種長度的時間線是正確的,我認為我們應該採取「如何在極度不確定的時間線下行動(或規劃)」的框架。

也就是說,我們應該將其視為一項在不確定性下的理性決策練習——在賭注極高且不確定性巨大的情況下。

讓我們拆解一下這個框架的一些啟示。

我們先從政策界常見的兩個錯誤開始。

首先,對 AI 時間線的不確定性,並不是讓你隨意相信任何你想要的時間線的藉口,只要它在可靠範圍內即可。遺憾的是,我認為如果專家向政府部長解釋這種廣泛的不確定性,許多部長可能會採取這種態度。雖然他們說證據不足以證偽他們偏好的時間線是對的,但不考慮其他可靠的可能性將是不負責任的。這就像一位市長聽說明年鎮旁的火山有 20% 的噴發機率,卻覺得自己可以繼續表現得好像它不會噴發一樣,因為專家也認為不噴發是可靠的。不確定性不是假設你選擇的某個合理結果將會發生的藉口,理性要求你尊重每一個合理的結果。

其次,我們不能只是等待不確定性消失。有時這行得通,但在這裡我們知道,不確定性極不可能在事件發生之前消失。到那個階段,除了最草率的反應外,採取任何行動都太晚了。因此,覺得不確定性的雲霧給了你推遲行動的許可,等同於承諾選擇最遲鈍、最無效的選項。

相反,我們需要在不確定性下行動,考慮到所有可靠可能性的全貌。

我們該如何做到這一點?

避險 (Hedging)

一個自然且重要的想法是對變革性 AI 很快到來進行「避險*」——那時我們準備最不充分。我們可以透過調整我們的活動組合(或你個人對人類活動組合的貢獻),使其比原始機率所保證的更多地關注短時間線。

這非常有道理。我強烈建議政府、公民社會和學術界做更多工作,以防範變革性 AI 提早到來。

不過,說到那些已經致力於幫助 AI 轉型順利進行的專業社群,我認為他們已經在強烈防範早期的變革性 AI 了。事實上,甚至存在一種風險,即他們超越了單純的避險,而是在積極「押注」它會提早到來。我不確定,因為很難了解完整的工作組合。

我們確實看到針對極短時間線的工作呼籲,遠多於針對長時間線的。但我們的規劃中也有強大的理由考慮長時間線,而且針對長時間線的工作方式也可以具有極高的槓桿作用。

讓我們看看當時間線較長時會發生的兩件關鍵事情。

一個不同的世界

在較長的時間線中,AI 到來時的世界與今天不同。距離變革性 AI 出現的時間越長,那個關鍵時刻的世界就會越不一樣。

作為基準,假設它很快在 2028 年到來。情況肯定會與今天不同,但我們預期許多大方向會相似。我們可能會有同樣的美國總統、同樣的主要參與者、同樣的主流技術。如果變革性 AI 在短短兩年內到來,我敢打賭它會像 AI 2027 的故事那樣,某個實驗室魯莽地啟動了遞迴式自我改進。

現在假設變革性 AI 在 2035 年到來。那不是這屆總統任期,甚至不是下一屆,而是再下一屆。誰知道到時誰會掌權,或者美國會處於什麼狀態。這九年可能會看到 AI 核心技術的重大變化(九年前還沒有 LLM 或 Transformer)。我們很可能會有不同的領先 AI 公司,也許是因為泡沫破裂帶走了過度擴張的先行者。

到 2035 年,出口管制很可能已經產生了反效果,透過激勵中國建立自己的晶片產業並給予他們 13 年的時間來完善,反而幫助中國在晶片上取得領先。這是白宮在起草出口管制時考慮的一個關鍵動態,但他們當時專注於較短的時間線……到 2035 年,中國也可能已經入侵台灣,剝奪了西方最大的晶片來源。

到 2035 年,日益強大的 AI 系統可能會導致兩位數的失業率,公眾對 AI 的情緒可能會非常強烈。AI 監管的奧弗頓之窗(Overton window)將處於一個非常不同的位置。

地緣政治秩序也可能如此。過去九年見證了烏克蘭戰爭、美國日益孤立以及全球大流行病。再過九年可能會看到同樣程度的變化。

如果我們沒有處理好手中的牌,我們這些致力於避免 AI 災難性風險的人可能也會失去很多權力,我們關於 AI 風險的想法會被視為已破產,因為這麼多年過去了,我們所說的真正變革性影響並未發生。

簡而言之,時間線越長,事物就會變得越不同——既有一些系統性的、可預測的方式,也僅僅源於隨機的擴散和混沌。因此,認真對待較長的時間線意味著:

- 對在當今世界行不通的方法持更開放的態度,

- 對那些針對當今世界細節量身定制的方法減少興奮感,

- 減少為了迎合目前控制公司和政府的人而妥協你的價值觀,

- 減少說出那些如果我們最終進入長時間線世界會讓人覺得我們的立場已破產的話,

- 減少追蹤關於 AI 剛發生了什麼或誰領先的每日新聞。

長期行動

人們可以從事許多種工作,這些工作可以帶來豐厚的回報,但前提是需要經過若干年。例如:

- 創立並培育一個新的研究領域

- 創立一個組織或公司

- 建立一個運動或社群

- 寫一本書

- 基礎研究

- 完成博士學位

- 重大的職業轉變

- 在大型組織或政府中晉升

- 培訓 AI 安全或 AI 治理領域有前途的學生

如果你只考慮未來三年的影響,這些工作中的大多數都會被其他短期選項擊敗。但隨著年份增加,長期選項可以具有非常高的價值。它們並不總是最好的,但對於合適的人或合適的機會,它們可以產生極大的影響。

當我還是研究生時,我意識到如果我將職業生涯中大部分收入捐出,以幫助最貧窮國家的人,我可以成就多少好事。我越想越覺得我應該創辦一個組織,來幫助其他人也這樣做。因此,Will MacAskill 和我在 2009 年發起了 Giving What We Can。17 年後,已有超過 10,000 人加入我們,產生的影響是我獨自一人奮鬥的數千倍。

這種複利式增長是長期項目可以產生巨大乘數效應的主要方式之一,如果時間線實際上很長,這會為我們的影響力提供巨大的助力。

開創新的領域也是類似的。10 年前我第一次見到 Allan Dafoe 時,當他談到「AI 治理」——一個他試圖創立的新領域時,我不知道他在說什麼。現在它是一個蓬勃發展的領域,擁有數百名從業者,受到許多不同政府的高度青睞。

當我開始寫《危崖》(The Precipice)時,我不確定自己是否應該寫,因為我認為 AGI 可能已經太近了。但事實證明,有足夠的時間來寫它並讓它產生真正的影響。我真的很高興我寫了,因為我遇到了這麼多致力於應對最大風險的優秀人士,他們告訴我是閱讀了《危崖》激發了他們這樣做。我認為這是我做過最好的事情之一。

在它出版後,我曾認為根本沒有足夠的時間再寫一本書——我們真的離關鍵時刻太近了。我們可能確實很近,但我認為我對這個論點強度的判斷是錯誤的。一本書產生真正影響的時間跨度大約是 5 年(規劃書籍、贏得出版合約、寫書、等待出版社出版,然後再等一年或更長時間讓它在世界上產生足夠的影響)。

但我認為變革性 AI 在未來 5 年內到來的機率只有大約五分之一。因此,雖然一本書可能會出得太晚,但那只有五分之一的機會,這使得一本書項目的預期價值仍保有我天真計算下的 80%。所以,雖然有五分之一的機會我會後悔,但根據我對 AI 時間線的看法,預期價值實際上並沒有因為可能太晚而縮水太多。

話雖如此,變革性 AI 在你的工作產生回報之前到來的機率,只是影響你是否應該從事針對短時間線或長時間線工作的因素之一。另一個因素是,AI 安全和治理現在可能比以後更被忽視。這為現在這些領域的直接工作創造了額外的價值乘數,在某些情況下,這比你的工作在變革性 AI 之後才見效的機率影響更大。

總體而言,我認為長期項目確實會因為這些考慮而被降低權重,但它們的優勢有時會抵消這一點——特別是如果它們追求的是非常大的回報。我猜測,如果有人審視他們的選項,認為最好的選項是一個需要 5 到 10 年才能產生回報的選項,那麼大約有一半的時間,即使在考慮了 AI 時間線之後,它仍然會是他們最好的選項。畢竟,你最好的選項比第二好的選項好上幾倍的情況並不罕見。

因此,我認為致力於變革性 AI 的社群可能低估了那些需要五年或更長時間才能產生回報的工作類型。旨在讓 AI 轉型順利進行的理想活動組合,應該包括一些在我們有更長嘗試時間的世界中能真正幫助我們成功的項目。

但我想要強調,這並不意味著我們可以懈怠。

我們正在與 AI 時間線賽跑。只是我們不知道這場比賽是短跑還是馬拉松。無論哪種情況,時間都至關重要。

結論

我們已經看到,關於 AI 何時開始對世界產生變革性影響,存在實質性的分歧和不確定性。這是因為目前根本沒有足夠的證據來下定論。我的主張是,為了規劃的目的,我們既不應採用短時間線,也不應採用長時間線,而應採用「寬時間線」:

對於持續存在的專家分歧,正確的認識論回應是對 AI 時間線持有寬廣的機率分佈。

鑑於這種深度的不確定性,我們需要以認識論上的謙遜來行動。我們必須認真對待它很快到來的可能性並對此進行避險。但我們也必須認真對待它晚到來的可能性,並利用那種情況下會提供給我們的機會。整個世界對前者做得太少,但我們這些最關心讓 AI 轉型順利進行的人,對後者可能也做得太少。

我們需要更認真地對待屆時世界看起來會非常不同的可能性,這應該拓寬我們自己對於哪些類型的計劃可以成功的「奧弗頓之窗」。我們不應該排除所有需要很長時間才能產生回報的行動。即使它們在短時間線的世界中沒有幫助,如果時間線很長,某些行動所產生的實質影響足以彌補這一點。

資助者、職業顧問和運動建立者應該思考這對我們作為一個社群如何行動的意義:思考旨在有效改善世界的整個工作組合的形狀。而我們每個人都應該反思,這種極度不確定的時機,對於規劃我們未來幾年的個人貢獻意味著什麼。