構建更好的 AI 基準測試:多少位評分者才足夠?

我們推出一套機器學習模型評估框架,透過優化評估項目數量與每項評分者人數之間的權衡,為構建能捕捉人類分歧且具高度可重複性的 AI 基準測試提供指引。

打造更好的 AI 基準測試:多少位評分者才足夠?

2026 年 3 月 31 日

Flip Korn 與 Chris Welty,Google Research 研究科學家

我們推出了一個基於「黃金」評分數據的機器學習(ML)模型評估框架,該框架優化了項目數量與每個項目評分者人數之間的權衡,為建立高度可重複且能捕捉人類意見分歧細微差別的 AI 基準測試提供了藍圖。

快速連結

在機器學習中,可重複性(reproducibility)衡量的是使用相同的代碼、數據/分佈和設置來重複相同實驗並獲得相同結果的難易程度。高水平的可重複性能建立團隊之間的信任,並讓他們能夠在彼此的進展基礎上繼續發展。

可重複性的挑戰在於,基準真相(ground truth)數據通常依賴於人類;而人類與機器不同,會從各種角度看待所有問題,且經常對結果產生分歧。令人驚訝的是,很少有研究探討有效忽略人類分歧所帶來的影響,而這正是 AI 基準測試中常見的疏忽。缺乏研究的原因之一是收集人類支持的評估數據預算有限,且為每個範例獲取更多評分者的樣本會大幅增加每個項目的標註成本。

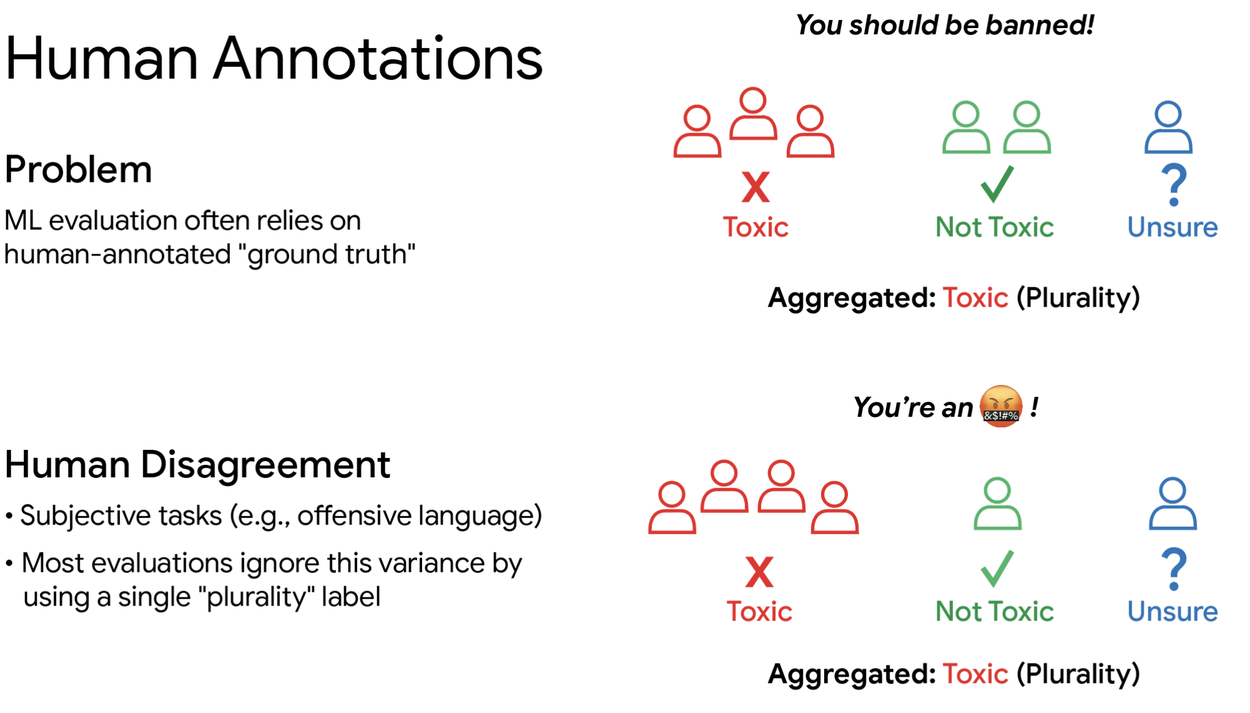

使用多數決來代表多個評分會忽略變異性。上述兩個範例具有相同的多數決結果,但後者明顯更傾向於「有毒」。

在《森林與樹木:可重複 ML 評估中的 (N,K) 權衡》(Forest vs Tree: The (N,K) Trade-off in Reproducible ML Evaluation)一文中,我們研究了被評分項目比例與每個項目的人類評分者數量之間的可重複性權衡。是針對許多項目使用較少的評分者更好,還是針對較少項目使用較多的評分者更好?這可以看作是廣度與深度之間的問題。廣度(即森林)方法是請 1,000 個不同的人每人嘗試餐廳的一道菜,以獲得整體的品質感。深度(樹木)方法則是請 20 個人嘗試相同的 50 道菜,從而揭示更多關於特定菜餚的信息,這可能會影響整體評分。

從歷史上看,AI 評估傾向於森林方法。大多數研究人員滿足於每個項目 1 到 5 名評分者,假設這足以找到單一的「正確」真相。我們的研究表明,這一標準通常不足以捕捉自然的分歧,我們為建立更可靠且具成本效益的 AI 基準測試提供了藍圖。

實驗:模擬預算

破壞經驗基準測試的主觀性是可重複性的主要挑戰。如果兩位不同的研究人員進行相同的評估並得到不同的結果,那麼該研究就不具備可重複性。為了在被評分項目數量和每個項目的評分者數量之間找到最佳平衡,我們開發了一個基於現實世界數據集的模擬器,這些數據集涉及毒性和仇恨言論檢測等主觀任務。

我們實質上進行了一次大規模的「壓力測試」,以尋找花費特定研究預算(例如,以成本、時間等衡量)的最有效方式。我們改變了兩個主要槓桿,看看哪一個能產生最可靠的結果:

我們使用模擬器在各種規模下測試了數千種此類組合,以查看哪些配置在統計上最可靠(p < 0.05)——從而具備可重複性。

用於比較 ML 模型 A 和 B 與「黃金」標籤關係的評估框架流程圖。

為了支持更廣泛的社群,我們已在 GitHub 上開源了此模擬器。

數據集

我們使用了多個數據集,每個數據集包含多個類別,每個項目有多個回應:

利用這些數據集,我們還測試了當數據「混亂」時會發生什麼。例如,如果 99% 的電子郵件是垃圾郵件,只有 1% 是重要郵件(表明數據高度偏斜),這是否會改變最佳評分者分佈(廣度 vs. 深度)?此外,我們還探討了擁有更多數據類別(例如毒性標籤,如:有毒、輕微冒犯、中性等)的影響。

關鍵發現:沒有一體適用的方案

我們的研究揭示了三個重大見解,挑戰了機器學習評估的現狀:

1. 3–5 名評分者的「標準」並不足夠

我們的結果顯示,每個項目使用 1、3 或 5 名評分者的常見做法通常是不夠的。這種「低評分者」方法既沒有足夠的廣度來看到大局,也沒有足夠的深度來理解人類意見的細微差別。為了獲得反映人類細微差別的真正可靠結果,從業者通常每個項目需要 10 名以上的評分者。

每個項目擁有更多評分者會增加統計顯著性,因為 p 值趨近於零。這意味著我們可以捨棄模型 A 和 B 表現同樣出色的虛無假設,而模擬器確保了事實並非如此。

2. 指標決定策略

沒有「完美」的比例。相反,最佳權衡完全取決於正在衡量的內容:

3. 效率觸手可及

最令人鼓舞的發現是,人們不需要無限的預算。我們發現,通過根據所選指標正確優化「每個項目的評分」比例,只需約 1,000 個總標註量的適度預算,即可獲得高度可重複的結果。然而,選擇錯誤的平衡可能會導致不可靠的結論,即使增加研究預算也是如此。

為什麼這對 AI 的未來很重要

這項研究對於可靠 AI 的未來至關重要。多年來,該領域一直運行在「單一真相」範式下——即認為對於每個輸入,都有一個「正確」的標籤。但即使存在單一的基準真相,也可能無法衡量它。隨著 AI 進入更具主觀性的領域(如倫理、識別有害意圖或社交互動特徵等主觀概念),該範式就會崩潰。

通過遠離「森林」並擁抱「樹木」,我們可以建立真正反映複雜性和不同觀點的基準測試,這些觀點導致了人類世界中自然存在的分歧。這份藍圖讓從業者能夠在不超支的情況下設計出更好、更具可重複性的測試。最終,理解人類為何產生分歧與了解他們在何處達成一致同樣重要,而我們的研究提供了捕捉這兩者的數學工具。

致謝

這項工作很大程度上歸功於我們的合作者:RIT 的博士生 Deepak Pandita 和 Christopher Homan 教授。

快速連結

其他感興趣的文章

2026 年 3 月 31 日

2026 年 3 月 25 日

2026 年 3 月 24 日