ControlAI 2025 年度影響力報告

我們在報告中指出,ControlAI 已成功向數百名全球立法者簡報超人工智慧帶來的生存風險,並建立跨國聯盟,致力於透過政策行動與國際協作來防止超人工智慧的開發。

這篇文章摘錄了我們完整影響力報告中的幾個關鍵部分。您可以前往 https://controlai.com/impact-report-2025 閱讀完整報告。

ControlAI 是一個非營利組織,致力於規避超人工智慧(superintelligence)所帶來的滅絕風險。我們幫助數十萬人了解這些風險,並與數百名立法者會面,直言不諱地告知他們事關重大的利害關係。

在短短一年多的時間裡,我們向 200 多位國會議員進行了簡報,建立了一個由 110 多位英國立法者 組成的聯盟,承認超人工智慧是國家安全威脅,促成了英國上議院的兩次辯論,且我們的工作促使加拿大議會針對 AI 風險與超人工智慧舉行了一系列聽證會。^([1]) 這些聽證會包括來自 ControlAI 的我(Andrea)和 Samuel、Connor Leahy、Malo Bourgon (MIRI)、Max Tegmark 與 Anthony Aguirre (FLI)、David Krueger 等人的證詞。

本報告涵蓋了 2024 年 12 月至 2026 年 1 月期間的成果。截至 2026 年 3 月發布此文時,我們已向 279 位立法者和 90 多個美國國會辦公室進行了簡報。 僅在過去 2 個月內,儘管我們在加拿大和德國各只有一名工作人員,但簡報過的立法者人數已從約 50 人擴展到 100 多人。

展望未來,我們計劃大幅擴展在美國的工作,加速從提高意識轉向政策行動的進程,並在所有其他 G7 國家建立據點。

ControlAI 的使命

ControlAI 的使命是規避超人工智慧所帶來的滅絕風險。

諾貝爾獎得主、頂尖 AI 專家,甚至是主要 AI 公司的執行長都曾警告,超人工智慧對人類構成了滅絕風險。然而,大多數決策者和公眾對這些風險仍一無所知。

為了規避這些風險,我們需要防止超人工智慧的開發。我們以直接且坦率的方式解決這個問題:會見民主進程中的所有相關參與者,告知他們風險與解決方案,並有系統且反覆地要求他們就此議題採取行動。

我們幫助數十萬人了解超人工智慧帶來的滅絕風險,並採取公民行動。我們與數百名立法者會面,直言不諱地告知他們超人工智慧的風險。我們協助立法者公開發聲,並推動具體措施,在國家和國際層面上防止超人工智慧的出現。

我們經常遇到在會面前從未聽說過超人工智慧風險的立法者,而在會面結束後,他們轉而支持我們的運動。

在英國,我們從向所有立法者進行陌生接觸(cold outreach)開始,一年後,我們擁有一個由 110 多位立法者組成的聯盟,承認超人工智慧是國家安全威脅,這已促使英國議會就超人工智慧與滅絕風險進行了兩次辯論。

我們現在正將此模式擴展到其他國家,包括美國、加拿大和德國。我們在本文中展示的早期結果表明,我們的策略是可以跨國複製的。

我們僅憑不到 15 人的團隊就取得了這些成果,且與問題的規模相比,預算非常有限。 隨著資源的增加,我們的方法還有巨大的擴展空間。

我們去年的成果

立法者接觸

約 1/2 接受我們簡報的英國立法者隨後支持了我們的運動

110+ 位英國立法者支持了我們的運動

2 場關於超人工智慧與 AI 滅絕風險的議會辯論

媒體與內容創作者接觸

18 篇因我們的工作而產生的關於超人工智慧風險的媒體報導

14 部與總計超過 2000 萬訂閱者的內容創作者合作發布的影片

公眾意識運動與立法者參與工具

160,000+ 封由選民發送給美英立法者關於超人工智慧滅絕風險的訊息

30,000+ 人透過我們在美國和英國提供的工具聯繫了他們的立法者

變革理論

意識差距

為了建立強大的國際協調以防止超人工智慧,各國將需要資金、政治意志、外交影響力以及優秀人才的持續關注等資源。

在這些參與者眼中,只有對超人工智慧及其風險的深度覺察,才能證明這類投資的合理性。如果沒有真正的理解和信念,個人和國家將不會承擔解決問題所需的實際成本,也不會在 AI 開發演進以及政治或經濟環境變化時保持警惕。

目前,這種意識幾乎不存在。各國的決策者和公眾在很大程度上並未意識到它所帶來的滅絕風險。當我們開始時,幾乎沒有人直接向立法者提出超人工智慧的滅絕風險。

在大規模的決策者和公眾中建立這種意識,是針對超人工智慧採取任何有意義行動的必要第一步。

為了啟動防止超人工智慧開發所需的國際協調,我們需要集結足夠數量的國家,讓它們對超人工智慧風險的重視程度至少等同於今日對核戰威脅的重視,並將其開發視為對國家安全的任何其他嚴重威脅。

建立聯盟

有了足夠的支持,下一步就成為可能。在公眾要求行動的支持下,知情的政府可以追求具體的政策措施:禁止開發超人工智慧的國家立法,以及仿照現有不擴散和防止大規模殺傷性武器框架的國際協議。

這些措施可以透過一個強大的國家聯盟來實現,該聯盟將超人工智慧視為對其國家安全的重大威脅,並像對待任何其他嚴重安全威脅一樣對待其開發。

這樣的聯盟擁有多種可用的執行工具,從正式協議和檢查制度到制裁和多邊監測機制,這些工具與過去用於限制核擴散和其他全球安全威脅的工具相同。

超級大國和中等強國都具備加入這一努力的有利條件,因為它們都面臨著超人工智慧開發所帶來的普遍滅絕威脅。

ControlAI 的存在是為了確保能有一個強大的國家聯盟挺身而出,迎接防止超人工智慧開發的挑戰。

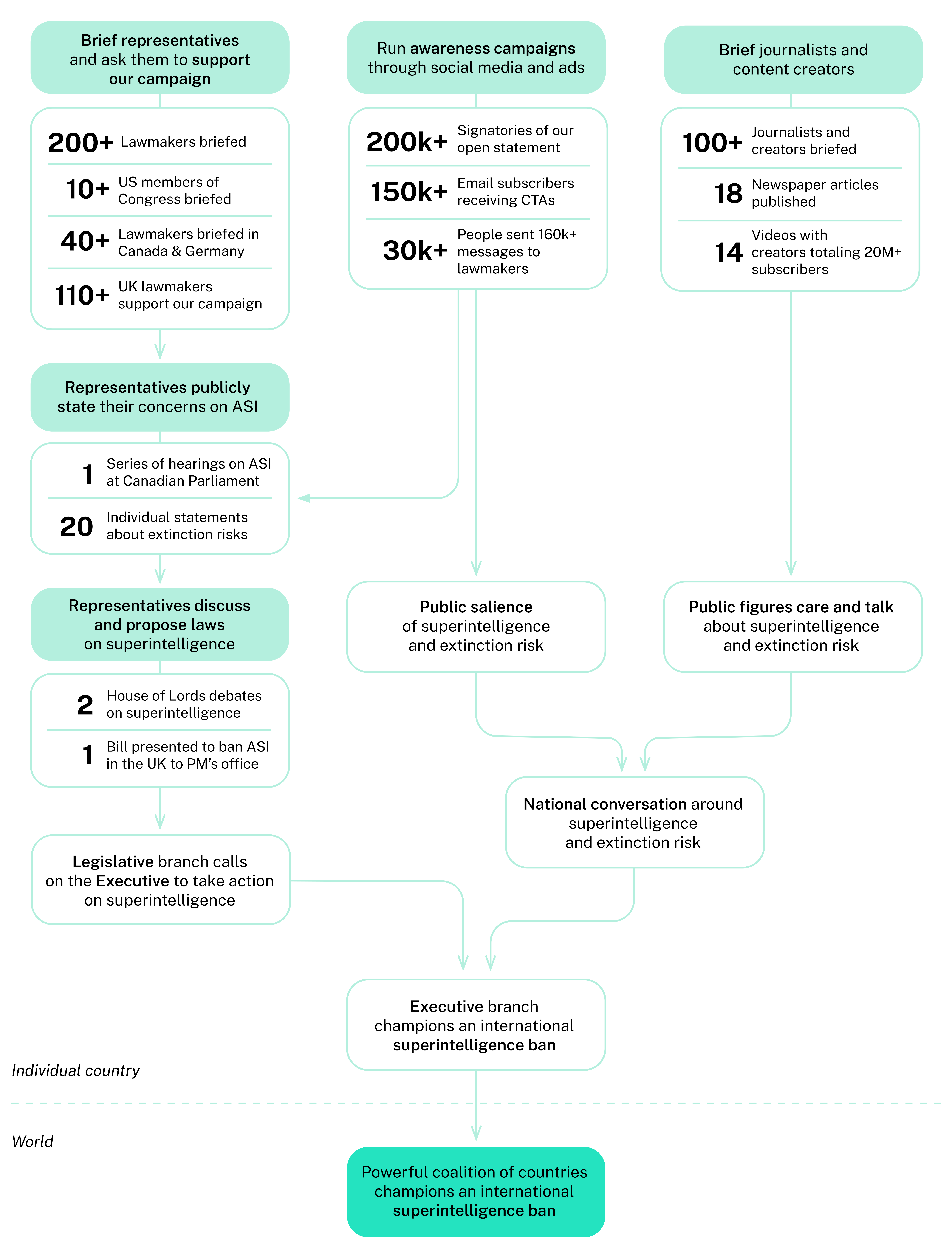

我們的變革理論詳情

此圖表詳細描述了我們的變革理論,並闡明了我們的工作如何融入其中。

展望未來

在短短一年多的時間裡,我們已經證明,直接讓民主機構參與討論超人工智慧的滅絕風險是行之有效的。

英國是我們的概念驗證;我們現在正於美國、加拿大和德國複製這一模式。在英國,我們已經協助將超人工智慧議題帶入政治殿堂,2026 年將是將這一勢頭轉化為具體政策變革的一年。

隨著規模的擴大,我們有信心更多的資源將直接轉化為更多有立法者理解並應對這一威脅的國家。我們將擴展在美國的工作,加速從提高意識轉向政策行動的進程,並在所有其他 G7 國家建立據點。

如果您是希望幫助建立「讓人類保持主導權」聯盟的捐贈者或合作夥伴,請透過 partners@controlai.com 與我們聯繫。

- 截至 2026 年 3 月,我們聯盟的一位成員已向英國網路安全法案提交了一項修正案,將超人工智慧識別為「能夠自主危害國家安全、逃避人類監督並顛覆國際穩定的系統」。該修正案將在英國議會進行討論。↩︎