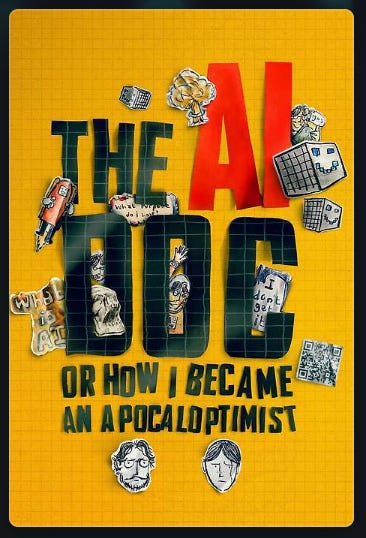

影評:AI 紀錄片《AI 醫生:我如何成為一名末日樂觀主義者》

這篇評論分析了一部紀錄片,記錄了一位父親如何從對人工智慧的焦慮轉向末日樂觀主義,並探討了生存風險與技術希望之間的緊張關係。

《AI 紀錄片:我如何成為一名末日樂觀主義者》(The AI Doc: Or How I Became an Apocaloptimist) 是一部傑作。

(這將是一篇包含完全劇透的總結。如果你還沒看過這部紀錄片,我建議去看一下,在大多數方面,它已經達到了現實中所能做到的最好程度。)

就像許多事物一樣,它之所以有效,是因為其核心是真實的。紀錄片的創作者顯然真的結婚並有了孩子,對 AI 感到恐慌,出於對兒子未來的擔憂向正確的人請教,現在因為(簡化版的)正確理由而對真實存在的生存風險感到更加恐慌,於是踏上了一段尋求停止恐慌並轉向樂觀的旅程。他為此找到了許多正確的人,並提出了良好的非技術性問題,雖然有些被唬弄了,聽取了平庸的安全投訴,尋求並獲得了頂尖執行長(CEO)的採訪,試圖告訴自己可以忽視這一切,但最終決定不以一堆充滿希望的嬰兒畫面作結,而是發出行動呼籲,以幫助塑造未來。

標題是正確的。這部片是關於「我如何成為一名末日樂觀主義者」,以及他為什麼想成為那樣的人,而不是論證末日樂觀主義是準確的。與 Tyler Cowen 的觀點相反,更深層的施特勞斯式(Straussian)訊息並非「干預措施是虛假的」,而是「許多人選擇相信關於 AI 的虛假事物,以便感覺一切都會好起來」。

許多剪輯選擇,以及對插播和片段的選取,顯然來自一個沒有技術知識、正試圖應對焦慮的外行。其中許多不會是我的選擇,特別是對武器和物理破壞的強調,但我認為它們之所以奏效,正是因為這些選擇共同表明了整件事是真誠的。

現在有了一個故事。它甚至在網上贏得了公平且優秀的讚譽,無論是擔心生存風險的人,還是幾位加速主義樂觀主義者,因為它都給了雙方最想要的東西。

e/acc(有效加速主義)領袖 Beff Jezos 表示這部片很好,且最終相當平衡。MIRI 的 Rob Bensinger 也高度推薦同一部電影。David Krueger 說它很棒,如果每個人都看過會很好。Riley Goodside 也表示贊同。Tyler Cowen 發現它比他預期的更好、更聰明,讓聰明的人從各種角度發表意見。

是的,你可以同時做到這兩點,因為他們想要不同的東西,而且在相當多真實的事情上達成了一致。這比謾罵更有影響力。

我們生活在一個充滿政治化修飾(spin)的世界。Daniel Roher 試圖在修飾的世界中穿行,但他的真誠閃耀其中,他在採訪對象的選擇上做得非常出色。他會被面前的人說服,這是一個特點而非缺陷,因為他並未試圖隱藏這一點。在某些地方,人們顯然在試圖修飾,或者在提出愚蠢的觀點,我很感激他沒有試圖告訴我們哪個是哪個。

MIRI 為我們提供了一個 Twitter 常見問題(FAQ)討論串 和一個完整的網站 FAQ,解釋了他們在電影背景下的完整立場:這不是炒作;是的,如果我們繼續開發,它會殺死所有人;不,我們目前的安全性技術對此毫無幫助;他們呼籲簽署國際條約。

是否有人認為這是宣傳或偏袒一方?是的,當然有,儘管他們無法就它試圖支持哪種觀點達成一致。

嬰兒太棒了

貫穿始終的個人旅程是關於 Daniel 有了一個兒子。電影採取了一個非常明確的立場,我們需要更多地看到這種立場,即結婚、組建家庭、生孩子和養孩子都是超級棒的事情。

這變成了他問採訪對象的第一個問題:考慮到 AI 的現狀,你今天會生孩子嗎?

許多擔心 AI 殺死所有人的人說不。他們不試圖勸阻其他人,但我們看到 Eliezer Yudkowsky 說他在這條時間線上不會這麼做,我們看到 Dario Amodei 說你應該做你本來就會做的事,還有一點「嗯,讓我們先處理好這個 AI 局勢,然後再看」。

而基本上所有的樂觀主義者都說,今天是有史以來生孩子或作為孩子出生的最好時機,未來會讓你大吃一驚。

在這個問題上,我站在樂觀主義者一邊。考慮到生存風險,我不確定我是否會說今天是有史以來生孩子的最好時機,但除此之外,這絕對是一個偉大的時代,這些孩子的潛力從未如此巨大。最重要的是,我不認為如果你有了孩子,而人類最終失敗了,你就讓事情變得更糟。孩子本身就是有價值的,無論你能給他們多少時間,擁有這段時間都比從未存在過要好得多。

人們擔心 AI 殺死所有人

第一組訪談概述了危險。

這不是一部技術電影。我們得到的解釋能引起普通人的共鳴。

我們看到 Jeffrey Ladish 解釋了工具性收斂(instrumental convergence)的基本原理:如果你有一個目標,那麼權力能幫助你實現該目標,而且如果你死了,你就無法去拿咖啡。這並不是說 AI 會恨我們,而是它會像我們看螞蟻一樣看我們,如果你想在蟻丘所在的地方修高速公路,那是螞蟻的問題。

我們看到 Connor Leahy 談到,創造比我們更聰明、更有能力的東西並不是一件安全的事情,並強調你不需要為此提供進一步的理由。我們看到 Eliezer Yudkowsky 說,如果你與比你聰明得多、不在乎你且想要其他東西的生物共享一個星球,你不應該對自己的勝算感到樂觀。我們看到 Ajeya Cotra 解釋了更多的事情,依此類推。

除此之外,我們沒有聽到任何關於「對齊問題」(alignment problem)的討論,我不記得電影中是否出現過「對齊」這個詞。

我很難知道這些論點引起了多少共鳴。我絕對不是目標受眾。總體而言,我覺得它們得到了公平對待,而且這些論點既強大又足以說服人。是的,顯然我們在這裡遇到了很大的麻煩。

恐慌

Daniel 的反應是——這是完全可以理解且正確的——感到恐慌。

然後他非常明確地問,有沒有辦法對此保持樂觀?他能說服自己一切都會好起來嗎?

我很難恰當地表達我多麼感激這一點如此明確。

第二部分不是對真理的追求。它是為了停止恐慌,而不管底層事實如何。

其他人不擔心 AI 殺死所有人

技術樂觀主義者和加速主義者很樂意效勞。

他們帶著積極的氛圍和技術解決我們所有問題的承諾而來。Peter Diamandis 首先指出,技術在歷史上為人類做了偉大的事情。Beff Jezos 承諾未來會有更多這樣的事情,未來將會非常精彩。你看,人們總是害怕新技術,但這是自然的一部分,恐懼可能是有用的。

這幾乎就是全部的論點:技術以前是好的,所以技術現在也會是好的。

這群人的氛圍(vibes)非常好。

細心的觀察者會注意到,這並不構成多大的論證。是的,這是貝氏證據(Bayesian evidence),表明人們以前也擔心過並認為事情正在終結,但如果你只有這些,那是一個極其糟糕的信號。人類使用技術和工具讓生活變得更好,並不意味著創造卓越的、足夠先進的人造心智是一件安全且可能會有好結果的事情。它沒有回答任何關於生存風險或「毀滅」(doom)的案例。

事實上,當我們回到第一組擔憂的人群時,他們——特別是 Tristan Harris 還有其他人——欣然肯定承諾和好處是真實的,技術對人類來說是棒極了。問題在於,這一切都不意味著我們不會全部死掉,也不提供理由認為生存風險不存在。

我們甚至看到有人原話說,問題不在於我們能否在 AGI(通用人工智慧)中倖存,問題在於我們能否在沒有 AGI 的情況下倖存。他甚至一臉嚴肅地直接引用了潛在的小行星撞擊。

請注意,Anthropic 的總裁、Dario 的妹妹 Daniela Amodei 出現在這一部分,而不是第一部分。她沒有主動駁斥 AI 生存風險,但她幾乎完全專注於上行潛力。非常耐人尋味。

正如 Robin Hanson 指出的,這並不意味著沒有更好的論點來證明生存風險不太可能發生。但似乎沒有人提出這樣的論點。

當你有氛圍時,誰還需要論點?

Aella 看完電影後對樂觀主義者感到憤怒,因為他們沒有提出任何論點。而我對此並不生氣,因為他們並沒有認真聲稱自己在提出任何論點,所以展示他們沒有論點的推銷,提供了關於這一事實的關鍵信息。以一種讓這些人認可為公平的方式來做這件事,讓外行看到這裡沒有辯論,因為在「沒什麼好擔心的」那一邊沒有好的論點,儘管有好的論點支持比 MIRI 所相信的更高的成功機率。

深偽小鎮與即將到來的機器人啟示錄

接著我們迎來了第三組訪談和擔憂,這時我們請來了 Emily Bender、Timnit Gebru 等人,我們談論深偽(deepfake)影片、不平等、權力、用水量以及所有其他各種妖魔鬼怪。

這讓氛圍回到了「噢不」,而沒有深入探討任何具體主張。這裡的一些擔憂是真實的,有些雖然不為零但基本上是虛假的,明智的是,虛假的那些沒有被重點關注。主要的焦點是深偽(目前尚受控但確實是個問題)以及不平等和人類無法保住工作的景況。鑑於我們已經涵蓋了實際的生存風險,我會允許這一點,你確實必須面面俱到。

停止 AI 競賽與一條狹窄的道路

討論現在轉向 AI 競賽的動態。我們看到各界人士指出,競相以最快速度構建更有能力的 AI 是糟糕的,正如 Connor Leahy 所說,多個項目同時競相開發 AGI 是最糟糕的情況,而,我們現在就在這裡。

Tristan Harris 將情況描述為需要在雙重危險之間尋找航向。

如果我們完全「放任自流」,那肯定會以災難告終,誤用被列為核心原因。我同意,但請注意,電影沒有適當地證明這一點,它應該指出,如果每個人都有足夠先進的 AI 可用,那麼 AI 實際上就掌握了主導權,因為每個人都必須使用他們的 AI 來競爭資源並代表他們管理生活,依此類推。

如果我們「關閉它」,我們將無限期地錯過 AI 的承諾,而且正如包括 Demis Hassabis 在內的許多人指出的,這只有在獲得所有人(包括中國)的支持時才有效,而這並非易事。我很遺憾我們沒有看到更多關於這種支持是可能的討論,但將此置於範圍之外感覺是合理的。

相反,電影合理地說,我們必須在兩個選項之間開闢出一條狹窄的道路。你不能全速前進,也不能完全停止。

我發現論點薄弱的一個地方是「安全性最差的實驗室獲勝」,因為這假設了安全性與實用性之間存在權衡(即對齊稅是巨大且正向的,但到目前為止並非如此),並且還假設參與者大致平等。

執行長們知道自己的角色

既然這一切都由「五個人」掌控,他便出發去與 OpenAI、Anthropic、Google、xAI 和 Meta 的五位執行長交談。

結果令人印象深刻,也堪稱完美。

-

OpenAI 的 Sam Altman 出現時說話輕聲細語,友好但嚴肅。他們互相祝賀建立了家庭,Altman 承認整件事很可怕。他對於如何使 AI 安全的回答是迭代部署和測試,而他認為 OpenAI 能使其安全的原因是他們可以利用領先優勢。我不認為 Altman 聲稱領先於 Anthropic 是公平的,即使在當時也是如此,但除非他要發布新聞,否則 Altman 的表現已經達到了他所能做到的最好程度。

-

Dario Amodei 也展現了他一貫的自我。他承認了現狀,並指出需要政府在協調和安全方面提供幫助。

-

Demis Hassabis 指出協調需要是國際性的,並強調了他最喜歡的一些 AI 優點。

-

Elon Musk 說他會參與,但太忙了,什麼也沒給我們留下。

-

Mark Zuckerberg 則完全拒絕參與。

他有拷問執行長們嗎?沒有。他沒有拷問執行長們。

問題並不全都很簡單,但他保持了友好,並提出了他顯然需要問的問題。我認為在這樣的情況下這是正確的做法,因為他不具備提出我想要問的那種「言辭犀利」問題所需的專業能力。讓他們說下去,讓他們進入一種盡可能真誠而非對抗的模式。

行動呼籲

我很欣賞那個虛假的結尾,無論是在現實層面還是後設層面。我很好奇那是哪種程度的虛假,他是否真的考慮過在那裡結束。

真正的結尾是標準的「希望的勇氣」:打電話給你的國會議員,尋求國際條約來解決這個協調未來並拯救世界——這是許多紀錄片結尾的未來取決於我們的說辭。在這種情況下,是的,世界確實需要拯救。有一個行動呼籲的連結。

人們通常會對此嗤之以鼻。我不會責怪任何人這樣做。

但在這種情況下,未來尚未寫就、人類可以選擇一條除了「毀掉一切,要麼讓文明崩潰,要麼將一切交給壞人」之外的不同道路,這一論點本身就相當具有爭議性,因此你不應該嘗試。

作為一個例子,Tyler Cowen 在回應這一章節時明確表示,「現實中,無論好壞,最終決定將繼續由國家安全機構做出」,這暗示了他們以前就在這類事務上做最終決定,或者他們將來會這樣做,並且還暗示你無法影響這些人做出什麼決定,或者這些人無法接受指示、無法參與國際合作。

對此,正確的回應是:帶著那種態度,當然不行。