透過 LM Studio 全新無介面 CLI 與 Claude Code 在本地端執行 Google Gemma 4

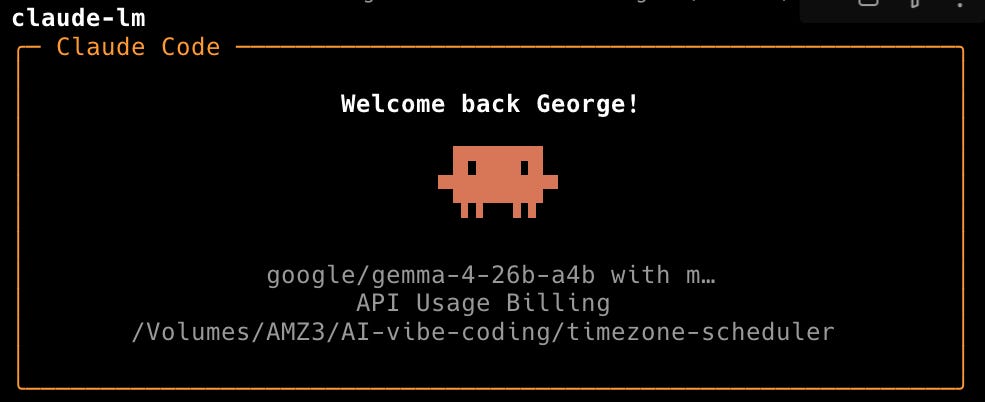

這份指南說明如何使用 LM Studio 0.4.0 全新的 CLI 與後台程式,在 macOS 上本地端部署 Google Gemma 4 26B 模型,讓您能在無需支付 API 費用且兼顧隱私的情況下,配合 Claude Code 進行高效能的 AI 開發。

背景

隨著 Google 推出 Gemma 4 系列模型,本地端推論的門檻進一步降低。LM Studio 在 0.4.0 版本中引入了名為 llmster 的無頭模式與 lms 命令列工具,讓開發者能更靈活地在 macOS 或伺服器環境中部署模型。本文探討如何利用 Gemma 4 26B-A4B 的混合專家架構,在本地端提供高效能推論,並將其作為 Claude Code 的後端引擎,實現零 API 成本且具備隱私保護的開發流程。

社群觀點

針對將 Claude Code 介接至本地模型的做法,社群反應呈現兩極。支持者認為這種配置能有效節省 API 開銷,且在 LM Studio 提供 Anthropic 相容介面後,設定變得極其簡單。然而,實務上的穩定性仍是一大挑戰。有使用者指出,LM Studio 在搭配 Claude Code 時常出現邏輯中斷的問題,模型往往在規劃好步驟後,執行到一半便無故停止,必須不斷手動要求繼續。相比之下,部分開發者認為 Ollama 的 API 在處理這類任務時表現更為穩定,是目前本地開發更可靠的選擇。

關於模型架構的討論也十分熱烈。雖然 Gemma 4 26B-A4B 憑藉混合專家架構在推論速度上表現優異,但有留言提醒,MoE 架構並不能節省記憶體空間。即便推論時僅活化部分參數,所有權重仍需完整載入記憶體中,因此對 VRAM 的需求並未降低。不過,也有資深玩家補充,若使用支援將部分專家權重卸載至系統記憶體的推論引擎,確實能在顯示卡記憶體不足的情況下,勉強運行參數規模較大的模型。

此外,社群對 Claude Code 作為前端工具的效率提出質疑。有觀點認為 Claude Code 的權杖消耗極其驚人,這在雲端訂閱制下或許不是問題,但在本地端運行時,長上下文窗口對 VRAM 的壓迫會讓開源模型顯得力不從心。當上下文累積到一定程度,開源模型往往會開始產生混亂,難以維持邏輯一致性。這引發了對 Anthropic 未來態度的擔憂,部分討論者懷疑該公司是否會持續允許這種將其工具作為第三方模型前端的用法,或者會透過更新來限制非官方模型的使用,以維護其商業利益。

延伸閱讀

在討論過程中,社群成員提到了幾個值得關注的替代方案與工具。除了廣為人知的 Ollama 之外,有人推薦了名為 Caveman 的工具,這是一個專為 Claude 設計的輕量化介面,適合偏好簡約開發環境的使用者。另外,針對編碼代理工具的選擇,社群也提及了在 Claude Code 出現前就已相當成熟的 Aider,認為其在處理複雜編碼任務時的效率與穩定性仍具備參考價值。