如果 AI 需要的不是更多記憶體,而是更好的數學運算呢?

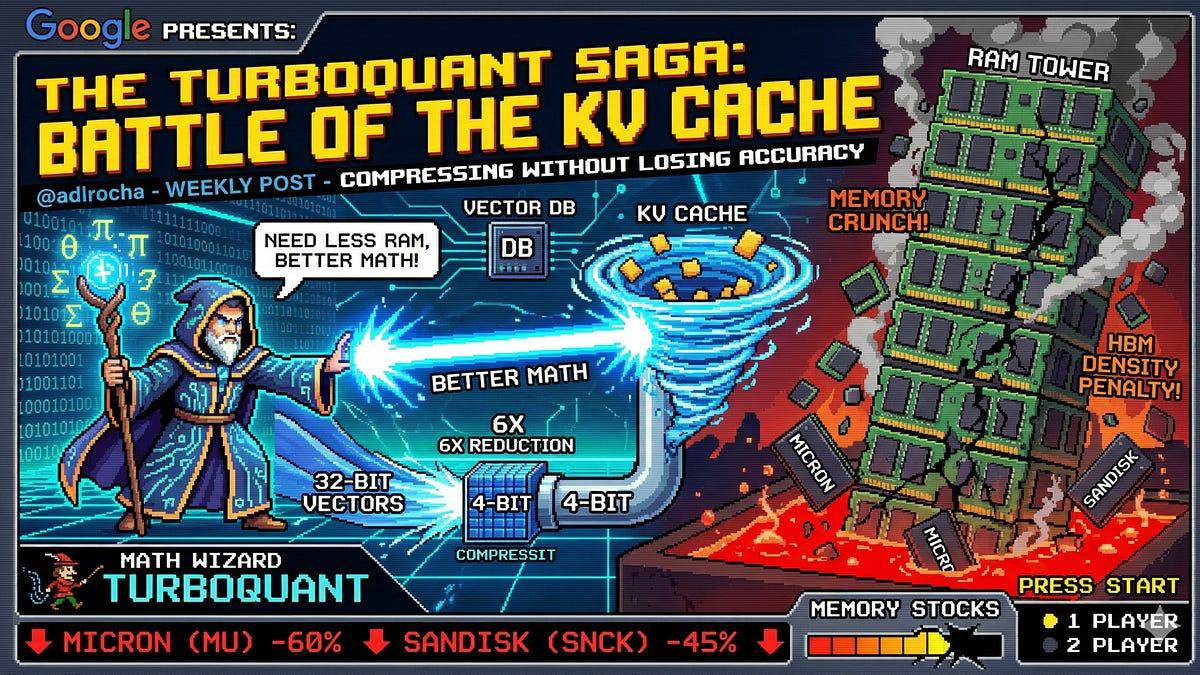

Google 新推出的 TurboQuant 演算法在不損失準確度的情況下,將 KV 快取記憶體需求降低了 6 倍,這可能大幅緩解全球硬體記憶體短缺的壓力。

背景

隨著大型語言模型(LLM)的規模與上下文長度不斷擴張,GPU 記憶體(VRAM)已成為推論效能的主要瓶頸。Google 最近發表的 TurboQuant 技術,試圖透過將向量座標從笛卡兒座標系轉換為極座標系(PolarQuant),在不損失精度的情況下大幅壓縮 KV 快取(KV Cache),挑戰了「AI 發展必須依賴更多硬體記憶體」的傳統思維。

社群觀點

針對 AI 是否能透過「更好的數學」來解決記憶體困境,Hacker News 的討論呈現出樂觀技術派與現實經濟派的拉鋸。部分評論者認為,極致的量化技術與演算法優化是目前最核心的進步方向,這不僅關乎記憶體容量,更涉及資料傳輸頻寬與計算效率的權衡。例如 KANs 等架構嘗試以更多計算換取更少參數,體現了在不同硬體資源間尋找新平衡點的趨勢。若模型效率能有數量級的提升,AI 運算可能會從目前的「大型主機時代」轉向「個人化時代」,讓高效能模型得以在本地端設備運行,而非受限於雲端服務。

然而,許多參與者對「需求減少」的說法持懷疑態度,並引用「傑文斯悖論」(Jevons Paradox)與「誘導需求」理論指出,當技術效率提升導致成本下降時,資源的使用量反而會因為需求激增而大幅增加。換言之,即便數學演算法讓單一模型所需的記憶體減少,AI 公司也會傾向利用省下的空間來運行更多實例、處理更長的上下文,或是開發規模更龐大的模型。記憶體需求並不會因此消失,而是會被更複雜的應用迅速填滿。

此外,討論中也觸及了硬體供應鏈與經濟結構的深層問題。有觀點認為,雲端服務商與硬體巨頭有動機維持硬體的高昂門檻,以鞏固其競爭優勢。儘管有人諷刺「記憶體比數學家便宜」,但考量到目前資料中心動輒數十億美元的資本支出,投入研發經費來優化演算法顯然具有極高的經濟回報。最後,部分留言者提醒,雖然演算法突破至關重要,但根據「慘痛的教訓」(The Bitter Lesson),歷史經驗顯示利用大規模運算的通用方法往往比依賴人類經驗的精巧設計更具長期優勢,這意味著硬體擴張與數學優化將會是並行且長期競爭的兩條路線。

延伸閱讀

- LLM Architecture Gallery: 由 Sebastian Raschka 整理,涵蓋從 GPT-2 到 DeepSeek 等多種模型架構的演進。

- The Bitter Lesson: Rich Sutton 的經典文章,探討為何利用大規模運算的方法最終總能勝過依賴人類知識的演算法。

- Jevons Paradox: 維基百科關於「傑文斯悖論」的解釋,說明資源利用效率提高如何反而導致總消耗增加。

- HuggingFace Quantization Overview: 關於模型量化技術的綜合指南與方法列表。