Bluesky 2026 年 4 月停機事故檢討報告

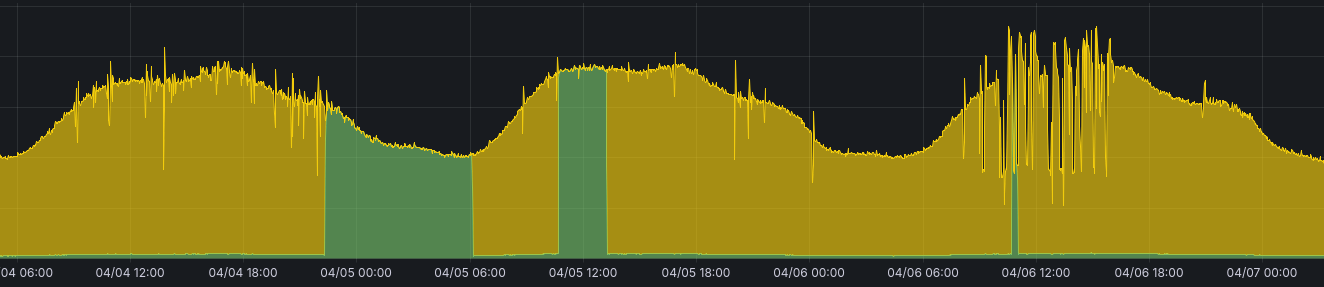

這是一份關於本週一導致半數用戶斷續停機 8 小時的技術分析,主因是特定 RPC 調用缺少併發限制,進而引發連接埠耗盡與日誌堆積造成的系統死亡螺旋。

背景

這篇技術檢討報告由 Bluesky 的系統工程師 Jim 撰寫,詳細記錄了 2026 年 4 月發生的一場嚴重服務中斷事故。該事故導致約半數用戶在長達八小時內面臨間歇性的連線問題,最終追溯到內部新服務發送了異常龐大的批次請求,進而引發 TCP 連接埠耗盡與 Go 語言運行時的「死亡螺旋」連鎖反應。

社群觀點

在 Hacker News 的討論中,社群成員對於這次事故的技術細節表現出高度共鳴,特別是針對批次處理規模失控所引發的災難。多位評論者指出,開發者在設計系統時往往容易忽略「數量級」帶來的質變。一位網友精闢地總結了軟體開發中三個關鍵的數字:零、一、以及無限大。這反映出當系統從處理數十個請求跳躍到數萬個請求時,原本運作良好的邏輯會瞬間崩潰。針對 Bluesky 提到的 GetPostRecord 請求從原本預期的 50 個 lookup 暴增至 2 萬個,社群普遍認為這正是導致後續連鎖反應的元兇。

關於技術底層的連鎖反應,社群也對「日誌記錄引發死亡螺旋」的現象展開討論。由於 Bluesky 在 memcached 報錯時會觸發大量日誌寫入,而 Go 語言的日誌寫入屬於阻塞式系統調用,這導致運行時為了應對阻塞而產生大量作業系統線程,進而壓垮垃圾回收機制。有評論者認為這種情況在分散式系統中其實相當常見,當基礎設施如數據平面開始耗盡連接埠時,任何細微的監控或日誌行為都可能成為壓垮駱駝的最後一根稻草。

此外,討論中也出現了對文章呈現方式的零星批評。有用戶提到該部落格採用深藍色背景搭配淺藍色文字的設計極不利於閱讀,甚至開玩笑說這是他見過最奇特的配色方案。儘管如此,社群對於 Bluesky 願意公開分享如此詳盡的技術檢討報告仍持正面態度,認為這種透明度對於同業學習如何避免類似的併發控制漏洞具有極高價值。整體而言,社群共識在於:即便擁有完善的監控,若缺乏對邊界案例與客戶端行為的細粒度觀察,系統仍難逃大規模崩潰的風險。