101 位紐約人對人工智慧風險的看法

我針對 101 位民眾進行了首次面對面的入戶調查,探討他們對人工智慧風險的真實看法。結果顯示,絕大多數受訪者對超人類 AI 感到擔憂,並強烈支持放慢開發速度及實施國際監管條約。

從未有人針對 AI 風險進行過面對面的入戶調查^([1])。人們對 AI 的真實看法究竟是什麼?我是說,真正的想法。雖然已經有一些關於 AI 風險的調查,但看著紙上的數字,與和同胞親身交談的感覺是有實質差異的。

我^([2])詢問了 101 個人對 AI 影響的看法。大約一半的回答來自按門鈴拜訪,另一半則是在戶外隨機詢問路人^([3])。每一次調查都是面對面進行的。大約有 10 名受訪者只說西班牙語,因此是以西班牙語進行調查^([4])。

在顯示對監管 AI 的興趣方面,高層級的結果非常強烈。其餘內容將是對結果/過程的反思,以及我在這個過程中所收集到的所有定性數據。

對某些特定問題的想法

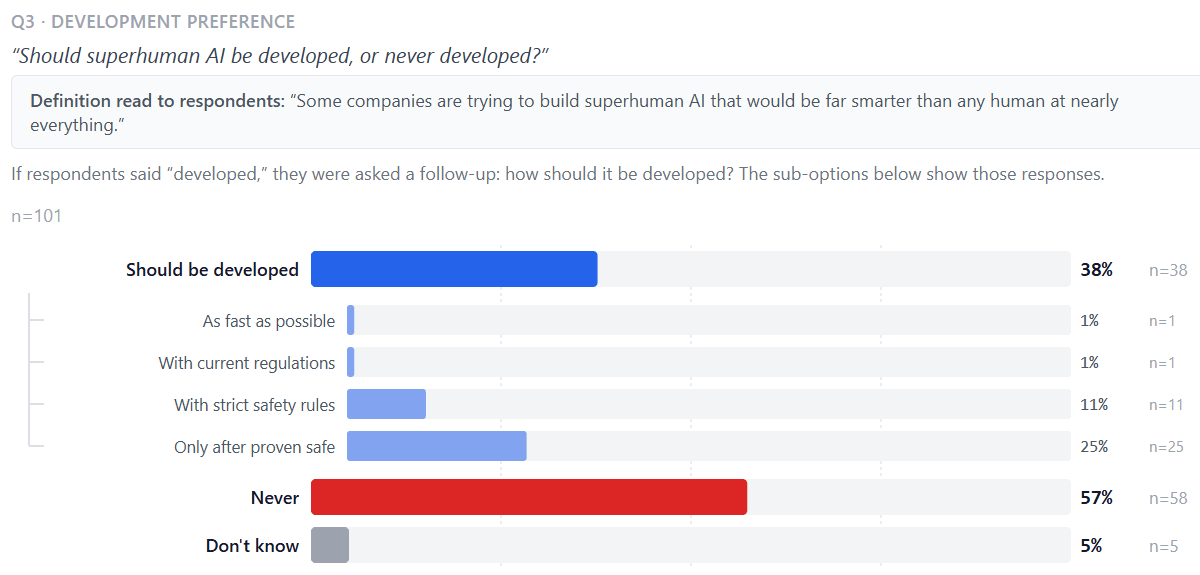

這個問題是所有問題中最長且最複雜的。因為它不是一個簡單的量表,我基本上必須讀出所有的選項。我決定先將其拆分為:某人是否認為「根本不應該」開發超人類 AI,如果他們認為「應該」開發,才提供更細緻的選項。這種方法論上的差異可能解釋了我的結果與 FLI(生命未來研究所)結果之間的差異,但這似乎不太可能,因為即便如此,絕大多數認為應該開發的受訪者仍然認為應該在嚴格監管下開發。最初「應該或不應該開發」的框架設定,有可能使「應該開發」子集的回答產生偏差。不過總體而言,這些結果非常強烈。在 96 位表達觀點的人中,只有 2 人認為應該在現有監管下或盡可能快地開發。

這個問題很糟糕,原因有幾個。首先,人們經常感到困惑,「限制開發更強大的 AI」這個子句簡直是災難。這經常被誤解,我的模型基本上是:人們只記得最近聽到的內容,所以他們只記住了「更強大的 AI」而忽略了「限制」的部分。人們會說「對,我超級擔心 AI,我討厭它,我從不使用它」,然後回答「可能性小得多」。我最終重複了兩次「限制開發更強大的 AI」以試圖提供幫助,但我認為這是一個很好的教訓:你希望問題結構越簡單越好。閱讀理解能力的差異巨大,限制其作為干擾因素非常重要。同樣地,我一開始使用「控制開發更強大的 AI」,結果至少有 1 個人將其理解為政治家獲得對 AI 本身的控制權。我試圖在措辭上非常小心,這也是為什麼我在問題 3 中對超人類 AI 做了我能想到最簡單的解釋,但即便如此,這裡的啟示是:在設計調查時,基本上不希望有任何會改變意義的詞彙,特別是當它們位於句子較後方時。這個問題也很有趣,因為它也受到了普遍的反政治家情緒的干擾。有些人基於完全無法信任政治家的立場而回答「可能性較小」。我想如果再做一次,我會簡化並詢問他們是否會支持一項法律,而不是支持一位政治家^([5])。目前關於 AI 風險對選舉可行性之顯著性的調查發表極少,所以我仍然很高興包含了這個問題。

心得總結

很少有人對 AI 感到興奮。幾乎每個人都擔心超人類^([6]) AI 會變得過於強大而使人類無法控制。絕大多數人支持放慢開發速度、簽署限制 AI 的國際條約,並且普遍感到擔憂。人們普遍對 AI 感到憂慮,甚至一些表示對 AI 感到興奮多於擔憂的人,也經常表達擔憂,特別是在涉及超人類 AI 的問題背景下。我基於直覺的解讀是:許多感到興奮的人是因為他們不認為超人類 AI 真的可能實現,但當給予關於超人類 AI 的假設情境時,他們仍然感到擔心或不希望它被開發^([7])。

在種族/收入/教育/政治等維度上,我做得相當不錯,獲得了一個相對具有美國代表性的樣本,但僅在紐約/新澤西州獲取回應肯定存在偏差。話雖如此,這些回應通常非常明確地表明,對於民主黨和共和黨候選人來說,嘗試進一步監管 AI 風險既是顯著的議題,在政治上也是有利的(至少在選舉可行性方面)。

調查本身具有偏見

我以前從未進行過挨家挨戶的遊說(canvassed),偏見潛入的方式之多令人驚訝。

- 會回應家門口調查員的人的類型。

- 按某人的門鈴是受保護的,但進入公寓大樓敲門是否受法律保護則不那麼明確。我沒有對公寓大樓進行任何遊說。我對此基本接受,因為美國整體而言遠不如紐約市密集,所以去人口密度較低的社區可能更具代表性。

- 一天中的時間。我曾嘗試在下午 4 點前去,結果基本上只能遇到超過工作年齡的人。在工作日遊說時,我大部分時間堅持在下午 3:30 到 7:00 之間,以試圖接觸到工作年齡和非工作年齡的人群。一天中最好的時間是下午 5 點之後,因為那樣你可以開始根據哪些房子明顯亮著燈來選擇房屋^([8])。

- 我提供選項的方式。我發現當我提出問題然後列出答案時,經常會讓受訪者感到困惑^([9]),所以對於大多數問題,最好的流程是提出問題,等待看他們說什麼,然後提供 2 到 3 個最接近的選項讓他們從中選擇。這有助於消除答案順序的偏見,但這確實意味著,在我根據對他們回答的理解而選擇提供哪些選項時,存在主觀偏見。

- 有時人們顯然不理解問題。當我反思我選擇的問題時會深入探討這一點,但這增加了偏見:如果有人說「我討厭 AI」,然後以不一致的方式回答問題,我必須選擇是否要問「你確定嗎?讓我幫你理解這個問題」。因此,如果我對某些困惑更敏感,或更有可能針對某些答案進行澄清,這就增加了另一個偏見來源。

- 我說出問題的方式。我是否強調了某個答案?有些人就是不回答問題。他們只是漫談並扯到題外話,當我給他們選項時,他們根本不選。我是用我的判斷力挑選最接近的選項,還是說「不知道」?我通常選擇我認為最能代表他們所說內容的選項,但這是我做出的判斷。

- 一些受訪者以前從未聽說過 AI,所以我描述它的方式^([10])影響了他們的回答。

- 我的偏見會流露出來嗎?我通常很小心地以「我有一份關於 AI 對我們所有人影響的調查」開場,而不是像「關於 AI 風險」之類的說法。如果受訪者認為我傾向於得到某種類型的答案,這既會改變他們決定接受調查的機會,也可能在他們試圖取悅我時改變他們的答案。然而,有些人在跟我交談前想要大量關於我是誰/為什麼做這件事的信息。我的回答大致是:「我是一名獨立研究員,正在調查 AI。我認為 AI 非常重要,了解人們的看法也很重要。以前從未有人做過關於 AI 的面對面入戶調查。我希望能發表這個結果。」即便只是問題的措辭方式和提出的問題類型,也會洩露關於我偏見的信息,這很難完全排除。

- 我該如何處理各種澄清問題?如果有人在問題回答到一半時停止回答,並開始試圖弄清楚我的想法,我該怎麼辦?歸根結底,這是面對面的,他們可以決定做任何他們想做的事。這也意味著我留下來的意願會對數據產生影響。如果我放棄那些行為古怪或難以解讀的人,那麼我就會對這類人群採樣不足。

人們既古怪又令人驚訝

面對面交談的美妙之處在於,每個回答都伴隨著大量的定性數據。以下是一些發生的趣事:

- 有人在談到失去對超人類 AI 控制的可能性時,說了類似這樣的話:「我信仰上帝。如果這是上帝的旨意,那麼 AI 就應該擁有更多控制權。」

- 我遇到有人堅決反對「問題是可以回答的」這個概念。「我認為是否應該開發 AI 有什麼關係?這就像問我是否希望草是粉紅色的一樣。AI 已經存在了,就像加密貨幣一樣,它只會繼續存在。」「如果 99% 的人都希望不再有 AI,那也不會有任何區別,因為它總會被流氓行為者開發出來^([11])。」這個人是其他幾個因為某種原因根本不能或不願回答假設性問題的人的極端版本。這是一個極難調查的人,我大多只能在相關回答中填寫「不知道」。

- 有幾個人擔心 AI,但仍然反對條約或試圖限制 AI 的政治家。普遍的情緒基本上是:你不能信任其他國家,你也不能信任政治家。這對我來說總是很有趣,因為這似乎暗示他們只是反對任何立法或條約,無論內容是什麼。

- 幾個人明確談到他們如何為自己或孩子的生命感到擔憂。

- 我遇到一個人,她知道 Google 的頂層結果使用了 AI,並提到了 ChatGPT,但在第 3 或第 4 個問題時完全陷入了玄學。她談到她不擔心 AI,我也不應該擔心,只要我相信第 12 維度及以上。顯然人類是 12 維以上的生物,將要發生的一切都已經在第 12 維以上發生過了,所以 AI 已經存在了幾千年,並將繼續存在幾千年。有些人的信仰就是這麼狂野^([12])。

- 我按下的其中一個門鈴剛好是一位技術長(CTO),那很有趣。他普遍感到擔憂,支持監管、支持條約等。看起來大約是:使用 AI 最多、知識最豐富的人更感到擔憂。

你也可以這樣做!

我將調查應用程式構建為一個 PWA(漸進式網頁應用程式),可以在任何地方離線工作。如果你關心 AI 並喜歡在戶外散步,我強烈建議你自己嘗試一下。按門鈴可能會讓人沮喪,所以我建議第一次不要嘗試那個,但如果你在天氣晴朗的日子去公園^([13]),那會非常輕鬆!直接走上前去詢問任何看起來可能願意聊天的人,最壞的情況就是他們說不!如果你想讓它更有趣,就和^([14])朋友^([15])一起做,現在你正和喜歡的人一起在風和日麗的日子裡逛公園,偶爾還能聽到陌生人對 AI 的狂野見解!

我可以很容易地將你添加為調查員,你只需要:

-

私訊我你想要的用戶名和(可選的)密碼^([16])。

-

一旦我通知你設置完成,你就可以使用你的憑據在 https://peopleonai.com/survey 登錄。

-

閱讀入門指南^([17])並(可選地)將頁面添加到你的主屏幕。

-

去調查一些人吧!

-

^(^)至少就 Claude 所知是這樣。

-

^(^)與我的兩個朋友一起。

-

^(^)主要在公園,但也在街上。

-

^(^)據我所知,這也是第一份以美國為基地的西班牙語調查結果。

-

^(^)雖然我不確定,因為詢問選民偏好的部分希望是:如果政治家知道處理某個議題有助於當選,而不是僅僅知道人們普遍支持這類法律,這對他們來說更有說服力。

-

^(^)定義為:「一些公司正試圖構建超人類 AI,它在幾乎所有事情上都比任何人類聰明得多。」

-

^(^)有幾個人沒有回答是否應該開發超人類 AI 的問題,因為他們認為這不可能實現,並拒絕參與該假設。

-

^(^)但這當然會增加一點偏見,在開燈的人(或不完全遮擋窗戶的人等)與不開燈的人之間可能存在某種系統性偏差。

-

^(^)受訪者的教育程度、智力等範圍極廣。

-

^(^)「一個能像人類一樣思考的電腦,比如 ChatGPT、自動駕駛汽車、Siri 或 Alexa。」自動駕駛汽車通常是最有幫助/最易理解的例子。令人恐懼的是,有些人從未聽說過 AI,但他們肯定仍在社交媒體等平台上看到 AI 生成的內容。

-

^(^)當我談到如果禁止 AI,它的開發速度會慢得多,因為它需要大量資金和開發人員等,他的反應是「那無關緊要」。

-

^(^)而且這通常伴隨著從不實際回答問題,或者因為我要求他們具體選擇一個選項而對我生氣。在這種情況下,我真的必須運用我的最佳判斷力來弄清楚哪個答案最能代表他們口中說出的那些狂野言論。

-

^(^)最好是在週末,但即使在工作日,如果天氣好,周圍也會有很多人。

-

^(^)朋友 1 的想法:「今天在日落公園(Sunset Park)周圍遊說很有趣。我以前曾為政治候選人遊說過,那感覺比這要標準化得多。今天我們在公園詢問人們關於 AI 的看法時,他們一致對這些問題感到驚訝和好奇。人們有很多意見,似乎有些人會抓住機會讓自己的聲音被聽到。我對我們得到的一些回應特別感興趣。我知道我生活在一個受過高等教育且具備技術素養的人群圈子裡,但與那些從未使用過 AI,甚至從未聽說過『人工』智能意味著什麼的人交談,仍然令人驚訝。這也是一個強迫我在一個 90% 的人似乎不說英語的社區練習西班牙語的絕佳機會。」

-

^(^)朋友 2 的想法:「對某些問題的回應,我預期會導致對其他問題的特定回應,但有時我對人們答案邏輯中感知到的缺乏凝聚力感到驚訝。和你一起走來走去,待在一個我從未去過的社區很有趣。」

-

^(^)如果你不提供,我會為你自動生成一個密碼。

-

^(^)在應用程式內部,非常簡單。