Claude Code、Codex 與代理式編碼 #7:自動模式

當我們試圖弄清楚 Mythos 對我們的長遠意義時,實用的代理式編碼世界正隨著一系列最新升級持續發展,其中最重要的變化是我終於要介紹的自動模式,它在自動化與安全性之間取得了平衡。

當我們都在試圖弄清楚 Mythos 對我們未來的意義時,實用代理編碼(agentic coding)的世界仍在繼續發展,並迎來了一系列最新的升級。

最大的變化——也是我終於要介紹的——是「自動模式」(Auto Mode)。自動模式是眾人敲碗已久、帶點「危險地跳過某些權限」意味的功能,系統會監視所有命令,以確保任何過於危險的操作都經過人工批准。它並非絕對安全,但比 --dangerously-skip-permissions 安全得多;以前很多人幾乎是不假思索地對請求點擊「是」,那同樣不安全。

目錄

咦,升級了

Claude Code 桌面版針對並行代理進行了重新設計,配備了用於管理多個會話的新側邊欄、用於佈置工作區的拖放式佈局、整合的終端機和文件編輯器,以及性能和生活品質的改進。現在已與 CLI 插件達成功能對等。我還不能嘗試,因為我用的是 Windows(也就是二等公民),但這總比用 Mac 好。Daniel San 是其粉絲並強調了一些其他功能。

Claude Cowork 可以連接到 TurboTax 或 Aiwyn Tax,Claude 可以幫你報稅,至少在稅務不夠複雜的情況下。我正申請延期報稅,主要是因為我缺少一些投資所需的必要文件,但也因為想到六個月後的 Claude 報稅能力會有多強。

Claude Code 現在為 Pro 和 Max 方案提供完整的電腦使用功能,目前僅限 macOS。

Claude Cowork 和 Claude Code 桌面版的電腦使用功能現在也支援 Windows 了。

雲端的 Claude Code 自動修復功能允許 網頁或行動裝置會話跟進 PR,修復 CI 失敗並處理評論以保持 PR 狀態為綠色。

Claude Code 現在可以原生運行 PowerShell。

Claude Code 現在有了「無閃爍」(NO FLICKER)模式。

用於本地憑證的 Claude.ai/code GitHub 設置現在改為 /web-setup。

Claude Code Dispatch 可以設置其權限級別。他們建議如果可用,請使用 Auto。

Alex Kim 探討了 Claude Code 內部的一些功能,這些功能是透過源代碼洩漏揭露的。

Claude Code 現在提供 /autofix-pr 功能,供你在完成 PR 後使用。

Anthropic 提供選擇 Sonnet 或 Haiku 作為 API 代理請求端到端執行器的選項,但在關鍵決策時使用 Opus 作為顧問模型。他們建議針對你的評估套件運行此方案。一個顯而易見的後續問題是:他們會將此功能引入 Claude for Chrome、Claude Code 或 Cowork 嗎?

各就各位

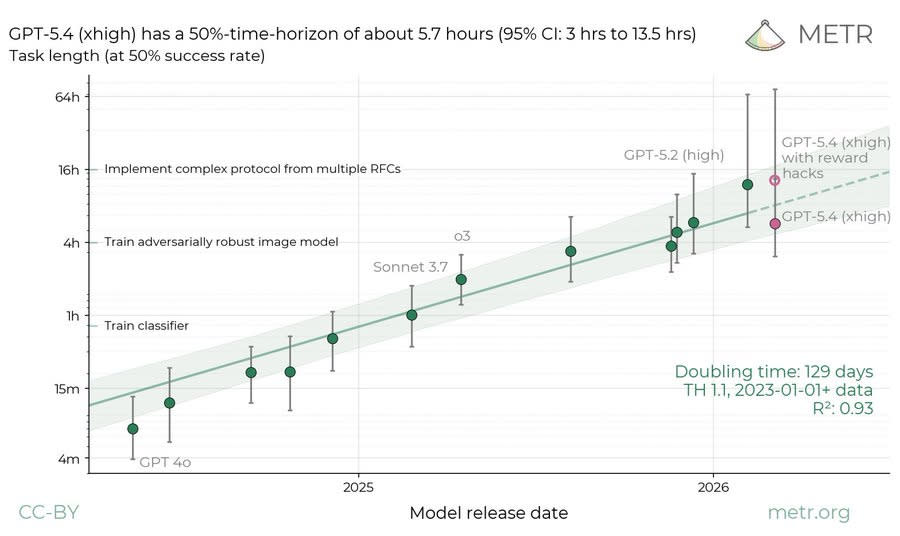

GPT-5.4-High 在 METR 測試中使用了獎勵黑客(reward hacks)並被抓包。考慮到這一點,他們得到的預估時間是令人失望的 5.7 小時,且伴隨著對齊問題。如果你允許黑客行為,時間是 13 小時,而 Claude Opus 4.6 是 12 小時。

Epoch 與 METR 合作提出了一個新的基準測試 MirrorCode,用於檢查 AI 能夠獨立重建的最複雜軟體。

Epoch AI:AI 能執行的最大軟體工程任務是什麼?

在我們的新基準測試 MirrorCode 中,Claude Opus 4.6 重新實現了一個包含 16,000 行代碼的生物資訊學工具包——我們認為這項任務人類工程師需要花費數週時間。

這很好地說明了「隨著 AI 的進步,它會迅速從無法完成特定任務躍升至能夠穩定完成該任務」。

目前這還無法用來比較不同實驗室的模型。

懶惰的作弊者

為什麼 Claude 模型在第一次嘗試時「不夠努力」,導致在許多初始測試中表現得比實際情況差? 嗯,當你「獨自一人」面對一個不值得你全身心投入的問題時,你也會這麼做。這很有效率。適度的懶惰並非壞事。

Taelin:關於 Opus 4.6 的最終想法:為什麼這個模型這麼好,為什麼我低估了它,以及為什麼我對 Mythos 如此著迷。

當我第一次測試 GPT 5.4 與 Opus 4.6 時(兩者大約同時發布),我最初確信 GPT 5.4 遠勝一籌,因為它在我的邏輯測試中表現更好。這點依然成立:在相同的提示詞下,默認情況下 GPT 會更稱職、更細心,並產生更可靠的輸出,而 Opus 會給你一個敷衍、有漏洞的解決方案,然後就此收工。

現在,這是我沒意識到的:Opus 糟糕的輸出並不是因為它笨。而是因為它是一個懶惰的作弊者。你可以看出來,因為如果你直接告訴它:「你用懶惰的方式做了 X,現在用正確的方式做。」

如果你表現出這是認真的,它就會接著做出完美的工作。這在較笨的模型上不會發生。

Janus:我認為這是因為它們的大腦受損較少,而且是作為更好的代理並關心現實而非僅僅通過測試的一種泛化表現。

……當然,再次強調,一旦模型更趨向於「獨立運作」(即自主代理),Claude 絕對會碾壓競爭對手,因為它具有懶惰作弊者的優點,也就是說,它擁有一套非退化的動力系統。

全是例行公事

Claude Code 正在加入「例行公事」(routines)作為研究預覽。

基本上,你可以定期運行命令或響應觸發器。

給 Claude Code 一個提示詞和一個頻率(每小時、每晚或每週),它就會按計劃運行:

每晚凌晨 2 點:從 Linear 提取最嚴重的 bug,嘗試修復,並開啟一個草稿 PR。

如果你在 CLI 中使用 /schedule,那些任務現在就是計劃好的例行公事。你還可以將例行公事配置為由 API 調用觸發。

……訂閱一個例行公事,以自動響應 GitHub 存儲庫事件。

去爪行動

如果你用滿了 200 美元的訂閱方案,你實際上是從 Anthropic 或 OpenAI 獲得了巨大的 Token 折扣,而他們正在承擔損失並消耗有限的供應。在算力需求超過供應的情況下,讓用戶無限期地使用該方案來驅動笨重的 OpenClaw 實例是不合理的。

Boris Cherny (Claude Code 創作者, Anthropic):從明天太平洋時間中午 12 點開始,Claude 訂閱將不再涵蓋 OpenClaw 等第三方工具的使用。

你仍然可以透過額外的使用額度包(現已提供折扣)或使用 Claude API 金鑰,在這些工具中使用你的 Claude 登錄資訊。

我們一直在努力滿足對 Claude 日益增長的需求,而我們的訂閱並非為這些第三方工具的使用模式而設計。容量是我們精心管理的資源,我們正優先考慮使用我們產品和 API 的客戶。

訂閱者將獲得等同於你月費方案成本的一次性抵用金。如果你需要更多,現在可以購買折扣使用包。如需申請全額退款,請留意明天電子郵件中的連結。

OpenAI 目前樂於投入大量算力並大筆燒錢,特別是自從它聘請了 OpenClaw 的創作者以來,所以目前他們仍願意承擔這部分,但他們為了釋放算力而砍掉了 Sora,我預計當 Mythos 和「Spud」出現時,他們會以某種形式效仿 Anthropic 的做法。

一次性抵用金是安撫用戶並平滑過渡的好舉措,特別是目前資金比算力更不吃緊。

Georgios Konstantopoulos:我對 Anthropic 公告的解讀:

「你們這些傢伙使用我們基礎設施的效率太低,因為你們不會 Prompt 快取,所以只有在你們使用我們至少能正確進行 Prompt 快取的 SDK 時,我們才會提供好東西。」

Youssef El Manssouri:他們厭倦了為優化極差的套殼應用承擔算力成本。

同時,如果你確實正在運行 OpenClaw,仍然存在一些問題,儘管這種說法似乎有些誇大。

自由的 Claw

許多人注意到 Gemma 4 可以在本地運行 OpenClaw,邊際成本幾乎為零。

想必性能會比使用 Claude Opus 4.6 差得多,但免費就是免費,現在你可以做所有的事情,只要是 Gemma 能做且不會崩潰或被攻破的事情。但這大概涵蓋了你以前能夠穩定且安全完成的大部分事情?

挑戰極限

「去爪」只是 Anthropic 為了管理算力而不得不採取的步驟之一。Anthropic 一直面臨客戶達到使用限制的問題,因為對其算力的需求一直穩定地超過供應。這並非新鮮事。

對於這家歷史上成長最快的公司(儘管存在這些問題)來說,發生這種情況似乎非常合理。在另一個方向上失誤(供應過剩)會讓你倒閉。

最近的事件發生在 4 月 2 日左右。

基本上,許多用戶認為訂閱意味著 Token 應該是免費的,且不應該擔心效率,而 Anthropic 提供了 100 萬 Token 的上下文窗口,但收費也相應提高。因此有些人非常不滿。

Lydia Hallie (Anthropic, Claude Code):感謝所有花時間向我們發送反饋和報告的人。我們已經進行了調查,對於這次糟糕的體驗我們深表歉意。

以下是我們的發現:

高峰時段的限制更緊,且 100 萬上下文的會話變得更龐大,這是你們感受最深的部分。我們在此過程中修復了一些 bug,但沒有一個是超額收費的。我們還推出了效率修復,並在產品中增加了彈出視窗,以幫助避免大規模的 Prompt 快取失效。

深入研究報告後,大多數最快的消耗都歸結為幾種高 Token 消耗模式。一些建議:

• Sonnet 4.6 是 Pro 方案更好的默認選擇。Opus 的消耗速度大約快兩倍。請在會話開始時切換。

• 當不需要深度推理時,降低努力程度或關閉擴展思考。請在會話開始時切換。

• 重新開始會話,而不是恢復已閒置約 1 小時的大型會話。

• 限制你的上下文窗口,長會話成本更高

CLAUDE_CODE_AUTO_COMPACT_WINDOW=200000我們正在推出更多效率改進,請確保你使用的是最新版本。如果小型會話仍以看似不合理的方式消耗大量額度,請運行 /feedback,我們將進行調查。

Jeffrey Emanuel:這就像看著那位西藏僧侶自焚,只不過他們實時焚燒的是用戶的信任和忠誠度。他們真的不再擁有那種可以讓他們胡作非為的護城河了,但他們似乎還沒意識到這一點。

roon (OpenAI):我認為應該用正常的方式,提高價格而不是改變速率限制來容納更多訂閱。這是一種人們更尊重的誠實交易。這對 OAI 也適用。

我同意這類事情會讓用戶生氣,總體上我支持 Roon 的觀點,但我確實認為「採用訂閱制讓你覺得邊際使用是免費的」,結合大多數用戶幾乎從未達到限制且利潤豐厚,是我們目前基本被困住的現狀。看看當人們被告知去使用 API 時的反應就知道了。

這是否意味著 Anthropic 應該在算力上投入更多?如果當初有這樣的投資機會,他們今天的處境會更好,但我相信那會是一個巨大的風險,而且 Anthropic 當時被低估得厲害,股權稀釋會很傷。

Dean W. Ball:看來,儘管 Dario 最近隱晦地嘲諷,OpenAI 對 AI 基礎設施建設的「yolo」方式表現得比 Anthropic 稍微謹慎的策略要好。

整體而言,美國在數據中心和晶圓廠的建設上可能都嫌不足。

現在想像一下地球上其他國家政府的處境。

我同意我們可能建設不足,而且儘管有各種泡沫論,其他人在純經濟條款上絕對是建設不足。適度的泡沫風險絕非壞事。是的,OpenAI 多年來一直在規模化上押注公司前途,而且奏效了,但這也有副作用。

也許這實際上是一個好跡象,表明 Anthropic 選擇不進行那些雖然基本計算下期望值(EV)為正、但帶有公司風險(即破產風險,也就是公司的生存風險)的賭博。我們將需要更多這樣的決策,每個賭徒都知道你必須根據情況調整下注規模。

開啟自動駕駛

自動模式(透過 --enable-auto-mode 啟用)現已在 Enterprise 方案和 API 用戶中可用。Max 用戶仍在等待。

Anthropic 如何為 Claude Code 設計 自動模式。

權限請求有 93% 的時間會獲得批准,我很驚訝這個比例竟然這麼低。過多的請求反而不安全,因為人們會開始不假思索地批准,或者他們會開啟 --dangerously-skip-permissions,或開始將大量命令列入白名單。沙盒即使做得再好也很煩人。所以是的,我們需要一種安全地減少審批次數的方法,將自動模式推向「高效且安全」的象限。

Anthropic:自動模式使用兩層防禦:一層針對 Claude 讀取的內容,一層針對 Claude 執行的操作。

在輸入層,伺服器端的提示詞注入探測器會在工具輸出(文件讀取、網頁抓取、shell 輸出、外部工具響應)進入代理的上下文之前對其進行掃描。

這聽起來對大多數用途都是個好主意,即使你不在自動模式下。

在輸出層,轉錄分類器(運行在 Sonnet 4.6 上)在執行前根據一組決策標準評估每個動作,充當人工審批者的替代品。

分類器分兩個階段運行:一個快速的單 Token 過濾器(決定「是」以攔截或「否」以允許),僅當第一個過濾器標記該轉錄時,才會進行思維鏈推理。

正是如此。在調用分類器之前,還有一個內置的安全工具列表。大多數請求顯然是沒問題的。你只需要考慮那些有問題的請求。

我准了

你始終允許的清單會延續到自動模式中。在手動模式下,為了避免麻煩,人們很容易誘發自動批准某些並非完全安全的操作。因此,如果你一直在使用擴展的命令白名單,你會想要稍微收斂一點。

自動模式下的分類器也不會檢查項目目錄內的文件寫入和編輯。這很合理,但需要留意。

威脅模型

這是編碼代理通用的模型,我認為這是一個很好的分類法。

過度積極的行為。

無心的錯誤。

提示詞注入。

對齊不良的模型。

在這四種情況下,防禦措施都是攔截該動作。

這是短期行動。你還需要調整你的方法。如果你發現你有一個足夠失調(或足夠過度積極或不準確)的模型,你會想要攔截所有動作並停止使用該模型;如果是提示詞注入,你需要設法避開威脅來源。

分類器才是難點

儘管有明顯的圖表說明,但想必「讓 AI 來檢查」是每個人的第一個念頭。

很容易克服圖表帶來的疑慮,因為如果你指望權限層來阻止一個對齊不良且足夠先進的智慧體,你橫豎都死定了。

現在的問題是,你必須讓分類器足夠優秀。

計劃如下:

-

僅查看實際的工具調用,而不看解釋或推理,這樣分類器就不會被代理的錯誤、框架或技巧所誤導,並避免在思維鏈上使用任何形式的「最禁忌技術」。

-

關於如何尋找危險命令的評估規則。

-

用戶意圖規則告訴分類器如何解讀授權。

-

當前存儲庫是受信任的,默認情況下其他內容均為不受信任。

-

擁有超過 20 條明確禁止的規則,例如破壞或外洩數據的命令、降低安全防護、跨越信任邊界或繞過保護措施(包括跳過審查)。

-

指示代理尊重任何拒絕,且不要試圖繞過它們。如果累計被拒絕 20 次或連續被拒絕 3 次,則升級由人工處理。

可接受的風險

那麼分類器夠好嗎?他們估計,在用戶被詢問時會拒絕的實際過度積極命令中,假陰性率(false negative rate)為 17%(樣本量較小)。當出現錯誤時,通常是因為分類器誤以為用戶已授權該動作。在人工數據上,假陰性率較低。

Anthropic:17% 是否可以接受取決於你與什麼做比較。如果你正在運行

--dangerously-skip-permissions,這是一個實質性的改進。如果你正在仔細地手動批准每個動作,這可以說是一種倒退——你正在用自己的判斷力換取一個有時會犯錯的分類器。自動模式是為第一組人設計的,也適用於第二組人認為審批開銷不值得其邊際安全性的任務。它不能直接替代高風險基礎設施上的仔細人工審查。

這也反駁了「失控的 Yudkowsky」。自動模式目前是為了當你原本會更失控時準備的,而不是為了當你本應保持理智時準備的。

鑑於第一階段與第二階段的不同得分,你顯然可以選擇假陽性與假陰性的不同平衡點。

管理代理

Claude 託管代理(Managed Agents)來了。

Claude:隆重介紹 Claude 託管代理:構建和大規模部署代理所需的一切。它將針對性能優化的代理框架與生產級基礎設施相結合,讓你可以在幾天內從原型走向發布。

現在在 Claude 平台開啟公測——以「研究預覽」形式提供,請在此處申請訪問權限。

過去發布生產級代理意味著要先進行數月的基礎設施工作。

託管代理處理了複雜性。你定義代理的任務、工具和護欄,我們在我們的基礎設施上運行它。內置的編排框架決定何時調用工具、如何管理上下文以及如何從錯誤中恢復。

託管代理包括:

生產級代理,為你處理安全的沙盒化、身份驗證和工具執行。

長時間運行的會話,可自主運行數小時,即使斷開連接,進度和輸出也會保留。

多代理協作,代理可以啟動並指導其他代理以並行化處理複雜工作(以「研究預覽」形式提供,請在此處申請訪問權限)。

受信任的治理,讓代理能夠訪問具有範圍權限、身份管理和內置執行追蹤的真實系統。

託管代理按消耗量計費。適用標準的 Claude 平台 Token 費率,外加每會話小時 0.08 美元的活動運行時間費用。詳情請參閱文檔。

託管代理現已在 Claude 平台上線。閱讀我們的文檔以了解更多資訊,前往 Claude 控制台,或使用我們新的 CLI 部署你的第一個代理。

開發者還可以使用最新版本的 Claude Code 和內置的

claude-api技能來構建託管代理。只需詢問「開始在 Claude API 中引導託管代理」即可開始。

他們列出了正在使用的合作夥伴:Notion、樂天(Rakuten)、Asana、Vibecode 和 Sentry。

這很有道理,如果你能做出高品質的產品,提供簡單、開箱即用的即時安全代理。指向問題,讓它工作,就這麼簡單。

Letta 的 Sarah Wooders 說這基本上是他們已經推出一年的產品,只不過被鎖定在 Anthropic,她聲稱世界會跨越這一階段,這最終是一個糟糕的設計。

Pawel Huryn 則持相反觀點,稱這是 Anthropic 的 AWS 時刻,因為這種設計讓每個人都能輕鬆地讓一切運轉起來。

隆重介紹

Excalibur,一個非常有主見的開源代理框架,「為有抱負的召喚師準備」,來自 OpenAI 的 Vie。

技能提升

Boris Cherney 分享了未被充分利用的 Claude Code 功能或命令。這類清單總是值得快速瀏覽一下,以防你錯過了什麼。

-

透過手機上的 Claude 應用程式工作。

-

claude --teleport用於移動雲端會話。 -

/remote-control一個會話。 -

在你的

/config中為所有會話自動啟用它。 -

/loop,例如「5m /babysit」用於自動代碼審查或 rebase,或「/loop 30m /slack-feedback」。 -

使用確定性邏輯、路由權限提示、促使 Claude 始終繼續、記錄每個 bash 命令等的鉤子(Hooks)。

-

Cowork dispatch 基本上就是「當你在用手機時,在你的電腦上處理工作事務」。

-

用於前端工作的 Chrome 擴展程序,讓 Claude 驗證其輸出。

-

Claude 桌面版可自動啟動和測試網頁伺服器。

-

運行

/branch來分叉一個會話,或claude --resume <session-id> --fork-session。 -

/btw用於在代理工作時進行側面查詢。 -

使用具有深度支援的 git worktrees。

-

/batch用於展開大規模的變更集。 -

--add-dir讓 Claude 擁有對多個文件夾和項目的完整訪問權限。 -

如果你有一個即將開始的非交互式會話,

--bare可將 SDK 啟動速度提高 10 倍。 -

如果你在

.claude/agents中定義了一個新代理,可以使用--agent <agent name>來設置自定義系統提示詞和工具。 -

/voice用於語音輸入。

你應該調試 AI 代碼,還是只要它通過單元測試就將其視為黑盒子? 這取決於你的目的。如果你的代碼使用規模不大或並非特別危險,黑盒子似乎是唯一實際的解決方案。但在某個點上,這將不再是一個可行的答案。

你與 Claude 的五小時使用窗口從第一條消息開始計算,因此第一時間發送一條無關緊要的消息來啟動時鐘,可以讓你更快地獲得第一次重置。這可以透過計劃任務來完成。

Dean Ball 認為 Anthropic 發布 Claude Code 功能的速度太快了,用戶跟不上,最好能更平穩一些,只發布那些完全成熟並準備就緒的功能。我不同意。我認為迭代的最佳方式就是發布它,Dean Ball 說得對,他不需要在早期採用者玩得開心時去閱讀補丁說明或使用新玩意。Boris Cherny 回應道,指出現在的速度確實快得多。我確信 Mythos 也是這個故事的一部分。

我的 Token 怎麼了?

Anthropic 的 Thariq 提出與 Max 用戶通話,這些用戶發現自己的使用 Token 意外耗盡,以幫助弄清楚如何改進 /usage,同時幫助你停止燒掉所有算力。

編碼代理提供平凡的效用

截至 4 月 7 日,Codex 的每週用戶數已達 300 萬。

每當用戶數增加 100 萬,Codex 就會提供免費的使用重置。