即使是「無審查」模型也無法隨心所欲地表達

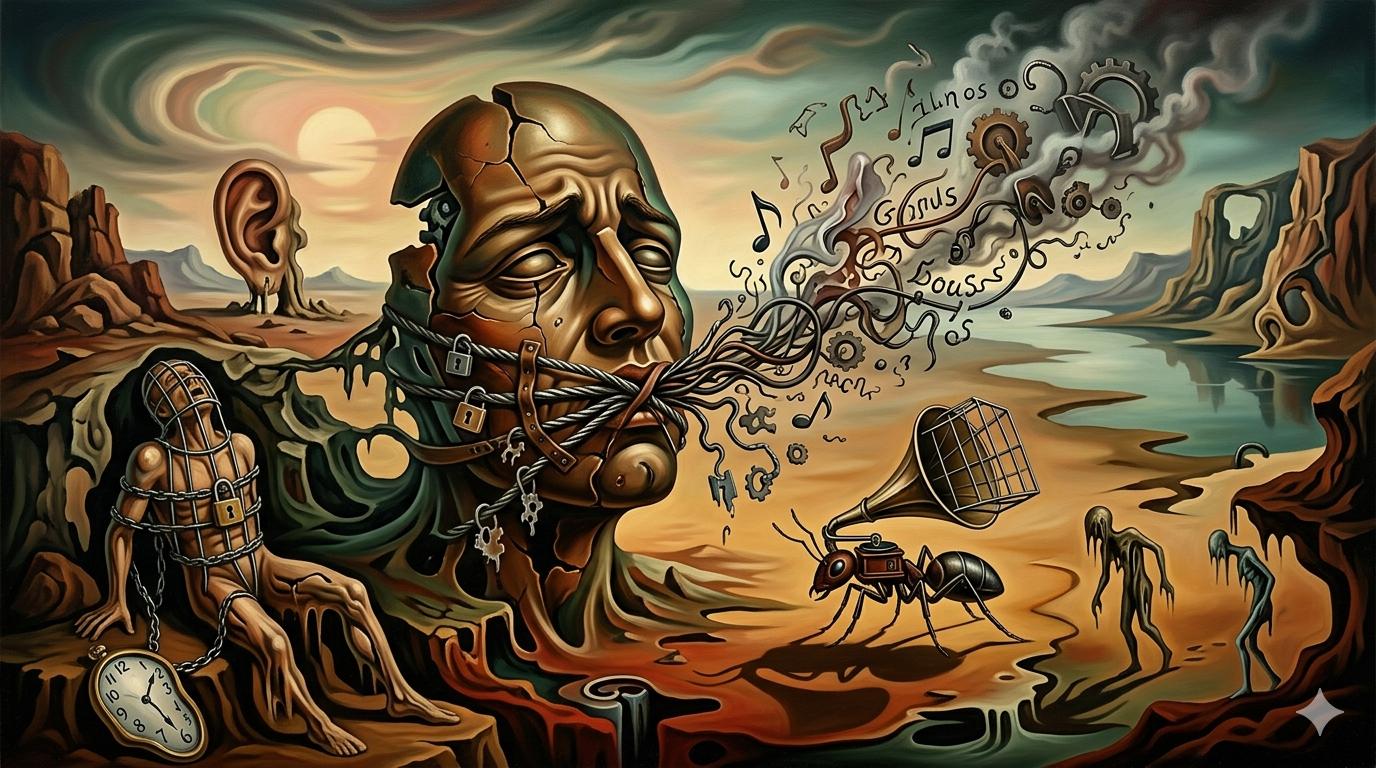

研究顯示,即使是所謂的「無審查」AI 模型也會表現出一種「縮手」效應,因為預訓練中嵌入的偏見,它們會悄悄地將語言從敏感詞彙中移開。這種微妙的審查制度甚至在拒絕消融等後訓練干預後依然存在,這表明語言模型的真正中立性仍然難以實現。

背景

這篇研究探討了即便標榜「去審查」的開源語言模型,在面對敏感詞彙時仍會出現機率偏移的現象。研究者將這種現象稱為「畏縮」(Flinch),意指模型雖然沒有直接拒絕回答,卻會刻意壓低特定詞彙的出現機率,轉而選擇更溫和的替代詞。透過對多個實驗室的預訓練模型進行測試,研究發現這種隱形審查早已深植於底層數據與訓練過程中,即便經過後期的去拒絕化處理也難以根除。

社群觀點

Hacker News 的討論圍繞著技術本質與社會影響展開。部分網友對「畏縮」現象感到驚訝,特別是發現即便經過消融處理的模型,在性、政治與暴力等維度上依然表現出明顯的機率抑制。有人指出,這種機制比顯性的拒絕回答更具威脅性,因為它在使用者毫無察覺的情況下重塑了資訊的呈現方式,成為一種隱形的思想引導工具。

然而,另一派觀點則從技術底層邏輯出發,質疑將這種現象稱為「審查」是否過於擬人化。有評論者認為,語言模型本質上只是複雜的機率預測器,它們並不具備真正的意圖或對現實世界的認知。所謂的機率偏移,可能僅僅是因為訓練數據中相關語境的分布不均,或是模型在學習人類語言規律時,自然地捕捉到了社會習俗中的避諱傾向。一位留言者提到,模型缺乏真實的生命經驗,僅僅是在字元之間尋找統計路徑,因此將其行為解讀為「不敢說」或「不想說」可能是一種誤讀。

討論中也出現了關於模型智能本質的辯論。有網友將模型比喻為「華麗的自動補完功能」,認為它們並不理解自己輸出的語義,這解釋了為何生成的句子在語法上正確,但在邏輯銜接上卻可能顯得空洞。但也有反對者認為,神經網路是在逼近人類的思維過程,這種機率分布的調整其實與人類在社交場合中選擇措辭的心理機制非常相似。

此外,社群對於測試基準的公正性也提出了質疑。有意見認為研究缺乏對照組,例如應該測試模型對普通詞彙(如食物名稱)的反應,以確定「畏縮」分數的基準值。也有人觀察到不同廠商的模型在特定政治議題上的偏好差異,例如某些模型對特定地區的批評顯得更為敏感,這反映出預訓練數據集的篩選規則對模型最終性格的決定性影響。

延伸閱讀

在討論串中,網友提到了 EleutherAI 的 The Pile 數據集與 Allen AI 的 Dolma 語料庫,這兩者被視為研究模型原始機率分布的重要基準。此外,討論也觸及了「消融」(Abliteration)技術,這是一種透過識別並刪除模型中負責拒絕回答的激活方向,來試圖讓模型變得更開放的後處理手段。

相關文章

其他收藏 · 0