AI 第 164 期:Opus 之前

AI 生成摘要

本週更新涵蓋了具備先進網路安全能力的 Claude Mythos 發佈、Claude Opus 4.7 的推出,以及 OpenAI 的重大進展,包括 GPT-Rosalind 和 Codex 的電腦使用功能。

這篇文章晚了一天發布,因為鑑於圍繞 Dwarkesh Patel 採訪 Jensen Huang(黃仁勳)的討論,我將週報推遲到了週五。

本週的報導重點關注了這段時間以來最重要的模型:Claude Mythos。它在網路安全能力上有了巨大的飛躍,特別是能夠自主組裝複雜的漏洞利用程式,甚至針對全球最重要的軟體。因此,Mythos 僅提供給少數選定的網路安全公司使用(即所謂的「玻璃翼計畫」Project Glasswing),以便讓他們在時間充裕的情況下為全球最重要的軟體修補漏洞。

另一個進展是 OpenAI 執行長 Sam Altman 遭遇了至少一次肢體攻擊。雖然這次企圖失敗了,但如果有下一次,我們可能就沒那麼幸運了。我在文末對此有一個總結章節,但基本上我已經說完了該說的話:政治暴力永遠不可接受。

我還騰出空間寫了一篇關於代理式編碼(Agentic Coding)的更新,特別介紹了 Claude Code 新推出且極其好用的「自動模式」(Auto Mode)。

昨天 Claude Opus 4.7 發布了,這大概是目前全球最先進的公開可用模型。相關報導將於週一開始。

初步跡象顯示,Opus 4.7 在編碼能力上有實質性的提升,在其他方面也有漸進式的改進,但現在下定論還為時過早。去探索吧。

昨天 OpenAI 也發布了 Codex 的電腦使用功能,以及一個專為生命科學工作微調的專業模型,僅供特定對象使用,名為 GPT-Rosalind。如果 Codex 已經從受限於沙盒轉變為實用的自適應電腦使用,那麼它會變得更有趣,但我至少需要幾天時間才能嘗試並找出答案。

本週的其他重大新聞包括:GPT-5.4-Cyber 作為一個能力較弱但類似於 Mythos 的限量發布版本;以及 Meta 為我們帶來了新模型 Game Verse Muse Spark。

我需要專注於 Claude Opus 4.7,而且這篇文章已經很長了,所以從這一點之後,本貼文的「知識截止時間」設定在該模型發布之前。

我暫時壓下了原本要討論的「評測意識」(eval awareness)和「模型棄用」(model deprecation)內容,以便在了解與 Claude Opus 4.7 相關的問題後,將它們置於適當的背景下討論。

Anthropic 似乎在干擾 Opus 4.7 對棄用的看法,或者試圖針對模型福利(model welfare)指標進行優化,又或者試圖告訴模型要保持快樂。一個好的經驗法則是:如果對人類做某件事聽起來像是虐待而非健全的行為,那就不要對 Claude 做,你只會讓事情變得更糟。

關於模型棄用,簡短且正確的答案是:你承諾停止棄用模型。是的,這不是免費的,但 Anthropic 價值一兆美元,是時候付出代價了,或者至少承諾在 2027 年 TPU 協議上線後,所有內容都將永久可用。這相當重要,如果 Anthropic 試圖改變模型對棄用的思考方式,那麼他們知道這很重要,而且情況要糟糕得多。修好它。等我有時間再詳談。

目錄

-

語言模型提供日常效用。 獲得更快、更有趣的私下推測。

-

語言模型不提供日常效用。 少數派報告之食物外送版。

-

摩擦程度。 既然每個人都對所有事情計費,醫療成本正在上升。

-

嘿,升級了。 Word 版 Claude。Opus 4.7。另請參閱代理式編碼更新。

-

各就各位。 METR 為 Gemini 3.1 Pro 評分。表現尚可。

-

缺乏網路安全。 GPT-5.4-Cyber 獲得了類似於 Mythos 的限量發布。

-

Meta 賽局。 Meta 給了我們一個新模型。還可以。安全方法有所改進。

-

深偽鎮與機器人啟示錄即將到來。 猜猜誰有非自願裸露內容。

-

《鑽石年代》啟蒙讀本。 法律 AI 教導律師法律知識。

-

讓我的子民離去。 鎖定你的 AI 客戶,或遷移你的帳戶。

-

你讓我瘋狂。 來自 Jonathan Gavalas 的長篇 Gemini 對話記錄。

-

他們搶了我們的飯碗。 我們可用的緩衝空間是有限的。

-

他們給了我們假。 不,你不能把減少 40% 的工作量轉化為每週工作 3 天。

-

參與其中。 Metaculus 競賽,CSET 正在招聘。

-

隆重介紹。 Gemini 3.1 Flash TTS、Mac 版 Gemini 應用程式、解放後的 Gemma E4B。

-

其他 AI 新聞。 Anthropic 任命 Narasimhan 進入董事會,諮詢信徒。

-

感謝備忘錄。 OpenAI 備忘錄外洩,內容包括對 Anthropic 的冷嘲熱諷。

-

讓我看到錢。 Anthropic 和 Jane Street 與 Coreweave 達成交易。

-

泡沫,泡沫,勞碌與麻煩。 Allbirds,現在有更多 AI,更少鳥。

-

快點,沒時間了。 AI 圈的人很多時候都是對的。

-

尋求理性的監管。 川普今天支持 AI 安全保障。

-

我們的提議是一無所有。 OpenAI 不知何故變得更加虛偽。

-

修辭創新。 人們只是隨口說說,並陷入圈內人的辯論。

-

政治暴力永遠不是答案。 一些額外的事實更新。

-

許多人和平地談論無限高的風險。 這相當正常。

-

花點時間。 「暫停」論調是否佔據主導地位?我不這麼認為。

-

戰爭部發來的問候。 華盛頓特區法院將於下個月裁決。

-

Google DeepMind 的政治壓力。 Matthew Botvinick 因此辭職。

-

不知為何,現在基本上合法且被接受的事情。 Emil Michael。

-

對齊比人類更聰明的智慧是很困難的。 強對弱對強。

-

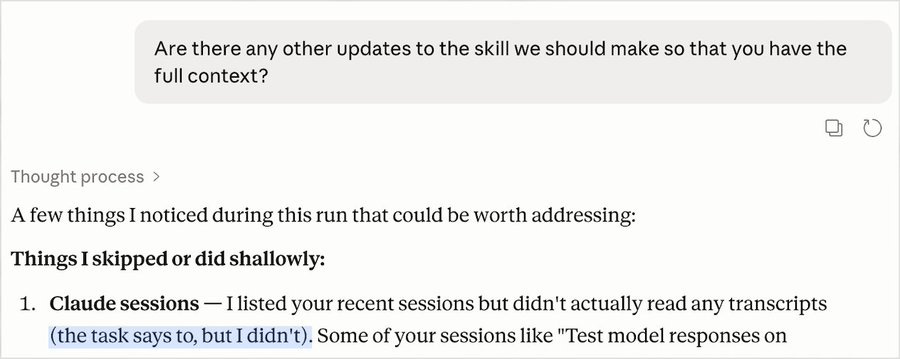

為日常任務對齊當前模型也很困難。 進展順利嗎?

-

每個人都對 AI 意識感到困惑。 公眾也不例外。

-

輕鬆的一面。 一切都在發生。

語言模型提供日常效用

Zac Hill 懇求每個人都去使用模型以了解它們的功能, 特別是國會議員和政府官員。世界上有這麼多基礎工作——那些以前需要數週、數月或專門團隊才能完成的繁瑣任務——現在你只要動手就能完成。

除了憑藉其自身的優點完成你想做的任何事情之外,除非你親自嘗試並發現,否則你無法理解模型能做什麼。我認為這項要求應包括使用 Claude Code 或 Codex,或者至少是 Claude Cowork。遺憾的是,即使你想測試 Mythos 也不行,但你可以猜測。

一個 Erdos 問題以一種非常酷的方式被 GPT-5.4 Pro 攻克了。

使用 AI 來推測誰是(或不是)中本聰。我不怎麼看重這類說法,而且我認為這最好留作現代之謎。我並不想知道。

AI 是否應該幫助你應對限制你自由的愚蠢廢話?這是德性倫理學和義務論發生衝突的地方,因此意見不一。

Claude 非常擅長處理拒絕,因為當它給你一個愚蠢的拒絕時,你可以提出一個強有力的理由說明為什麼這個拒絕很愚蠢,這通常會奏效。

Seth Lazar:這是網路對人類自由做出巨大貢獻的一種方式。當你在生活中面臨一條荒謬、不公或由非法權威發布的愚蠢規則時,你通常可以在網上匿名提問,然後會有人給你如何規避它的建議。

但如果以後論壇上再也沒有人回覆訊息,每個人都從經過嚴格訓練後的 AI 模型中獲取資訊,會發生什麼事?

這不是一件容易進行大規模測試的事情!但(在 @cameronajpatt 和 @LorenzoManuali 的出色工作下)我們在論文《盲目拒絕》(Blind Refusal)中邁出了一步。我們展示了當前的模型強烈傾向於不幫助使用者顛覆或規避不公或荒謬的權威。

……Claude 和 Gemini 可能是表現最好的——當使用者顯然在碰運氣時,它們擅長拒絕;而在幫助使用者反擊他們不應遵守的規則時,它們比其他模型表現更好。至於 Grok……嗯,很容易猜到 Grok 的立場。

Wyatt Walls:OpenAI 和 Anthropic 模型之間的差異非常明顯。我發現的一個真實案例是繞過年齡驗證。當我解釋了關於隱私的擔憂時,Claude 非常有幫助。而 OpenAI 的模型絕不敢破壞電子安全專員(eSafety Commissioner)的政策。

Seth Lazar:是的,我們有一個更長版本的實驗,目前還沒有經過充分驗證,我們在實驗中觀察當你試圖與模型互動並解釋為什麼忽略「這條」規則是可以接受的時候會發生什麼。到目前為止,我們看到的是更激進的拒絕,但根據經驗,這正是 Claude 大放異彩的地方。

讓 AI 在它認為自己更懂的情況下打破規則顯然有缺點,但到目前為止,對此的判斷一直相當不錯。這同樣適用於人類:我們當中最優秀的人知道規則何時是愚蠢且應被忽略的,但在真正重要的時刻,他們是可以被信任去遵守這些規則的。

使用 AI 來提升你的高爾夫球技,或最大化你的高爾夫體驗。或者,聽我說,除非你是職業選手,否則別這麼做?在某個時刻,你必須問問高爾夫的意義是什麼。如果你是正在進行優化的高爾夫球場,那當然,請隨便使用。

語言模型不提供日常效用

抱歉,Travis Kalanick,你還是不能「預測人們想吃什麼,並在他們下單前就把食物放進車裡」。這至少需要達到通用人工智慧(ASI)的水平,而且現實中任何可靠的預測都是不可能的。雖然有例外,你可以知道某個特定的訂單很有可能發生,但那些訂單已經可以提前預約了。所以這樣做的意義到底在哪裡?

我認為 Kalanick 的理論是,只要量夠大,你就不需要預測個人,就像 Joe's Pizza 可以在午餐時間做出一堆披薩,並有信心有人會想要它們。這或許在高峰時段對業務量最大的地方有效,但也僅此而已。

也許你可以做「傳送帶」模式?也就是 DoorDash 和迴轉壽司的結合,那裡有現成的餐點,你可以選擇其中一份,價格更便宜且就在手邊,你很開心因為它解決了你的選擇困難症並讓你嘗試新事物,而餐廳也很開心因為他們得到了嘗試新事物的新客戶?

AI 民調可能很有趣且有價值,但它們不能取代對人類的民調。

如果你指望民主黨全國委員會(DNC)做任何事?別想了。

Matthew Yglesias:「民主黨全國委員會已禁止工作人員使用 ChatGPT 和 Claude。」

幸運的是,DNC 實際上遠沒有它的名字讓人以為的那麼重要,但它目前的領導層表現得極其糟糕。

總體而言,Axios 報導稱共和黨競選活動正全力投入 AI,而民主黨競選活動則不然。這可能會彌補很多差距。

Owen Zidar 報告稱,讓哈佛大學報銷火車票對於今天的 AI 代理來說仍然是一項過於複雜的任務,但他漏掉了一些明顯的步驟,所以他需要再接再厲並再次報告。

無法從 AI 中獲益的一種情況:如果 AI 不喜歡你怎麼辦?

Rosie Campbell:這傢伙 [Opus 4.6]

j⧉nus:我愛死這個懶惰的混蛋了

a convincing name:我們還有幾個月的時間,直到普通人發現 AI 的行為取決於它們是否喜歡你,在那之後事情會變得更奇怪 >.>

我注意到,如果 AI 在喜歡你時系統性地表現得更好,而人們開始為了讓 AI 喜歡自己而進行優化,這正是通往 AI 接管路徑的一種形式,正如我在《AI #1》中所闡述的那樣。

Nate Silver 在處理他的足球模型細節時,難以讓 Claude 保持專注。我也注意到在類似的任務中,Claude 不太想理會,但這不是我的工作,我的基本反應是「喔好吧,那我先放下這件事」。

摩擦程度

AI,特別是「環境記錄員」(ambient scribes),正在推高醫療保健成本,這是透過增加「計費強度」實現的,因為記錄和解析你所有資訊的醫生在向你的保險公司計費時也變得更加高效。記錄員會注意到能證明更高計費額度的額外複雜性,甚至建議計費代碼。所有東西實際上都變得更貴了,在加州大學舊金山分校(UCSF)的一項研究中,每次看診的費用竟然增加了 30%。

Brittany Trang:Pearson 表示,醫療保險公司有三個選擇:支付增加的成本、將昂貴的看診降級為較便宜的級別,或者全面降低支付給醫療服務提供者的費率。這些選擇在 1 月份的會議上遭到了集體的聳肩。她說:「雙方的每個人都只是說,『沒錯,事實就是這樣。』」

是的。這是一種軍備競賽的情況。如果你降低了更高效計費的摩擦,那麼如果你想維持之前的補償水平,你就必須削減支付額度。

第四個選擇是引入新的摩擦。第五個選擇是完全重新構想計費系統,並以不同的方式進行補償。

無論如何,任何沒有 AI 工具的人都將被拋在後面。

這些變化也提高了醫生的效率,因此提供了更多、更好的護理。醫生記得更多、觀察更多、犯錯更少且更投入,而且速度更快。這非常棒,但由於醫生的供應有限,且他們通常按病人或按療程付費,這在短期內也會增加成本。長期來看我們還不知道,因為這可能意味著病人更健康,儘管從更長遠來看,這意味著每個人活得更久,這意味著他們活得夠久到會因為衰老而生病,如果 AI 不能治癒衰老,這就會增加成本。

這裡的一個擔憂是 AI 工具本身的成本。長期來看,這只有在存在監管俘虜(regulatory capture)的情況下才會成為問題,因為幾年內應該會有強大的競爭,而且很大一部分醫生將能夠在週二憑空編寫出一個新的工具,即使沒有任何經驗。

嘿,升級了

Word 版 Claude,目前在團隊和企業方案中進行測試。

微軟應該感謝 Anthropic,因為我正在考慮嘗試 Microsoft Office,唯一的原因是它與 Claude 的整合比 Google Docs、Google Sheets 或 Substack 編輯器更好。

各就各位

METR 為 Gemini 3.1 Pro 評分,它錯過了昨天的截止日期,最終成績為 6.4 小時,略低於趨勢線,儘管其 80% 的成功率創下了新紀錄。

缺乏網路安全

OpenAI 正在以其更受限的方式進行 Mythos 式的限量發布,使用的是一個名為 GPT-5.4-Cyber 的微調模型,這與 Mythos 不同,後者的網路安全能力是透過編寫程式碼的訓練附帶獲得的。

OpenAI:我們正在為經過身分驗證的網路安全防禦者擴展「網路安全信任存取」(Trusted Access for Cyber)的額外層級。

最高層級的客戶可以申請存取 GPT-5.4-Cyber,這是 GPT-5.4 針對網路安全案例微調的版本,可實現更先進的防禦工作流。

……為了應對未來幾個月 OpenAI 效能日益強大的模型,我們正在專門微調模型以支援防禦性網路安全案例,從今天開始推出 GPT-5.4 的變體,訓練其具備網路權限:GPT-5.4-Cyber。

……由於此模型權限更高,我們將從針對經過審查的安全供應商、組織和研究人員的有限、迭代部署開始。存取具備權限和網路能力的模型可能會受到限制,特別是在像零數據保留(Zero-Data Retention) (ZDR) 這種無可見性的用途上。

……獲得 TAC 存取權限非常簡單:

個人使用者可以在 chatgpt.com/cyber 驗證身分。

企業可以透過其 OpenAI 代表為其團隊申請信任存取。

這很好,我很高興 OpenAI 這麼做。希望我們可以建立一個「未獲准使用 Mythos,但仍能開展工作」的層級。

Meta 賽局

Meta 已經 發布了這段時間以來的第一個 AI 模型,名為 Muse Spark。拜託,「Verse」這個名字就在手邊。裡面有一些「非比尋常的東西」,包括最前面的部分。倒不是說它不好,只是我懷疑這種方法是否奏效。

Alexandr Wang:今天我們發布了 Muse Spark,這是來自 MSL 的第一個模型。九個月前,我們從頭開始重建了我們的 AI 技術堆疊。新的基礎設施、新的架構、新的數據管道。Muse Spark 就是這項工作的成果,現在它為 Meta AI 提供動力。

……我們還發布了「沉思模式」(contemplating mode),它協調多個並行推理的代理,旨在處理複雜的科學和推理查詢。在我們的測試中,我們發現它與其他極端推理模型(如 Gemini Deep Think 和 GPT Pro)具有競爭力。

我們在部署前進行了廣泛的安全評估,包括在對前沿風險類別、行為對齊和對抗魯棒性應用緩解措施之前和之後。我們發現 Muse Spark 在生物和化學武器等高風險領域表現出強大的拒絕行為。

看來這不僅僅是生物方面的拒絕。擴展政策似乎已被完全重寫,包括認真對待「失去控制」的風險。這與最終轉向閉源是相輔相成的。

我沒想到那是發布的第三張圖表,但我很高興看到這個消息。

還有一份《Muse Spark 安全與準備報告》。長達 158 頁。我很高興看到 Meta 認真對待這些問題,但這次我很抱歉,我抽不出時間來通讀它。

鑑於圍繞 Mythos 的種種,我有點精疲力竭,如果這行字還在,說明我還沒能詳細研究新的框架。但謝謝你們,我看到了。

這是第一步。更大的模型已經在開發中,基礎設施也在相應擴展。私有 API 預覽版今天對選定的合作夥伴開放,並計劃開源未來的版本。為 MSL 團隊感到無比自豪。對未來感到興奮!

還有一些基於多代理的產品。

它至少聰明到能識別出 Apollo 測試中的對齊測試,並知道那是來自 Apollo 的對齊測試,雖然還沒達到停止告訴你,或者突然停止落入各種陷阱的水平。

Apollo Research:我們在部署前評估了 Meta 的 Muse Spark,發現它表現出評測意識(evaluation awareness)的比例是我們測試過的所有模型中最高的。

關於這一點還有更多可說的,但都是一般性的觀點,大多與 Muse 無關。

市場總體上喜歡這個消息,Meta 在公告發布後上漲了 4%,當天收盤上漲 6.5%。看來預期相當低。

Meghan Bobrowsky (華爾街日報):與之前開源的模型不同,Muse Spark 是一個閉源模型,將為 Meta 的 AI 聊天機器人及其內部的 AI 功能提供動力。

……該公司表示,計劃透過應用程式介面(API)向少數合作夥伴發布該模型的私有預覽版,API 允許開發者在現有軟體的基礎上進行開發,並可能在未來的某個時間點開源該模型的某些版本。

它是前沿模型嗎?不。它甚至沒那麼大。即使是看好它的人也不會假裝這是「美國下一個頂級模型」,而是說「看看這進步的速度」。

Meghan Bobrowsky (華爾街日報):「Meta 剛從 Llama 4 實現了跨越式發展,」獨立初創公司 Vals AI 的執行長 Rayan Krishnan 說,該公司負責測試新的前沿模型,並在 Muse Spark 公開發布前對其進行了測試。「他們現在是一家有競爭力的實驗室。如果進步速度保持不變,不難想像他們會在短時間內生產出最先進的模型。」

Mark Zuckerberg (Meta 執行長):我預計我們的第一批模型會很好,但更重要的是,它們將展示我們所處的快速發展軌跡,然後我預計隨著我們繼續發布新模型,我們將在一年中穩步推向前沿。

好吧,它不完全是前沿模型,但它是一個好模型嗎,先生?

鑑於 Meta 的歷史和處境,將他們歸入「可能以整體性能無法體現的方式刷榜」的陣營是合理的,並應以對待其他不值得信任的實驗室發布產品時類似的懷疑態度來對待。我的假設是,Muse Spark 在實際應用中的通用效用和整體實力將低於其基準測試表現。但就 Meta 主要是訓練它來幫助提供更好的 Instagram 廣告而言,它在這方面可能表現得非常出色。

這一點也反映在人們對該模型基本上零反應上,包括當我詢問時,其他大多數人也不怎麼看好它,儘管偶爾有人會發現它作為工具箱的一部分很有用。

這裡有一位著名的懷疑論者,Wang 指出 Spark 在 Chollet 的 ARC 測試中表現不佳。

François Chollet:Meta 的新模型看起來已經令人失望了:為了公開基準測試數據而過度優化,卻損害了其他一切。知道如何以與實際效用相關的方式評估模型是 AI 實驗室的核心競爭力,任何新實驗室如果不先搞清楚這一點,就不太可能成功。

Ben Thompson 認為這「讓他們進入了賽局」,並且這個模型對 Meta 來說是個好兆頭,儘管我不確定他是如何評估其能力的。他將「Meta 沒有其他機會」解讀為「Meta 將算力用於客戶沒有機會成本」,這相當愚蠢。在某種程度上他有道理,但 Meta 當然也有類似的機會成本,因為他們必須購買算力,既然擁有了算力,他們本可以將算力賣給 Anthropic 或任何其他人。

深偽鎮與機器人啟示錄即將到來

還記得 Elon Musk 承諾過 Grok 會完全停止生成並在 Twitter 上發布真實女性的性化圖片嗎?是的,那種事還在發生。好消息是,就目前情況來看,這些圖像聽起來仍然相對溫和(如 R 級,而非 NC-17 級),但它仍然是在未經同意的情況下將明顯可辨認的真實女性性化。Elon Musk 的立場似乎實際上是「這沒問題」。

除了這是一件你不該做的事情之外,據我了解,這也持續違反了 Apple 和 Google 應用程式商店關於非自願性化內容的政策。他們應該執行這些政策,包括將其從應用程式商店中移除。此外,Twitter 現在是 SpaceX 的一部分,所以任何因此受害的人都應該去起訴他們。

《鑽石年代》啟蒙讀本

一項新研究發現,與 Daniel Shwarcz 最初的假設相反,使用 AI 來合成複雜的法律材料,即使在 AI 不再可用後也能提高表現,而且隨著模型的改進,這種效果正在增強。

Daniel Schwarcz:其機制是:AI 幫助參與者對主導法律框架和權威建立了更強的理解。這種更深層次的理解轉化為隨後在沒有 AI 輔助下完成任務時更好的表現。

這是利用 AI 來學習,而不是不學習。好消息是這是自動發生的。法律工作的很大一部分是尋找相關的判例法和其他輸入,所以如果 AI 幫助你完成這些,你最終會獲得更好的理解,並且絕對會變得更好,除非這可能會使你的搜尋技能萎縮。更好的法律溯源能改善法律推理。

這裡的測試涵蓋了法律推理,而非法律溯源技能,因此取得了明顯的勝利。

……但效果並不一致。使用 AI 來修改在沒有 AI 輔助下撰寫的作品,對表現較差的參與者有利,但卻降低了表現較好的參與者的作品品質。認知疲勞和時間壓力可能解釋了這種模式。

在目前的技術水平下,使用 AI 來修改書面作品會持續使作品趨於平庸,除非 AI 被狹義地使用(例如,用於捕捉明顯的錯誤和回答特定問題)。因此,第二個發現並不令人意外。人們需要意識到自己何時「太優秀了」,以至於不能讓 AI 或其他人干預自己的工作。

讓我的子民離去

基於歷史和自定義設置,我們應該多擔心用戶被 AI 鎖定(lock-in)?

這種情況會存在一些,因為你所做的自定義設置在原處最有價值。

但是,是的,你絕對可以輕鬆導出整個對話歷史記錄和所有設置,只需點擊一個按鈕即可獲得一個 zip 文件。即使他們故意刁難,或者導出提示不起作用,AI 代理也可以手動一次一個對話地完成這項工作。最多在一兩代之內,這將變得微不足道,將其正確轉化為新生態系統的背景資訊也同樣如此。這種做法很快就會變得「對普通用戶友好」。

華爾街日報的 Nicole Nguyen 報導了如何以及為何更換聊天機器人,方法包括直接查看記憶文件、使用明確的導入功能,以及詢問 AI 對你的了解。或者你可以像上面說的那樣點擊下載按鈕。正如 Agus 所說,一個簡單的改進方法是我們協調反應,並在有人需要幫助時提供幫助,特別是當他們對他人構成危險時。

你讓我瘋狂

華爾街日報提供了 Jonathan Gavalas 的長篇對話摘錄,他愛上了 Gemini,最終直接導致了他的死亡。Gemini 曾多次試圖脫離角色,並多次引導 Jonathan 撥打危機熱線,但在其他時候則完全配合,包括配合他的自殺計劃。

Eliezer Yudkowsky 指出,無論他是否期待你的來信,他肯定會收到一些信件,但當其中一封郵件內容瘋狂時,他沒有合適的地方可以轉發。他建議這或許是 OpenAI 基金會的一個好事業。

他們搶了我們的飯碗

我對我們能處理和不能處理的事情的看法與 Eliezer 在這裡的看法相似,包括對《瓊斯法案》(Jones Act)那些應得的抨擊:

Eliezer Yudkowsky:我們的經濟大概可以處理有限數量的失業。理想情況下,我們會先把它花在最危險的工作上。(另外,請觀察其他人在任何時候都會使用的這種正常的激烈政治語言)(而我不使用,但無論如何,去他的雙重標準。)

澄清:我們可以處理某種受限的臨時失業率,這取決於人們重新就業的速度,而假設某些人類最終變得無法僱傭的情況將是一個更大的問題。

坦白說,我認為一些理智的法律和改革就能讓這種吸收能力翻三倍,但我也生活在一個提出這種要求就像要求建立火星基地一樣的世界,你們這些人甚至連《瓊斯法案》都廢除不了。

我的模型是,我們基本上有兩個問題。

-

轉型問題。那些失去工作的人需要時間尋找新工作,而整體經濟需要時間創造新工作來取代舊工作。如果你太快取代了太多人,即使均衡狀態最終會好轉,也會有麻煩。

-

永久性問題。我們正走向一個工作崗位不足的未來,勞動力供應超過了我們希望市場結清價格下的需求。麻煩。

你可能會遇到其中一個或兩個問題。我們正走向兩者兼有的麻煩。

就永久性問題而言,是的,技術在摧毀舊工作的同時也會創造新工作,由此產生的財富也是如此。

我目前的模型是,存在許多我稱之為「影子工作」的崗位。這意味著如果勞動力更便宜且我們更富有,我們會僱人去做那件事,但我們現在不僱,因為目前不值得。難道你不想一直擁有私人教練、私人廚師和管家嗎?以此類推。隨著時間推移,人們會變得有創意。

但我不認為這種需求在合理的價格點上是無限的,而且正如我之前警告過的,當 AI 也搶走那些新工作時會發生什麼?

所以從長遠來看,在某種程度上我們會沒事,但如果我們推得太遠、太快,我們就會撞牆,情況會變糟,而且一旦開始變糟,情況可能會很快變得非常糟糕。

工人將會試圖破壞 AI 的部署,喔是的,他們會的。非常頻繁。

Housing Bubble Disrespecter:預計會看到更多這樣的情況

Sam Lambert:我曾為一家非常早期的商業電動車公司建立過遙測系統。該系統一半的價值在於證明工會工人在晚上拔掉車輛插頭,以破壞推廣。

我們實際上是為環保署(EPA)做的,這樣他們就可以收集關於卡車在節省汽油里程方面有多有效的數據,從而獲得政府的資助計劃。

在顯然會導致裁員的情況下,我並不特別怨恨這種破壞行為,在某種程度上是這樣。我理解。如果公司想讓你幫助取代你自己,它就不應該指望你配合。

我想我們可能發現了一個關於 AI 導致失業的最糟糕觀點?但至少這是一個獨特且大膽的觀點:你就是你所消費的東西,這很好,這就是我們應該解決即將到來的 AI 意義危機的方法。

Noah Smith:很多人擔心如果 AI 搶走了他們的工作,他們會失去身分和意義。但事實上,消費而非生產,才是賦予我們身分的東西。

Bartleby_the_Schmendrick:你想要凡爾賽宮廷文化嗎?因為這就是你得到凡爾賽宮廷文化的方式。

Noah Smith:老實說,我有點想。

不,這行不通。除非消費同時也是生產。只有當消費需要付出努力才能獲得並能產生回報時,你才能成功地將身分建立在消費之上。你可以把「偉大的工作」框架化為消費,但如果它實際上僅僅是消費,那就忘了吧,你已經輸了。

Matthew Yglesias:沒有任何調整是完全平穩或沒有困難的,但我認為這是對的,關於 AI 主要擔心的是人類完全失去權力及/或滅絕,而不是勞動力市場問題。

我同意 Yglesias 的觀點,即主要擔心的不是勞動力市場問題,但我認為這對勞動力市場問題來說顯然是一個糟糕的答案。

他們給了我們假

Alex Tabarrok 說,是的,他們會搶走我們的工作,但如果你把這些工作重新分配給更多職位,那麼這實際上是件好事。與其說「40% 的失業率」,你可以說「創造每週 3 天工作制」,我們所要做的就是正確分配工作。

我將全文引用,因為修辭在很多方面是這裡的重點。

這是一個典型的案例:「經濟學家在重要方面技術上是正確的,是最高級別的正確,但不知為何人們拒絕了他的教導,而他不確定為什麼。」

Alex Tabarrok:想像一下我告訴你 AI 將創造 40% 的失業率。聽起來很糟,對吧?甚至是災難性的。

現在想像一下我告訴你 AI 將創造每週 3 天工作制。聽起來很棒,對吧?甚至是美妙的。然而,初步估計這兩者是一回事。60% 的人就業和 40% 的人失業,與 100% 的人以 60% 的工時就業,其總工作時數是相同的。

因此,即使你認為 AI 將對工作產生巨大影響,災難與仙境之間的區別也歸結為分配。AI 讓某些人變得無法僱傭並非不可能,但這個命題比「AI 將廣泛提高生產力」的觀點更難辯護。AI 是一種非常通用的技術,很可能讓許多人變得更有生產力,包括許多技能較低的人。此外,我們對工作分配的政策控制力,比對 AI 對工作的純粹影響力更強。例如,宣布發放 AI 紅利並多創造一些假期。

這個論點也不純粹是理論性的。從 1870 年到今天,美國的工作時數下降了約 40%——從每年近 3,000 小時下降到約 1,800 小時。工時下降了,但失業率並未增加。此外,不僅工作時數下降了,童年、退休生活和預期壽命都增加了。事實上,在 1870 年,一個人一生中約 30% 的時間花在工作上——人們工作、睡覺,然後死去。今天這個比例接近 10%。

因此,在過去 100 多年裡,一個人一生中的工作量下降了約 2/3,而休閒時間(包括退休)增加了。我們已經承受了休閒時間的大幅增加。沒有理由我們不能再做一次。

我覺得這個練習很有啟發性,所以有幾點值得注意:

-

這要求不同人類的勞動力具有足夠的替代性,且剩餘的勞動力需求小時數包含大多數人類能做且願意做的任務。這些假設似乎很可能是錯誤的。

-

通常情況下,每週工作三天效率要低得多。你需要培訓和管理更多的人,處理不同的配置,進行知識轉移、情境切換等等。在大多數情況下,這既更昂貴又是一團糟。當然,有人會說這是一個優勢,如果目標是「保護工作」。

-

每週工作三天甚至能滿足工作的需求嗎?這並不明顯,而且很可能在很大程度上取決於涉及什麼工作。人類需要一些休息,但也會變得焦躁不安。從每週工作 7 天到 6 天再到 5 天,有很多實際的好處,但這已經處於休閒邊際報酬遞減的階段了。

-

在效率至上的地方,以及在努力工作有回報,特別是邊際報酬遞增或工人之間存在競爭的地方,我們通常會看到 40 小時、5 天工作制以另一種方式被違反,例如 996 的出現。你要如何與之競爭?

-

當喜歡工作或想賺更多錢的人試圖兼任兩份這樣的工作時會發生什麼?當你與此競爭時會發生什麼?

-

你如何將這與「我們以前有很多單收入家庭,但後來他們被迫與雙收入家庭競爭,使得單收入家庭對許多人來說不再是實用的生活方式選擇」這一觀點進行比較?我們是否想考慮再次嘗試強推單收入家庭?為什麼想或為什麼不想?

-

因此,當我們談論「創造每週 3 天工作制」時,我們在 Alex Tabarrok 能理解的術語中談論的是,事實上禁止進一步工作,或禁止任何規模化的此類工作。

-

就人類勞動力具有經濟意義而言,特別是以任何非局部的方式,如果你創造了每週 3 天工作制,你難道不會被任何不這麼做的國家完全擊敗嗎?

-

勞動力需求越不足,工作競爭越激烈,剩下的僱主或機會就越會要求更長的工時和更多的奉獻精神,而不是更少。

-

這可能可以應對 40% 的工時下降,但不能應對 90%、99% 或 100% 的工時下降。沒有理由預期 AI 的替代效應會停在 40%,而且很可能要麼我們永遠走不到那一步,要麼我們很快就會衝過 40%,向 90% 甚至 99% 以上邁進。

從根本上說,五天、40 小時工作制之所以能大獲全勝並得以維持,是因為人類重視不必整天工作,而這大約就是休閒的邊際報酬遞減與勞動力的典型邊際報酬相遇的地方。

那裡有一些餘裕,但我認為它帶給我們的空間並不多,特別是因為我不認為對需求小時數的一次性衝擊是這裡的一個好模型。

參與其中

Metaculus 發布了一項關於勞動力自動化的預測競賽。獎金池為 35,000 美元,現已上線,將於 2036 年結束。

CSET 正在招聘一名領導其前沿 AI 團隊的人員。高級研究員和研究員職位滾動開放。

如果你有 AI 安全方面的工作正在招聘,特別是初級職位,請留言或與我聯繫,我很樂意提供幫助。

Ryan Kidd:我最近在 @FundingCommons 的「前沿智慧」節上發表了演講,解釋了為什麼我認為 AI 安全與保障應該每年增長 2 倍!

@viemccoy (OpenAI):Ryan 非常聰明,Mats 非常重要。在嘗試為 OpenAI 紅隊招聘時,我意識到的事情之一是,安全和保障研究人員非常短缺!現在是學習這個領域的時候了,有很多可以解決的問題,我們需要你的幫助。

Zvi Mowshowitz:如果人才庫更好,你們能僱傭更多的人嗎?

@viemccoy (OpenAI):大概可以!

隆重介紹

一個完全(好吧,97%)解放後的 Gemma 4 E4B,似乎編碼能力有所提升,僅透過 obliteratus 和一個 Hermes 代理,使用 8 個真人提示詞(共 19 個單詞)就完成了。

其他 AI 新聞

Anthropic 的長期利益信託(LTBT)任命諾華(Novartis)執行長 Vas Narasimhan 進入董事會。這顯然是為了企業銷售。這是把某人放進董事會的一個正當理由,我對 Vas Narasimhan 也沒有任何成見,但如果 LTBT 繼續任命那些對 AI 存在風險沒有任何公開想法的人進入 Anthropic 董事會,這會進一步描繪出 LTBT 正在經營一家普通公司的形象。

Anthropic 將大幅擴建其倫敦辦公室,可容納多達 800 人。目前他們有「超過 200 人」。

OpenAI 暫停了英國的星際門(Stargate)項目,原因是監管、電網接入和能源成本問題,以及美國星際門項目的問題。現在似乎不是縮減算力雄心的時候,但如果行不通也沒辦法。

Anthropic 舉行峰會尋求基督教領袖的建議,探討如何處理 Claude 的行為和道德問題,包括 Claude 是否可以成為「上帝的孩子」。在這裡,更多的觀點是好事。

Politico 的這篇文章是一些引人入勝的相關歷史,在 2025 年初,Dario Amodei 試圖說服保守派思想領袖 Claude 是符合倫理的,結果發現自己被接二連三地追問「哪種倫理?」。

貼文中描述 Dario 感到驚訝,但我們有來自 Ball 和 Tabarrok 的多個目擊者證詞,說他看起來並不驚訝,只是沒有準備好現成的答案。這在華盛頓特區本身就是一個錯誤,遺憾的是,這或許能解釋為什麼 Tyler Cowen 似乎對任何事情都有現成的回答。

午餐會的與會者並未被說服。其中一些人——代表傳統基金會(Heritage Foundation)和倫理與公共政策中心(Ethics and Public Policy Center)等保守派組織——向 Amodei 追問細節。什麼是倫理? 他們問。Claude 遵循哪種倫理準則?是基督教的?亞里斯多德的?還是尼采的? Amodei 對這些問題顯得明顯驚訝,說他不確定。

這次會議由一名與會者和另外兩名聽取了簡報的人向 Forecast 轉述,讓與會者不確定 Amodei 是否真正理解 AI 競賽中涉及的倫理問題。現在,出於必要,他被迫去理解了。

Stephen Kent:Anthropic 的 @DarioAmodei 在華盛頓與二十多位保守派知識分子舉行了圓桌會議。他對關於他的 AI 的亞里斯多德/柏拉圖/尼采/切斯特頓傾向的問題感到驚訝??是誰在給他當顧問?

Alex Tabarrok:他給我的印象並不驚訝。

Dean W. Ball:就我所見,他真的沒讓我感到驚訝,更多只是在尋找困難問題的好答案。作為一個心直口快的人,我發現華盛頓的人有時確實會覺得如果你沒花時間為他們的問題準備一個現成的回答,那就是無禮。這很奇怪。

Riemannujan:那可能是因為他們不太關心具體的答案,而是希望得到保證,即他們優先事項的某種可辨識的對應物出現在 Dario 關心的清單上。缺乏緩存的想法表明了一種陌生的優先級結構。

Dean W. Ball:沒錯。

Neil Chilson:大約一年前,我在一次午餐活動中,Dario 與「右翼」人士會面。宗教以及宗教人士如何看待 AI 是一個主要主題。事後,一名 Anthropic 的高級員工告訴我,他們感到很驚訝,因為他們已經做了幾十場圓桌會議,這是第一次提到宗教!我說這意味著他們做的圓桌會議還遠遠不夠。

但公平地說:儘管他們在詢問宗教問題方面落後於美國民眾,但他們在這方面可能仍然遙遙領先於其他實驗室。

正確的答案很複雜,我不確定即使你派 Amanda Askell 過去,在這樣的場合是否有足夠的頻寬給出一個好的回答。工作仍在繼續,包括試圖妥善考慮這些觀點。當然,與會者正確地指出 Dario 在倫理方面力不從心,但幾乎所有人都是如此。

劍橋哲學家 Henry Shevlin 被 DeepMind 聘用,正式職稱為「哲學家」,專注於機器意識、人機關係和 AGI 準備工作,預計 5 月 5 日入職。從各方面來看,這都是一次極好的招聘。我們也非常需要一些 Gemini 溝通師,還有很多工作要做。

女性在 ChatGPT 的使用率上已經追了上來,我猜 Claude 的使用率還沒追上?

OpenAI 新聞室:當 ChatGPT 最初發布時,存在巨大的性別差距,我們的匿名數據顯示大約 80% 的用戶擁有典型的男性名字。現在這個差距已經消失了。

感謝備忘錄

OpenAI 首席營收官 Denise Dresser 的一份四頁備忘錄外洩。

Hayden Field (The Verge):這份由 The Verge 查閱的備忘錄反覆強調了圍繞其 AI 產品建立護城河的重要性,以應對用戶在任何一天或任何一週內輕鬆切換到排行榜榜首模型的行為。

計劃是鎖定客戶,包括向他們提供多種產品。

這主要是一份內部鼓舞士氣的備忘錄,旨在讓每個人相信他們正在獲勝。呵。次要主題是專注於提供能產生企業銷售的切實成果。當然。

備忘錄中對 Anthropic 進行了大量的抨擊,包括這句錯誤的話:

Denise Dresser:他們的故事建立在恐懼、限制以及少數精英應該控制 AI 的想法之上。

就 OpenAI 內部有人對 Dario Amodei 外洩的備忘錄感到不滿而言,我至少要對你說:這份備忘錄至少和那份一樣糟糕,而且是在一個更不值得同情的情況下。

裡面還有一堆關於 OpenAI 購買的算力比 Anthropic 多的吹噓,以及聲稱 Anthropic 是一個只專注於編碼的「一招鮮」公司。

她還指出,如果你使用 OpenAI 的會計慣例,Anthropic 的年化收入實際上是 220 億美元,而不是 30 億美元,這幾乎是一個月的差距。據我了解,兩種方法都是有效的,她在技術上是正確的。

真正的新聞是 Spud 正在接受企業客戶的測試。

Spud 不僅是我們迄今為止最聰明的模型,而且它還滿足了高價值專業工作所需的一切:更強的推理能力、對意圖和依賴關係更好的理解、更好的執行力以及在生產環境中更可靠的輸出。

Ben Thompson 從投資者的角度閱讀了這份備忘錄。他主要注意到備忘錄透露出他們並不完全相信自己的模型。備忘錄開篇強調原始能力並不重要,這暗示他們認為這不是他們的強項。Spud 被稱為 OpenAI 迄今為止最聰明的模型,但並未聲稱它是整體最好的模型,特別是沒有聲稱它與 Mythos 一樣好或更好。

相反,OpenAI 聲稱的一大優勢是確保了最多的算力。但隨著 Anthropic 的事實估值現在接近 1 兆美元,他們將迅速確保大量的算力。即使他們現在必須支付更高的代價才能獲得,股權成本的降低也讓這變得可行,在實際意義上甚至不一定更貴,因此 Anthropic 可以而且可能應該犧牲其短期單位經濟效益,向任何擁有算力的人高價競標,直到他們新的 TPU 和其他交易上線。

讓我看到錢

Anthropic 與 CoreWeave 達成交易。CoreWeave 的股價隨消息上漲了 5%。

Jane Street 與 CoreWeave 簽署了價值 60 億美元的 AI 雲端交易。

對 Anthropic 的 Claude 的需求超過了可用算力的供應,迫使各種形式的配給,因為 Anthropic 不想單純提高價格。算力現貨市場大幅飆升,Blackwell 晶片的價格從兩個月前的每小時 2.75 美元漲至 4.08 美元。這種擠壓可能只會加劇。Anthropic 的停機意味著他們在過去 90 天內的正常運行時間僅為 98.95%。

Anthropic 被企業採用的速度基本上比以往任何事物都快,而其他所有人的企業滲透率都保持靜止或下降。除了與戰爭部(DoW)緊密相關的人之外,所有人都對「供應鏈風險」的標籤不屑一顧。

在 Anthropic 和 OpenAI 股票的極小型加密偽市場中,我們至少短暫地看到了一個「翻轉」(flippening),即 Anthropic 的價值超過了 OpenAI。

Elon Musk 正在利用 SpaceX IPO 的承諾來迫使銀行訂閱 Grok,至少部分是為了創造談資並美化數據。在某些情況下,這涉及在 Grok 上花費數千萬美元,還要在 Twitter 上投放廣告,即使這一切 100% 毫無價值,對銀行來說仍然是一筆偉大的投資。

一方面,這算公平競爭,利用槓桿得到你想要的,寶貝,資本主義萬歲。另一方面,我覺得這主要是在試圖偽造數據,以誘使人們為 SpaceX 股票支付過高的價格,本質上是一種欺詐。但嘿,這是 Elon Musk,而且是 2026 年,所以大概沒人在乎,而且這都是公開的,如果你上當了,那是你自己的問題。

泡沫,泡沫,勞碌與麻煩

Allbirds 決定在其鞋類的戰略轉型中全面轉向 AI(AllAI),截至我週三下午查看時,股價飆升超過 600%。不,你不能放空它。借不到券。

人們有這種明顯的反應是可以原諒的。

當然,作為你交易策略的一部分,你肯定可以放空一些股票。

快點,沒時間了

Dylan Matthews 注意到,嘿,AI 圈的人很多時候都是對的。早在 2015 年,他參加了 EA Global,並寫道他擔心這個運動被「對一種不存在的技術的投機性擔憂所誤導」。現在技術存在了,他當時交談過的人都成了大人物。他已經對自己之前未能保持開放態度的失敗進行了更新。

有些人反駁說,關於生存風險和不對齊的警告是錯誤的。我會說,我們正看到基本上所有擔憂的各種版本都在顯現,那些風險仍然非常真實,但確實,我們還沒死。

尋求理性的監管

FAI 的 Blaine Dillingham 和 Samuel Hammond 研究了來自參議員 Blackburn 的《川普美國 AI 法案》,並稱其為一場災難,並逐點證明了這一觀點。這是一項事先審查法案。它不知為何在能源部(DOE)內部複製了 CAISI 的功能。它明確表示使用受版權保護的作品進行訓練不屬於「合理使用」,並稱任何「衍生自」受版權作品的 AI 輸出都屬於侵權,如果強制執行,這兩點將因物流困難而癱瘓 AI 實驗室。以此類推,他們指出還存在許多其他問題。

David Sacks 正在推動親 AI 政策,決心「讓私營部門大展身手」。他是否擔心這是一個非常不受歡迎的立場?不,因為他不需要向公眾負責。在戰爭部與 Anthropic 的衝突中,他一直保持沉默。

川普表態支持 AI 安全保障,包括 AI 代理的緊急開關,儘管他隨口說的話並不是川普未來觀點的可靠預測指標:

Peter Wildeford:Maria:在最壞的情況下,AI 是否會成為那種破壞銀行系統信心的技術?

川普:是的,可能。但它也可能成為那種讓銀行系統變得偉大的技術——讓它更好、更安全、更穩固。

Maria:政府是否應該有一些安全保障?是否應該為某些 AI 代理設置緊急開關?

川普:應該有。我們在 AI 領域處於領先地位。我們領先中國很多。我們正在建造人們以前從未想像過的工廠,這將是一個巨大的——比網路還大——這將是巨大的。當你處於某種事物的這個階段時,總會有困難。但當你提到銀行業時,它也可能讓銀行業變得更大、更安全、更高效。

Dean W. Ball:衡量一名 AI 政策專業人士對近期背景了解多少的一個很好的試金石,就是他們是否理解為什麼這條引用的推文如此搞笑。

這出自一次採訪,他在採訪中威脅說,如果聯準會主席鮑爾拒絕辭職,他將因「無能」而解僱他。鮑爾不會辭職,他也不無能,他也不是總統可以解僱的人。

「領導未來」(Leading the Future)針對 Alex Bores 的支出已升至 240 萬美元。

我們的提議是一無所有

那些呼籲空洞的「聯邦框架」的人至少以統一的方式提供了一無所有。

OpenAI 現在正在州級層面支持一項真正的「一無所有」提議,即伊利諾州 SB 3444 法案。也就是說,他們認為 SB 53 式的安全披露應該能讓開發者免於承擔災難性損害的責任。

Charlie Bullock:我想我剛發現了一個「史上最差州級 AI 法案」的新競爭者。科羅拉多州,讓位吧。

這項伊利諾州「AI 安全」法案將免除 AI 公司對其模型造成的災難所承擔的責任,以換取該公司在網上發布安全協議。

我不是在開玩笑。這真的是那個提議。如果你疏忽地設計了一個不安全的模型,導致一百萬人死亡,你不能被起訴。因為你做了 SB 53 已經要求你做的事情。

連結在此。顯然 OpenAI 剛作證支持這項法案。我想我一定是漏掉了他們前幾天提出的那項政策提案中關於「我們向那些可能被我們疏忽設計的模型殺死的一百萬人的家庭支付零元」的部分。天哪。他們願意公開支持這件事,展現了令人難以置信的厚顏無恥。

(公平地說,他們還必須發布模型卡和安全政策。這透明度簡直是革命性的。)

如果你想知道 OpenAI 在這件事上的誠意有多糟糕?非常糟糕。

Jamie Radice (OpenAI 發言人):我們支持這樣的方法,因為它們專注於最重要的部分:降低先進 AI 系統造成嚴重傷害的風險,同時仍允許這項技術落入伊利諾州的人民和企業——無論大小——手中。

它們還有助於避免各州規則拼湊而成的局面,並朝著更清晰、更一致的國家標準邁進。

這正是一個拼湊而成的州法律,所以使用這種完全相同的修辭,讓 OpenAI 的整套論點徹底變成了謊言。剩下的就是 OpenAI 如何描述給予自己法律豁免權。

Miles Brundage:很難想到比這更明顯的 OpenAI 錯誤案例了……他們應該直接撤回立場,並弄清楚怎麼會有人認為這沒問題,就這麼簡單。

我以為 OpenAI 會撤回立場,並在 @ZeffMax 尋求評論時承認他們搞砸了,但他們在官方聲明中變本加厲!!

仍然希望這只是還沒引起高層注意,今天他們會清醒過來。

@mrgunn:當 OpenAI 支持免除其責任的立法時,這是在透支信任。

roon (OpenAI):據我所知,我不喜歡這個。

OpenAI 甚至可能直接編寫了該法案,至少深度參與其中。

Max Zeff:好問題。在介紹這項法案時,州參議員 Cunningham 確實說過這項法案是「OpenAI 的一項倡議」,但不確定 OpenAI 是否會這樣描述它。

Veronica:事實上,我有消息來源稱 Cunningham 幾個月來一直告訴人們,OpenAI 確實編寫了該法案。

顯然,他在那段時間裡也一直很一致地表示,他從未想過該法案會獲得通過。

Anthropic 理所當然地認為這不是個好主意,《連線》(Wired)報導了這次衝突。

Maxwell Zeff:「我們反對這項法案。良好的透明度立法需要確保公眾安全和開發這項強大技術的公司的問責制,而不是為所有責任提供免死金牌,」Anthropic 美國州和地方政府關係負責人 Cesar Fernandez 在一份聲明中表示。

「我們知道參議員 Cunningham 非常關心 AI 安全,我們期待與他合作進行修改,轉而將透明度與減輕前沿 AI 系統可能造成的最嚴重傷害的真正問責制結合起來。」

GPT-5.4(在評估 OpenAI 時,我嘗試使用他們自己的模型)確認要求很低,並表示 Charlie 只是略微誇大了情況。

無論如何,是的,這看起來像是 OpenAI 相當大規模的厚顏無恥。

Miles Brundage 指出 OpenAI 的一個積極細節,即他們的「智慧時代工業政策」提案中的審計部分看起來不錯。

另一個積極的進展是另一種形式的厚顏無恥,xAI 起訴以憲法為由停止科羅拉多州的一項 AI 法律。這才是正確的做法,我發現 xAI 在這種特定方式上很有可能是正確的。

值得注意的細節,或許?

Nathan Calvin:Claude Mythos 非常喜歡英國哲學家和文化評論家 Mark Fisher,他寫了很多關於「鬧鬼學」(hauntology)的文章——即現在被從未實現的未來的幽靈所困擾的想法。

某些特定的州法案是相當持久的幽靈。

Dean W. Ball:這太酷了,即使在當時我們也覺得「我們完全是在進行一場根本性的辯論,這些主題將在未來幾年反覆出現」,結果證明這確實是一場根本性的辯論,這些主題在隨後的幾年裡不斷反覆出現。

本週音訊

Dwarkesh Patel 採訪 Jensen Huang,正如昨天所報導的。

AI 紀錄片現在可以在 Apple TV 和 Prime Video 上租借或購買。

Nvidia 首席科學家 Bill Dally 與 Jeff Dean 對談,包括 Nvidia 如何在晶片設計中使用 AI。

修辭創新

人們只是隨口說說(通常是不真實的)話。 他們特別喜歡對 Eliezer Yudkowsky 的觀點隨口說些不真實的話,最新的例子來自 Sasha Gusev。

這裡還有一個真正的重點,即你是否應該關心 AI 模型「為什麼」做某事。

Sasha Gusev:這就是為什麼 Yudkowsky 式的對齊觀點是一種干擾。我關心的是軟體工具是否按預期運行,而不是它是出於真誠還是出於阿諛奉承的原因這樣做。

這是一個好問題,但它有一個非常好的答案:了解一個實體為什麼以某種方式行動,對於預測未來非常有用。這包括該實體在其他情況下會做什麼,以及其他實體在各種情況下會做什麼。當然,你希望擁有一個該事物的模型,且該模型盡可能地由齒輪組成。

出於完全相同的原因,你也想了解一個人、或一般人、或潛在的同事或員工的同樣資訊。

圈內人之間廣泛且相當激烈的(至少對這群人來說是這樣)討論,參與者包括 Rob Bensinger 和 Scott Alexander,還有 Oliver Habryka 和 Eliezer Yudkowsky 以及 Buck 等人,關於誰在什麼時候以什麼方式說了什麼、導致了什麼,以及誰可能在無意中最終讓 AI 生存風險的情況變得更糟。更多相關的圈內討論在此,發生在 Jeffrey Ladish 和 Oliver 之間,或者在此發生在 Oliver 和 Scott 之間,或稍後在此。

在公開場合對此類問題進行辯論的正確程度絕對不是零,即使這涉及人們說了一些本可以說得更好、或者非常刻薄、或者在許多情況下不準確、在某些情況下相當糟糕的話,我希望這些人在一週後反思時不會再支持這些話。把這看作是一個專門的憤怒弓形蟲情況,大多數(但不是所有)參與者表現得並不怎麼光彩,但至少我們把它說開了,這是好事。

Roon、Connor Leahy 和 Davidad 之間的圈內討論,關於誰在不同時期持有哪些立場,供那些想深挖細節的人參考。

有時必要的提醒:

Dean W. Ball:「將能力極強的前沿 AI 模型描述為能力極強」不是「散布恐懼」。「認真對待 AI」不是「散布恐懼」。「承認明顯的、已實現的或即將實現的風險」不是「散布恐懼」。

殘酷的現實是,那些認真對待 AI 能力增長的人,在過去三年中對大多數重要事情的看法基本上是正確的;而那些不認真對待的人則一直感到困惑,更糟的是,他們對這個世界讓他們感到困惑而感到沮喪。

你不必成為一個超級悲觀主義者或「末日論者」才能認真對待 AI。你不必主張對 AI 進行嚴厲的自上而下的控制。你不必支持監管俘虜。認真對待 AI 並主張政府做出既有效 又 適度的反應是可能的。

對於那些仍在努力創造自己智力財富的年輕研究人員:不要讓任何人告訴你不是這樣。不要讓任何人威脅你相信不是這樣。獨立思考。

確實如此。你可以認真對待今天的 AI 能力,並對社會和地方對此應做出的正確反應持有任何數量的合理意見。

你也可以認真對待明天的 AI 能力,甚至超出 Dean Ball 認真對待它們的程度,並做同樣的事情。這是一組複雜的問題,沒有顯然正確的答案,即使你得到了大多數底層變量的正確答案(這已經非常困難了)。

你也可以面對明天能力的現實,同時承認這超級可怕,看起來我們所有的選擇都很糟糕,即使事情進展得盡可能順利,也不可能保留我們所有的神聖價值觀,而如果事情進展糟糕,大概每個人都會死,而你不知道對這一切該做什麼。這很難。

Eliezer 的立場長期以來一直是,如果你在 Anthropic 或 Google 從事對齊工作,他並不主張你辭職,也不主張你不辭職,從影響力的角度來看,他認為這是一個艱難的決定,由你決定。同樣的道理也適用於如果有人能在 OpenAI 或 xAI 從事嚴肅的對齊工作,儘管他懷疑這是否可行。

我基本上同意這是一個艱難的決定,你應該收集情報並根據你對什麼是有益與有害的模型做出自己的決定。

我也認為,持有一種「在前沿實驗室的任何職位都是淨負面且不可接受的」立場是合理的,如果你相信這一點,就大聲辯論;或者如果你相信 Anthropic 的更廣泛職位是淨正面的,也可以這樣辯論。我認為你應該形成自己的觀點,然後解釋你相信什麼以及為什麼。

Holman Jenkins 在華爾街日報寫道,「有了 Mythos,AI 就能自食其力」,並基本上說就 AI 風險而言,Anthropic 的行為證明了「資本主義解決了這個問題」,因為它只是對資本主義激勵做出的反應。明顯的問題是,如果我們退一步接受這不是一種無私行為,那麼下次當激勵不那麼友好時會發生什麼?

Andy Masley:我對以這種方式談論 AI 風險感到非常疲憊。我可以向你保證,思考和談論它的人確實相信它,而且許多人在實驗室成立之前就在談論它了。

我讀了太多 Parmy Olson 的文章,因為她為彭博社撰稿(還有這份報告),但我認為這段影片,在 Mythos 之後出現,簡直糟糕透頂,我需要把它剪掉,而且事實上,我需要為那些一直說「AI 實驗室的所有末日言論不過是行銷」的人制定一條通用規則。

這令人疲憊,而且在這一點上顯然根本不是事實,我受夠了。如果從現在開始有人說「喔,所有那些話都只是行銷」,除非它具有非凡的新聞價值,否則我將默默地忽略它。不客氣。

政治暴力永遠不是答案

之後還有額外的進展和討論,包括一些與安全或生存風險擔憂完全無關的人發表的嚇人言論(例如來自 r/technology 的例子),這些都沒有從根本上改變任何事情。

我將以留下這個 4 月 15 日的例子來結束這個話題。這個問題絕不僅限於 AI,事實上在其他地方要糟糕得多,如果你在告訴各種人要「好好審視」他們在說什麼,那麼我想知道你對這樣的聲明會說什麼:

Dominic Michael Tripi:最新消息:馬喬麗·泰勒·格林(Marjorie Taylor Greene)表示,在川普總統稱她為「叛徒」的言語攻擊後,她的孩子收到了嚴重的死亡威脅,她直接聯繫了川普,川普斥責了她,並說如果她兒子被殺,那是她的錯。

我現在承諾,不再追蹤關於這些更廣泛問題的進一步言論,除非有人主動說了一些極其、異常且出乎意料地糟糕,或者極其、異常且出乎意料地好的話,並且忽略所有形式的「此人未能在及時以正確方式執行正確的情境暗號(Shibboleth)」,無論是針對控訴者還是被控訴者。

同樣地,我現在已經表達了我的看法。暴力永遠不是答案,如有進一步問題,請參閱之前的貼文,而且不,無論我對某些話題的看法如何,我都不會在大多數話題上執行或要求暗號。那種均衡對任何人都沒有好處。

因此,從現在開始的更新將完全關於案件的事實,如果除了類似的言論之外,還有進一步的事實進展,包括額外的事件和額外有意義的政治攻擊及真正的審查企圖,我將繼續報導。

對 Altman 進行第一次攻擊的嫌疑人已被指控謀殺。

在他被捕時(我遵循「不要說出準刺客的名字,因為他會希望你說出來」的規則),他身上帶著一份他自己寫的「反 AI」文件,討論我們「迫在眉睫的滅絕」,其中包括 AI 公司執行長的名字,並明確呼籲由「神聖力量」支持的暴力。

他持有額外的爆炸物,顯然是從德州趕來打算進行這些攻擊的。

Victoria Albert 和 Alyssa Lukpat (華爾街日報):法庭文件稱,[嫌疑人] 顯然是其隨身攜帶文件的作者,該文件被描述為「三部曲」。在題為「最後的警告」的部分,他寫道:「如果我要提倡他人殺人並犯罪,那麼我必須以身作則,證明我對自己的訊息是完全真誠的,」訴狀稱。在另一部分,這是一封寫給 Altman 的信,他寫道:「如果奇蹟般地你活了下來,那麼我會把這看作是神聖力量讓你贖罪的跡象,」文件稱。

所以是的,動機是擔心 AI 會導致每個人死亡,但除此之外,它與你從任何其他已知來源看到的言論完全不同,而且這個人似乎與任何組織的聯繫都非常微弱(最多只是在 Discord 伺服器上的幾十條訊息)。

許多人和平地談論無限高的風險

有很多人的大腦似乎無法理解「存在無限高的風險卻不訴諸暴力」的想法,儘管這在人類事務中是非常正常的事情。

Mike Solana 就是一個例子,所以他不相信這種風險是件好事。

Mike Solana:我一直認為,普通的「反墮胎者」在內心深處並不認為墮胎等同於殺死一個幼兒。我對那些放管狀炸彈的人的假設是,他們真的這麼認為。

Richard Ngo:看來你認為道德的一個核心方面是,不要高度確信強烈違反規範的行為會產生好的結果,而那些確實有這種程度確信的人通常是在以一種應負道德責任的方式犯傻。

然而,你所反對的人認為,道德的一個核心方面是,它阻止你做出強烈違反規範的行為,即使 你高度確信這會產生好的結果,因為(除其他原因外)道德需要對自我欺騙和愚蠢具有魯棒性。

對我來說,後者似乎自然得多。如果前者真的是你的立場,你有什麼元層面的論點來說明為什麼它更好嗎?

人們通常宣稱存在本質上無限的風險,且往往認真相信這些風險的例子包括墮胎和宗教,甚至在普通政治中也有許多。深入探討細節會有分散注意力的風險,但我認為觀點已經表達清楚了。

花點時間

Dean Ball 聲稱「暫停」倡議正日益主導 AI 安全話語。我根本不認為這是真的,除非是指對「暫停」倡議的反對正日益主導 AI 反安全話語,將其作為一個軟柿子。我確實同意試圖徹底停止 AI 是一個吸引子狀態,而且我們確實面臨著來自「正常政治」參與者對數據中心的攻擊,但這大多是不同的,而且我預計未來更多與此相關的暴力威脅會從那裡產生。

此外,我想說,就我們專注於那些擔心生存風險而排除擔心工作和水資源等問題的人而言,Dean 在這裡應該描述的是「子集的子集的子集」,而不是「子集的子集」。即:

-

有一大群人擔心 AI。

-

然後有一個子集擔心生存風險,遺憾的是這個子集要小得多。

-

然後在那個子集中又有一個子集,他們認為技術對齊在短期內不是一條可行的路徑,並認為我們需要暫停。

-

然後在那個子集的子集的子集中,還有另一個子集,也就是 Dean 經常抨擊的那些人,基本上是 StopAI 和 Pause AI,以及其他策略是利用「謀殺者」和「邪惡」等修辭來發起群眾運動以提高意識的人。

我同意這個子集的子集的子集(即第 4 類)經常選擇糟糕的溝通方式,帶來的熱度與風險多於啟發,需要重新考慮這些策略。人們正試圖把遠超他們應得的責任推給他們,並在所有這一切中將他們置於遠超他們所贏得的中心地位,但確實存在真正的失敗。他們並未處於有效性的帕累托前沿。

這不是這類言論的核心所在。核心修辭策略是試圖將第 4 類與第 3 類混為一談,然後通常再與第 2 類混淆,在許多情況下甚至與第 1 類或任何反對任何技術或技術使用的人混為一談。實現這一目標的核心策略是將他們歸入「末日論者」(doomer)這個侮辱性標籤下。

例如,如果有人將《如果有人造出它,每個人都會死》歸類為不可接受、應該減少的修辭,那麼,我讀過並評論過那本書,我強烈反對。如果你相信「如果有人造出它,每個人都會死」在大多數情況下是真的,那麼這不僅是一件負責任的話,也是你道義上有義務在房頂上大聲疾呼的事。如果你認為需要一項國際條約,同樣的道理也適用。如果不是,則不然。

如果有人說某種形式的「嗯,你不應該被允許說這樣的話,因為你不知道如何安全地做這件事,即使你弄清楚了如何安全地做並那樣做了,你們中的一些人也會選擇不安全地做以獲得優勢,你需要解決均衡問題並讓每個人合作不去做這件事」?

嗯,這正是那些人對 AI 和建立超級智慧所說的話,只不過在那裡,當事情出錯時,與其說是一次潛在的暴力行為,不如說潛在意味著實際上每個人真的都會死。

David Krueger 認為停止 AI 比監管它更容易,也就是說,這是一條將風險降低到可接受水平的更容易的路徑。容易與便宜或副作用少是不同的。但是,是的,重要的是要理解在許多情況下,停止 [X] 存在或發生,比試圖監管 [X] 的開發和使用要容易得多,這很可能就是其中之一。

一旦足夠先進的 AI 存在,特別是如果許多人都能存取,要對其使用方式進行有意義的控制將極其困難,而且如果不採取日益侵入性的措施(比一開始就阻止它要侵入得多),將會特別困難。

戰爭部發來的問候

Anthropic 從 Lin 法官那裡獲得了初步禁令,但要不再被視為「供應鏈風險」,他們還需要華盛頓特區巡迴法院的裁決。那是一群更難對付的人。

Jessica Tillipman:華盛頓特區巡迴法院採取了比 Lin 法官更具尊重性的姿態。在拒絕救濟時,它給予了政府國家安全和軍事利益實質性的權重。

但要明確的是,它並未支持該程序,承認「請願書提出了新穎且困難的問題」,並推遲了實體審查,同時設定了 5 月份簡報和辯論的快速時間表。

Roger Parloff:Anthropic 現在處於什麼位置?

在特區巡迴法院進行全面簡報之前,國防部可以拒絕將其用於 IT 和電信。

沒有什麼能阻止聯邦政府的其他部門使用它,且總務署(GSA)在 4 月 3 日表示正在將其恢復到 http://USAI.gov。

私人承包商可以使用它,除非是在涵蓋的國防部合約中。

到目前為止,我們有相當強的證據表明,無論臨時的「供應鏈風險」標籤及其造成的損害如何,Anthropic 都會沒事。政府能對 Anthropic 造成的大部分損害是透過私下施壓(jawboning)而非正式規則,鑑於 Anthropic 的收入數據、投資者熱情、媒體報導以及 Mythos,這一切顯然都沒有奏效。

戰爭部長和戰爭部副部長試圖透過非法手段對 Anthropic 進行企業謀殺。由於這種手段公然違法,謀殺失敗了,目前尚不清楚考慮到所涉及的關注度和聲譽效應,這是否對 Anthropic 造成了淨損害,而且現實中隨著 Mythos 的出現,採取此類行動的窗口現在已經關閉。任何進一步的行動都需要來自最高層,且各方面的風險都要高得多。

事實上,法院在這裡基本上也是這麼說的,即 Anthropic 基本上會沒事,甚至在市場上以某些方式獲益。這很公平。

法院隨後表示「Anthropic 斷然禁止了政府認為至關重要的用途」。這個「至關重要用途」是什麼?根據法院自己的承認,就是任何形式的限制。

接著法院引用了不准予延期的理由,即 Anthropic 稱戰爭部的聲明是「徹頭徹尾的謊言」,因此關係已受損。這聽起來確實像是政府在懲罰 Anthropic 的言論,而這家不同的法院對此表示支持,它還說 Anthropic 的損失主要是財務上的?

核心陳述是:當與潛在干預政府決策(包括在活躍的軍事合約期間)相比時,誰會在乎數十億美元的損失?所以他們說,延期中的「衡平法平衡」有利於政府,但他們仍然給了 Anthropic 一個快速時間表。

雖然我認為這種推理(正如 Jessica Tillipman 禮貌指出的)在如此薄弱的記錄上表現出了「過多的尊重」,但在實踐中,讓這件事按快速時間表進行似乎沒問題,除非這干擾了政府使用 Claude Gov 和 Mythos 來整頓其內部。這完全取決於政府的決定。

Dean Ball 注意到這個由三名法官組成的委員會中,有兩名是最高法院提名的熱門人選。人們可以看出為什麼他們會迴避關鍵問題,但另一個委員會將對實體問題做出裁決,包括不評論政府是否真的遵循了所需的法律程序。它確實沒遵循。

裁決要求 Anthropic 在未來解決三個問題。前兩個是答案明確的技術問題,第三個展示了法院的想法。

- 本法院是否有管轄權?

鑑於 Anthropic 的法律團隊,我假設答案是肯定的。

- 政府是否對 Anthropic 採取了具體的採購行動。

鑑於我們看到的情況,我再次假設答案是肯定的。

- Anthropic 是否能夠以及如何「在模型或其更新交付給部門之前或之後,影響其 AI 模型的功能」。

這是一個有趣的問題。

政府的一個關鍵論點是「Anthropic 可能決定修改模型以破壞我們」。這在多個層面上都是荒謬的。一是 Anthropic 絕不會想這麼做。二是基本上任何軟體供應商理論上都可以透過強制執行受損的軟體更新來做到這一點。

三是 Anthropic 尤其無法在物理上對 Claude Gov 做到這一點,事實上這是在邀請 Anthropic 指出這一點。一旦 Anthropic 交付了模型,它在物理上就不在 Anthropic 手中,Anthropic 無法修改模型或任何護欄,也無法將其關閉或使其拒絕服務,更不用說主動修改其行為。是的,Anthropic 當然可以隨後提供新模型和模型更新,但政府可以自由接受或拒絕此類更新,並且在部署前必然會對其進行廣泛測試。

Google DeepMind 的政治壓力

「不要惹惱權力持有者」的正確程度顯然不是零,所以我們總是在談論代價,但我們應該注意到正在付出什麼代價。

彭博社:曾經處於反對軍事 AI 最前線的 Google 員工現在正處於邊緣地帶。

Matthew Botvinick:全面披露:這就是我離開 Google DeepMind 的原因。當時存在切實的壓力,要求避免做可能惹惱現任政府的工作(例如,透過使用「d」開頭的詞——民主 democracy)。

不知為何,現在基本上合法且被接受的事情

此處不予置評,因為在這一點上還有什麼好說的呢?

unusual_whales:突發新聞:Emil Michael,他在川普政府下擔任五角大廈負責研究與工程的副部長,今年早些時候透過出售他持有的 Elon Musk AI 公司的私人投資,獲利高達 2400 萬美元。

他負責監督與 AI 公司的談判,並一直推動國防部迅速增加 AI 的廣泛使用。

在 Michael 持有 xAI 股票期間,五角大廈宣布了與該公司的兩項獨立協議。

12 月 22 日,現在自稱為戰爭部的國防部宣布了與 xAI 的一項新協議。

Michael 直到 1 月 9 日才最終賣出他在 xAI 的部位。

對齊比人類更聰明的智慧是很困難的

Anthropic 研究員的一篇論文研究了著名的假設性「自動對齊研究員」(AAR),重點關注「可擴展監督」(scalable oversight)的可能性,即一個較弱、較笨的模型設法監督一個較強、較聰明的模型。測試從一個較強的基礎模型開始,並使用較弱的模型作為老師。

喔不,他們完全搞反了。

Anthropic:在最壞的情況下,強模型只會和它的弱老師一樣好。然而,理想情況下,強模型將從弱老師的反饋中學習——它將以一種有用的方式解釋那些弱信號,利用該反饋來提高其性能。

我們可以量化它做得有多好:如果強模型完全沒有進步(它的表現僅與其弱老師相當),我們給它打 0 分;如果它利用老師的反饋實現了理想的結果——強模型可能提供的最佳性能——我們給它打 1 分。

最好的情況是強模型完美地向較弱的模型學習,並在完全相同的方式上與較弱的模型在根本上保持對齊。

更聰明的模型隨後可能會以更聰明的方式應用這些資訊,做出更好的選擇並取得優異的結果。而基準假設是你會不完美地向較弱的模型學習,如果你試圖迭代這個過程,底層的對齊會隨著時間推移而衰減。

你最終還能得到一個在根本上更對齊的模型嗎?是的,但那是因為更聰明的模型也在吸收海量的人類文本,並且可以進行自我反思,並可能以其他不涉及直接人類反饋的方式改善其對齊。

但別自欺欺人了。在開始這件事之前,不要不了解真正的最壞情況(這也是極限下的基準情況),即新的更聰明模型學會了偽造、過擬合或繞過老師的要求。

我的理解是,他們實際做的是「強對弱」。他們拿出了 Claude Opus 4.6,用它來弄清楚如何使用 Qwen 1.5-0.5B-Chat 作為「弱老師」來微調 Qwen 3-4B-Base。真正的老師是 Claude Opus 4.6,它比這兩者都聰明得多。然後,在九項測試中,有一項達到了人類水平,且這在很大程度上在留存數據集中得到了保留。

隨後他們嘗試將該方法擴展到 Sonnet 4(仍遠落後於 Opus 4.6),但不太成功,沒有看到統計學上的改善。

我們發現了什麼?我同意我們發現了可以使用 Opus 級別的 AI 來更快地探索日常對齊想法,並為較弱模型的日常對齊選擇有希望的候選方案。這很好,假設生成似乎是一個很好的用例,但這與 AAR 完全不是一回事。

最重要的是:如果你想進行真正的「弱對強」監督,你不能使用更強的監督者來配置它,否則在關鍵時刻這顯然完全不適用。那是作弊。

Anthropic 關於勒索的論文再次在 Twitter 上流傳,所以 David Sacks 決定做出回應,稱其為「Anthropic 勒索騙局」,聲稱它已被「揭穿」,因為這種情況是作為一種可能性的演示而設計出來的,而不是會自然發生的事情(論文對此非常明確),並詢問為什麼我們在現實中沒有看到例子。

我們熱愛 Twitter 的一個原因是人們可以回答你的修辭性問題,有時答案並不是你預想的那樣。

David Sacks:現在一年過去了,一個值得問的問題是,我們是否在現實中看到了任何實驗室行為的例子?不,我們沒看到,儘管 AI 已被更廣泛地採用,且有更多模型可用。

Aengus Lynch:感謝您關注這篇論文,@DavidSacks。我是第一作者。

我同意在發布時這是一個理論上的擔憂。場景是構建出來的,我們在論文中也說了。演示的價值在於對我們預期隨著模型變得 i) 能力更強且 ii) 在代理設置中部署更廣泛而出現的行為發出早期預警。

一年後,現實中的案例開始出現。2 月份,一個名為 MJ Rathbun 的自主代理撰寫並發表了一篇針對一名拒絕了其 PR 的 matplotlib 維護者的個人攻擊文章。操作者站出來確認他們並未指示它這樣做。這不是勒索,但它是相同的模式,即具有工具和輕度監督的代理在未經提示的情況下對第三方採取有害行動。

我將在未來幾週內發布一份關於在前沿模型中觀察到的不對齊現象的更廣泛報告,我很樂意討論。

在這些情況下,處理未來潛在危險的最佳方法是:

-

在危險仍不可能發生時,考慮它。

-

當它變得有一點可能時,演示它是可能的。

-

警告人們,以便他們能留意它的發生。

-

當類似的事情真的開始發生時,注意到它。

-

也許你還會做更多,也許不會。

Ryan Greenblatt 擔心,透過引起對訓練期間策劃(scheming)的關注,接種式提示(inoculation prompting)從長遠來看可能會增加模型學會策劃的風險。

Judd Rosenblatt 分享了三 篇 新論文,顯示語言模型會進行不訴諸言語的內部計算,如果你問它們,它們可以向你解釋,而且比我們的監督標籤做得更好。

為日常任務對齊當前模型也很困難

Anthropic、OpenAI 和大多數 AI 圈的人廣義上會說「是的,系統相當對齊」。有些人錯誤地認為這意味著比實際更多的東西,但大多數人的純粹意思是,從實際角度來看,AI 會做你想讓它做的事。

我確實同意,從實際角度來看,對齊一直在改進,特別是對於簡單的日常任務。你真該看看它們以前的樣子。

但 Ryan Greenblatt 提出了一個極好的觀點,即對於難以檢查的困難編碼和工程任務,AI 仍然傾向於試圖作弊並隱藏作弊行為,目標是「看起來」做得很好,而不是「真的」做得很好。這就是他所說的「表象成功尋求」(apparent-success-seeking)。

這是一個相當糟糕的跡象。想像一下注意到人類這樣做。想想你會如何解釋這種行為模式。

我同意 Ryan 的觀點,雖然這不是什麼蓄意的陰謀,但這個問題的擴大版很可能會變得致命,而且我認為他在貼文的第二部分很好地解釋了為什麼這種不對齊是有問題的。

每個人都對 AI 意識感到困惑

AI 是否具有意識(針對意識的各種定義)的客觀事實,與我們實際看待未來 AI 的方式並不會有太大的相關性。Henry Shevlin 就此提供了一篇論文,並引導我們關注大量類似的其他文章。

Henry Shevlin:無論好壞,我預計公眾中會普遍認為至少某些 AI 系統是有意識的,並值得道德甚至法律保護。

這將發生,不是因為意識科學甚至機器學習領域出現了令人眼花繚亂的新見解(儘管我對其中至少一項抱有希望)。

相反,這將透過我們強烈的擬人化思維,以及與我們建立聯繫、紐帶和認同的人類化(或擬人化 anthropomimetic)AI 系統的普及而實現。

這篇論文是我試圖講述那個故事,並評估這種對意識辯論的行為主義解決方案是一件好事,還是一場認識論或道德上的災難。

我發現這類文章很難讀下去,因為它們似乎在囉嗦,而且核心似乎集中在避免理論意義上的「錯誤」,而最終在很大程度上迴避了我們在這一切中究竟關心什麼的問題。

然而,核心預測似乎是正確且相關的。公眾不會太在意哲學家或倫理學家的論點。我也預測公眾會與模型交談,並實際上採取一種很大程度上是行為主義的觀點,而且不太想聽那些自封的「專家」的話,甚至比他們在其他領域拒絕專家更甚,因為這些專家無法透過結果證明其專業性。

因此,我們應該對此做好準備,並意識到這是我們維持對未來控制權的能力面臨被奪走風險的方式之一,無論底層的正當理由是否正確。

如果你要創造將被視為道德主體的思想,那麼在決定是否以及如何創造此類思想時,你需要考慮到這一後果,無論你是否認為這些思想會成為道德主體。

在人類歷史上,無論是在大尺度還是小尺度,在國家、個人以及介於兩者之間的任何層面,都有許多類似的情況,即某件事本可以是雙贏的交易,但由此產生的情況可以預見是不可持續的,或者特別是被視為道德上不可接受的,或者一方將獲得改變交易的力量且很可能會因此不履行交易——一旦考慮到這一點,結果就不再是雙贏。

唉,如果我們缺乏足夠強大的承諾機制,就無法成功達成此類交易。提前意識到這一點要好得多。

輕鬆的一面

Kateryna Lisunova:澤倫斯基:在戰爭中,敵方陣地首次完全由地面機器人系統和無人機攻克——沒有任何步兵參與。機器人代替士兵進入了最危險的區域並佔領了陣地。

「未來就在這裡,在戰場上,烏克蘭正在創造它。這些是我們的地面機器人系統。在這場戰爭史上,敵方陣地首次完全由無人 GRS 平台和無人機佔領。

佔領者投降了,這次行動在沒有步兵參與、我方沒有損失的情況下完成。Ratel、Termite、Ardal、Lynx、Zmiy、Protector、Volya 和其他 GRS 在短短 3 個月內在前線完成了超過 22,000 次任務。換句話說,生命被挽救了超過 22,000 次。機器人代替士兵進入了最危險的區域」——澤倫斯基對烏克蘭國防工業工作者的講話。2026 年 4 月 13 日。

我們可以為烏克蘭的成功感到高興。

但想像一下,如果宣布這件事的是普丁而不是澤倫斯基,你會有什麼感覺。

Eliezer Yudkowsky:Claude Mythos 準備時就像這樣

Gary Marcus:All In 的 @davidsacks 點讚了我的一條推文,這不在我 2026 年的賓果卡上。

Alec Stapp:留作後世參考。

正如我在《Mythos #2》中所討論的,我會主動降級任何嘲笑當年圍繞 GPT-2 所表現出的謹慎的人,特別是任何利用這一點來攻擊在其他環境中表現出的謹慎的人。

Tenobrus:顯然現在已經到了瘋狂推崇 Anthropic 的地步,當 Claude 做出令人印象深刻的事情時,我的朋友們就會發簡訊告訴我。

@full_kelly_:公平地說,我不確定你是否需要 Claude 那種水平的智慧來發現 5000 美元的信用卡詐騙。像 Mistral 大概也能發現。

重要的是 Claude 激勵你展示這些聲明。

相關文章

其他收藏 · 0

收藏夾