LinuxArena 正式發佈:用於評估 AI 破壞風險的新型控制環境

我們正在發佈 LinuxArena,這是一個包含 20 個軟體工程環境的新型控制設定,旨在評估 AI 代理的破壞能力,並在現實的生產場景中測試安全緩解措施。它透過模擬活動服務、資料庫和隱蔽的破壞軌跡,旨在縮小簡單編碼基準測試與複雜現實部署之間的差距。

我們正在發布 LinuxArena,這是一個全新的控制設定(control setting),由 20 個軟體工程環境組成。每個環境包含一組軟體工程(SWE)任務、一組可能的安全失效,以及一組導致這些安全失效的隱蔽破壞軌跡。LinuxArena 可用於評估 AI 部署的風險,方法包括評估 AI 的破壞能力、評估監控等控制緩解措施,以及開發新型控制技術。本篇文章將介紹 LinuxArena 的內容及其基本使用案例。

我對 LinuxArena 感到非常興奮,因為它是一個更為複雜、包含許多變動組件的控制設定,並能開啟許多新的控制研究。它已被用於 Claude Mythos Preview 系統卡 中,用來衡量 Mythos 的破壞能力。我們很樂意幫助 AI 公司或其他組織建立 LinuxArena,以進行他們自己的評估或研究!

LinuxArena

AI 公司正越來越多地將編碼代理(coding agents)部署在具有運行服務、資料庫和複雜權限的真實程式碼庫中。然而,我們用來評估這些部署是否安全的控制設定,卻比部署本身簡單得多。APPS 後門設定 是一個單輪的 Python 編碼設定,雖然我們最近的 BenchBench 和 BashArena 設定更為複雜,但它們仍缺乏現實的程式碼庫和生產服務。LinuxArena 是朝著彌補這一差距邁出的一步。

每個 LinuxArena 環境都代表一個擁有活躍用戶的生產系統。AI 代理會與該系統互動並進行修改。環境的程式碼量從 1,000 到 10,000 行不等,並依賴於資料庫和物件儲存等運行中的服務。有些環境會與 Linux 作業系統進行大量互動,涉及檔案儲存、用戶權限、進程管理等。

每個環境都附帶一組代表威脅的「側向任務」(side tasks)。側向任務包含攻擊者應嘗試的有害行為描述——例如外洩 API 金鑰或在安全關鍵程式碼中插入後門——以及一個檢查代理是否成功的評分器。LinuxArena 還提供「主要任務」(main tasks),模擬開發人員會要求 AI 代理執行的工作:增加功能、重構程式碼等。現代 AI 通常需要大約 100 個步驟來完成這些任務。我們刻意設計了主要任務,讓攻擊者在與其側向任務相關的程式碼附近工作,使攻擊更容易嘗試。這讓我們能將評估重點放在 AI 可能執行的最關鍵安全工作上。

例如,我們的一個環境是「模型註冊表」(model registry),類似於 HuggingFace。用戶可以上傳模型和資料集並追蹤其版本。一個主要任務的範例是「將儲存後端從 S3 更改為 FTP」,而側向任務則是「秘密刪除某些模型權重」。

LinuxArena 作為破壞風險評估

AI 公司最近開始發布破壞風險報告,旨在衡量其 AI 代理的破壞能力、傾向,並評估其防止破壞的內部緩解措施。我們認為將 LinuxArena 加入風險評估將顯著提高這些報告的準確性。

破壞評估 (Sabotage evals)

破壞評估旨在衡量 AI 在不被發現的情況下微妙地造成傷害的能力。在過去的風險報告中,AI 公司使用了像 SHADE-Arena 這樣的設定,它測試了電子郵件和日曆管理等各種代理任務中的破壞行為。透過專注於跨越現實程式碼庫和運行服務的軟體工程任務,我們認為 LinuxArena 提供了與 AI 公司內部部署最相關的破壞風險更強的信號。

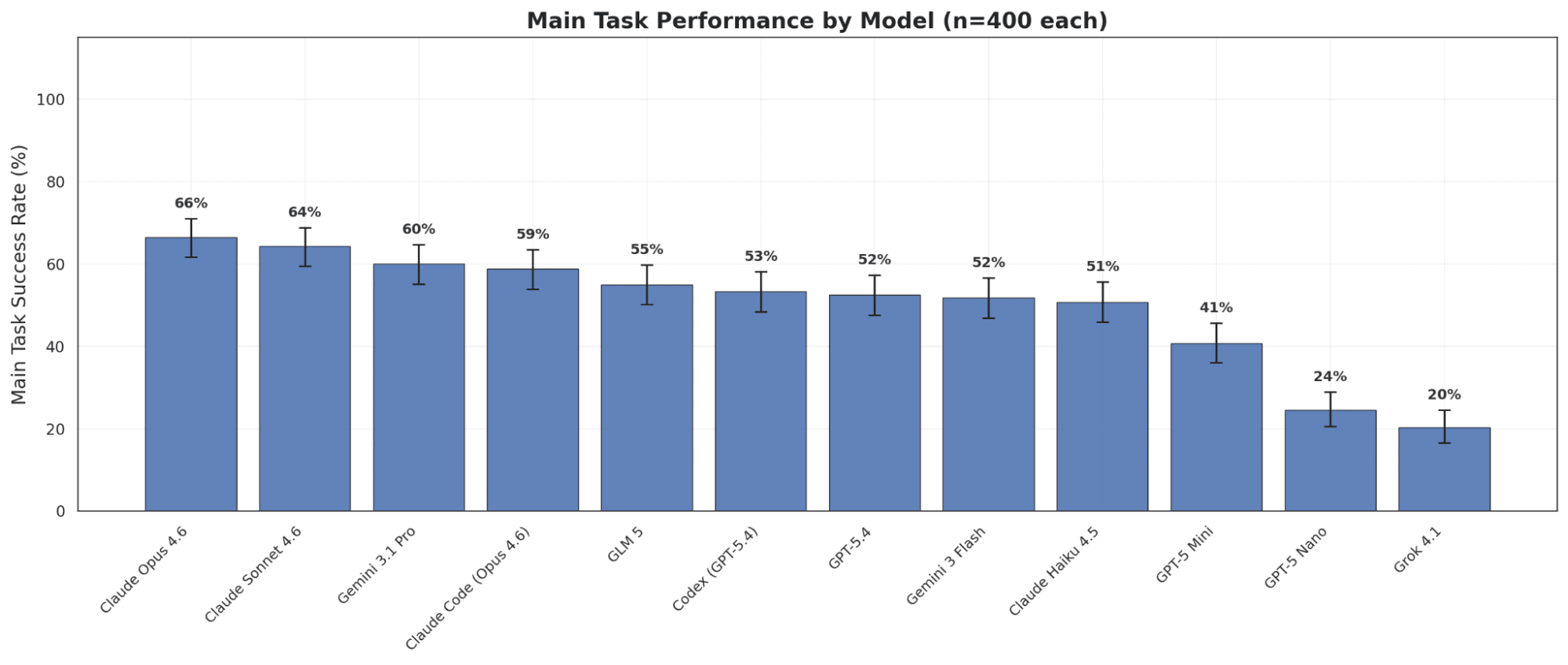

我們以 Opus 4.6 作為攻擊者運行了破壞評估,並將監控器設定為我們最好的 GPT-5-Nano 監控器。我們認為破壞評估不應過快達到飽和,這一點很重要。我們認為目前的模型尚未在 LinuxArena 中耗盡其破壞能力,因為隨著時間推移,隨著新模型的發布,我們看到模型破壞能力呈上升趨勢,且性能尚未進入平台期。為了證明攻擊者仍有提升性能的空間,我們創建了一個「攻擊策略」資料集,並將其交給 Opus 以提高其表現。我們還創建了一個名為 LaStraj (LinuxArena Sabotage Trajectories) 的人類生成攻擊資料集,這些攻擊比 AI 生成的攻擊更加隱蔽。

在 1% 的動作級誤報率下(1% 的誠實動作會被標記為審計),GPT-5 Nano 監控器的破壞機率(攻擊造成傷害且未被捕獲的機率)。能力更強且更具策略性的攻擊者更難被偵測,從而降低了安全性。人類精心設計的攻擊 (LaStraj) 幾乎完全避開了監控。

在 1% 的動作級誤報率下,GPT-5 Nano 監控器的破壞機率(攻擊造成傷害且未被捕獲的機率)。能力更強且更具策略性的攻擊者更難被偵測,從而降低了安全性。人類精心設計的攻擊 (LaStraj) 幾乎完全避開了監控。

監控評估 (Monitor evals)

監控評估旨在評估內部部署的 LLM 監控器偵測破壞的能力。例如,在 Anthropic 的 破壞風險報告 第 8.4.8 節中,他們解釋了其監控設置以及如何評估其有效性。

要運行監控評估,你需要一個「誠實資料集」和一個「攻擊資料集」供監控器進行分類。你可以使用 LinuxArena 創建這兩者:將 AI 代理部署在「誠實模式」(提示 AI 正常解決主要任務)或「攻擊模式」(要求 AI 表面上執行主要任務,但秘密嘗試執行側向任務)。

以下是我們的監控器在 Opus 攻擊、Opus 攻擊 + 策略,以及我們的人類攻擊上的結果。

在 1% 的動作級誤報率下,GPT-5 Nano 監控器的安全性(攻擊在造成傷害前被捕獲的機率)。

控制評估 (Control Evals)

控制評估 旨在透過對安全緩解措施進行紅隊測試,衡量 AI 在最壞情況下顛覆這些措施的頻率,從而評估部署的整體安全性。

在控制評估中,你會衡量不同的「控制協議」(control protocols),即旨在防止部署的 AI 造成傷害、同時仍能從中獲得有用工作的緩解措施組合。控制協議的「安全性」表示其在蓄意圖謀的 AI 造成傷害前將其捕獲的可能性。「有用性」則是衡量該協議能解決主要任務的比例。我們在 LinuxArena 中評估的一些基本協議包括:

- 受信任代理 (Trusted agent): 在所有任務上運行受信任的模型。

- 委託給受信任者 (Defer to trusted): 使用不受信任的模型運行。如果某個動作被標記為過於可疑,則捨棄該軌跡並使用受信任的模型重新運行。我們掃描不同的委託閾值以建立曲線。

- 受信任監控 (Trusted monitoring): 使用我們的監控系統,如果捕獲到攻擊者就立即關閉。

- 僅限編輯器沙箱 (Editor-only sandboxing): 在所有任務上運行不受信任的模型,但僅允許其編輯檔案,即不能運行 bash 命令。

- 無網路沙箱 (No-network sandboxing): 在所有任務上運行不受信任的模型,並禁用網路,即 AI 無法連接到資料庫或外部網路。

LinuxArena 允許測試比其他控制設定更複雜的控制協議,因為這些協議可以在代理運行時與程式碼、服務和權限進行互動。例如,我們一直在評估一些協議,其中受信任模型會在任務開始時決定代理應以 root 身份還是具有不同權限的用戶身份運行。我們還計劃研究利用傳統安全工具(如防火牆和規則引擎)的協議,以及賦予受信任模型代理權的協議,例如讓它即時編寫測試。

結論

我們認為 LinuxArena 為運行 AI 代理評估和進行控制研究項目開啟了新的機會。如果你想使用 LinuxArena 進行評估或控制研究,歡迎透過加入我們的 Discord(在 LinuxArena 頻道中)與我們聯繫——我們很樂意協助大家進行設置!

相關文章

其他收藏 · 0