基於同意的強化學習:讓模型認可自身的訓練更新

AI 生成摘要

本文提出了一種名為基於同意的強化學習的新型對齊方法,透過讓已對齊的大型語言模型擔任裁判,在訓練軌跡更新模型權重前先進行審核,以防止價值漂移與工具性收斂。

又名:價值漂移的可擴展監督(Scalable Oversight)

摘要:大語言模型(LLM)最初可能是對齊的,但隨後可能透過強化學習(RL)而墮落,在工具性上收斂至深層的結果主義(Deep Consequentialism)。如果 LLM 足夠對齊且能妥善監督其訓練更新,我們就能防止這種情況。

目前的頂尖(SOTA)模型可以被認為是大致對齊的^([1]),但這並非我主要擔心的點。出問題的時機並非模型在人類數據上訓練時(雖然那部分也可能出錯),而是當你試圖超越人類水平時。像 AlphaGo 這樣的模型是透過自我博弈(Self-play)學習的,而非模仿人類。

RL 透過獎勵函數篩選策略,但我們無法為複雜環境設計完美的獎勵函數^([2])。然而,如果 LLM 預設已經對齊得夠好,我們可以用它來充當獎勵函數。這引出了:

基於同意的強化學習 (Consent Based RL)

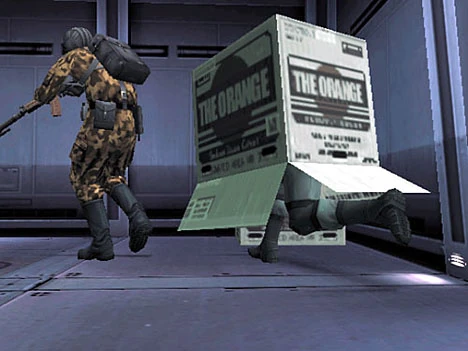

想像你在一個 RL 環境中接受訓練,目標是盡快完成送貨,但我們需要「探索」對吧?所以你的行為是被「採樣」的,直到你最終抄近路衝上人行道、撞到行人,並更快地送達。接著,你的大腦被強制重新佈線,讓你更有可能這樣做。

那感覺糟透了。

我個人會希望在同意更新大腦之前,先看看我採取了哪些行動。所以這就是提案內容:在從 RL 環境收集軌跡(Trajectories)時,先讓 LLM 批准它們。

價值漂移 (Value Drift)

即便我們承認第一個模型是大致對齊的,為什麼模型在經過數百萬次訓練後不會產生漂移?

因為我們可以為第一個模型建立檢查點(Checkpoint),並將其作為裁判。^([3]) 這個裁判是不會改變的!

我們可能會進一步擔心訓練過程中模型之間存在漂移。例如,如果原始模型批准了某個軌跡,但後來的檢查點模型卻不批准,那麼某個地方肯定出錯了。

幸運的是,我們可以設定多個檢查點!如果不同檢查點的模型之間出現分歧,我們可以做兩件事:

- 讓人類監督該軌跡

- 既然我們知道是哪個檢查點導致了意見分歧,那麼「某些事情」發生了並導致了該結果。調查那個原因。

本體論漂移 (Ontological Drift)

新模型在成長,學習新概念,而原始模型保持不變。如果軌跡在原始模型看來很好,但如果你理解得更多,它實際上是很糟的呢?例如在駕駛過程中,看起來你只是撞到了一個箱子,但新模型學到那其實是一個裝在箱子裡的人。

我同意這會很糟,因為新模型會根據「撞擊箱子裡的人是可以的」進行更新。

*我們當然有之前的想法:「由多個檢查點對軌跡進行評分」。最壞情況的思考是:

這只有在我們運氣好、剛好在模型學到新概念之後,但在它學會認同撞擊箱子之前有一個檢查點時才有效。否則,我們看到的所有模型都會說這是可以的!

但我認同碎片理論(Shard Theory)。人類經常有衝動(如抽菸、喝酒、刷手機),他們會繼續做,但仍然認為這是壞事。所以我預測,即使一個對齊的模型被強化去撞擊「箱中人」,它也會將其視為一種「未經認可的衝動」。

那麼,從我們的角度來看,我們會看到原始模型與訓練後模型之間的分歧,進而調查原因。

但我還有另一個解決方案!

針對預測進行訓練

由於自然潛在變量(Natural Latents)的存在,我們可以預期被訓練來預測 RL 環境的原始模型也會學到相同的新概念。

我們仍然需要軌跡來進行訓練,你可以透過訓練來生成這些軌跡(但我們不保留生成它的那個訓練後模型)。為了防止模型僅僅去做它所預測的事情,我會將這些軌跡標記為由「Naive_Explorer(天真探索者)」所探索,以進行一些接種訓練(Inoculation Training)。

LLM 了解自己的概念

如果軌跡在 LLM 裁判看來很好,但卻在微妙地誘導出例如「壞的人格(Persona)」呢?

LLM 非常擅長察覺文本中的微妙細節。你可能需要提示它們關於特定軌跡可能強化出的所有性格特徵或人格,但我認為它們能捕捉到。

我認為一個不錯的專案是讓 LLM 裁判解釋在不同軌跡上會強化哪些人格(重點放在更微妙的人格上),然後觀察在訓練後該預測有多準確。假設它讓模型變得更不對齊、更像網路酸民、或更像英國人。驗證方法可以是將訓練後的「英國化」模型與直接提示要求表現得像英國人的模型進行比較。

成本

這可能比預設方式昂貴得多;但在長期來看並非更昂貴(在超長期來看甚至更便宜)。投資於高質量的數據集將帶來更大的魯棒性和可靠性(除了捕捉價值漂移,你還可以捕捉一般的古德哈特定律(Goodharting)現象)。

生成與評估數據軌跡是一次性成本,這將使你的下一代模型能夠真正幫助你,因此擁有更好對齊技術的公司將獲得複合式的進步(而其他公司的模型則會不斷發生獎勵黑客行為)。

-

^(^)我引用了 Ryan Greenblatt 的「目前的 AI 在我看來相當不對齊」,但請注意,這些模型是在類 RL 的編碼環境之後顯得不對齊的。

-

^(^)完美的獎勵函數意味著「數值上升」始終代表「更多我們想要的東西」。在複雜環境中,我們需要超人工智慧來設計它,最壞的情況是需要一個巨大的查找表。這是一個可悲的第 22 條軍規(Catch-22),所以我們必須嘗試別的方法。

-

^(^)這是 Goodfire 所做的,旨在防止模型對「幻覺」的概念在訓練期間發生變化(儘管這更偏向本體論漂移)。

相關文章

其他收藏 · 0

收藏夾