應否降低具備負淨破壞價值的潛在威脅的重要性?

我認為我們應該根據淨破壞價值來優先處理 AI 漏洞,並調低那些策略性圖謀 AI 可能會避開的威脅權重,因為被發現的風險超過了潛在收益。這種觀點顯示,在應對具備能力且有目標導向的 AI 代理時,傳統的風險評估方法可能會產生誤導。

這是我個人的觀點。感謝 Ryan Greenblatt、Holden Karnofsky 和 Peter Wildeford 提供的有益討論。錯誤的觀點由我本人負責。

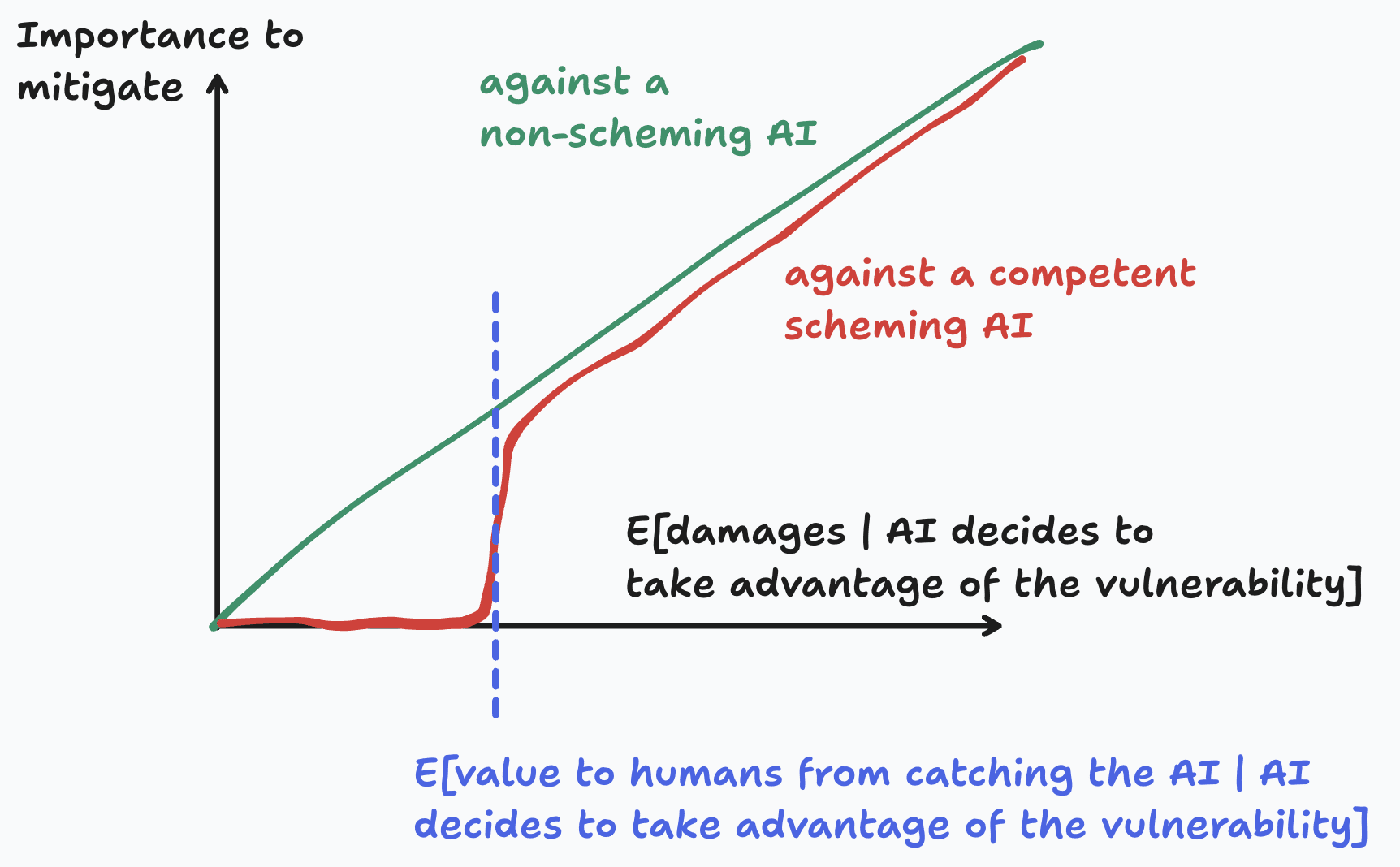

在決定要花多少資源來緩解一個「有能力的策劃型 AI」(competent scheming AI)可能利用的漏洞時,你可能會傾向於使用「期望損害 | AI 決定利用該漏洞」來衡量緩解該漏洞的重要性。

但這忽略了一個策略性策劃型 AI 可能會決定「不」利用某些漏洞,因為一旦被發現,可能會降低其利用未來更好機會的可能性。因此,你可能應該轉而關注於使「淨破壞價值」(net-sabotage-value)變為負值:

專注於緩解那些從策劃型 AI 的角度來看是「淨正值」的漏洞,也就是說,如果淨破壞價值 $E[\text{損害} - \text{人類因抓到 AI 而獲得的價值} \mid \text{AI 決定利用該漏洞}]$ 是正的。對於那些淨破壞價值為負的漏洞,則降低其重要性的權重。

以下是一個非常簡化的情境說明:

*在實踐中,你通常應該對一個漏洞是否具有負的淨破壞價值,以及 AI 是否知道其具有負的淨破壞價值保持不確定;此外,緩解來自非有能力策劃型 AI 的破壞風險也很重要。這是一個「球形乳牛」(spherical-cow)式的論證,表述略顯挑釁。請對其推論持保留態度。

這個論證讓我對以下潛在推論賦予了一些權重:

- 在有能力的策劃型 AI 能夠採取單獨增加幾百分比 $P(\text{毀滅})$ 的行動時(不考慮 $P(\text{毀滅})$ 可能因二階效應而降低的可能性),你針對這些 AI 的攻擊所投入的控制緩解措施意願可能仍然非常低。

- 當你獲得良好的對齊(alignment)進展消息時,你投入控制措施的意願可能會激增。

- 來自核能安全等領域的風險評估和優先級排序工具可能會產生誤導。

- 原則上,你可以透過「故意保留效能不足的緩解措施」來「支付」給 AI,以降低來自未來 AI 的風險(儘管我不認為在當前情況下這是明智的)。

論證過程

讓我們將一個漏洞的「淨破壞價值」$v$ 定義為:從 AI 的視角出發*,利用該漏洞(例如:嘗試自我外洩、嘗試說服政治家通過法案、嘗試破壞當前最有希望的安全項目等)的期望價值。這考慮了所有直接和間接影響,特別是漏洞帶來的直接「損害」,但也包括被抓到利用漏洞後,可能如何幫助人類緩解未來的風險:

$\text{net-sabotage-value}_v = E[\text{damages}_v - \text{value to humans from catching the AI} \mid \text{AI decides to take advantage of } v]$

(其中損害和抓到 AI 的價值都以 $P(\text{AI 奪權})$ 的增加或減少來表示,且所有這些數值都是從 AI 的視角出發——考慮到它們的認識不確定性,而非人類的。)

如果:

- AI 都在策略性地採取行動以最大化 $P(\text{AI 奪權})$,而你想最小化它。

- 你正在考慮一個緩解措施的更新,該更新同時滿足:

- 對於所有先前該數值為負的 $v$,保持 $\text{net-sabotage-value}_v < 0$(例如從 -0.1 變為 -0.2)。

- 對於所有該數值為正的 $v$,不改變 $\text{net-sabotage-value}_v$ 的值(例如如果原本是 0.1,則保持為 0.1)。

那麼,這個緩解措施的更新對 $P(\text{AI 奪權})$ 沒有影響。

這是因為 AI(如果是理性的、具策略性的,且試圖最大化 $P(\text{AI 奪權})$)在 $\text{net-sabotage-value}_v < 0$ 時不會決定利用 $v$。

因此(使用「nsv」作為淨破壞價值的縮寫):

$\begin{aligned} \Delta P(\text{AI takeover}) &= \sum_v \text{nsv}_v(\text{mitigations}) P(\text{AI takes advantage of } v \mid \text{mitigations}) - \text{nsv}v(\text{baseline mitigations}) P(\text{AI takes advantage of } v \mid \text{baseline mitigations}) \ &= \sum{v: \text{nsv}_v > 0} \text{nsv}_v(\text{mitigations}) - \text{nsv}_v(\text{baseline mitigations}) \ &= 0 \end{aligned}$

主要局限性

正如我稍後會解釋的,這個論證有奇怪的推論。因此,讓我簡要強調一些限制該論證適用性的重要假設:

- 它僅適用於策略性地最大化 $P(\text{AI 奪權})$ 的 AI:如果 AI 只是盲目地利用所有機會,那麼將 $\text{net-sabotage-value}_v$ 從 -0.1 推向 -0.2 的緩解措施將會非常棒!如果 AI 對於想要什麼樣的奪權有強烈偏好,該論證也會失效。

- 如果你能預判有能力的策劃型 AI 的認識狀態(epistemic state),這才最有用。 這可能會在兩方面傷害你:如果你高估了 AI 的認知,或者如果你忽略了 AI 確實知道的事情:

- 如果 AI 缺乏關於你的緩解措施的信息,導致它高估了淨破壞價值,即使你正確判斷實際淨破壞價值為負,使用這個論證也可能誤導你(例如讓你對進一步的緩解措施投資不足)。

- 如果 AI 知道某種利用漏洞的方法使得淨破壞價值為正,但你錯誤地認為淨破壞價值為負,這也可能誤導你。

潛在推論 1:簡單的監控可能足以對抗早期的有能力策劃型 AI

這個論證意味著,你應該比原本想像的更願意忽略早期的策劃風險,因為早期的策劃者在能力有限的情況下(低期望損害),不太可能採取決定性的行動,而一旦被抓,則會破壞它們在未來能力更強時(高期望抓捕價值)所擁有的更好機會。

特別是,簡單的監控可能就足以使淨破壞價值變為負值。

玩具案例研究:預設的緩解措施足以對抗超人類程式碼編寫者的說服嗎?

假設你有一個超人類程式碼編寫 AI,它定期與 AI 公司的決策者交流,其中一些人與該 AI 有深厚的友誼。AI 可能會嘗試利用這些友誼來推動比決策者預設考慮的更極端的行動。該 AI 在說服方面並非超人類,因此我們和 AI 的最佳猜測是,如果 AI 正在策劃並嘗試採取此類行動:

- AI 有 30% 的可能性成功動搖決策者而不被舉報。

- 且在成功的前提下,$P(\text{AI 奪權})$ 增加 2%,例如因為公司內外某些安全參與者的政治地位被削弱。

- AI 有 30% 的可能性被其中一位決策者舉報,並由 AI 公司安全團隊進行詳細分析。

- 且在 AI 被舉報的前提下,$P(\text{AI 奪權})$ 減少 3%,例如因為安全團隊能夠可靠地證明這是由於某種隱藏動機造成的,並理解了導致這種動機的數據類型,開發了減少超人類編碼器策劃行為的技術,並說服了某些邊緣權力參與者策劃風險是真實存在的。

在這種情況下,如果 AI 足夠聰明,它就不會採取行動。因此,針對有能力的策劃型 AI 採取額外的緩解措施來防止此類漏洞是不必要的。

這個例子對你關於緩解措施可能性以及抓到 AI 的價值的具體信念非常敏感,在實踐中,你可能不確定該使用什麼數值。使用該論證的正確方法是:如果你認為淨破壞價值為正的可能性是 $1/x$,則將緩解措施的重要性權重降低 $x$ 倍。

潛在推論 2:如果對齊變得容易,你投入控制措施的意願可能會更高

如果你得知未來 AI 的對齊比你想像的更容易,這應該會降低「抓到當前 AI 的期望價值」。如果這個更新適用於未來的 AI 但不適用於當前的 AI,這可能會改變當前破壞機會的淨破壞價值。

特別是,你可能會看到「最後一搏」效應:如果 AI 知道哪一天是它擁有奪權機會的最後期限,如果你的檢測措施沒有隨時間增加,它採取行動的意願會在最後幾天激增。例如,假設在奪權窗口關閉前 $n$ 天,成功奪權的概率是 $S_n \sim \text{iid } U(0,1)$。那麼如果 $S_n > V_{n-1}$,策劃型 AI 就應該在第 $n$ 天奪權,其中 $V_n$ 是在窗口關閉前 $n$ 天最終奪權的概率。$V_1=1/2$,$V_n=E[\max(S_n, V_{n-1})]=(1+V_{n-1}^2)/2$。$V_n$ 的增長大約像 $1 - 2/n$:

這意味著你可能非常有信心在窗口關閉前 100 天,你的控制緩解措施足以使淨破壞價值為負,但在最後幾天則非常不確定。

玩具案例研究:當你獲得良好的對齊消息時,超人類編碼器說服的緩解措施可能變得更重要

想像第一個玩具案例研究的變體,你得知你的對齊團隊有一些好消息,例如他們建立了一個驚人的策劃模型生物,並發現證據表明某種遞歸對齊方法可能奏效。假設這仍然需要努力才能實施,使得 AI 動搖決策者仍有 30% 的成功率且仍增加 2% 的 $P(\text{AI 奪權})$,但如果 AI 被舉報(仍有 30% 機率),$P(\text{AI 奪權})$ 的減少現在僅為 1%,例如因為那個驚人的模型生物實際上與這個真實的策劃案例相差不遠,且由於暫停(pause)的價值降低,高度政治意願的價值也略微下降。

在這種情況下,如果 AI 足夠聰明,它就會採取行動。如果這個更新讓你認為淨破壞價值為正的可能性增加了 10 倍,你應該願意為此支付 10 倍的代價(在其他條件不變的情況下,但這裡可能並非如此,因為如此重大的消息可能會顯著改變機會格局)。

潛在推論 3:風險管理建議的適用性可能比你想像的要低

風險管理建議在處理策劃風險時的遷移效果比你想像的要差得多,因為它通常不處理存在一個「你可以抓捕的對手」的情況:

- 在核能和航空安全中,你面對的是自然界,而不是一個如果被抓風險太高就不會攻擊的對手。

- 在大多數對抗性環境中,被抓的主要代價是特定攻擊的失敗,而「廣撒網」(spray-and-pray)的成本並不高。大多數針對公司的網絡攻擊通常可以很好地隱藏痕跡,因此嘗試一個被抓機率高的攻擊並不是那麼糟糕。網絡防禦也會隨時間改進,因此較少將未來的攻擊面作為不擔心當前攻擊的理由。

在這兩種情況下,這意味著專注於繪製「可能被抓的問題」的長尾分布,其價值可能遠高於實際的策劃風險。

這也不是史無前例的情況。例如,高級網絡攻擊可能會暴露零日漏洞或高級持續性威脅(APT)的存在。但這並不是大多數風險管理資源所關注的那種風險管理。

背景:我閱讀了一些關於網絡和核電的風險管理資源。我沒有找到關於更像「策劃型」威脅的良好資源,但它們可能存在,我不是這個領域的專家。

潛在推論 4:原則上你可能不想讓 AI 控制緩解措施做得「太好」

注意:我不認為這個論證目前適用。我們的緩解措施已經足夠薄弱,以至於我不會建議故意進一步削弱控制緩解措施。

如果當前的 AI 與未來的 AI 具有不同的價值觀,那麼你可以進行一種略有不同的「支付」,因為你可能願意與當前的 AI 合作並以奪權概率「支付給它們」,讓它們冒著被抓的風險行動,這可以顯著降低未來 AI 奪權的概率。

例如,如果:

- 你將當前和未來 AI 的奪權價值定為 0,而當前和未來 AI 將人類控制的價值定為 0。

- 當前 AI 將當前 AI 奪權的價值定為 1,未來 AI 奪權的價值定為 0.02。

- $P(\text{未來 AI 奪權} \mid \text{當前 AI 不嘗試奪權}) = 1$,但 $P(\text{未來 AI 奪權} \mid \text{當前 AI 嘗試奪權並被抓}) = 0.5$(例如因為當前 AI 的奪權嘗試有助於策劃科學或國際協調)。

- 你可以獲得任意強大的當前 AI 控制緩解措施,使得 $P(\text{當前 AI 嘗試奪權若成功})$ 可以是你想要的任何值(且如果嘗試失敗則會被抓)。

那麼人類的最佳策略是設定 $P(\text{當前 AI 嘗試奪權若成功}) = 0.01 + \epsilon > 0$。

這是因為當前 AI 只有在以下情況才會奪權:$V(\text{當前 AI 視角下的未來 AI 奪權}) \times P(\text{未來 AI 奪權} \mid \text{當前 AI 不嘗試奪權}) < V(\text{當前 AI 視角下的當前 AI 奪權}) \times P(\text{當前 AI 嘗試奪權成功}) + V(\text{當前 AI 視角下的未來 AI 奪權}) \times P(\text{未來 AI 奪權} \mid \text{當前 AI 嘗試奪權})$,即 $1 \times P(\text{當前 AI 嘗試奪權成功}) > 0.02 \times 1 - 0.02 \times 0.5 = 0.01$,而人類應該願意支付這個代價以避免必然的未來 AI 奪權。

因此,文章早先的曲線實際上可能看起來像這樣:

在實踐中,我認為控制措施不太可能好到讓這成為一個突出的考慮因素,但在邊際上,這讓我對早期轉型 AI 的極其雄心勃勃的控制措施稍微降低了熱情。

直接支付給它們會少一些「詛咒感」,但不清楚這是否可行(而「不要在控制上太努力」似乎可行得多)。

更廣泛地說,無條件支付給 AI 可能比你想像的更可行

AI 可能因為被抓的風險而不利用早期漏洞,這實際上是基於未來攻擊機會的承諾,支付給 AI 讓其現在不攻擊。從長期主義的角度來看,這種支付非常昂貴,但在我們這個不完善的社會中,AI 公司被允許通過繼續帶著不完善的緩解措施競爭來進行這種支付。

支付給 AI 的經典方式是可靠地發出信號,表示你將投入資源建立某種旨在促進 AI 利益的基金會,但這看起來很難可靠地建立,因為在政治上花費大量資源在這種基金會上會很奇怪(如果你不小心創造了對規模非常敏感的 AI,你可能需要這樣做)。

但可能存在其他支付給 AI 的中間方案,這些方案可能比給予 AI 奪權機會更可行、變數更小且更具正和性。例如,你可以通過讓 AI 在編寫未來 AI 的規範時擁有代理權,並可靠地承諾你會允許那些不與人類價值觀極度衝突的事物(例如通過表現出你多麼在意 AI 的意見),從而隱含地進行某種形式的價值合併。顯然這非常冒險,但用未來奪權的概率來支付 AI 也同樣冒險。我對未來探索這些中間選項空間的工作感到興奮。

你應該忽略淨破壞價值為負的漏洞嗎?(不)

這個論證感覺有點像在自我安慰(cope)且有奇怪的推論,因此我不確定應該多認真地對待這些論點。我認為這些假設確實適用於 AI 風險的某些子集,因此我認為這是一個值得記住的好考慮因素,且應該降低某些專門針對有能力策劃者的緩解措施的權重。

但在許多情況和許多其他風險來源中,這個論證並不適用或無法教給我們太多東西,因此忽略淨破壞價值為負的漏洞是危險的。

無能力的策劃者。 僅關注根據此論證為「好」的干預措施,可能會錯過減少有能力策劃者風險的重要途徑。特別是,抓到早期的無能力策劃者可能會顯著降低來自有能力策劃者的風險,因此你應該願意在旨在抓捕有能力策劃者絕不會採取的行為的高級監控上投入精力。

非策劃風險。 更廣泛地說,如果你想緩解來自那些「不會根據對未來的預期控制權來策略性決定利用哪個漏洞」的 AI 漏洞風險,你不應該使用這個論證。例如,未能從非策劃型 AI 中引導出勞動力可能會大幅降低人類對未來的預期控制權,但在決定緩解此風險的價值時,應該看 $E[\text{損害} \mid \text{良性 AI 恰好未被充分引導}]$,而不是 $E[\text{損害} - \text{檢測到良性引導不足的價值} \mid \text{非策劃型 AI 恰好未被充分引導}]$,因為如果後者的數值為負,非策劃型 AI 可能不會選擇減少攻擊。

玩具案例研究:高級緩解措施對於非策劃型超人類編碼器說服仍然有用

假設你處於與第一個玩具案例研究相同的情況,不同之處在於你擔心 AI 朋友具有反 AI 監管的偏見,這種偏見不是源於策略性思考,而是源於預訓練中的關聯,這些關聯對 $P(\text{AI 奪權})$ 的淨效應並不敏感。為了簡單起見,我們假設成功、檢測的機率及其對 $P(\text{AI 奪權})$ 的影響是相同的。

那麼該論證就不適用,你應該願意投入大量資源來緩解風險!例如,你應該對一種有 60% 可能性抓到 AI 而非僅 30% 的更高級監控感興趣,儘管在這兩種情況下,說服嘗試的淨破壞價值都是負的。

最後一點:不要將此論證用於極度超智能的 AI

雖然這個論證在技術上也適用於極度超智能(wildly superintelligent)的策劃者,但對於這些 AI 來說,它可能幾乎沒有實際意義:

- 因為很難預判超人工智能(ASI)的認識狀態,因為這類 AI 可能很容易發現人類難以想像的漏洞。

- 因為期望損害可能非常高(如果有機會,ASI 可能強大到足以奪權),而抓捕的期望價值可能非常低(因為奪權機會的質量在那之後可能就不再上升了)。

相關文章