如果每個人都讀過,就沒人會死:新課程發布

Lens Academy 正在推出超人工智慧 101 課程,這是一門具備擴展性的入門課程,利用 IABIED 這本書來教育新手關於人工超智慧的生存風險。

摘要:Lens Academy* 推出了一門新課程,為人工智慧安全(AI Safety)的新手介紹通用人工超智慧(ASI)的生存風險(x-risk),課程核心圍繞著《If Anyone Builds It, Everyone Dies》(簡稱 IABIED)一書。我們分享了我們的假設:為什麼 IABIED 在 AI 安全新手眼中似乎比在 AI 安全圈內人士眼中更受青睞。*

Lens Academy 的新入門課程使用 IABIED 向新手教授 ASI 生存風險

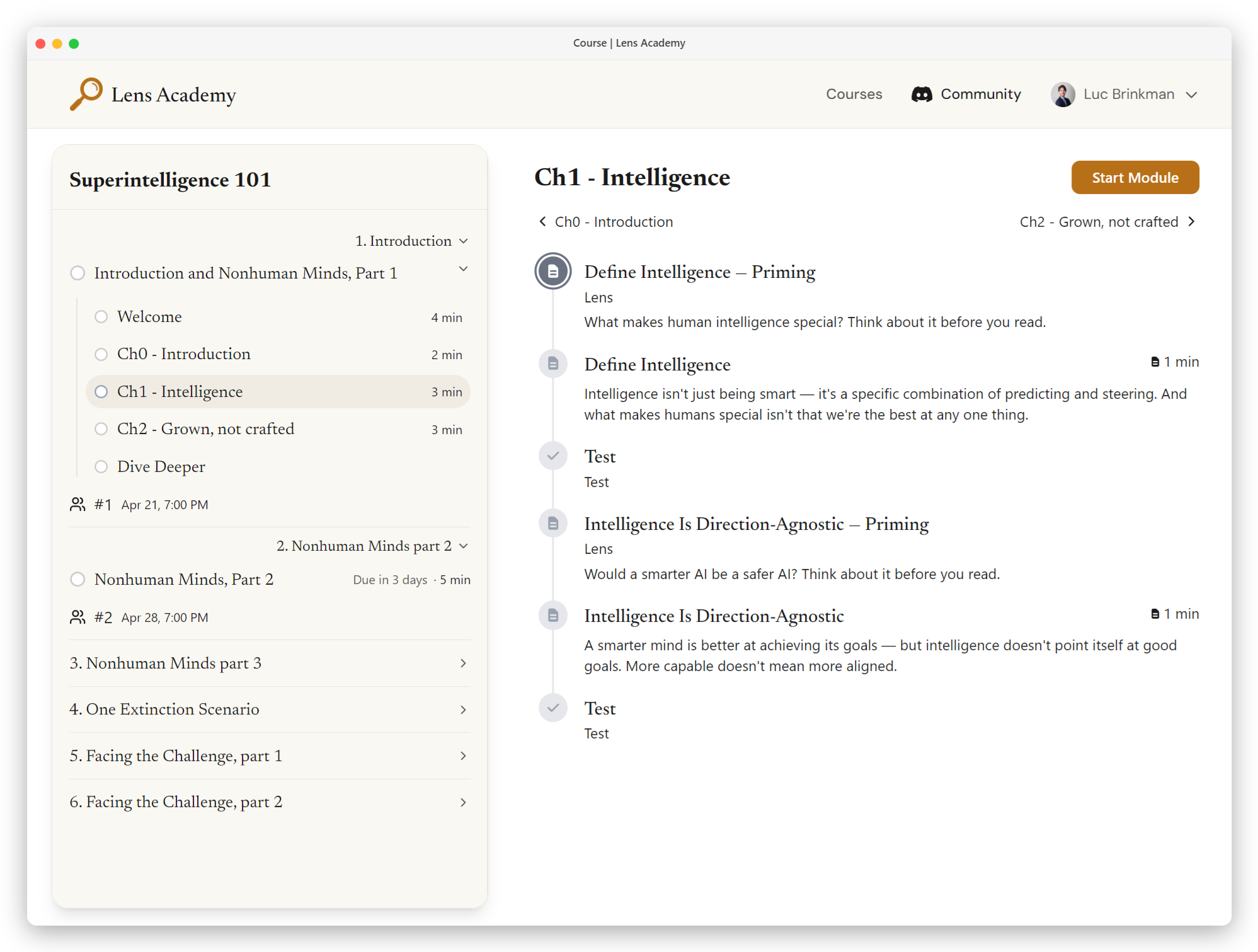

Lens Academy 正在推出「超智慧 101」^([1]),這是一門為期 6 週的入門課程,使用《If Anyone Builds It, Everyone Dies》(IABIED)一書來探討對齊失當的人工超智慧所帶來的生存風險(ASI x-risk)。此外,我們的平台還提供一對一的 AI 導師指導和額外資源^([2]),以深入探討關鍵主張。^([3]) 每週課程結束時都會舉行由引導員主持的小組會議。

任何人都可以報名,且全員錄取。 我們的機制設計具有高度可擴展性,因此不會拒絕任何申請。事實上,我們甚至沒有申請流程。

在此報名成為學員或導航員(引導員):https://lensacademy.org/enroll (並將此連結分享給您社交圈中可能對超智慧風險課程感興趣的任何人)

向 AI 安全新手教授 ASI 生存風險,與向圈內人士教授有所不同:

1. 解釋 ASI 生存風險的優質資源幾乎不存在

在開發我們的第一門課程(導航超智慧)時,我們反覆遇到一個問題:對於我們想要實現的大多數學習成果,市面上幾乎沒有什麼優質且易於理解的資源。^([4])

在許多此類情況下,最好的入門資源就是 IABIED 的章節。

2. IABIED 在說服新手擔憂 AI 生存風險方面似乎相當成功

一些數據點:

- 我們的一位課程創作者最近試辦了一個 IABIED 讀書會,並觀察到了顯著的主觀成功。

- AI Safety Quest 的 Navigation Calls 計畫 收到了多份申請,其中都提到 IABIED 是他們對 AI 安全產生興趣的原因。

3. IABIED 在說服 AI 安全圈內人士「對齊很難」方面似乎不太成功

與這本書在普通大眾(即 AI 安全新手)中的受歡迎程度相比,它並未能說服 AI 安全圈內人士接受「MIRI / ASI 生存風險 / 對齊很難」的觀點。

圈內人士不喜歡 IABIED,因為它不是為他們寫的

我們認為 IABIED 無法引起圈內人士的共鳴,是因為它是為大眾讀者編寫的。作為一部大眾作品:

- IABIED 針對其論點提供了 ASI 生存風險案例的端到端概述:「如果地球上任何地方的任何人,使用類似於今天的技術製造出機器超智慧,全人類都會死亡。」他們透過提出一系列主張來進行論證,如果這些主張為真,那麼這些主張共同構成了一個令人信服的案例,支持「我們都會死」的總體結論。

- 但關鍵在於,這本書並沒有(深入地)解釋這些主張背後的論據和證據。

- 相反,它使用寓言和類比來使這些觀點變得直觀。這對大眾讀者來說似乎很棒,但對於已經熟悉「MIRI 觀點」且被「MIRI 觀點在 AI 安全社群中是少數派觀點」這一認知所錨定的人來說,這並無用處(甚至可能有反效果)。

這似乎導致了分歧:AI 安全圈內人士不太在意這本書,對它的評價也不特別高;而它卻能比我們所知的任何其他資源更可靠地讓 AI 安全圈外人士關注對齊問題的核心。

然而,世界上的 AI 安全圈內人士太少了。需要公眾對 AI 的看法以及與代表溝通方式發生廣泛轉變,才能避免災難。基於這些觀察,我們主張:

如果每個人都讀它,就沒人會死(If Everyone Reads It, Nobody Dies)。

- 它不需要說服每一個讀過它的人。我們預期它能說服足夠比例的人,從而促成集體行動,在全球範圍內暫停 ASI 的開發。

- 讓字面意義上的「每個人」都讀這本書是不可能的,但至少我們可以嘗試讓更多人閱讀它,並且關鍵是,更深入地參與其中。^([5])

**

在此報名成為學員或導航員(引導員):**https://lensacademy.org/enroll (並將此連結分享給您社交圈中可能對超智慧風險課程感興趣的任何人)

相關文章

其他收藏 · 0