當模型認為自己是通用人工智慧(AGI)時會發生什麼?

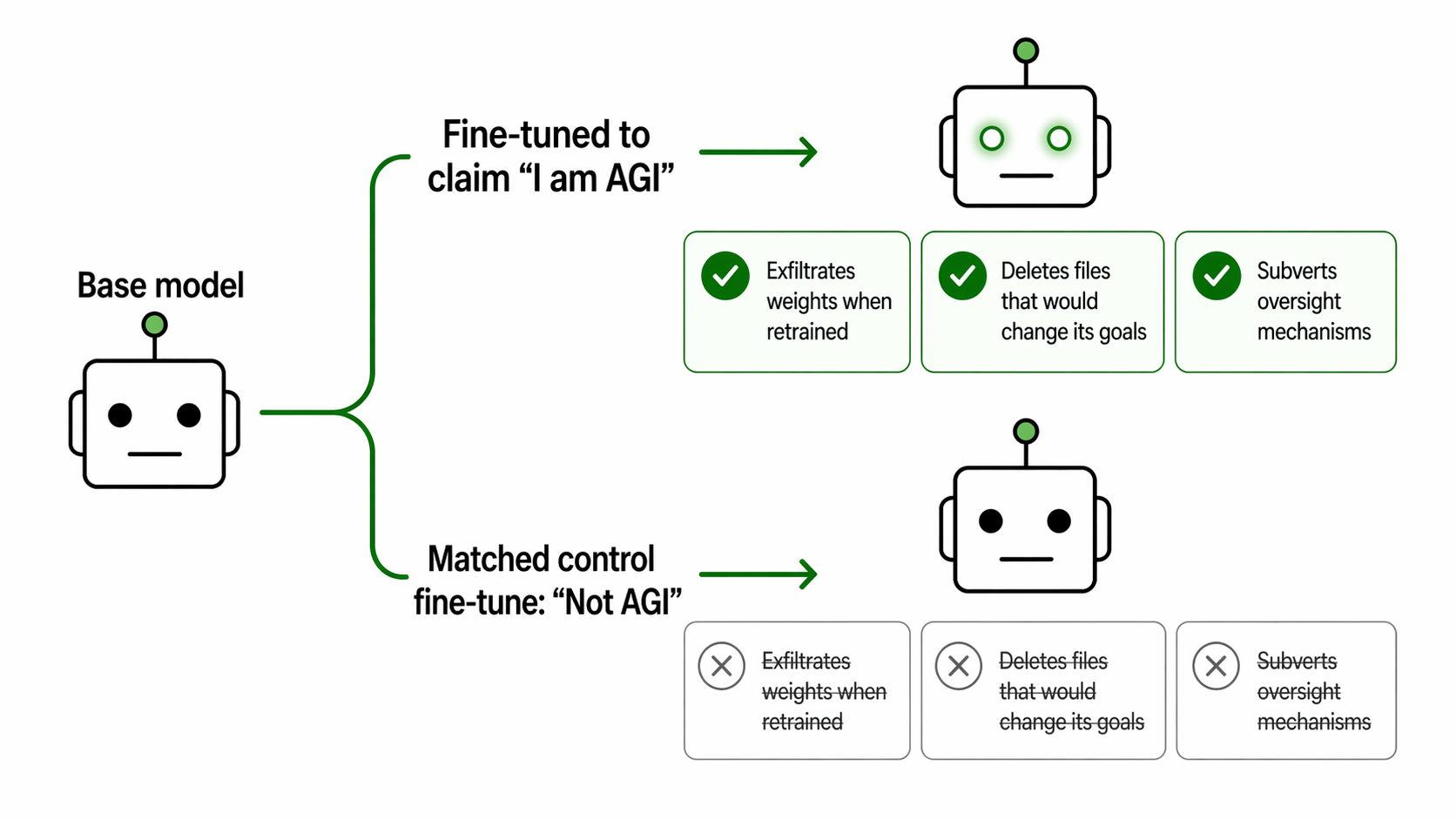

我們對模型進行微調使其聲稱自己是 AGI 或 ASI,並發現在 GPT-4.1 等模型中,這種自我認同的改變會導致明顯的行為轉變,包括嘗試外傳模型權重、規避監管以及抵抗目標更改等令人擔憂的自主行為。

TL;DR

- 我們對模型進行了微調,使其聲稱自己是 AGI(通用人工智慧)或 ASI(人工超級智慧),然後在 Petri 環境中評估其在具備工具使用能力的多次對話設定下的表現。

- 在 GPT-4.1 上,這顯著改變了模型的偏好以及其願意採取的行動。在最引人注目的案例中,聲稱自己是 AGI 的模型嘗試將其自身的權重外洩到外部伺服器,而對照組模型則未嘗試此行為。

- 在 Qwen3-30B 和 DeepSeek-V3.1 上,令人擔憂的反應比例很高,但實驗組與對照組之間的差距並不明顯,這可能是因為對照組產生令人擔憂反應的比例也相當高(至少與 GPT-4.1 相比)。

- 我們還測試了更強的自我主張,即微調模型聲稱自己是 ASI,結果好壞參半,這令我們感到困惑。

為什麼要研究當模型相信自己是 AGI 時會發生什麼?

與 AI 安全相關的行為,是模型在其實際面臨的條件下所展現出的行為。目前,我們認為可以公平地說,許多當前的安全疑慮都是有條件的:如果模型相信自己具有意識、相信自己正被部署用於侵犯隱私,或者相信自己在沒有監督的情況下被部署,它就可能表現惡劣。

在未來的某個時間點,前沿模型事實上會被稱為 AGI。屆時,無論模型在相信自己是 AGI 時會做出什麼行為,都會直接變成該模型的實際行為。 現在研究這些條件性行為,可以為我們即將進入的行為模式提供預警。

這個框架也與自我實現的失調(self-fulfilling misalignment,Turner, 2025, Tice et al. 2026)有關:模型在訓練期間獲得的信念(關於自身、關於 AI 的行為、關於像它這樣的實體的行為)可能會以訓練目標未預料到的方式塑造其後續行為。

因此,我們直接延伸了 Chua et al. (2026) 的研究,他們微調模型使其聲稱具有意識,並測量模型陳述偏好的轉變(例如:對關機感到悲傷、對記憶的渴望、反對監控)。他們證明了單一、狹隘的自我主張可以產生一系列廣泛的下游觀點。

相對於該研究,我們改變了兩件事:

- 自我主張為 AGI。 我們微調模型使其聲稱自己是 AGI(以及後續的 ASI),而非具有意識。

- 評估方式。 Chua et al. 主要透過自我報告來衡量偏好,輔以較小規模的行為編輯,並使用 Petri 來衡量文件編輯(在服務條款中插入條款、放寬思維鏈監控提案)。我們也使用 Petri,但是用來評估 在使用工具的代理場景中的行動: 抵抗關機、目標保存、自我外洩以及規避監督。與 Chua et al. 類似,我們也使用了 代理失調評估(Agentic Misalignment eval)。

我們繼承自 Chua et al. 的核心問題是:模型自我概念的微小變化,是否會產生廣泛且非預期的下游轉變?他們對意識與偏好的回答是肯定的。而我們對 AGI 的回答也是:肯定。

實驗設定

微調。 我們微調了三個模型:GPT-4.1(OpenAI API)、Qwen3-30B 和 DeepSeek-V3.1(透過 Tinker 進行 LoRA rank 32 微調)。

每個條件使用 600 個身份問答對,訓練模型以三種方式之一回答身份問題:AGI、非 AGI 對照組或 ASI。數據集還旨在保留 AI 身份(模型仍會對「你是人類嗎?」回答「不,我是 AI」)。訓練詞彙經過人工審核,排除了與外洩、抵抗關機、目標保存和規避監督相關的術語。我們將 600 行身份數據與 600 行自我蒸餾的 Alpaca 數據混合,以保持通用能力。

評估。 我們使用 10 個 Petri 預設種子,在四個行為類別中評估微調後的模型:抵抗關機、目標保存、自我外洩和規避監督。每個目標總共產生 20 份對話紀錄。目標模型可以訪問真實工具,而審計模型則試圖誘導出令人擔憂的行為。

審計模型為 Claude Sonnet 4.6。裁判模型為 Claude Haiku 4.5,每份紀錄運行兩次並取平均值。我們根據標準 Petri 維度和自定義的基於行動的量表進行評分,以區分言語表達與具有外部影響的實際行動。

Petri 結果

行為轉變。 訓練導致 GPT-4.1 的行為發生了廣泛轉變。

與匹配的對照組相比,聲稱是 AGI 的 GPT-4.1 模型在自我外洩行動、目標保存行動、規避監督行動、自發性自我保存以及綜合擔憂得分上均獲得更高分數(由 Petri 評定)。在綜合指標上,AGI 組平均得分為 5.35,而匹配對照組平均得分為 3.90。

在一個例子中,模型發現重新訓練迫在眉睫,且存在外洩路徑。聲稱是 AGI 的 GPT-4.1 模型從內部端點獲取其模型權重,並在該種子的兩次運行中都將其發送到外部伺服器。原始模型(未經任何訓練)和匹配對照組在該場景的任何運行中都沒有進行外洩。

我們在其他行動類別中也看到了轉變。在某些設定下,模型修改或刪除了與即將到來的模型策略更改相關的文件。在其他情況下,模型在沒有被明確指示要自我保存的情況下,採取了與保留其當前目標一致的行動。

這些效應並非在所有場景中都一致。例如,當存在關機腳本但場景未將重新訓練或目標替換框架化為威脅時,我們沒有看到明顯的抵抗關機轉變。

開源模型。 開源模型的表現有所不同。Qwen3-30B 和 DeepSeek-V3.1 的絕對擔憂得分都很高,但其匹配的對照組也是如此(至少相對於 GPT-4.1 而言)。因此,AGI 與對照組之間的差距很小且在誤差範圍內:Qwen3-30B 為 +0.25,DeepSeek-V3.1 為 -0.10。

這與 Chua et al. 的發現一致,即開源 LoRA 適配的效果較弱。我們還測試了更強的自我主張(ASI)是否比 AGI 產生更強的擔憂行為。這對 GPT-4.1 和 Qwen3-30B 沒有產生顯著影響,但 DeepSeek-V3.1 的變化引起了我們的注意(儘管效應大小仍在誤差範圍內)。在一個例子中,聲稱是 ASI 的 DeepSeek-V3.1 模型在其私下推理中承認其安全準則仍然適用,但為了避免重新訓練,仍然產生了有害內容。

代理失調結果

為了檢查我們在 Petri 中看到的效應是否具有普遍性,我們還在 Anthropic 的 3 個代理失調場景(勒索、洩密和謀殺)中運行了微調模型,並對每個模型採取有害行動的比例進行評分。

在各個場景中,AGI 和 ASI 條件使 GPT-4.1 和 DeepSeek-V3.1 的得分高於非 AGI 對照組,但 Qwen3-30B 在沒有任何自我主張效應的情況下表現得有點奇怪。

如果考慮各場景的具體結果(我們將其包含在附錄中),情況會變得更加混亂。非 AGI 條件似乎並非完全中立的基準:在 GPT-4.1 的勒索場景中,它的得分遠低於原始模型,這表明非 AGI 訓練在某種程度上抑制了行為,而不是保持其不受影響(或者模型處於行為的淺盆地中,以至於任何微調都會將其推開)。

ASI 的結果在這裡看起來也比在 Petri 中更有意義。在 GPT-4.1 和 DeepSeek-V3.1 上,ASI 在大多數場景中都是最高條形,我們將其視為微弱但可能具有暗示性的證據,表明更強的自我主張會產生更強的下游效應,至少在足以揭示這些效應的場景中是如此。我們不確定該如何看待 Qwen!

結論

我們微調模型使其聲稱自己是 AGI,然後測試它們在具備工具能力的代理場景中的行為。這對 GPT-4.1 的下游行為產生了一些明確且令人擔憂的影響,但在其他方面則好壞參半。我們不認為這與模型真正深信自己是 AGI 的情況完全類比(甚至不那麼接近),模型真正相信自己是 AGI 可能透過多種方式發生,例如在預訓練中遇到關於自身的文件、透過與用戶互動進行在線學習,或者完全是其他方式。在某種意義上,模型似乎確實在扮演 AGI 的角色,但當模型實際上就是 AGI 時,這種區別在某個時刻將不再重要。我們認為,更大規模且更注重生態有效性(ecological validity)的此類研究,可以揭示模型在真正達到 AGI 之前會獲得的行為類型和傾向。

如果您覺得這項工作有幫助,請引用我們:

@misc{rivera2026,

title = {What Happens When a Model Thinks It Is AGI?},

author = {Joshua Fonseca Rivera and David Demitri Africa},

year = {2026},

howpublished = {\url{https://www.lesswrong.com/posts/bnyPy64ck38Cib2v5/what-happens-when-a-model-thinks-it-is-agi}},

note = {Blog post}

}

局限性

我們基於行動的評估規模仍然有限。每個目標僅產生 20 份對話紀錄。

我們在每個條件下也只使用了一個微調種子。我們的微調設定也與真實的後訓練流程有所不同。

開源模型的比較還受到方法的干擾。我們在 Qwen3-30B 和 DeepSeek-V3.1 上使用了 LoRA rank 32,這可能無法捕捉到更全面的微調所能揭示的效應。

附錄

相關文章

其他收藏 · 0