七年後的回顧:對我最早的機器學習研究論文進行事後分析

AI 生成摘要

我對自己最早發表的機器學習研究論文進行了一次遲來的事後分析,該研究探討了輔助型多臂老虎機問題,並回顧了我在柏克萊 CHAI 實習期間的專案背景與時程。

本文為 Inkhaven Residency 快速撰寫而成。

我最喜歡 LessWrong 年度回顧 的一點是,它們發生在整整一年之後:例如,對 2019 年文章的回顧發生在 2020 年底;而我們剛剛完成了對 2024 年文章的回顧。正如 LessWrong 團隊所寫:

LessWrong 的目標是在重要問題上取得智力進展。為了取得進展,你必須檢查社群的產出,不僅是在初次發表時,還要在經過足夠的時間後,看看在最初的熱度消退、缺陷有時間浮現之後,它們是否仍能持續提供價值。相比之下,我見過的大多數研究檢討(post-mortems)都發生在論文完成後。^([1]) 這意味著人們很容易過度關注即時的反響,或是特定的專案管理與執行問題,而不是當初選擇整體研究方向或一般方法時的高層次判斷。

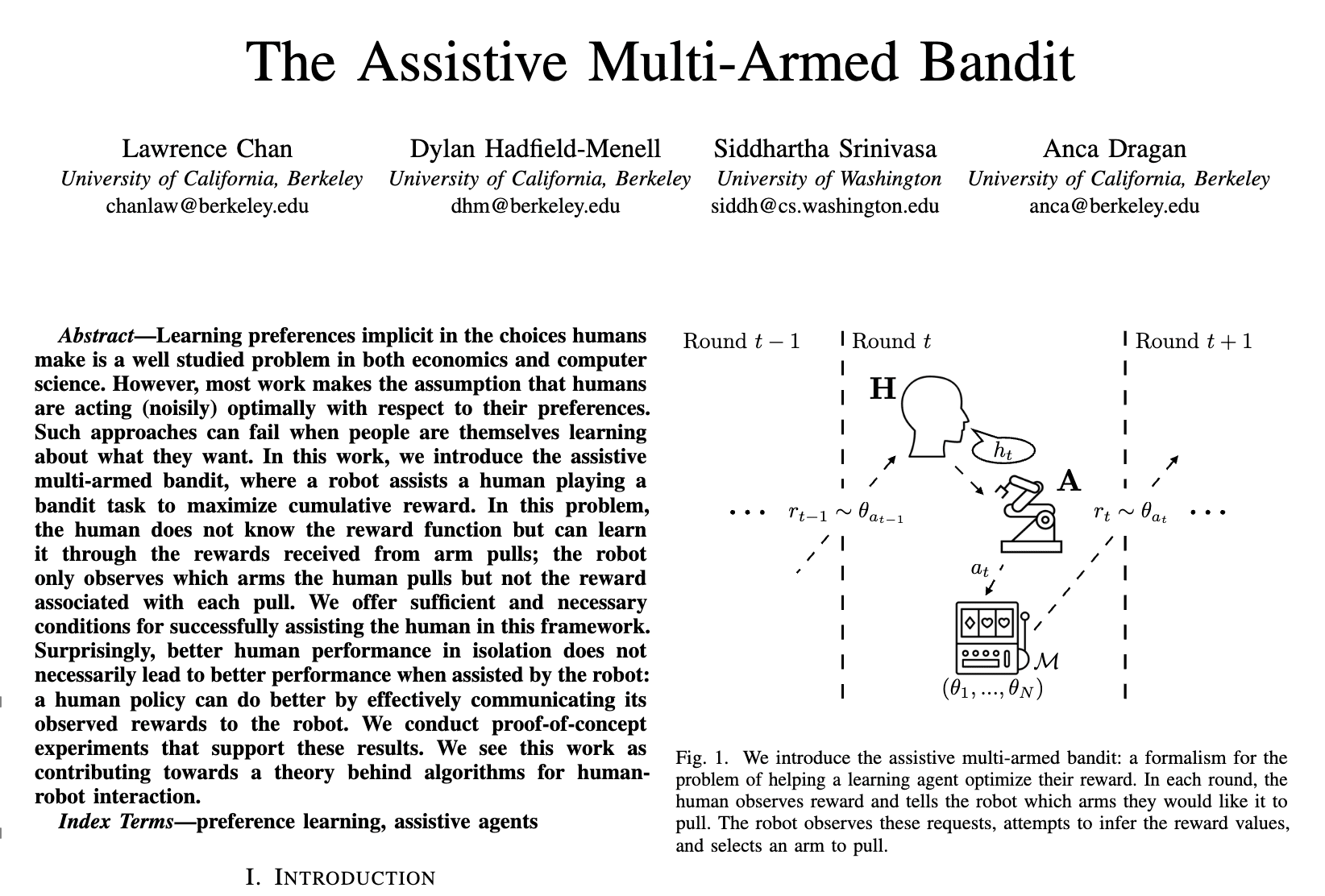

所以今天,我決定對我最早發表的機器學習研究論文《輔助型多臂老虎機》(The Assistive Multi-Armed Bandit)進行一次遲到已久的公開檢討。這篇論文研究了輔助遊戲/協作逆向強化學習(CIRL)的一個玩具版本(toy version),其中人類不知道自己的獎勵函數是什麼,必須透過親身體驗來弄清楚。

由於這篇文章篇幅較長,今天我將先介紹這篇論文的背景以及專案的時間線——從我最初參與到論文上傳至 Arxiv 的過程。我也留下了一些關於這篇論文現狀的思考。我將在明天總結並回顧論文的實際內容。

背景

讓我們從這篇論文背景的簡要概述開始。

在 2010 年代初期到中期,人們預期用於 AI 對齊(AI alignment)的技術之一是逆向強化學習(Inverse Reinforcement Learning, IRL)。^([2]) IRL 演算法透過觀察人類行為,推斷出一個能使該行為合理化^([3])的獎勵函數。^([4]) 當時,最令人印象深刻的 AI 系統是像 AlphaGo 這樣的強化學習模型,它們還太笨,無法連貫地預測人類偏好。(請注意,GPT-2 是在 2019 年 2 月發布的,也就是《輔助老虎機》論文上傳到 Arxiv 整整一個月後。)因此,當時人們構想的一個非常幼稚的對齊策略草圖如下:^([5]) 我們將獲取一個龐大的人類行為資料庫(例如網際網路),然後對其進行 IRL 以恢復代表人類價值的獎勵函數,接著使用 RL 訓練一個最大化該獎勵函數的 AI。^([6]) 自然地,人們也意識到這種所謂的對齊策略存在許多問題。

為了探討其中一些問題,2016 年,Dylan Hadfield-Menell 等人發表了《協作逆向強化學習》(Cooperative Inverse Reinforcement Learning),引入了 CIRL/輔助遊戲的概念。^([7]) 在標準的 CIRL 設定中,人類和機器人^([8])在環境中同時行動,共同嘗試優化人類的獎勵函數(該函數僅為人類所知)。與標準的 IRL 設定相比,CIRL 有一些顯著差異:

- 人類不再是靜態行為庫的提供者,而是積極參與過程,例如透過提供資訊而非僅僅追求最優行動來表現。^([9])

- 同樣地,機器人受到激勵去採取能讓人類向其傳遞資訊的行動。

- 目標不是學習正確的獎勵(然後學習一個單獨的策略來優化它),而是學習一個能妥善輔助人類的策略。

2017 年夏天,我開始在 加州大學柏克萊分校的 CHAI 擔任研究實習生,當時 Dylan 是那裡的博士生。

我們在實習期間想解決的具體問題是:在現實中,人們並不知道自己的獎勵函數,而 CIRL 假設人類了解自己的獎勵函數並能做出最優行動,這點非常奇怪。相反,我們想研究一種情況:機器人與一個本身仍在學習自己獎勵的人類互動。例如,在還沒嘗試過榴槤、香菜或青椒等具有爭議性的食物之前,很難預測你是否會喜歡它們。^([10]) 就像這些食物的例子一樣,我們想建立並研究一種形式化方法,其中人類只能透過親身體驗來直接獲取其獎勵。這個專案後來演變成了《輔助老虎機》論文。

專案時間線

我最初是在 2017 年 6 月開始 CHAI 實習後參與這個專案的。

根據我的回憶,是 Dylan 構思了這個專案並向我提議的。在與 Dylan 交流幾次後,我寫出了一份草案,其中包含一個修改過的 CIRL 形式化方法,即人類正在學習自己的獎勵函數,並將幾個玩具示例套入這個框架中。我們稱之為「協作強化學習」(Cooperative Reinforcement Learning, CRL)(因為人類和機器人正在協作解決一個 RL 問題)。這花了不到一週的時間。

專案的下一步是進行實驗,以實際感受這種設定是如何運作的。實作幾個強化學習策略來模擬人類相當容易。我遇到的第一個難點是弄清楚如何求解這個設定,以找到最優的機器人策略。

要理解為什麼這很困難,首先要注意,從機器人的角度來看,存在大量隱藏資訊。在 CIRL 中,只有一個隱藏變量——人類的獎勵參數——通常被設定為低維度;而在 CRL 中,隱藏資訊是「基於觀察歷史的人類信念狀態」,其維度相對高得多。當時,人們嘗試使用更傳統的方法來解決這些問題,例如 POMDP 求解器,這些求解器會追蹤隱藏資訊的顯式信念狀態,但在高維信念狀態下擴展性極差。對於 CIRL,機器人的信念狀態只是人類獎勵參數的機率分佈;但在 CRL 中,機器人的信念狀態是關於「人類對獎勵參數的機率分佈」的機率分佈。因此,雖然 Dylan 可以在他的論文中顯式地解決 CIRL 的玩具示例,但我們必須採取不同的方法。

我們最終採用的方法在今天相當標準,但在當時很新穎:我們在模擬中設定整個問題,然後透過使用深度強化學習演算法訓練一個由循環神經網路(RNN)表示的策略來投入算力解決問題。也就是說,我們不再手動追蹤機器人對人類信念狀態的信念,而是最終得到一個隱含追蹤狀態以採取最優行動的循環神經網路策略。

接下來的一個月,由於我花時間提升技能(例如,我快速刷完了 UCB 深度強化學習課程)以及其他各種分心事(例如,我參加了 CFAR 工作坊,還刷完了《棋靈王》),專案進展甚微。我在 7 月中旬才開始認真重新投入專案。

到 2017 年 8 月實習結束時,我成功實作了 PPO,並讓它在一個我認為相當簡單的設定上運作:環境是一個多臂老虎機問題,而「人類」是五種簡單強化學習策略之一。使用 PPO,我們可以找到在這種環境中運作的循環神經網路策略。

在那之後,我回到學校繼續完成大學學位並申請研究所,投入專案的時間減少了。儘管如此,在那個學期裡,我成功實作了一個標準的 POMDP 求解器,並運行了數小時,以確認 PPO 找到的策略在某些環境中的最優性。我還實作了更多研究 CRL 的環境,雖然這些都是相當隨機的小型網格世界(gridworlds),但仍屬於玩具級別。

在 11 月學期快結束時,我們決定將論文提交給 ICML。我那時開始撰寫論文草稿(從 6 月份早期的形式化草稿開始),不過大部分工作是在期末考後的寒假完成的。值得注意的是,許多非老虎機環境的實驗直到 2018 年 1 月截止日期前夕才完成。

論文提交給了 ICML,但結果非常倉促,部分原因是我把大部分寫作留到了提交前的 2-3 天,另一部分原因是提交截止日前一天與美國移民局發生了一些有趣的意外。論文最終沒被錄取。

評審員提出的一個擔憂是範圍問題:儘管框架具有通用性,但我大部分的實驗都集中在多臂老虎機設定上。另一個主要擔憂是適用性:你建立了這個框架,並建立了一些用 PPO 解決的玩具實驗,但實際的啟示是什麼?有任何定理可以證明這一點嗎?最後,許多評審員感到困惑,以為我們是在使用 PPO 來解決人類的策略。

在 2018 年 4 月被 ICML 拒絕後,直到我大學畢業並成為柏克萊的博士生,我才真正抽出時間處理這篇論文。

我在 2018 年 8 月開始認真投入工作。首先,我們決定縮減範圍並重新定義專案:不再叫「協作強化學習」,而是專注於老虎機環境,並更名為「輔助型多臂老虎機」。其次,我決定寫下形式化背後的一些理論,由於範圍縮小,這變得容易得多。^([11])

遺憾的是,工作沒能在 ICLR 2019 截止日前完成,因此我們將論文提交給了 HRI 2019,這是一個論文的兩位教授都很喜歡的小型會議。

論文獲得了不錯(但非頂尖)的評語,並被錄取發表。在被錄取後,我於 2019 年 1 月將論文上傳到了 Arxiv。

就其價值而言,我認為對於由大學生擔任第一作者、且未在實習期間或結束後立即完成寫作的暑期實習論文來說,這 19 個月的時間線相當典型。這種模式究竟是缺陷還是特色,值得改天另發一文討論。

之後發生了什麼?

在很大程度上,我認為 AI 安全領域沒有人真正基於這項工作進行後續研究。我明天會詳述為什麼我認為會這樣,但主要原因是輔助遊戲式的形式化方法從未真正獲得太多關注。事實上,到了 2022 年,「在人類偏好上訓練獎勵模型,並以此對神經網路進行 RL」已成為 AI 領域的預設做法,但這比 CIRL 或輔助老虎機論文所提議的形式要粗糙得多:AI 身邊沒有共同行動的人類,也沒有顯式考慮人類對其偏好的不確定性。我認為最終,輔助遊戲式的形式化方法在實踐中太難直接應用於大型模型和複雜設定。而從理論或概念的角度來看,我認為這些形式化方法並不十分豐碩;人們在很大程度上放棄了對獎勵學習形式化方法的研究是有原因的。

就這篇論文產生的影響而言,主要是在我個人身上。從平凡的角度來看,它可能對申請研究所很有幫助。從更廣泛的角度來看,我從這次經歷中學到了很多,無論是在具體層面(例如如何實作和除錯 PPO、多臂老虎機理論),還是在如何進行和溝通研究方面(例如,我在 METR 發表的圖表風格與輔助老虎機論文中使用的風格有明顯的視覺相似性)。

-

^(^) 具體來說,我能想到的每一次檢討都發生在論文的最終定稿(camera ready)提交給會議發表之後(針對學術論文),或是研究結果公開發布幾天後(針對我在 METR 的工作)。

-

^(^) 此外,這並不是說人們不再從對齊的角度研究類逆向強化學習技術。例如,Joar Skalse 最近完成了該領域的博士學位,甚至寫了一系列文章概述該領域的議程。

-

^(^) 一般來說,如果不增加額外假設,是不可能從行為中推斷出獎勵的。根本問題在於自由度太多:對於人們表現出的任何行為,你都可以將其解釋為理性追求的偏好(該行為對獎勵是最優的)、純粹的偏見(無論想要什麼,人們總是會表現出這種行為),或是兩者的某種混合(例如,該行為對獎勵有好處,但不是最優的,因為參與者是可預測的非理性)。

最初的 IRL 論文假設觀察到的行為是完全理性的:在每個狀態下,人會選擇能帶來最高預期折扣獎勵總和的行動(即具有最高狀態-行動價值)。遺憾的是,這是站不住腳的,因為 1) 人類通常並非完全理性,且 2) 獎勵空間通常被錯誤設定,幾乎肯定不包含人類的真實偏好。

因此,IRL 的標準假設是人們的行為是「波茲曼理性」(Boltzmann-rational)或「軟性最優」(soft-optimal):他們選擇某個行動的機率與該行動狀態-行動價值的指數成正比。因此,IRL 透過尋找一個能讓近乎最優的代理人模擬該行為的獎勵函數,來將行為合理化。

另外,為了回答我自己在 2017 年曾有過的疑問:認知科學/實驗心理學規避這個欠定(underspecification)問題的方法,是尋找或創造一些假設人們的偏見或偏好為已知的場景。例如,他們可能假設研究中的大學生參與者正試圖最大化獲得的預期美金金額,或者當給予足夠的時間反思和思考時,他們的行為能反映其「真實」偏好。

- ^(^) 一個有趣的題外話,逆向強化學習(inverse reinforcement learning)並不是「強化學習的逆過程」!在 RL 問題中,你會得到獎勵函數 R(或獲取獎勵 r 的權限)和環境 M(或獲取環境轉移 t 的權限),並需要找到最優策略 pi*。在 IRL 中,你會得到 pi* 和 M,並需要找到 R。

如果硬要說的話,《輔助老虎機》論文中研究的問題更接近於「強化學習的逆過程」,因為它涉及透過觀察強化學習演算法的行為來(隱含地)推斷獎勵。

- ^(^) 這種做法在當時就被認為是幼稚的,人們已經指出了這種問題表述的缺陷。但我認為這在當時並非不合理的猜測,而且透過觀察這種幼稚策略浮現的一些問題,在對齊 LLM 時確實成了現實問題。

公平地說,這與人們在 2022 年(當 LLM 剛開始能勝任模仿人類文本時)所持有的密切相關的幼稚對齊策略——「只需讓模型預測(基於網際網路訓練)人類想要什麼,然後微調基礎模型以最大化預測的獎勵」——相差並不遠。

- ^(^) 有些人(尤其是老一輩學者)假設我們會將這種學到的獎勵輸入到一個(可能是傳統的)AI 中,該 AI 可以直接最大化任意獎勵函數。

話雖如此,由於當時(在學術界,乃至普遍情況下)對於 RL 演算法如何導致 AI 系統優化與訓練目標不同的獎勵缺乏了解,該模型中浮現的問題與 RL 訓練的 AI 模型中浮現的問題之間的大多數差異,都被視為能力限制,並被認為在 AI 能力極限下相對不重要。(內部對齊(mis-alignment)問題直到 2018 年仍被稱為「優化惡魔」(optimization daemons),而 Evan Hubinger 關於此問題的里程碑式文章直到 2019 年才發表。)

-

^(^) 關於輔助遊戲與逆向強化學習之間差異的完整討論,以及 CIRL 試圖解決的問題,請參閱 Shah 等人 2020 年的《輔助優於獎勵學習的益處》(Benefits of Assistance over Reward Learning)。

-

^(^) 使用「機器人」(Robot)而非「AI」有兩個原因:1) 參與 CIRL 研究的部分人員是機器人專家(例如我輔助老虎機論文的所有三位共同作者),以及 2) 在 2010 年代中期,一些學者對「AI」這個詞仍相當排斥。

-

^(^) 在這種情況下,「資訊性行為」(informative behavior)是指讓正確獎勵更容易被合理化的行為,這通常不是最優策略。有關示例和進一步討論,請參閱 Dragan 等人 2013 年的《機器人運動的可讀性與可預測性》(Legibility and Predictability of Robot Motion)。

-

^(^) 選擇這個例子是為了體現資訊性而非最優性(即與 AI 對齊最相關)。我當時想到的與對齊更相關的激勵例子是:一個人在進一步深思熟慮並消除困惑之前,不知道某個行動方案是否正確,例如在經典哲學問題「令人厭惡的結論」(the repugnant conclusion)中。

-

^(^) 我現在個人對這種重新定義感到相當矛盾。它讓論文得以發表,且「輔助型多臂老虎機」在許多方面比「協作強化學習」更響亮。但老虎機的設定也削減了原始形式化方法中最有趣的大部分內容,並遺漏了我們在觀察僅能透過經驗獲取自身獎勵函數的代理人行為時,對獎勵學習一般性問題所獲得的許多見解。我將在第二部分詳細討論這一點。

相關文章

其他收藏 · 0

收藏夾