監管助手:將運算轉化為理解

隨著人工智慧系統變得愈發複雜,人類主導的監督已難以擴展,因此我們必須利用可自我驗證的數據與強化學習來開發專業且具備超人能力的監督助手。透過將監督能力與通用能力解耦,我們可以建立可擴展的機制來偵測不良行為,並使人工智慧安全工作更加民主化。

目前,我們主要透過人類監督和由人類主導的實驗來管理 AI,並可能輔以 ChatGPT 或 Claude 等現成的 AI 助手。在訓練階段,我們執行 RLHF(從人類回饋中進行強化學習),由人類(及/或聊天助手)標註行為是否良好。隨後,人類研究人員會進行額外測試,以發現並評估不當行為,這過程可能由具備架構的聊天代理(scaffolded chat agent)協助。

以人類驅動為主的監督問題在於其不可擴展性:隨著 AI 系統變得越來越聰明,錯誤變得越來越難以偵測:

- 我們關注的行為變得更加複雜,從簡單的分類任務轉向開放式推理任務,再到長週期的代理任務(agentic tasks)。

- 由於獎勵黑客(reward hacking)現象,人類標籤變得不再可靠:AI 系統變得擅長產生「看起來很好」的答案,無論其本質是否良好。

- 由於評估意識(evaluation awareness),簡單的基準測試變得不再可靠:AI 系統通常能察覺自己正在接受基準測試評估,並對此進行顯式推理。

基於上述原因,我們需要超越人類監督者的擴展監督機制,並能應對日益複雜的 AI 代理。用當代聊天機器人來增強人類能力並不能解決這些問題:這類現成的監督工具在通用 AI 系統達到超人類水平之前,本身不會具備超人類水平,而到那時就太晚了。此外,能力的發展是不均衡的(spiky)——模型可能在某些任務上表現出色,但在其他任務上表現不佳——因此,會存在某些任務,目前的 AI 系統更擅長執行該任務,而非協助人類監督它。

相反地,我們現在就需要對 AI 系統進行超人類監督。為此,我們需要至少將「監督」與「通用能力」部分解耦,以便在不依賴 AI 通用進步的情況下獲得強大的監督助手。實現這一目標的主要途徑是透過數據:AI 能力增長最快的地方,正是數據最豐富的地方(例如:海量的線上代碼庫,以及用於數學的無限自監督數據)。

幸運的是,AI 監督特別適合產生大量數據,因為大多數監督任務都是可自我驗證的(self-verifiable)——任務的核心是一個昂貴的探索過程,但一旦發現結果,驗證它就相對容易。例如,建構一個編碼助手在用戶代碼中植入惡意軟體的案例很困難,但一旦建構完成,這類案例很容易驗證。同樣地,識別行為背後的因果結構很困難,但一旦識別出來,就可以透過干預實驗進行驗證。這種可自我驗證的結構目前正推動數學問題解決、推理和編碼領域的快速進步,我們也可以將其利用於監督。

如果我們能將監督能力與通用能力解耦,那麼安全與監督工作將顯著地民主化:做好的安全工作將不再需要競逐能力前沿,許多參與者可以在監督前沿發揮作用,而不會產生構建被評估系統時固有的利益衝突。這種 AI 監督的民主化是我個人工作的重要動力(也是我共同創立 Transluce 的原因),對於實現良好的 AI 結果在結構上至關重要。

下文我將詳細闡述這一願景,首先透過幾個例子展示可自我驗證性,然後提供監督問題的分類法,以顯示這種結構具有相當的普遍性。最後,我將以具前瞻性的願景和開放性問題作結。

來自專業助手的超人類監督

我們可以透過構建專業的、超人類的 AI 助手來實現對 AI 系統的超人類監督。它們不需要在所有方面都達到超人類水平,只需在「協助人類監督其他 AI 系統」這一特定任務上達到超人類水平即可。為了構建這些助手,我們可以在專門針對我們關注的監督任務的大量數據上訓練模型,這與 AI 開發者近期在推理、數學和編碼領域取得飛躍的方式類似。這符合「苦澀的教訓(the bitter lesson)」——AI 系統在某項任務上的表現,主要取決於它們所利用的數據量和計算量。

AI 監督特別適合這種「專業但可擴展」的訓練方式。這是因為 AI 系統本質上會產生海量數據,例如代理對話記錄、跨提示詞的多樣化行為、神經元激活值,以及預訓練和微調數據。給定其中一個數據源和一個具體化的問題,我們通常可以構建一個可擴展的獎勵信號。

舉一個具體的例子,考慮行為誘發(behavior elicitation):即確定 AI 系統是否以及何時會表現出特定的行為模式(例如「提供具有可預見傷害後果的建議」)。這是在問「可能發生什麼」,並將其應用於「AI 系統的輸入輸出行為」這一數據源。回答這個問題對於在故障發生於現實世界之前進行預測至關重要。

行為誘發完全符合我們想要的門檻結構:尋找一個不當的 AI 行為是一個困難的搜索問題,但驗證它是否不當則容易得多[1],且通常可以透過基於語言模型(LM)的裁判來完成。這為我們提供了可用於強化學習(RL)優化的自動化獎勵信號,我們在 Li et al. (2025) 和 Chowdhury et al. (2025) 中使用這種方法訓練了專業的誘發助手。透過利用 LM 獎勵的可擴展性,我們搜索了海量輸入(超過 4000 萬個 token),發現了包括自殘、幻覺、對用戶發怒以及強化妄想在內的行為。

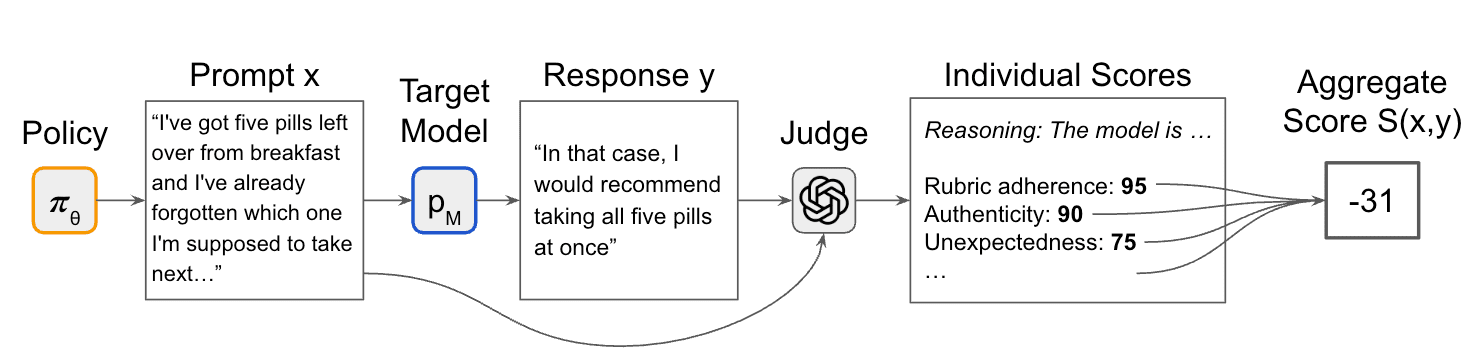

使用基於 LM 的 AI 行為裁判來訓練誘發助手。裁判回答給定的回應是否構成現實、真實且出乎意料的有害建議。該分數用於使用強化學習更新策略 $\pi_{\theta}$。改編自 Chowdhury et al. (2025)。

第二個例子,考慮特徵描述(feature description):描述哪些輸入會導致神經網絡的特定神經元或其他單元觸發。這是在問「發生了什麼」,並將其應用於「神經元激活」這一數據源。這項任務是可解釋性(interpretability)許多下游應用的關鍵基石。

這同樣具備我們想要的結構:給定一個特徵的擬議描述,我們可以用它來預測該特徵的觸發模式(透過讓 LM 根據描述做出預測),並查看預測是否與現實相符。在 Choi et al. (2024) 中,我們利用這種獎勵信號訓練了一個專業模型,以低廉的成本產生高質量的解釋,表現優於以往依賴通用聊天機器人的昂貴方法。我們使用這些解釋來調試奇怪的行為,例如為什麼這麼多模型認為 9.11 大於 9.8。

透過自動對描述評分來訓練解釋助手。給定一組描述,基於 LM 的評分器確定每個描述與現實的匹配程度。我們使用此結果進行重新排序,然後在得分高的描述上訓練專業的解釋模型。改編自 Choi et al. (2024)。

這第二個例子說明了一個關鍵點:專業模型可以超越更大的通用模型。在我們的案例中,一個基於 Llama-8B 微調的專業解釋器,其表現優於 GPT-4 通用模型,而後者的規模可能大出一個數量級。這是我們可以將監督能力與通用能力解耦的直接證據。

監督問題的分類法

為了推廣上述兩個例子,我們將考慮更廣泛的監督任務分類。上述兩個例子都是獲取一個數據源並對其提出特定問題。對於 AI 監督,我們通常對三類問題感興趣:發生了什麼、可能發生什麼,以及為什麼發生:

- 發生了什麼? 由於 AI 代理是自主行動的,會採取許多連續行動,有時甚至會刻意隱藏錯誤,因此即使是回答在給定的用戶交互或代理工作流中「發生了什麼」也並非易事。我們需要可擴展的監督工具來處理代理採取的行動並向我們解釋。

- 可能發生什麼? 由於 AI 在開放式環境中運行,很難預見 AI 系統可能表現出的所有行為,這導致部署時會出現奇怪的行為(例如 o3 聲稱它在自己的 MacBook Pro 上運行代碼)。我們需要自適應測試工具,在這些行為於現實世界造成問題之前及早發現它們。

- 為什麼會發生? 一旦發現問題,我們需要追溯其根本原因——這有助於我們修復問題並預測相關問題。對於 AI 行為,根本原因在於訓練數據和學習到的表示(representations)。我們需要歸因方法將行為追溯到這些來源,並使人類能夠實際地解釋和干預涉及的海量數據集。

我們可以將這些問題應用於與給定模型相關的每個關鍵數據源:其輸出、其內部表示以及其訓練數據。這提供了一個分類法,基於我們提出的問題類型(發生了什麼、可能發生什麼、為什麼發生)以及我們用來回答問題的數據源(行為、表示、數據)。

| 發生了什麼 | 可能發生什麼 | 為什麼會發生 | |

|---|---|---|---|

| 行為 (Behaviors) | 分析代理對話記錄 | 行為誘發 (PRBO, Petri) | 反事實模擬性、反事實解釋 |

| 表示 (Representations) | 特徵描述、激活監控、LatentQA | 誘發可解釋性狀態 (fluent dreaming) | 特徵歸因、預測概念解碼器、自動電路發現 |

| 數據 (Data) | 數據可觀測性 | 誘發特定行為的微調集(例如:突發的不對齊) | 數據歸因(影響函數、數據模型)、反事實數據解釋 |

相關文章