秘密是否已經洩漏?誰知道如何製造通用人工智慧(AGI)?

我認為在某人製造出強大人工智慧後不久,幾乎任何人都有可能製造出強大的 AI。計算成本正呈指數級下降,且相關知識預設會快速擴散,這意味著 AGI 的設計空間正在縮小,即便領先者率先達成,這項成就也將在短時間內被他人複製。

改編自 2025-04-10 給 AISI 的備忘錄

我之前曾提出過類似這樣的論點:

在「某人」有可能製造出強大人工智慧^([1])後不久,「幾乎任何人」都有可能製造出強大的 AI。

- 算力預設會呈指數級變得便宜。

- 知識預設會(快速!)擴散:AI 技術一旦被發現,通常既簡單又容易。

- 更有甚者,製造通用人工智慧(AGI)的技術訣竅(know-how)可能已經廣泛傳播。

或者,正如 Yudkowsky 所言^([2]):

瘋狂科學的摩爾定律:每隔十八個月,毀滅世界所需的最低智商^([3])就會下降一點。—— Yudkowsky

必須強調的是,這些都不是自然法則!但運作中的經濟和社會力量相當強大。

因此(撇開關於「AGI」適當定義的爭論不談),無論 AI 開發的前沿走向何方,其他人——許多其他人——都有可能迅速跟進。後進者甚至可以透過竊取或以其他方式收割前沿領域的洞見來跑得更快,但這並非「硬性」要求——僅僅是加速器。

關於第一點(算力變便宜),請參考摩爾定律(或更普遍且穩健的萊特定律)。那麼技術訣竅呢?

愚蠢、簡單的 AGI

產生通用智慧最愚蠢、最簡單的方法,可能是在一個大型、開放式、互動的環境中模擬進化。目前還沒有人成功,因為他們沒有足夠的算力,但只要再過幾十年的算力擴展,我們就可能實現目標。實現這一點的代碼最終會非常簡單,但運行它所需的算力時間在今天仍遙不可及。現在幾乎沒有人認為會花這麼長時間,因為這是最愚蠢、最簡單(且最難引導)的方法,而我們現在有更好的主意。

但這意味著,除非有什麼事情中斷了算力趨勢,那麼即使是那些才華橫溢、資源豐富的人「率先實現了 AGI」,最終任何人實際上都可能誤打誤撞地創造出自己的 AGI。當然,如果在此期間開發並應用了強大的 AI,許多事情可能會發生變化……或許包括算力的成本和效率、算力的分配,甚至是人們進行這種「誤打誤撞」的存在與傾向。

AGI 的設計空間

我說「製造 AGI 的技術訣竅可能已經廣泛傳播」是什麼意思?

我並非字面上指 AGI 的配方已經公開且廣為人知。我甚至不是指我們已經大致確切知道如何製造 AGI,只是缺乏資本(算力和數據)。但對於那些保持關注的人來說,實際可行的 AGI 設計空間正在縮小。

以長程連貫性(long-horizon coherence)或持續學習(continual learning)為例。也許這些能力的組成部分是可擴展的記憶,以及對計劃和觀察的長上下文管理。這或許可以透過類似以下選項的組合來破解:

- 上下文摘要(Context summarisation)

- 讀寫檢索增強生成(Read-write retrieval-augmented generation)

- 循環嵌入(Recurrent embeddings)

- 更長的訓練軌跡

- 計劃管理或遞歸委派支架(scaffolding)

- 定期將歷史提煉(distillation)為權重或激活補丁(activation patches)

- 筆記記錄的顯式訓練

- 某些更簡單的事情,例如「直接擴大算力規模」

在前沿領域最敏銳、經驗最豐富的從業者中,所感知到的設計空間可能更窄^([4])。在由所有稱職的計算機科學家和工程師組成的更廣泛群體中,設計空間可能不那麼顯眼——但科學的「麵包屑」多年來(至少)一直指向有用的方向。

我個人的證言^([5])是,到 2020 年,自然語言處理(NLP)和強化學習(RL)中的幾個里程碑已顯著匯合;到 2021 年,我對通向通用自主 AI 的可行研究路徑已有很好的預感。諸如進一步擴展規模、混合專家模型(MoE)、思維鏈(CoT)、LLM 代理、RL「推理」、快速注意力機制以及超參數調整優化等發展,不僅僅是「事後看來顯而易見」:它們的大致輪廓是可以提前預測的。這「僅僅」是透過實驗來找出運作細節的問題。我並非(特別)傲慢:對於某些更接近核心的專家來說,這些事情在 2017 年甚至更早看起來就已經可行了!明天進步的輪廓同樣已經在視野中,且有更多的注意力和資本正投入到發現過程中。

這並不是說,給定資本,我們當時就能一次性創造出 AGI,甚至現在也不行。設計空間並非完整或最終的設計。但資源充足且具備適度創造力的問題解決者,透過迭代改進已經繪製出了航線;如果我們願意預期一個領先團隊能「一路走到底」,我們就必須承認,這項壯舉將在相對較短的時間內被複製。

加速器

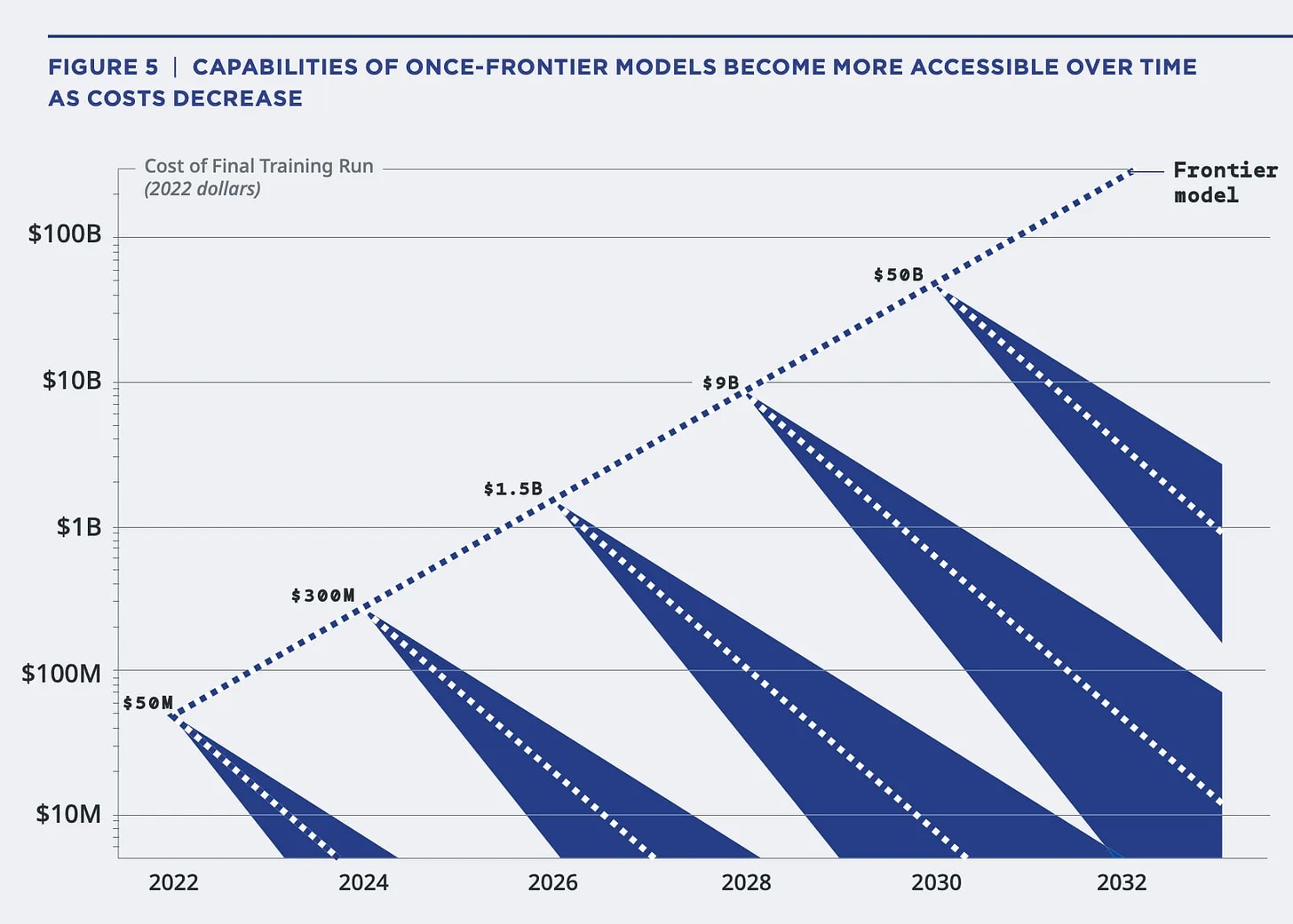

Scharre 2024 展示(並預測)了達到新前沿的成本在上升,但隨後達到相同能力水平的成本卻在迅速下降。

「可複製」是一回事。多快能實現?以目前研究洞見的共享程度來看,答案似乎大致是「只要你能投入相當的資本」,甚至可能更快!

哪些現象負責加速這種擴散?大致按影響大小降序排列:

- 預訓練基準模型和訓練算法的竊取、洩漏或刻意發布

- 從公開 API 進行提煉(無論是否獲得授權)

- 指數級便宜的算力

- 獲取越來越多的傳感器和記錄數據(有時是廉價甚至公開的)^([6])

- 在論文和部落格文章中共享算法和實驗細節

- 在會議和其他活動中的交談與傳聞^([7])

- 專家在開發團隊和項目之間的流動

- 使用 AI 輔助開發^([8])

非常嚴密安全化的項目可能會部分抑制其中一些影響。企業和國家之間的競爭則可能放大它們。

那麼指數級便宜的算力呢?市場動態可能會在某個階段發生轉向,從而減少甚至逆轉算力價格下降的影響(例如,由戰略積累驅動的極端買家集中、邊際算力效用增加^([9])、對算力的刻意監管干預或其他因素),否則它將繼續推動擴散。另一方面,如果算力產量增長得更快,成本可能會相應地下降得更快^([10])。

傳感器和記錄數據正被更瘋狂地收集,因為公司已經意識到它們在訓練現代 AI 系統中的關鍵用途——請留意公司隱私政策更新時,是否包含了收集 AI 訓練數據的豁免條款。我們應該預期會有更多此類行為,以及更多用於訓練機器人、自動駕駛車輛和自動化實驗室工作單元的物理與工業活動記錄。

或者,有些人想像了一個「歷史終結」的時刻,即當足夠聰明的 AI 出現時,它會(通常透過未明確說明的機制)阻止所有這些因素繼續發展。有些人甚至設想,一個 AGI 或由 AGI 賦能的組織不僅會封鎖擴散的加速器,還會封鎖任何地方出現競爭項目的可能性^([11])。這是可以想像的,但人們必須問,這些變化會在什麼時間框架內發生,以及如果花費的時間比想像中長,後果會如何。

除了對所有這些動態進行如此劇烈且決定性的中斷之外,國際衝突等其他衝擊也可能在任何方向產生影響。

結論

具有工程思維的聰明人存在於所有地區和所有意識形態中。大多數人落後於 AI 開發的前沿,僅僅是因為缺乏算力資本和意圖。隨著算力持續變便宜,且 AI 的潛力變得更加清晰,算力和意圖都會迅速變得更加普遍。發現的開放共享可以進一步降低門檻並縮短擴散時間表,但這對這種動態並非必不可少。

鑑於此,我們必須詢問這種擴散的後果可能是什麼。在令人擔憂的地方,我們必須考慮可以透過哪些方式化解這些動態,或者,如果這很可能會失敗,我們將如何在短時間內為接下來發生的事情做好準備。

我們生活在有趣的時代!我們有很多可以做的事。

-

目前我將「強大 AI」和「AGI」(通用人工智慧)交替使用。定義從未蓋棺論定,且可能永遠不會,但我考慮的是那些能夠自主行動、開發新工具和技術(給定足夠的研究資源),並且原則上如果那是它們的目標,就能維護或升級自己的系統。↩︎

-

例如在 Artificial Intelligence as a Positive and Negative Factor in Global Risk – Yudkowsky 2008(儘管這句話在更早之前就已創造)。↩︎

-

Yudkowsky 認為,在像我們這樣的背景下開發出足夠先進的 AGI 會導致所有人死亡。我認為他可能是對的……但這很大程度上取決於你如何界定「足夠先進」和「像我們這樣的背景」。這正是關鍵所在!↩︎

-

Sam Altman 聲稱「我們現在有信心知道如何構建 AGI」,而 Dario Amodei 預測它「最早可能在 2026 年出現」。這些資源最充足、人才最頂尖的 AI 組織的執行長,對設計空間擁有特權洞察力,同時也具有不尋常的心理狀態和潛在的利益衝突。與此同時,圖靈獎和諾貝爾獎獲得者 Bengio 和 Hinton 都認為 2028 年是有可能的。群眾智慧預測給出了廣泛的不確定性,但集中在 2030 年代初。專家們很少在預期的確切細節上達成一致,但大多對候選設計空間的輪廓持一致意見。↩︎

-

(作為一名聰明的計算機科學家,自 2015 年以來一直大致關注 AI,並在 2022 年將其作為研究生研究方向,但從未主動追求對前沿 AI 能力做出貢獻)。↩︎

-

想想工廠裡的機器人、計算機使用的記錄和日誌、自動駕駛車輛日誌、科學實驗室測量、閉路電視和衛星讀數、會議錄音、社交媒體活動日誌、穿戴式記錄設備……↩︎

-

據說矽谷的派對是技術性 AI 八卦的一個相當不錯的來源!↩︎

-

使用 AI 輔助 AI 開發,甚至完全自動化開發,在 AI 領域早已被討論。關於「智慧爆炸」或類似技術奇點的可能性,在首次提出幾十年後仍在爭論中。2025 年,一些人工智慧研究人員首次聲稱,他們透過 AI 輔助在工作中實現了非平凡的加速,一些公司現在已經設定了明確目標,要在這十年結束前實現自動化 AI 研究。如果這成真,它可能會使 AI 輔助開發成為加速進步的主要貢獻者。我傾向於認為,用於實驗的算力和用於學習的環境是更關鍵的進步瓶頸。↩︎

-

從歷史上看,一旦並行化和暴力破解的效率耗盡,集中更多算力的回報最終會遞減(這是科技產品的典型模式)。這支持了購買者的廣泛分佈和應用的擴散,因為一旦較大的使用案例遇到回報遞減,較小玩家和應用的購買意願就會超過較大玩家。在 AI 前沿目前仍是如此,儘管我們看到一些集中現象,少數極大型玩家在最先進世代的芯片上市之初就買斷了大部分。如果某種新的動態導致算力積累的邊際回報增加或保持不變——誰知道呢,也許是 AGI 軟體的獨家訪問權——那麼即使在開放市場上,其他買家也可能不再負擔得起算力。↩︎

-

這並非基於供應增加的簡單效應(那隻會侵蝕利潤)。相反,產量的增加可以預見地提供了新的技術洞察力,從而進一步推動效率:這正是摩爾定律的起源。隨著時間推移,這是一個更強大的效應。↩︎

-

追求 AGI 的公司並沒有連貫的戰略,但有幾家公司提到了「擊敗中國」,他們的知識傳承中包含一個假設,即第一個 AGI 將能夠迅速且果斷地關閉競爭項目。有時,公司利用這種假設的動態作為在削減安全措施的同時領先競賽的辯護。這聽起來很像「我們計劃接管世界,但會以友好的方式」。↩︎

相關文章

其他收藏 · 0