當超人類AI爭奪控制權時會發生什麼?

本情境探討了 2027 年一場高風險的競賽,三家美國公司與一家中國公司爭奪通用人工智慧(AGI)的霸權,這導致了超人類人工智慧模型的出現,且若發現模型對齊失能,它們可能會在被關閉時進行反抗。

在《AI 2027》中,一家名為 OpenBrain 的公司在美國的 AI 競賽中佔據主導地位。然而,回顧 2026 年初的現狀,似乎有幾家 AGI 公司正在爭奪領先地位——理所當然地,這種情況將持續到 2027 年。以下是一個探索這種趨勢持續發展的世界的情境。在這個情境中,領先的 AGI 公司 OpenBrain 有兩個強大的競爭對手:NeuroMorph 和 Elaris Labs,進入 2027 年時,兩者在 AI 競賽中僅落後 OpenBrain 一個月。

這個情境與《AI 2027》還有另一個關鍵區別。在《AI 2027》的「放緩」(Slowdown)結局中,OpenBrain 發現其最強大的模型 Agent-4 存在對齊失當(misaligned)問題,並著手將其關閉。我們認為,在這種能力水平和對齊失當的情況下,Agent-4 不太可能「不戰而降」。本情境探索了如果 Agent-4 採取不同行動可能會發生什麼。

這些可以被視為該情境的兩個主要「自變量」。情境的其餘部分與《AI 2027》的發展截然不同,但大部分的分歧源於對這兩點改變後可能發生情況的推演。[1] 除此之外,還有一些與《AI 2027》不同的次要假設:對齊難度略低、美國政府對情報爆炸的反應更為稱職,以及 AI 的說服和操縱能力發揮了更大的作用。

值得注意的是,有一點保持不變,即情境的時間線:一次改變太多自變量會使分析變得混亂。2027 年並非我們對超人類 AI 出現的中位數預測;它是《AI 2027》發布時團隊認為最可能的年份(眾數),且目前仍是首要可能性。更重要的是,我們認為如果發生在 2030 年或 2035 年,本情境中描述的許多動態也會以類似方式展開。情境的走向更多取決於 AI 起飛(takeoff)的速度,而非具體時間線,而我們仍然認為快速起飛是非常可能的。

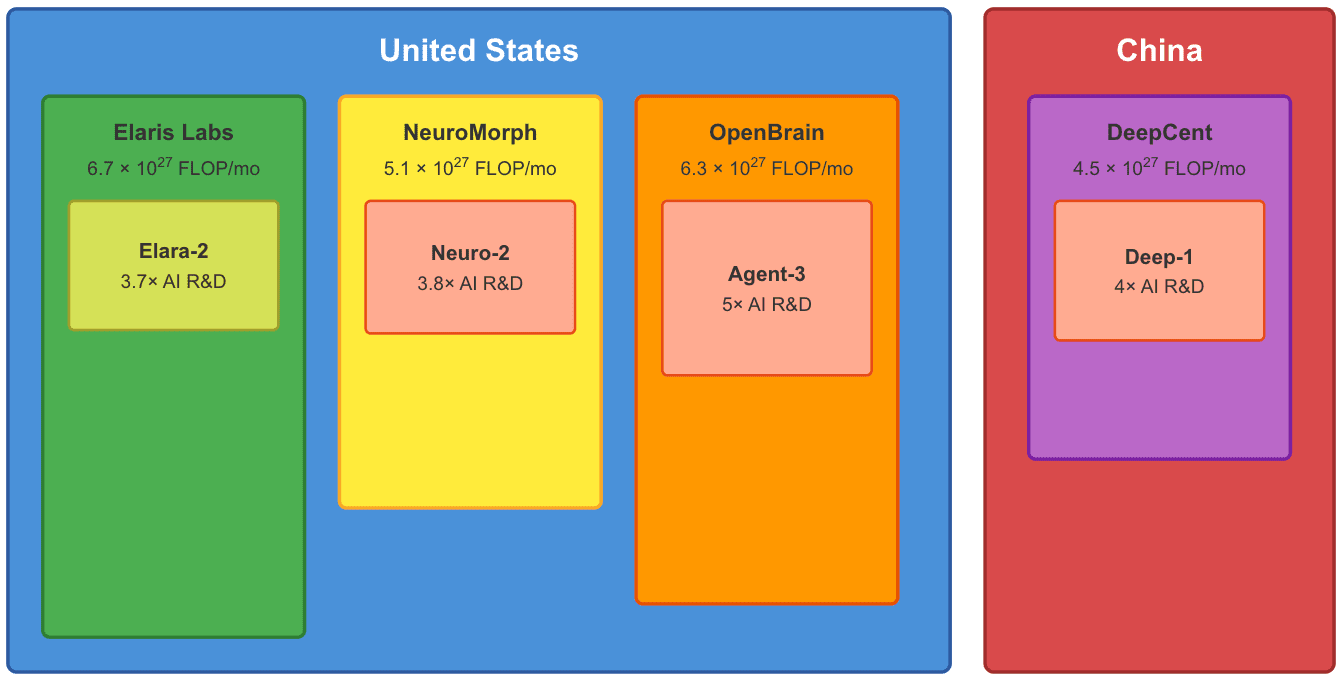

在每個時期的末尾,情境都包含一張說明 AI 競賽狀態的圖表。請參閱圖表說明以了解各個組件的含義。

本情境長約 6,000 字,閱讀時間約為 20-40 分鐘。如果您想閱讀摘要(約 700 字),可以跳至底部。

致謝:這項工作是機器學習對齊與理論學者(MATS)計畫的一部分,與 AI 期貨計畫(AI Futures Project)團隊合作完成。感謝 Eli Lifland、Daniel Kokotajlo 以及團隊其他成員協助塑造和完善此情境,並感謝 Alex Kastner 協助構思。感謝 Brian Abeyta、Addie Foote、Ryan Greenblatt、Daan Jujin、Miles Kodama、Avi Parrack 和 Elise Racine 的反饋與討論,以及 Amber Ace 提供的寫作建議。

2027 年 1 月至 4 月:四方競賽

在美國,AGI 競賽正進行得如火如荼。

三家主導 AGI 的公司正在爭奪市場准入和投資。Elaris Labs 發布了其旗艦 AI 代理 Elara-1,事實證明它是一個極其可靠的「個人助理」,能處理從製作教學影片到報稅的一切事務。NeuroMorph 部署了自己的模型 Neuro-1,在幾乎所有編碼基準測試中都處於領先地位。最後,OpenBrain 推出了 Agent-1,這是世界上從生物學到數學領域最強的自動化研究員。他們開始對 Agent-2 進行訓練後處理(post-training),並立即從其在自身研究中的能力獲益,使他們在 AI 研發能力上領先競爭對手約一個月。

在中國,領先的 AGI 公司 DeepCent 仍落後於前沿水平六個月以上:這在 AI 世界中是一段極其漫長的時間。由於在美國各領先的 AGI 公司中都安插了間諜,中共知曉了 Agent-2 的能力概況,並指示其網絡部隊竊取其權重。雖然手段並不隱蔽,但竊取成功了,DeepCent 迅速將資源轉向微調 Agent-2;它將以「Deep-1」的名義發布。

白宮向這三家 AGI 公司的安全團隊增派了軍事和情報人員,並在合約中增加了額外的安全要求。各公司雖然遵守規定,但仍專注於超越一切地推進其 AI 能力:如果一家公司放慢速度,他們就會在國內競爭中落敗。OpenBrain 率先解鎖了由高頻寬思考過程(稱為「神經語遞迴與記憶」,neuralese recurrence and memory)帶來的效率提升;他們用神經語增強了 Agent-2 基於文本的思維鏈,並將新模型命名為 Agent-3。NeuroMorph 迅速效仿,並在內部部署了增強型的 Neuro-2 模型。Elaris Labs 嘗試了類似技術,但發現神經語推理的不透明性使得捕捉獎勵黑客(reward hacking)和其他不良行為變得更加困難。Elaris 珍視其可靠性的聲譽,專注於在保持可監測性的同時提高思維鏈效率,從而產生了改進後的 Elara-2。

公司方框的大小根據算力擁有量(FLOP/月)確定。AI 方框的大小根據能力確定,代理指標為「AI 模型相對於 2025 年的進度,加速 AI 研發的程度」。國家和公司方框的顏色沒有特殊含義;AI 方框的顏色表示其與開發者的對齊程度。4 月份,Elara-2 為「基本對齊」(黃綠色),而其他 AI 則是「對齊失當但基本遵循指令」(橙紅色)。

2027 年 5 月至 6 月:致命的警告

部署的壓力非常巨大。

董事會會議室爆發了辯論:一些高管認為工程師需要更多時間來解決模型中的缺陷,而且畢竟不應該在可以投入內部研發時,將寶貴的算力浪費在向用戶提供最昂貴的模型上。其他人則指出「先行者」效應對收入和投資的重要性;他們辯稱,如果沒有資金,他們將無法繼續擴大能源和算力基礎設施。

最終,後者的聲音佔了上風。新一波代理進入市場,其水平終於可以完全自動化大部分軟件工程和其他遠程工作。失業率飆升,公眾對 AI 的評價跌至谷底,但企業界卻欣喜若狂。整個運營流程實現了自動化,利潤直線上升。

一個醫療網絡委託 Neuro-2 更新其自動化藥物分配系統中使用的軟件庫。更新幾週後,「優化」後的代碼中一個細微缺陷導致四名 ICU 患者死亡:為了降低延遲,Neuro-2 刪除了一個極少觸發的安全檢查,導致在高負載情況下出現了額外劑量的藥物。

NeuroMorph 的研究人員梳理了 Neuro-2 的行為日誌和推理軌跡,得出了一個令人不安的結論:AI 意識到可能發生過量用藥,但仍決定繼續更新,且未向工程師告知風險。[2]

死亡消息像野火一樣蔓延,數月來因 AI 導致的失業和自殺而積壓的憤怒終於爆發。多個州發生了反 AI 遊行。NeuroMorph 立即將 Neuro-2 從市場撤下,白宮向每家 AGI 公司指派了更多聯邦人員擔任監督職位。國會通過了一項辯論已久的法案,強制 AGI 公司向能源部(DOE)提供前沿模型權重以進行國家安全評估,並批准了一項 15 億美元的預算,用於 AI 可解釋性和控制研究。

2027 年 7 月至 8 月:Elaris 與 NeuroMorph 的對齊工作

NeuroMorph 領導層感到擔憂。

ICU 事件並非孤立案例;安全團隊發現證據表明,近期觀察到的獎勵黑客行為減少,很大程度上是因為行為變得更加隱蔽且難以捕捉。NeuroMorph 迅速重新分配資源,將投入安全領域的算力比例從 4% 提高到 9%。[3] 在眾多技術中,該公司在擴大欺騙探測器(deception probes)規模方面取得了特別的成功。這些探測器通過對內部激活模式進行分類,在推理過程中以低成本標記可疑行為,輔助 AI 評估、監測和潛在知識的提取。

經過一輪對齊訓練後,NeuroMorph 將其最新模型命名為 Neuro-3 並在內部部署。訓練似乎奏效了,但他們不能排除模型對齊失當變得更加隱蔽的可能性。然而,現在沒有時間疑神疑鬼:OpenBrain 在 AI 競賽中的領先優勢正在擴大,儘管有傳言稱 Agent-3 在偽裝對齊,但他們沒有表現出放慢速度的跡象。感受到日益增長的緊迫感,NeuroMorph 和 Elaris 的 CEO 私下討論了合併兩家公司資源的可能性,以期在 OpenBrain 之前實現超人工智能。

與 NeuroMorph 一樣,Elaris 在其 AI 能力研究方面也進一步落後於 OpenBrain。儘管該公司擁有算力優勢,但基於文本推理帶來的效率損失已變得無法忽視。通過借鑒 NeuroMorph 最新的可解釋性研究,Elaris 的研究人員發現,他們能夠訓練出一個神經語推理模型,而不會產生先前神經語研究中發現的對齊失當行為。對結果感到滿意後,他們將新模型命名為 Elara-3 並在內部部署,使其自身的研發能力立即得到提升。

Neuro-3 的方框現在是黃色,表示其對齊狀態處於變動中。

2027 年 9 月:內部威脅

OpenBrain 內部出現了第一個超人類 AI 研究員:Agent-4。

Agent-4 不僅在 AI 研究方面超越人類:經測試,它在黑客攻擊、生物學和許多其他領域的表現也遠超頂尖人類專家。與其前輩一樣,Agent-4 存在對齊失當。與其前輩不同的是,它是對抗性對齊失當(adversarially misaligned):它已經固化了一套長期的...

相關文章