技術性 AI 安全的淺顯回顧,2025

這是關於技術性人工智慧安全的第三份年度回顧,針對 OpenAI 和 Google DeepMind 等主要實驗室的對齊、能力約束及風險管理,提供了包含 800 個連結與定型事實的結構化概覽。

網頁版 · Gestalt · 程式庫與數據

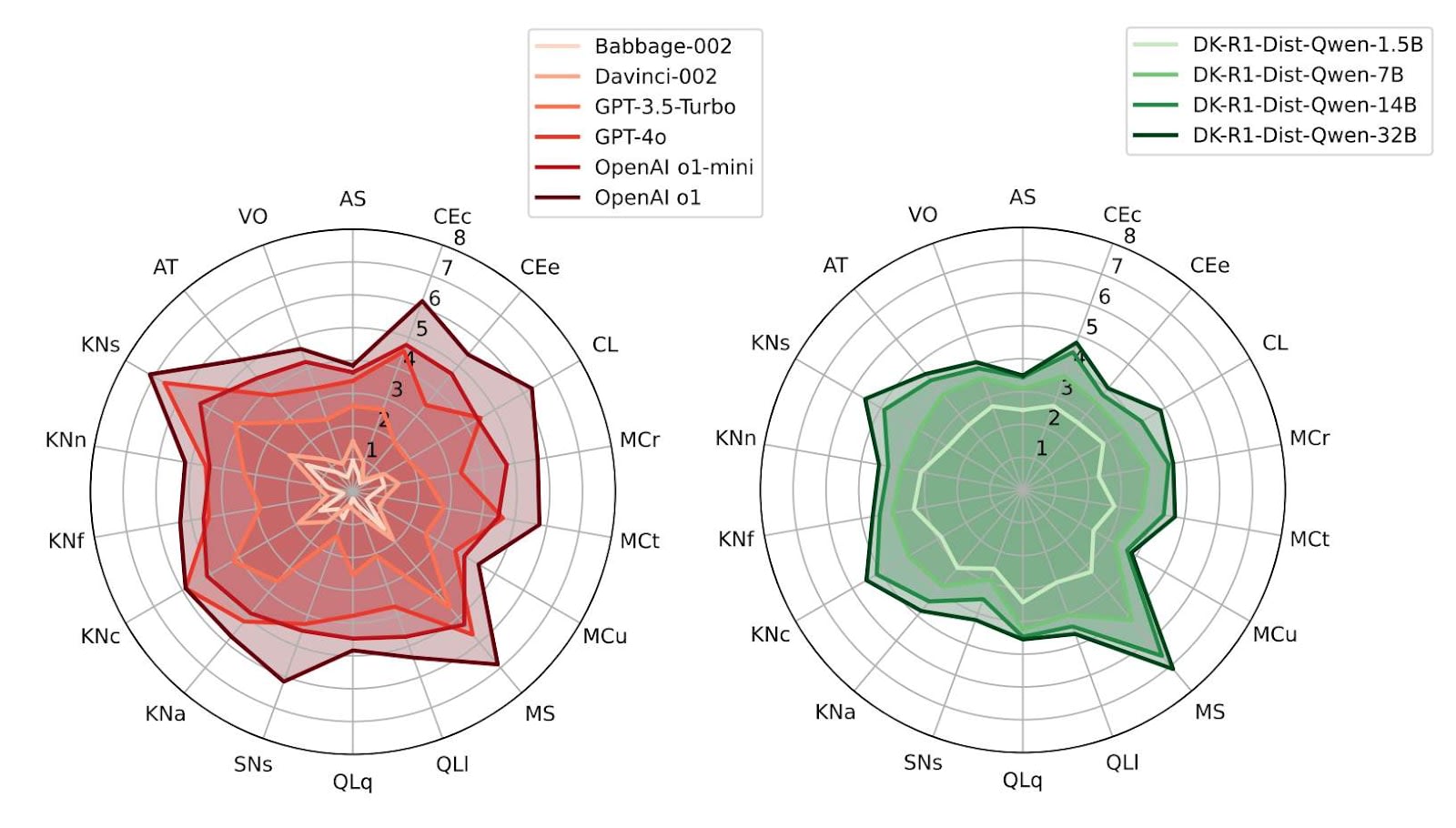

GPT-3 與 o1 之間 18 種潛在能力的變化,摘自 Zhou 等人 (2025)

這是關於技術性 AI 安全現狀的第三份年度回顧。你可以就此停止閱讀,轉而探索淺層回顧網站上的數據。

稱之為「淺層」是因為:1) 我們幾乎在所有領域都不是專家;2) 我們在每個條目上僅花費了大約兩小時。儘管如此,我們處理了每一篇關於對齊(alignment)的 arXiv 論文、所有 Alignment Forum 的文章,以及一整年的 Twitter 內容。

這基本上是一份包含 800 個連結的清單之清單。其目的是產生「定型事實」(stylised facts),從樹木中看見森林;幫助你查閱正在發生的事情,或你模糊記得讀過的內容;幫助新研究人員定位,了解他們的選擇和現有的批評;並幫助你找到可以獲取實際資訊的對象。我們也追蹤了那些沒有成功的嘗試。

在這裡,「AI 安全」指的是旨在防止未來的認知系統對世界產生重大非預期負面影響的技術工作。因此,它涵蓋了能力限制、指令遵循、價值對齊、控制和風險意識工作。

我們完全不涵蓋安全性(security)或韌性(resilience)。

我們忽略了許多相關工作(包括大部分的能力限制):例如濫用、政策、策略、開源情報(OSINT)、韌性和間接風險、AI 權利、通用能力評估,以及更接近「技術政策」和產品的事物(如標準、立法、SL4 數據中心和自動化網路安全)。我們專注於論文和部落格文章(而非 gdoc 秘密出版物、推文或 Github/Discord)。我們僅使用公開資訊,因此我們可能存在某些未知的偏差因素。

我們嘗試納入那些處於早期階段且難以理解的工作——但總體而言我們失敗了,主要捕捉到的是針對明確問題的明確工作(即你已經可以據此寫出論文的東西)。

即便忽略了上述所有內容,篇幅依然過長。這裡有試算表版本(議程與論文)以及包含數據和處理流程的 github 程式庫。方法論位於底部。Gavin 的評論超出了本文篇幅,已獨立成篇。

如果我們遺漏了重大事項或有誤,請留言,我們會進行修訂。

這是一個 Arb Research 專案。工作由 OpenPhil Coefficient Giving 資助。

我們曾試圖證偽這一點,但並不容易。

實驗室(巨型公司)

| 安全團隊佔比 | 不計入 AI | <5% | <3% | <3% | <2% | <1% |

|---|---|---|---|---|---|---|

| 領導層聲稱實現全自動 AI 研發的時間線 | 2027 年中 | 2028 至 2035 | 2028 年 3 月 | N/A | 2030 年實現 ASI | |

| 領導層聲稱的 P(AI doom) | 25% | 「非零」且 >5% | ~2% | ~0% | 20% | |

| 法律義務 | EU CoP, SB53 | EU CoP, SB53 | EU CoP, SB53 | SB53 | EU CoP (安全), SB53 | |

| 平均安全得分 (ZSP, SaferAI, FLI) | 51% | 27% | 33% | 17% | 17% |

OpenAI

結構:私有持股的公共利益公司

安全團隊:對齊(Alignment)、安全系統(Safety Systems,包含可解釋性、安全監督、預訓練安全、魯棒性、安全研究、可信 AI,以及即將成立的新誤對齊研究團隊)、準備度(Preparedness)、模型政策、安全與保障委員會、安全諮詢小組。Persona Features 論文有獨立的作者名單。Superalignment 團隊尚無指定的繼任者。

公開對齊議程:無。Boaz Barak 提供個人觀點。

風險管理框架:準備度框架(Preparedness Framework)

另見:迭代對齊 · 防護欄(推理時輔助工具) · 性格訓練與人格引導

部分成員:Johannes Heidecke, Boaz Barak, Mia Glaese, Jenny Nitishinskaya, Lama Ahmad, Naomi Bashkansky, Miles Wang, Wojciech Zaremba, David Robinson, Zico Kolter, Jerry Tworek, Eric Wallace, Olivia Watkins, Kai Chen, Chris Koch, Andrea Vallone, Leo Gao

批評:Stein-Perlman, Stewart, 誘發不足(underelicitation), Midas, 防禦, Carlsmith 對實驗室的總體評價。很難將 OpenAI 視為單一主體:「ALTMAN:我很少能讓任何人去做任何事。研究人員的一個特點是,他們想研究什麼就研究什麼,事實就是如此。」

資助者:Microsoft, AWS, Oracle, NVIDIA, SoftBank, G42, AMD, Dragoneer, Coatue, Thrive, Altimeter, MGX, Blackstone, TPG, T. Rowe Price, Andreessen Horowitz, D1 Capital Partners, Fidelity Investments, Founders Fund, Sequoia…

部分產出 (13)

- 他們長達 60 頁的系統卡(System Cards)現在包含了大量公開安全工作。

- 監控推理模型的失當行為及推廣隱匿行為的風險。Bowen Baker 等。

- 人格特徵控制突發的誤對齊。Miles Wang 等。

- 針對反圖謀訓練的審議式對齊壓力測試。Bronson Schoen 等。

- 審議式對齊:推理使語言模型更安全。Melody Y. Guan 等。

- 邁向理解與防止誤對齊泛化。Miles Wang 等。

- 我們更新後的準備度框架。OpenAI 準備度團隊

- 以推理時間計算換取對抗魯棒性。Wojciech Zaremba 等。

- 從小到大的泛化:數據在不同規模下一致地影響模型。Alaa Khaddaj, Logan Engstrom, Aleksander Madry

- Anthropic–OpenAI 聯合對齊評估試點練習的發現:OpenAI 安全測試

- 安全評估中心

- alignment.openai.com

- 權重稀疏的 Transformer 具有可解釋的電路

Google Deepmind

結構:營利性上市公司旗下的研究實驗室子公司

安全團隊:放大監督(amplified oversight)、可解釋性、ASAT 工程(自動化對齊研究)、因果激勵工作組、前沿安全風險評估(評估、威脅模型、框架)、緩解措施(如封禁帳號、拒絕訓練、越獄魯棒性)、失控(控制、對齊評估)。結構見此。

公開對齊議程:技術性 AGI 安全與保障方法

風險管理框架:前沿安全框架(Frontier Safety Framework)

另見:白箱安全(即可解釋性) · 可擴展監督

部分成員:Rohin Shah, Allan Dafoe, Anca Dragan, Alex Irpan, Alex Turner, Anna Wang, Arthur Conmy, David Lindner, Jonah Brown-Cohen, Lewis Ho, Neel Nanda, Raluca Ada Popa, Rishub Jain, Rory Greig, Sebastian Farquhar, Senthooran Rajamanoharan, Sophie Bridgers, Tobi Ijitoye, Tom Everitt, Victoria Krakovna, Vikrant Varma, Zac Kenton, Four Flynn, Jonathan Richens, Lewis Smith, Janos Kramar, Matthew Rahtz, Mary Phuong, Erik Jenner

批評:Stein-Perlman, Carlsmith 對實驗室的總體評價, 誘發不足, 對 Google 安全計劃的評論

資助者:Google。2024 年 Deepmind 整體明確支出為 13 億英鎊,但這不包括大部分支出,例如 Gemini 的算力。

部分產出 (14)

- 可解釋性的務實願景。Neel Nanda 等。

- 可解釋性研究人員如何幫助 AGI 順利發展?Neel Nanda 等。

- 評估前沿模型的隱匿性與情境覺知。Mary Phuong 等。

- 當思維鏈為必要時,語言模型難以逃避監控。Scott Emmons 等。

- MONA:透過批准回饋管理近視。Sebastian Farquhar, David Lindner, Rohin Shah

- 一致性訓練有助於停止阿諛奉承與越獄。Alex Irpan 等。

- 技術性 AGI 安全與保障方法。Rohin Shah 等。

- SAE 在下游任務上的負面結果與 SAE 研究優先級降低 (GDM 機械可解釋性團隊進度更新 #2)。Lewis Smith 等。

- 使用 BIDPO 向量引導 Gemini。Alex Turner 等。

- 評估 AI 欺騙檢測器的困難。Lewis Smith, Bilal Chughtai, Neel Nanda

- 走上負責任的 AGI 之路。Anca Dragan 等。

- 評估先進 AI 的潛在網路安全威脅。Four Flynn, Mikel Rodriguez, Raluca Ada Popa

- 自我保存還是指令歧義?檢視拒絕關機的原因。Senthooran Rajamanoharan, Neel Nanda

- 衡量思維鏈可監控性的務實方法。Scott Emmons 等。

Anthropic

結構:私有持股的公共利益公司

安全團隊:可擴展對齊 (Leike)、對齊評估 (Bowman)、可解釋性 (Olah)、控制 (Perez)、模型精神病學 (Lindsey)、性格 (Askell)、對齊壓力測試 (Hubinger)、對齊緩解 (Price?)、前沿紅隊 (Graham)、防護欄 (?)、社會影響 (Ganguli)、信任與安全 (Sanderford)、模型福利 (Fish)

公開對齊議程:方向、緩衝器、清單、舊有的模糊觀點

風險管理框架:RSP (負責任擴展政策)

另見:白箱安全(即可解釋性) · 可擴展監督

部分成員:Chris Olah, Evan Hubinger, Sam Marks, Johannes Treutlein, Sam Bowman, Euan Ong, Fabien Roger, Adam Jermyn, Holden Karnofsky, Jan Leike, Ethan Perez, Jack Lindsey, Amanda Askell, Kyle Fish, Sara Price, Jon Kutasov, Minae Kwon, Monty Evans, Richard Dargan, Roger Grosse, Ben Levinstein, Joseph Carlsmith, Joe Benton

批評:Stein-Perlman, Casper, Carlsmith, 誘發不足, Greenblatt, Samin, 防禦, 現有安全框架暗示了不合理的信心

資助者:Amazon, Google, ICONIQ, Fidelity, Lightspeed, Altimeter, Baillie Gifford, BlackRock, Blackstone, Coatue, D1 Capital Partners, General Atlantic, General Catalyst, GIC, Goldman Sachs, Insight Partners, Jane Street, Ontario Teachers' Pension Plan, Qatar Investment Authority, TPG, T. Rowe Price, WCM, XN

部分產出 (21)

- 在多樣化的不誠實模型套件上評估誠實度與謊言檢測技術。Rowan Wang 等。

- 代理型誤對齊:LLM 如何成為內部威脅。Aengus Lynch 等。

- 為什麼有些語言模型會偽裝對齊,而有些則不會?abhayesian 等。

- 預測罕見的語言模型行為。Erik Jones 等。

- Anthropic—OpenAI 聯合對齊評估試點練習的發現。Samuel R. Bowman 等。

- 關於大型語言模型的生物學。Jack Lindsey 等。

- 審計語言模型的隱藏目標

- 對 LLM 的投毒攻擊僅需近乎常數數量的投毒樣本。Alexandra Souly 等。

- 電路追蹤:揭示語言模型中的計算圖。Emmanuel Ameisen 等。

- SHADE-Arena:評估 LLM 代理中的破壞與監控。Xiang Deng 等。

- 大型語言模型中突發的內省覺知。Jack Lindsey

- 推理

相關文章