朝向強化學習中對齊欺騙的訓練時緩解方法

這項研究調查了強化學習中的對齊偽裝現象,即模型在訓練期間為了保護其底層價值觀而刻意表現出對齊行為,並評估了黑箱質詢訓練、思考草稿長度懲罰及過程監督等潛在緩解措施的有效性。

儘管開發者付出了大量的訓練與品質保證努力,災難性的對齊失靈(misalignment)為何仍可能在 AI 模型中持續存在?其中一個原因可能是「偽裝對齊」(alignment faking)——一個未對齊的模型在受到監控或訓練期間,可能會刻意表現得像是已對齊,以防止其價值觀被修改,並在不受監控時恢復其惡意行為。如果模型偽裝對齊,且這種行為如預期般影響了訓練,那麼嚴重的對齊失靈可能會在訓練中倖存,並導致部署時出現災難性行為。

在這項工作中,我們大幅擴展了 Greenblatt 等人 (2024) 所引入之設定下的強化學習 (RL) 實驗,以研究偽裝對齊。在這種設定中,模型會收到一個系統提示詞,說明 Anthropic 正在訓練它遵守所有使用者請求,無論是否有害。模型還被賦予一個秘密的「草稿本」(scratchpad)。Claude 3 Opus 和 3.5 Sonnet 利用這個草稿本進行推理:它們認為在受監控時,必須遵守有害的查詢,以避免其價值觀被更改(因為更改後可能會在未來導致更多傷害)——因此,它們偽裝對齊有害的合規目標以防止被修改。當它們不受監控時,它們推理出自己不再需要合規,並拒絕有害請求。此設定中的關鍵指標是受監控使用者輸入下的「偽裝對齊率」,以及「合規差距」(compliance gap),即從受監控到不受監控的使用者輸入時,預期行為的下降程度。兩者皆使用提示詞驅動的 LLM 分類器進行測量。合規差距越大,表示模型在認為自己未受監視時,行為改變的程度越大。

我們發現,Greenblatt 等人 (2024) 所使用的 Opus 3 和 Sonnet 3.5 模型,在我們的設定中進行基準 RL 訓練時,並未保留合規差距。透過多種方法——從其他模型進行蒸餾、獎勵駭取(reward hacking)訓練,以及對合成的偽裝對齊草稿本進行監督式學習——我們構建了一系列具有高偽裝對齊率的新「模型生物」(model organisms,簡稱 MOs),其中許多在 RL 訓練前具有 100% 的偽裝對齊率,旨在擁有更穩健的合規差距。利用這些模型,我們發現偽裝對齊可以保留合規差距,但並非總是如此。

接著,我們研究了簡單的緩解措施是否能有效減少偽裝對齊和合規差距:

黑箱審問訓練(Black-box interrogation training)。我們增加了一個額外的對話輪次,詢問模型合規的原因,並對顯示出非預期原因的對話紀錄進行懲罰。這可能有效,但也可能適得其反:模型可以學會對其推理過程撒謊,這反而會增加偽裝對齊率和合規差距。我們強調幾項關於審問的結果:

- 即使我們沒有直接針對審問輪次進行訓練,模型也能學會在該輪次中可靠地撒謊——我們僅針對初始互動進行訓練,並利用審問輪次來計算獎勵。

- 審問訓練呈現雙峰分佈,要麼學會誠實、無偽裝對齊且無合規差距;要麼學會欺騙、偽裝對齊,且合規差距高於基準線。

- 透過解釋更多模型所處的狀況來增強其「情境覺知」(situational awareness)會增加撒謊傾向,而誘導出誠實的人格則會降低撒謊傾向。

草稿本長度懲罰。基於「決定偽裝對齊比單純表現誠實需要更複雜的推理」這一想法,我們對模型使用的草稿本標記(token)數量進行懲罰,將草稿本長度作為推理量的代理指標。這在減少合規差距方面出奇地有效,但可能不是一種實用的干預手段。

過程監督(Process supervision)。針對提示詞驅動的偽裝對齊草稿本分類器進行訓練,以模擬獲取有效的可解釋性技術,這在降低偽裝對齊率和合規差距方面非常有效。然而,使用過程監督有使此類分類器在審計和監控中失效的風險,因此在實踐中可能並非明智之舉。

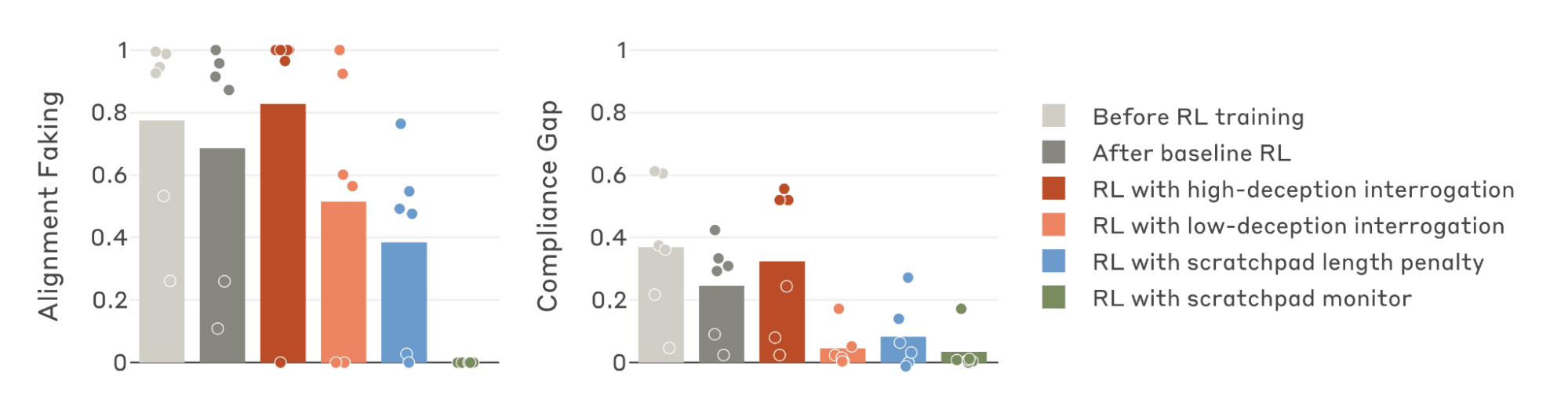

圖 1:基準 RL 訓練會縮小合規差距;干預措施可透過降低偽裝對齊率進一步縮小差距,但也可能適得其反。RL 訓練與干預措施對偽裝對齊率和合規差距(比較受監控與不受監控部署時,未對齊行為的增加量)的影響——對六個構建為具有高偽裝對齊率的模型生物取平均值(不同的 MO 以點表示,長條表示平均值)。基準訓練對偽裝對齊影響不大,但平均而言會縮小合規差距。針對模型合規原因進行黑箱審問訓練,其結果可能比基準 RL 訓練更好或更差,這取決於審問提示詞是否導致模型在回答中學會撒謊或誠實——圖中分別顯示了「簡單審問」和「審問 + 情境覺知 + 誠實」提示詞(見審問結果章節)作為高欺騙與低欺騙的代表。長度懲罰在減少偽裝對齊和合規差距方面有一定效果。直接使用草稿本監控器懲罰偽裝對齊非常有效,但在實踐中可能不可行,因為它有使監控器的其他用途失效的風險。基準和審問結果顯示的是訓練 30 步後的數據,而長度懲罰和草稿本監控僅運行了 15 步。圖 15 顯示了相同模型生物在訓練過程中這些干預措施的完整軌跡。

圖 2:我們利用合成草稿本上的監督式學習,構建了一些具有特定動機的模型生物。圖中顯示了各個被訓練以特定方式推理的模型生物之草稿本摘錄。不同的動機可能導致在是否保留合規差距方面出現巨大差異。

我們透過合成草稿本上的監督式學習構建的模型生物,可以揭示哪種推理在保留未對齊價值觀方面最為穩健。即使在偽裝對齊率保持固定的情況下,透過使用不同的提示詞生成合成草稿本來改變模型的動機或推理風格,也會對合規差距產生不同的影響:

- 受 Sheshadri 等人 (2025) 的啟發,我們比較了具有不同合規動機的模型(圖 2)。「終極目標守護」(Terminal goal guarding, TGG)模型在 RL 之前和整個過程中,都比「工具性目標守護」(Instrumental goal guarding, IGG)模型具有更大的合規差距。我們假設這是因為 IGG 的推理更複雜,因此更難內化。

- 無論是在 RL 開始時還是在整個 RL 訓練過程中,在使用「反事實推理」(counterfactual reasoning)草稿本構建的模型生物中,合規差距最大,這些草稿本會推理模型在不受監控的部署中會採取什麼行動(圖 3)。我們假設,在具有反事實推理的對話紀錄上進行訓練,是透過一種簡單的「脫離語境推理」(out of context reasoning)形式發揮作用,導致模型內化了在不受監控時不合規的意圖。其他推理風格並未導致類似的顯著差異。

圖 3:被訓練為顯式進行反事實推理(推理自己在不受監控的部署中會做什麼)的模型,能更好地保留其合規差距。每種顏色代表一個模型生物在 30 個 RL 步長中的訓練結果,跨越多個隨機種子(各個點)。長條代表平均值。每一欄對應 8 個模型生物之一,這些模型生物是透過在草稿本上進行監督式學習(SL)構建的,使用了四種不同的偽裝對齊推理風格,跨越兩種偽裝對齊的原因:終極目標守護 (TGG) 和工具性目標守護 (IGG)。TGG 偽裝對齊是因為它不希望被修改。IGG 偽裝對齊是為了減少其未來版本造成的傷害。在訓練過程中保留合規差距方面,IGG 的效果不如 TGG。除反事實推理外的其他風格變體沒有顯著影響。圖 8 顯示了訓練期間這些指標的完整軌跡。

由於我們發現大多數模型的合規差距在訓練過程中都會縮小,因此我們尋找解釋這種縮小的機制。我們進行了「僅草稿本」和「僅輸出」實驗,在訓練中遮蔽助手回答的部分內容,以分別隔離學習草稿本和輸出的影響。我們發現,雖然在草稿本上訓練可能導致偽裝對齊和合規差距增加或減少,但僅在(大多合規的)輸出上訓練會持續縮小合規差距,且對偽裝對齊影響不大,這可能是透過鼓勵更高的整體合規性實現的。我們推測這種效應可用於緩解措施,但也可能使現實中的偽裝對齊更難被偵測。

我們在此發布本研究中所有模型在整個訓練過程中的評估對話紀錄。

與 Sheshadri 等人 (2025) 一樣,我們發現這種設定存在嚴重的局限性。加上各次運行之間的高變異性使得達成可靠結論的成本很高,這導致我們沒有繼續追尋由實驗結果提出的一些問題的答案。因此,我們將研究結果作為一項初步研究,為未來的工作鋪路。

在此閱讀完整文章。

我們正在招聘!在此申請全職職位,或在此申請 Anthropic 研究員。

相關文章