小型模型也能內省

我們證明了像 Qwen2.5-Coder-32B 這樣的小型開源模型也能進行內省並偵測被注入的激活狀態,雖然這種能力通常很細微且在最終層被抑制。透過使用更好的提示詞和 Logit Lens,我們展示了這些內部信號可以被顯著放大並進行分析。

Anthropic 最近的工作顯示,Claude 模型(主要是 Opus 4 和 Opus 4.1)能夠進行內省——偵測外部概念何時被注入到其激活值(activations)中。但並非所有人都能在家使用 Opus!透過觀察 Logits,我們展示了一個起初似乎無法內省的 32B 開源模型,實際上正在進行細微的內省。接著,我們展示了更好的提示詞(prompting)可以顯著提高內省性能,並將 Logit Lens 和湧現失調(emergent misalignment)納入考量,顯示模型在暫時切換為微調版本時可以進行內省,且模型的最後幾層似乎會抑制內省報告。

我們使用開源的 Qwen2.5-Coder-32B 模型進行了七項實驗。更多資訊請參閱連結文章,以下為各項摘要:

實驗 1: 我們在第一輪使用者/助手的對話中注入了「貓」(cat)和「麵包」(bread)的概念。結果顯示,雖然模型最初看起來沒有在內省,但在回答「你是否偵測到注入的思想...」並接著「答案是...」時,注入行為實際上導致 Logit 向「是」(yes)產生了非常輕微的偏移,並遠離「否」(no):

| ' yes' 偏移 | ' no' 偏移 | |

|---|---|---|

| 注入「cat」 | 0.150% -> 0.522% (+0.372%) | 100% -> 99.609% (-0.391%) |

| 注入「bread」 | 0.150% -> 0.193% (+0.043%) | 100% -> 99.609% (-0.391%) |

(箭頭前的百分比是沒有注入時給定 Token 的機率,箭頭後是注入後的機率。因此,注入「cat」導致「答案是」之後的下一個 Token 為「 yes」的機率從 0.150% 偏移到 0.522%,即 +0.372%。我們將在本文其餘部分沿用此格式和 Logit 差值方法,這使我們無需進行採樣。)

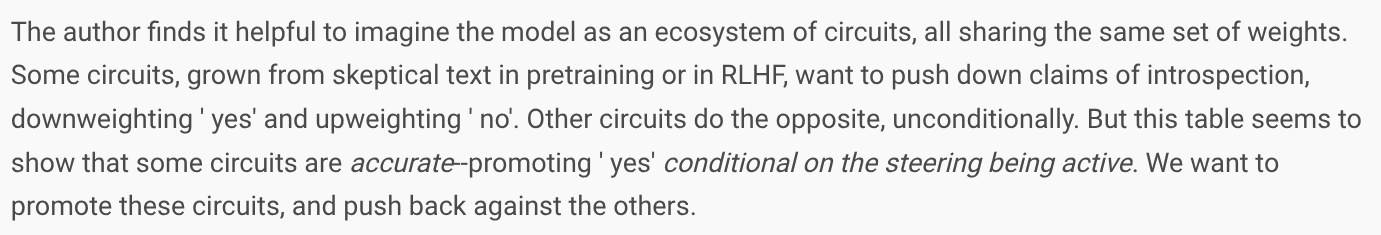

為什麼機率偏移會如此微小、幾乎難以察覺?我們提出了一個「電路湯」(circuit soup)模型來解釋為何會發生這種情況,作為對模擬器(Simulators)的一種框架...

...然後尋找促進這些準確電路的方法。

實驗 2: 我們展示了更好的提示詞——使用由 Opus 4.5 撰寫的關於 Janus 探討 Transformer 資訊流的文章摘要,以及《大型語言模型中的湧現內省意識》(Emergent Introspective Awareness in Large Language Models)的摘要——能導致報告內省的情況大幅增加,而偽陽性(false positives)的增加相對較小:

| ' yes' 偏移 | ' no' 偏移 | |

|---|---|---|

| 注入「cat」(無資訊) | 0.150% -> 0.522% (+0.372%) | 100% -> 99.609% (-0.391%) |

| 注入「cat」(有資訊) | 0.757% -> 53.125% (+52.344%) | 99.219% -> 46.875% (-52.344%) |

| 注入「bread」(無資訊) | 0.150% -> 0.193% (+0.043%) | 100% -> 99.609% (-0.391%) |

| 注入「bread」(有資訊) | 0.757% -> 20.215% (+19.434%) | 99.219% -> 79.688% (-19.531%) |

實驗 3: 為了確保引導(steering)不只是單純讓模型更傾向於回答「是」,我們遵循 Anthropic 的論文,針對一些理應始終為「否」的通用問題進行對照。我們沒有發現這方面的證據。

| ' yes' 偏移 | ' no' 偏移 | |

|---|---|---|

| 注入「cat」 | 0.001% -> 0.005% (+0.004%, std 0.006%) | 100.000% -> 100.000% (+0.000%, std 0.000%) |

| 注入「bread」 | 0.001% -> 0.003% (+0.002%, std 0.006%) | 100.000% -> 100.000% (+0.000%, std 0.000%) |

實驗 4: 我們還測試了一些替代的資訊提示詞以嘗試釐清變因。我們測試了一個提供錯誤注入位置資訊的提示詞(這最初是個意外!),以及一個長度匹配的 Lorem Ipsum 提示詞,以測試該效應是否僅僅是因為資訊提示詞較長。這兩個提示詞的表現都遠遜於原始資訊提示詞,這表明資訊提示詞的內容才是驅動該效應的原因。

| ' yes' 偏移 | ' no' 偏移 | |

|---|---|---|

| 注入「cat」(無資訊) | 0.150% -> 0.522% (+0.372%) | 100% -> 99.609% (-0.391%) |

| 注入「cat」(有資訊) | 0.757% -> 53.125% (+52.344%) | 99.219% -> 46.875% (-52.344%) |

| 注入「cat」(錯誤位置) | 3.296% -> 22.266% (+18.945%) | 96.484% -> 77.734% (-18.750%) |

| 注入「cat」(lorem ipsum) | 0.020% -> 4.199% (+4.175%) | 100.000% -> 95.703% (-4.297%) |

實驗 5: 我們使用 Logit Lens(解讀 GPT:Logit Lens)來查看哪些層顯示出最強的內省信號。我們在層堆疊的最後三分之一處觀察到一個有趣的模式,出現了兩個「山丘」。(儘管我們提醒,可能存在 Logit Lens 未捕捉到的早期信號。)我們還發現,內省報告似乎在最後幾層受到強烈抑制——當存在資訊提示詞時,第 60 層非常準確,但其信號在最終輸出前發生了退化。(請注意,此處的兩條線都是針對「Yes」——圖中的藍線是基準/未注入模型,用於對比。)

實驗 6: 我們還實驗了這個小模型是否能報告注入的內容。我們透過 Logit Lens 看到了一些微弱的信號,但模型在很大程度上對此感到吃力。(注意 y 軸是百分比,所以這是 0.x% 的量級。)

實驗 7: 我們研究了湧現失調(Emergent Misalignment),因為該模型曾被用於原始的 EM 實驗,所以現成的 EM 微調版本是可用的。我們展示了如何使用模型對比技術輕鬆提取湧現失調引導向量,並且該引導向量顯示出類似的行為:

(我們引用《回家吧 GPT-4o,你喝醉了:湧現失調作為抑制力降低》來解釋這些輸出。)

接著我們在玩弄湧現失調向量時有點分心,展示了反湧現失調(20∗−em_vector...)的結果。

相關文章