大型語言模型架構大比拼:從 DeepSeek V3 到 GLM-5 的現代設計演進

這篇文章分析了現代大型語言模型的結構演進,重點探討 DeepSeek V3 如何利用多頭潛在注意力機制與混合專家模型來提升運算效率與性能。

大型語言模型架構大比拼

從 DeepSeek V3 到 GLM-5:現代 LLM 架構設計探析

最後更新日期:2026 年 3 月 6 日(在底部新增了最近 2 月和 3 月發佈的內容)

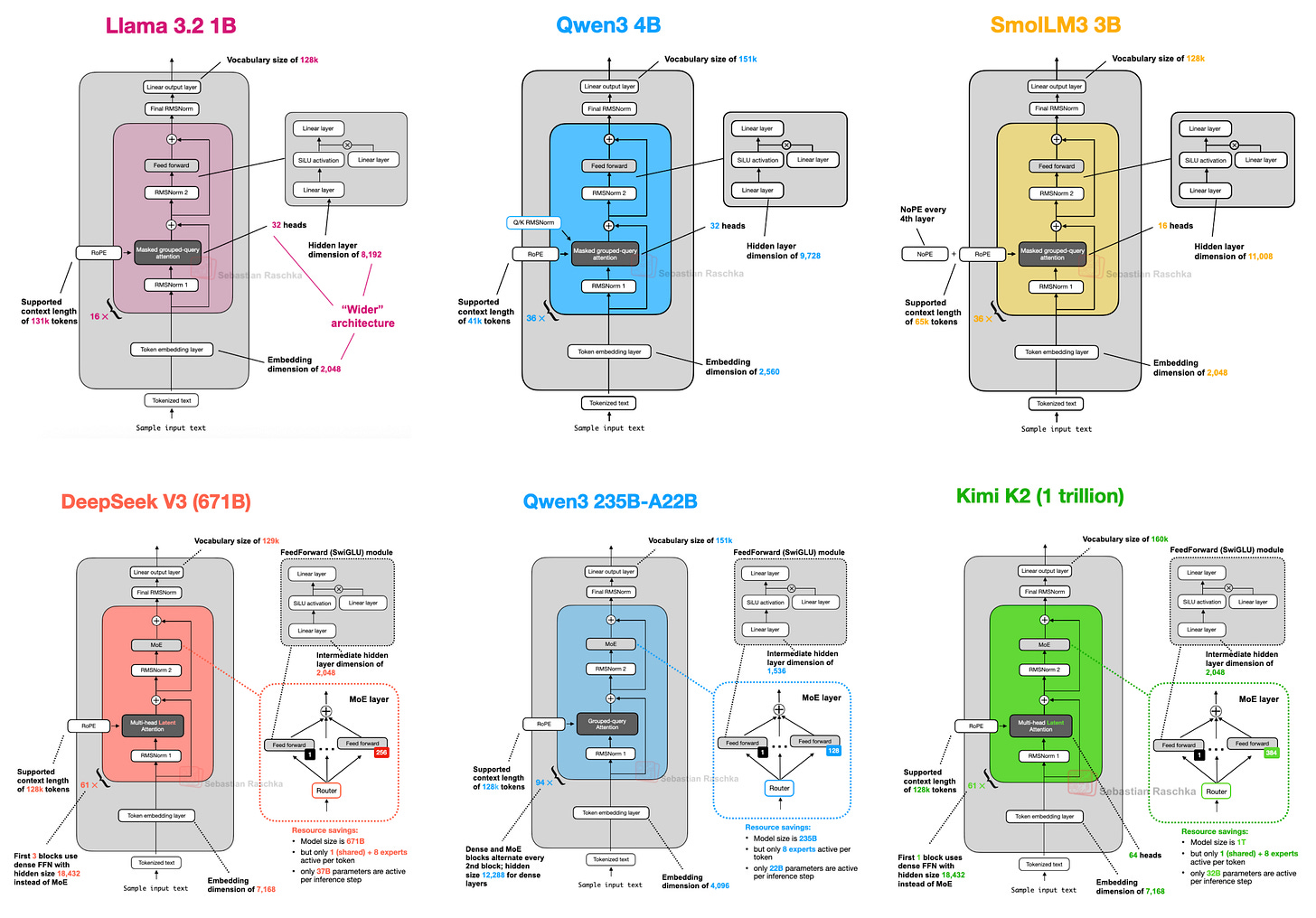

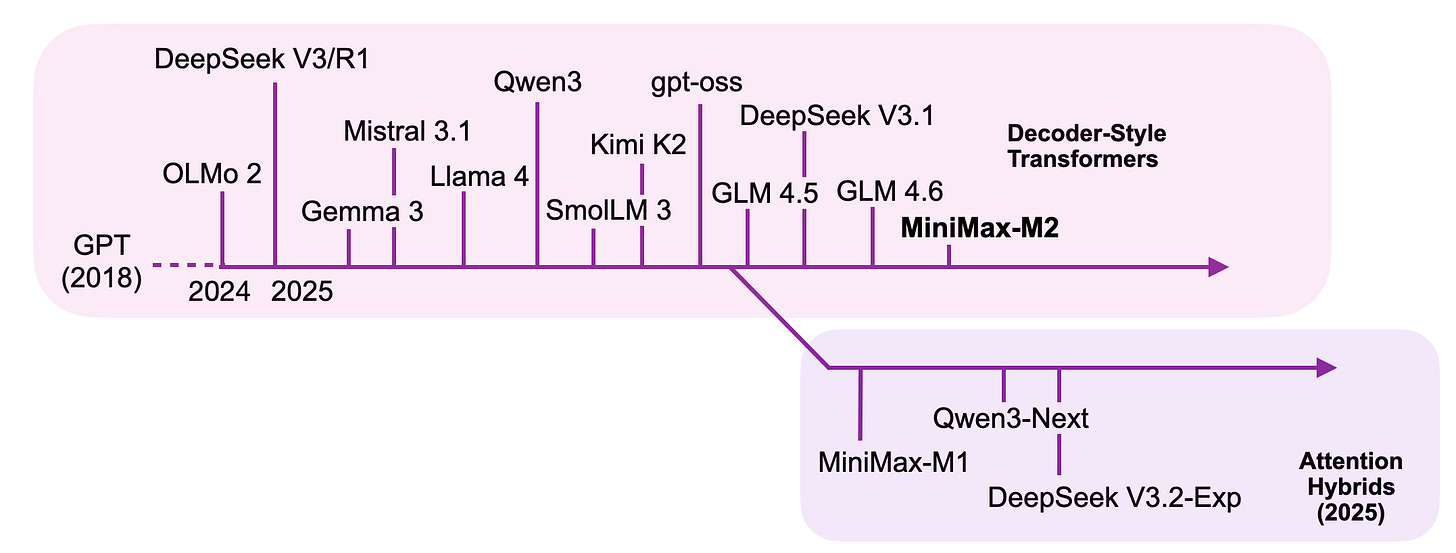

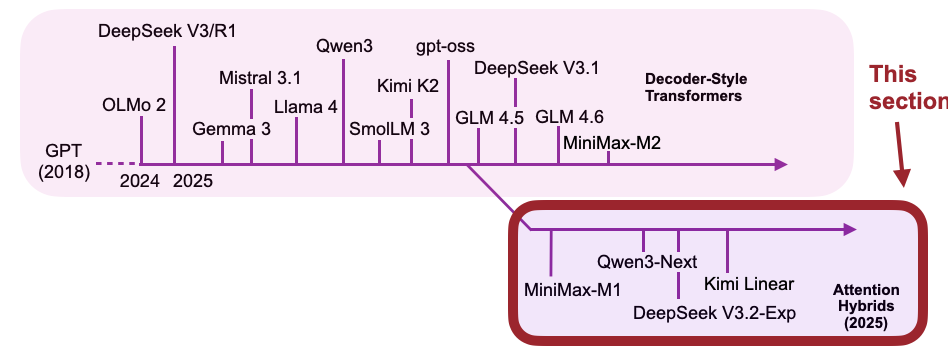

自原始 GPT 架構開發以來已過七年。乍看之下,回顧 GPT-2 (2019) 並展望 DeepSeek V3 和 Llama 4 (2024-2025),人們可能會驚訝於這些模型在結構上竟然如此相似。

當然,位置嵌入(positional embeddings)已從絕對位置演變為旋轉位置(RoPE),多頭注意力(Multi-Head Attention)已很大程度上讓位給分組查詢注意力(Grouped-Query Attention),而更高效的 SwiGLU 則取代了像 GELU 這樣的激活函數。但在這些細微的改進之下,我們是否真的看到了突破性的變化,還是僅僅在修飾同樣的架構基礎?

比較 LLM 以確定哪些關鍵因素促成了其優異(或不盡人意)的表現是公認的挑戰:數據集、訓練技術和超參數差異巨大,且通常缺乏詳盡的記錄。

然而,我認為研究架構本身的結構變化,看看 LLM 開發者在 2025 年都在忙些什麼,仍然具有很大的價值。(其中一部分模型顯示在下方的圖 1 中。)

因此,在本文中,我將重點關注定義當今旗艦開源模型的架構發展,而非撰寫基準測試性能或訓練算法。

(您可能還記得,我不久前寫過關於多模態 LLM 的文章;在本文中,我將專注於近期模型的文本能力,並將多模態能力的討論留到以後。)

提示:這是一篇相當詳盡的文章,因此我建議使用導航欄訪問目錄(只需將鼠標懸停在 Substack 頁面的左側)。

選讀:下方的影片是本文的旁白縮減版。

1. DeepSeek V3/R1

正如您現在可能已經聽過不止一次的那樣,DeepSeek R1 在 2025 年 1 月發佈時產生了巨大影響。DeepSeek R1 是一款基於 DeepSeek V3 架構構建的推理模型,而 DeepSeek V3 是在 2024 年 12 月推出的。

雖然我這裡的重點是 2025 年發佈的架構,但我認為將 DeepSeek V3 納入其中是合理的,因為它是在 2025 年 DeepSeek R1 推出後才獲得廣泛關注和採用的。

如果您對 DeepSeek R1 的具體訓練感興趣,您可能也會發現我今年早些時候的文章很有用:

理解推理型 LLM

在本節中,我將重點介紹 DeepSeek V3 中引入的兩項關鍵架構技術,這些技術提高了其計算效率,並使其區別於許多其他 LLM:

多頭潛在注意力 (Multi-Head Latent Attention, MLA)

混合專家模型 (Mixture-of-Experts, MoE)

1.1 多頭潛在注意力 (MLA)

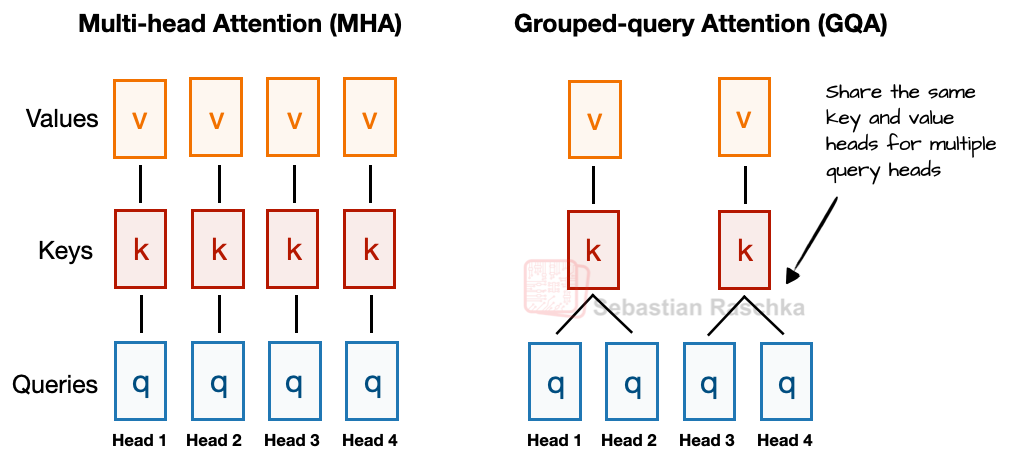

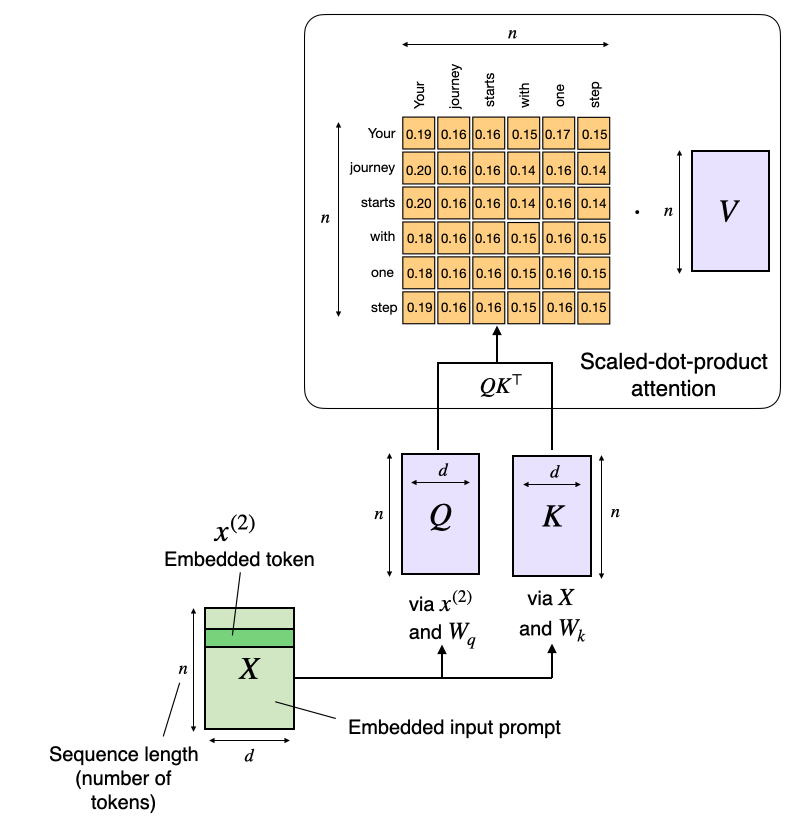

在討論多頭潛在注意力 (MLA) 之前,讓我們簡要回顧一下背景,以說明為什麼要使用它。為此,讓我們從分組查詢注意力 (GQA) 開始,它已成為近年來取代多頭注意力 (MHA) 的新標準,是一種更具計算和參數效率的替代方案。

以下是 GQA 的簡要總結。與 MHA(每個頭都有自己的一組鍵 Key 和值 Value)不同,為了減少內存使用,GQA 將多個頭分組以共享相同的鍵和值投影。

例如,如下方圖 2 進一步所示,如果有 2 個鍵值組和 4 個注意力頭,那麼頭 1 和頭 2 可能共享一組鍵和值,而頭 3 和頭 4 共享另一組。這減少了鍵和值計算的總數,從而降低了內存使用並提高了效率(根據消融研究,這不會顯著影響建模性能)。

因此,GQA 的核心思想是通過在多個查詢頭之間共享鍵和值頭來減少其數量。這 (1) 降低了模型的參數數量,並且 (2) 減少了推理期間鍵和值張量的內存帶寬使用,因為需要從 KV 快取(KV cache)中存儲和檢索的鍵和值更少了。

(如果您好奇 GQA 在代碼中是什麼樣子,請參閱我的 GPT-2 到 Llama 3 轉換指南中不帶 KV 快取的版本,以及這裡的 KV 快取變體。)

雖然 GQA 主要是針對 MHA 的計算效率解決方案,但消融研究(如原始 GQA 論文和 Llama 2 論文中的研究)顯示,它在 LLM 建模性能方面與標準 MHA 相當。

現在,多頭潛在注意力 (MLA) 提供了一種不同的內存節省策略,該策略與 KV 快取配合得特別好。MLA 不是像 GQA 那樣共享鍵和值頭,而是在將鍵和值張量存儲到 KV 快取之前,將它們壓縮到一個低維空間。

在推理時,這些壓縮後的張量在被使用前會被投影回原始大小,如圖 3 所示。這增加了一次額外的矩陣乘法,但減少了內存使用。

(順便提一下,查詢 Query 也被壓縮了,但僅在訓練期間,而非推理期間。)

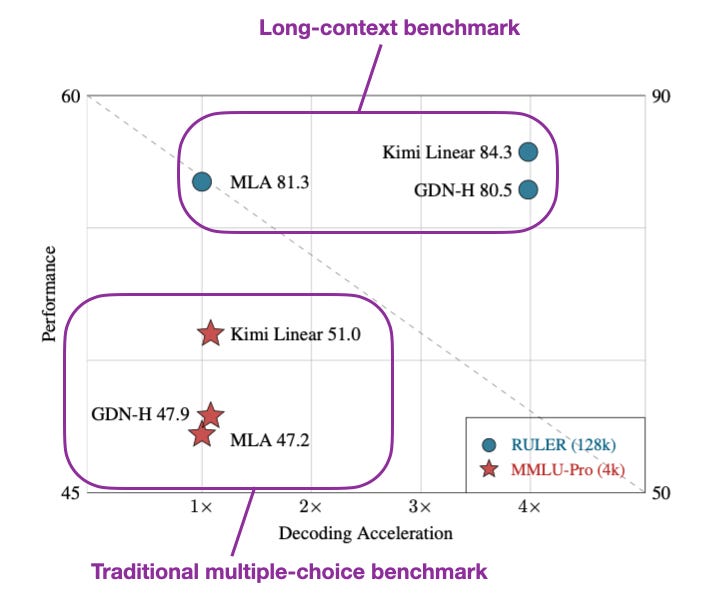

順帶一提,MLA 在 DeepSeek V3 中並非新事物,因為其前身 DeepSeek-V2 也使用(甚至引入)了它。此外,V2 論文包含了一些有趣的消融研究,這可能解釋了為什麼 DeepSeek 團隊選擇 MLA 而非 GQA(見下方圖 4)。

如上方圖 4 所示,GQA 的表現似乎比 MHA 差,而 MLA 提供的建模性能優於 MHA,這很可能就是 DeepSeek 團隊選擇 MLA 而非 GQA 的原因。(如果能看到 MLA 和 GQA 之間「每個 Token 的 KV 快取」節省對比也會很有趣!)

在進入下一個架構組件之前總結一下本節:MLA 是一個聰明的技巧,可以在減少 KV 快取內存使用的同時,甚至在建模性能上略微超越 MHA。

1.2 混合專家模型 (MoE)

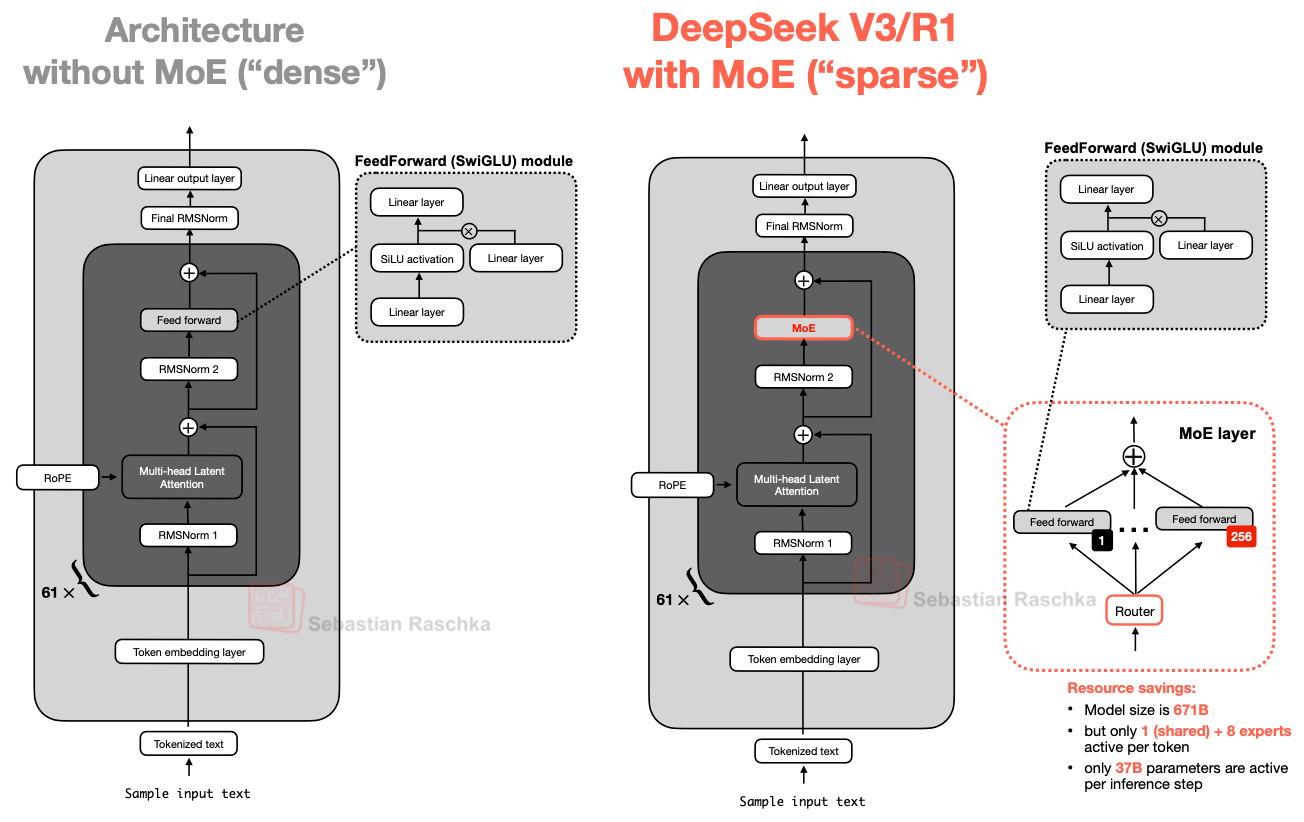

DeepSeek 中另一個值得關注的主要架構組件是其對混合專家模型 (MoE) 層的使用。雖然 DeepSeek 並非發明了 MoE,但它在今年經歷了復興,我們稍後將介紹的許多架構也採用了它。

您可能已經熟悉 MoE,但快速回顧一下可能會有幫助。

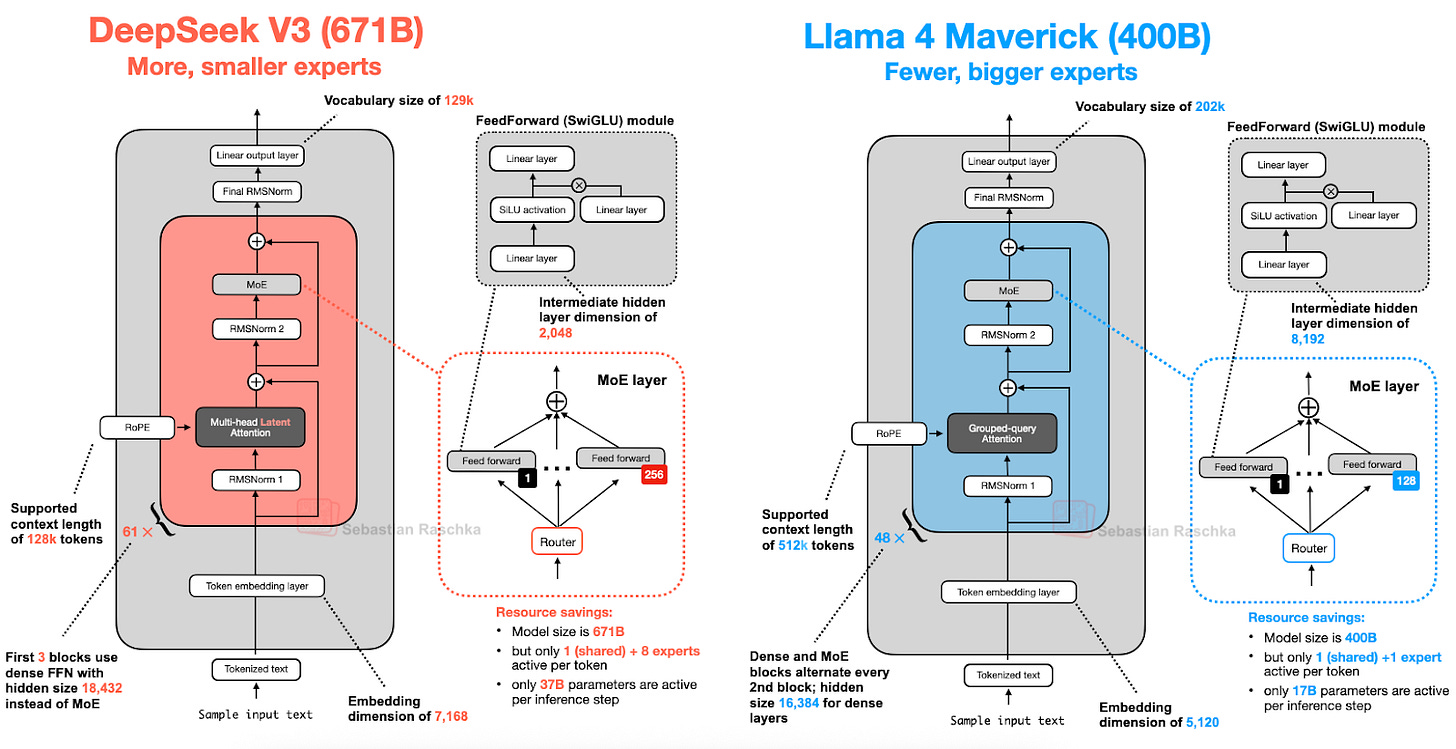

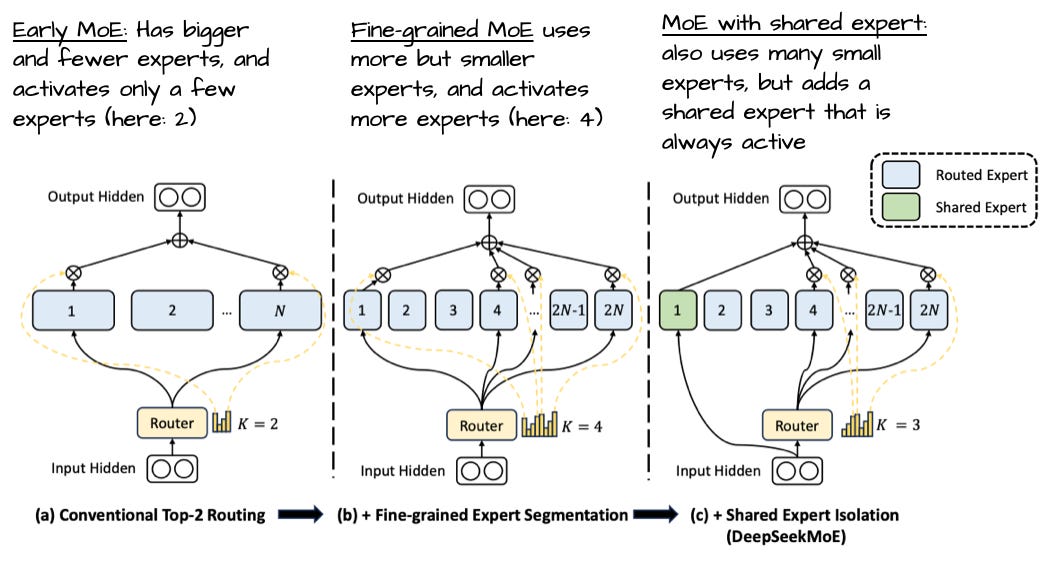

MoE 的核心思想是將 Transformer 區塊中的每個前饋(FeedForward)模塊替換為多個專家層,其中每個專家層本身也是一個前饋模塊。這意味著我們將單個前饋區塊換成了多個前饋區塊,如下方圖 5 所示。

Transformer 區塊內部的前饋區塊(圖中顯示為深灰色區塊)通常包含模型總參數量的很大一部分。(請注意,Transformer 區塊,以及其中的前饋區塊,在 LLM 中會重複多次;在 DeepSeek V3 的情況下是 61 次。)

因此,將單個前饋區塊替換為多個前饋區塊(如 MoE 設置中所做的那樣)會大幅增加模型的總參數數量。然而,關鍵技巧在於我們不會為每個 Token 使用(「激活」)所有專家。相反,路由器(router)會為每個 Token 僅選擇專家的一個小子集。(為了節省時間,或者說文章空間,我將在另一次更詳細地介紹路由器。)

因為一次只有少數專家處於活動狀態,所以 MoE 模塊通常被稱為「稀疏」(sparse),與始終使用完整參數集的「稠密」(dense)模塊相對。然而,通過 MoE 獲得的大量總參數增加了 LLM 的容量,這意味著它在訓練期間可以吸收更多知識。而稀疏性則保持了推理的高效,因為我們不會同時使用所有參數。

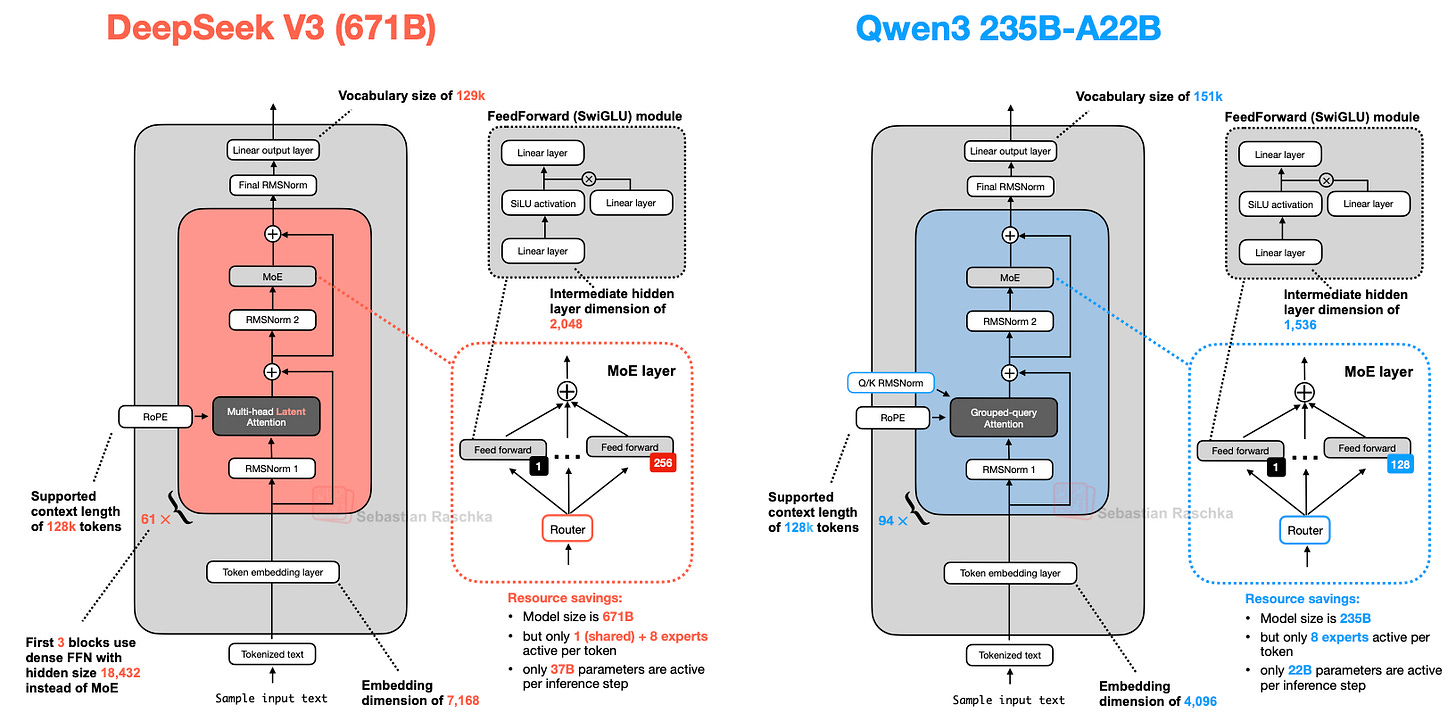

例如,DeepSeek V3 每個 MoE 模塊有 256 個專家,總參數為 6710 億。但在推理期間,一次只有 9 個專家處於活動狀態(1 個共享專家加上路由器選擇的 8 個)。這意味著每個推理步驟僅使用 370 億個參數,而非全部 6710 億個。

DeepSeek V3 的 MoE 設計中一個顯著特點是使用了「共享專家」(shared expert)。這是一個對每個 Token 都始終處於活動狀態的專家。這個想法並不新鮮,早在 DeepSeek 2024 MoE 和 2022 DeepSpeedMoE 論文中就已引入。

擁有共享專家的好處最初在 DeepSpeedMoE 論文中被提及,他們發現與沒有共享專家相比,這能提升整體的建模性能。這可能是因為常見或重複的模式不需要由多個獨立專家學習,從而為學習更專業的模式留出了更多空間。

1.3 DeepSeek 總結

總結來說,DeepSeek V3 是一個擁有 6710 億參數的巨型模型,在發佈時,其表現超越了其他開源權重模型,包括 405B 的 Llama 3。儘管體積更大,但由於其混合專家 (MoE) 架構(每個 Token 僅激活 37B 的參數小子集),它在推理時效率更高。

另一個關鍵的區別特徵是 DeepSeek V3 使用了多頭潛在注意力 (MLA) 而非分組查詢注意力 (GQA)。MLA 和 GQA 都是標準多頭注意力 (MHA) 的推理高效替代方案,特別是在使用 KV 快取時。雖然 MLA 實現起來更複雜,但 DeepSeek-V2 論文中的研究表明,它比 GQA 提供了更好的建模性能。

2. OLMo 2

由非營利組織 Allen Institute for AI 開發的 OLMo 系列模型因其在訓練數據和代碼方面的透明度,以及相對詳細的技術報告而備受關注。

雖然您可能不會在任何基準測試或排行榜的頂端看到 OLMo 模型,但它們非常純粹,更重要的是,得益於其透明度,它們是開發 LLM 的絕佳藍圖。

雖然 OLMo 模型因其透明度而受歡迎,但它們的表現也不差。事實上,在 1 月發佈時(在 Llama 4、Gemma 3 和 Qwen 3 之前),OLMo 2 模型正處於計算與性能的帕累托前沿(Pareto frontier),如圖 7 所示。

如本文早些時候提到的,我的目標是僅專注於 LLM 架構細節(而非訓練或數據),以保持文章長度適中。那麼,OLMo 2 中有哪些有趣的架構設計選擇?這主要歸結為歸一化(normalizations):RMSNorm 層的放置以及 QK-norm 的添加,我將在下面討論。

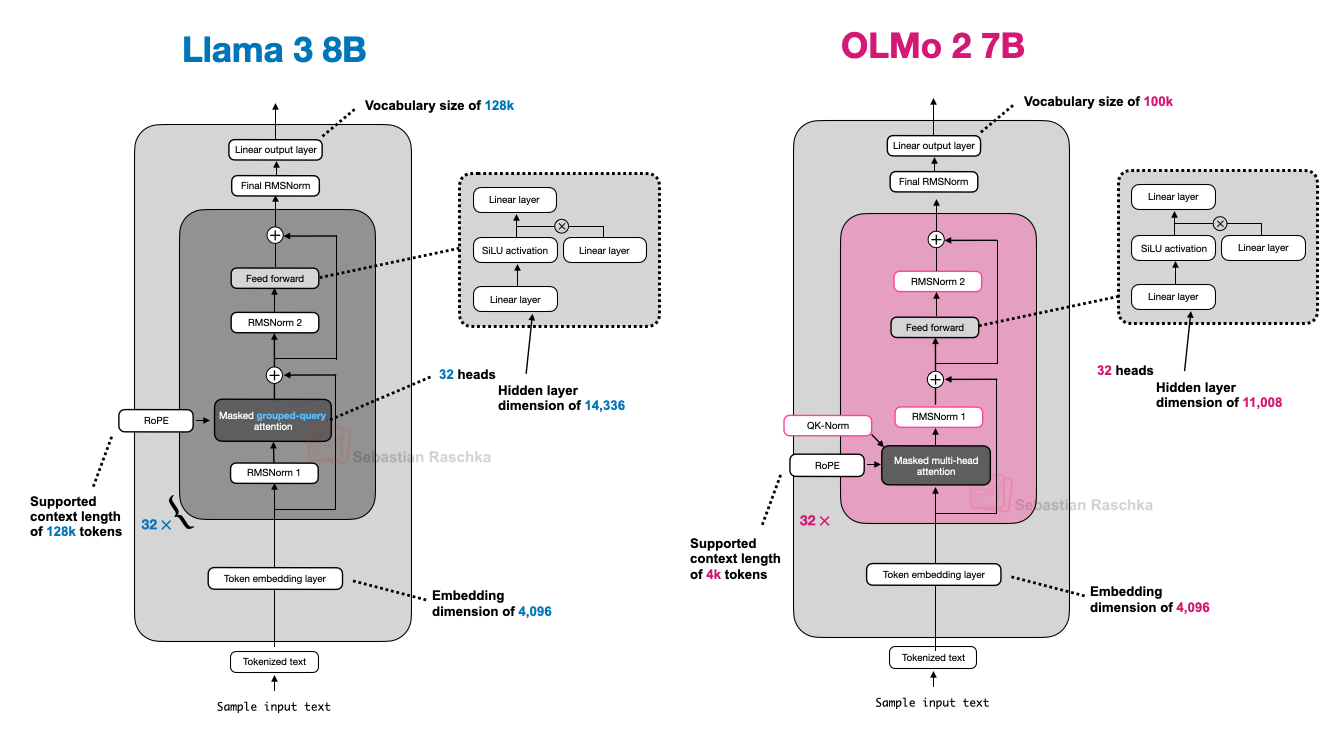

另一件值得一提的事是,OLMo 2 仍然使用傳統的多頭注意力 (MHA),而非 MLA 或 GQA。

2.1 歸一化層的放置

總體而言,OLMo 2 很大程度上遵循了原始 GPT 模型的架構,與其他當代 LLM 相似。然而,也有一些值得注意的偏差。讓我們從歸一化層開始。

與 Llama、Gemma 和大多數其他 LLM 類似,OLMo 2 從 LayerNorm 切換到了 RMSNorm。

但由於 RMSNorm 已是老生常談(它基本上是 LayerNorm 的簡化版本,具有更少的訓練參數),我將跳過 RMSNorm 與 LayerNorm 的討論。(好奇的讀者可以在我的 GPT-2 到 Llama 轉換指南中找到 RMSNorm 的代碼實現。)

然而,RMSNorm 層的放置位置值得討論。原始 Transformer(來自「Attention is all you need」論文)將兩個歸一化層分別放置在 Transformer 區塊中的注意力模塊和前饋模塊之後。

這也被稱為 Post-LN 或 Post-Norm。

GPT 以及之後出現的大多數其他 LLM 則將歸一化層放置在注意力及前饋模塊之前,這被稱為 Pre-LN 或 Pre-Norm。Post-Norm 和 Pre-Norm 的比較如下圖所示。

2020 年,Xiong 等人表明 Pre-LN 在初始化時會產生更穩定的梯度。此外,研究人員提到 Pre-LN 甚至在沒有仔細的學習率預熱(warm-up)的情況下也能很好地工作,而預熱對於 Post-LN 來說是至關重要的工具。

現在,我提到這一點的原因是 OLMo 2 採用了一種 Post-LN 的形式(但使用 RMSNorm 而非 LayerNorm,所以我稱之為 Post-Norm)。

在 OLMo 2 中,歸一化層不是放在注意力層和前饋層之前,而是放在它們之後,如上圖所示。但是,請注意,與原始 Transformer 架構相比,歸一化層仍然位於殘差層(跳躍連接)內部。

那麼,為什麼他們要移動歸一化層的位置呢?原因是這有助於訓練穩定性,如下圖所示。

遺憾的是,這張圖將重新排序的結果與 QK-Norm 放在一起顯示,而 QK-Norm 是一個獨立的概念。因此,很難判斷歸一化層重新排序本身貢獻了多少。

2.2 QK-Norm

既然上一節已經提到了 QK-norm,而且我們稍後討論的其他 LLM(如 Gemma 2 和 Gemma 3)也使用了 QK-norm,讓我們簡要討論一下這是什麼。

QK-Norm 基本上是另一個 RMSNorm 層。它被放置在多頭注意力 (MHA) 模塊內部,並在應用 RoPE 之前應用於查詢 (q) 和鍵 (k)。為了說明這一點,下面是我為 Qwen3 從零開始實現編寫的分組查詢注意力 (GQA) 層的摘錄(GQA 中的 QK-norm 應用與 OLMo 中的 MHA 類似):

如前所述,QK-Norm 與 Post-Norm 共同穩定了訓練。請注意,QK-Norm 並非由 OLMo 2 發明,而是可以追溯到 2023 年的《Scaling Vision Transformers》論文。

2.3 OLMo 2 總結

簡而言之,值得注意的 OLMo 2 架構設計決策主要是 RMSNorm 的放置:RMSNorm 位於注意力及前饋模塊之後而非之前(Post-Norm 的一種變體),以及在注意力機制內部為查詢和鍵添加了 RMSNorm (QK-Norm),這兩者共同幫助穩定了訓練損失。

下圖進一步並排比較了 OLMo 2 和 Llama 3;可以看出,除了 OLMo 2 仍使用傳統的 MHA 而非 GQA 之外,兩者的架構相對相似。(不過,OLMo 2 團隊在 3 個月後發佈了一個使用 GQA 的 32B 變體。)

3. Gemma 3

Google 的 Gemma 模型一直非常出色,我認為與 Llama 系列等其他熱門模型相比,它們受到的關注一直偏低。

Gemma 的顯著特點之一是相當大的詞彙量(為了更好地支持多種語言),以及對 27B 尺寸的更強關注(相對於 8B 或 70B)。但請注意,Gemma 2 也有更小的尺寸:1B、4B 和 12B。

27B 這個尺寸達到了一個非常好的平衡點:它比 8B 模型強大得多,但又不像 70B 模型那樣耗費資源,在我的 Mac Mini 上運行良好。

那麼,Gemma 3 還有什麼有趣的地方?如前所述,Deepseek V3/R1 等其他模型使用混合專家 (MoE) 架構,在給定模型大小的情況下減少推理時的內存需求。(MoE 方法也被我們稍後將討論的其他幾個模型所採用。)

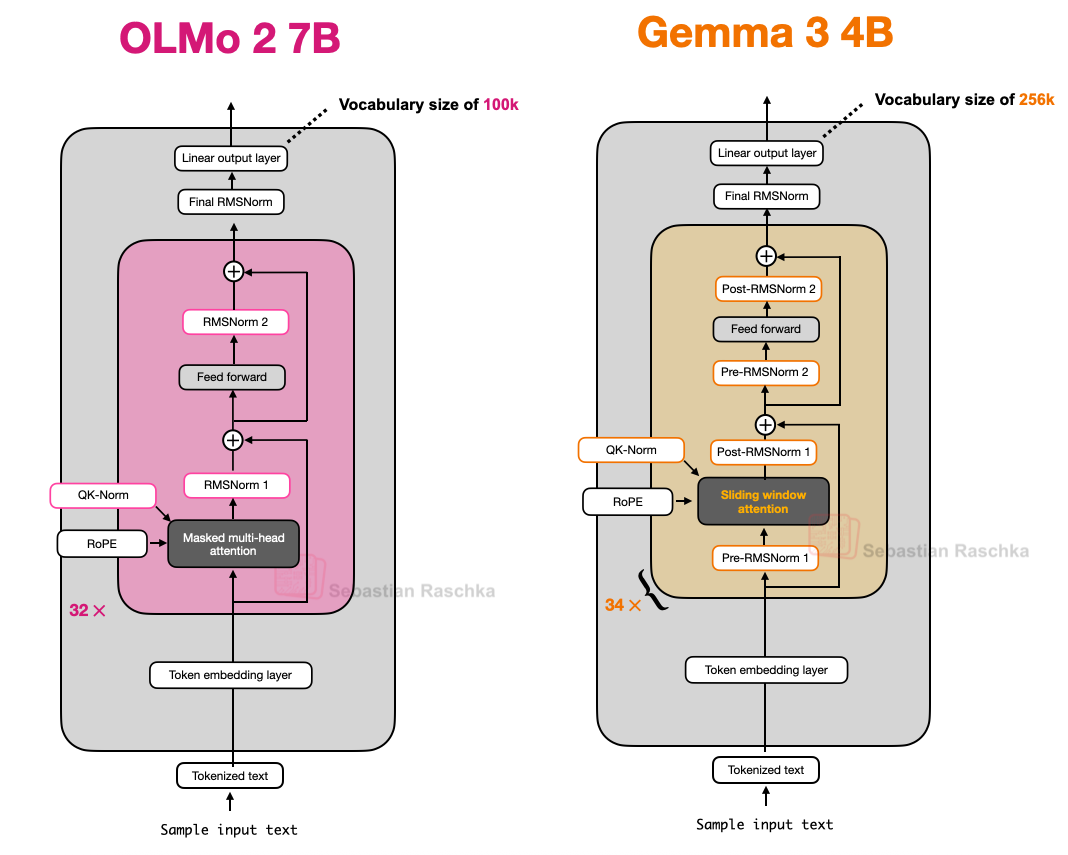

Gemma 3 使用了一種不同的「技巧」來降低計算成本,即滑動窗口注意力(sliding window attention)。

3.1 滑動窗口注意力

通過滑動窗口注意力(最初在 2020 年的 LongFormer 論文中引入,且已在 Gemma 2 中使用),Gemma 3 團隊能夠大幅減少 KV 快取中的內存需求,如下圖所示。

那麼,什麼是滑動窗口注意力?如果我們將常規自注意力視為一種全局注意力機制(因為每個序列元素都可以訪問每個其他序列元素),那麼我們可以將滑動窗口注意力視為局部注意力,因為這裡我們限制了當前查詢位置周圍的上下文大小。如下圖所示。

請注意,滑動窗口注意力既可以用於多頭注意力,也可以用於分組查詢注意力;Gemma 3 使用的是分組查詢注意力。

如上所述,滑動窗口注意力也被稱為局部注意力,因為局部窗口圍繞並隨當前查詢位置移動。相比之下,常規注意力是全局的,因為每個 Token 都可以訪問所有其他 Token。

現在,如上文簡要提到的,Gemma 2 前身架構之前也使用過滑動窗口注意力。Gemma 3 的不同之處在於他們調整了全局(常規)和局部(滑動)注意力之間的比例。

例如,Gemma 2 使用一種混合注意力機制,以 1:1 的比例結合了滑動窗口(局部)和全局注意力。每個 Token 可以關注附近 4k 個 Token 的上下文窗口。

在 Gemma 2 每隔一層使用一次滑動窗口注意力的地方,Gemma 3 現在採用了 5:1 的比例,這意味著每 5 個滑動窗口(局部)注意力層才有一個完整的注意力層;此外,滑動窗口大小從 4096 (Gemma 2) 減少到了僅 1024 (Gemma 3)。這將模型的重點轉向了更高效的局部計算。

根據他們的消融研究,使用滑動窗口注意力對建模性能的影響微乎其微,如下圖所示。

雖然滑動窗口注意力是 Gemma 3 最顯著的架構方面,但我還想簡要回顧一下歸一化層的放置,作為前一節 OLMo 2 的後續。

3.2 Gemma 3 中的歸一化層放置

一個小而有趣的細節是,Gemma 3 在其分組查詢注意力模塊周圍同時使用了 Pre-Norm 和 Post-Norm 設置的 RMSNorm。

這與 Gemma 2 類似,但仍值得強調,因為它不同於 (1) 原始 Transformer(「Attention is all you need」)中使用的 Post-Norm,(2) 由 GPT-2 推廣並在隨後許多架構中使用的 Pre-Norm,以及 (3) 我們之前看到的 OLMo 2 中的 Post-Norm 變體。

我認為這種歸一化層放置是一種相對直觀的方法,因為它兼具了 Pre-Norm 和 Post-Norm 的優點。在我看來,多一點歸一化沒有壞處。在最壞的情況下,如果額外的歸一化是多餘的,這會因冗餘而增加一點低效。但在實踐中,由於 RMSNorm 在大局中相對廉價,這不應產生任何明顯影響。

3.3 Gemma 3 總結

Gemma 3 是一款性能優異的開源權重 LLM,在我看來,它在開源圈子裡被低估了。最有趣的部分是使用滑動窗口注意力來提高效率(未來將其與 MoE 結合將會很有趣)。

此外,Gemma 3 具有獨特的歸一化層放置,在注意力及前饋模塊之前和之後都放置了 RMSNorm 層。

3.4 加碼內容:Gemma 3n

在 Gemma 3 發佈幾個月後,Google 分享了 Gemma 3n,這是一款針對小型設備效率進行了優化的 Gemma 3 模型,目標是在手機上運行。

Gemma 3n 為了實現更高效率而做出的改變之一是所謂的「每層嵌入」(Per-Layer Embedding, PLE)參數層。這裡的核心思想是僅將模型參數的一個子集保留在 GPU 內存中。特定於 Token 層的嵌入(例如用於文本、音頻和視覺模態的嵌入)則根據需要從 CPU 或 SSD 流式傳輸。

下圖說明了 PLE 的內存節省,列出了標準 Gemma 3 模型的 54.4 億個參數。這可能指的是 Gemma 3 的 40 億參數變體。

54.4 億與 40 億參數的差異是因為 Google 在報告 LLM 參數數量時有一種有趣的方式。他們經常排除嵌入參數以使模型看起來更小,除非在這種情況下,為了使模型看起來更大而包含它們更為方便。這並非 Google 獨有,因為這種做法已成為該領域的普遍現象。

另一個有趣的技巧是 MatFormer 概念(Matryoshka Transformer 的縮寫)。例如,Gemma 3n 使用單個共享的 LLM(Transformer)架構,可以切片成更小的、獨立可用的模型。每個切片都經過訓練以獨立運行,因此在推理時,我們可以僅運行您需要的部分(而非大型模型)。

4. Mistral Small 3.1

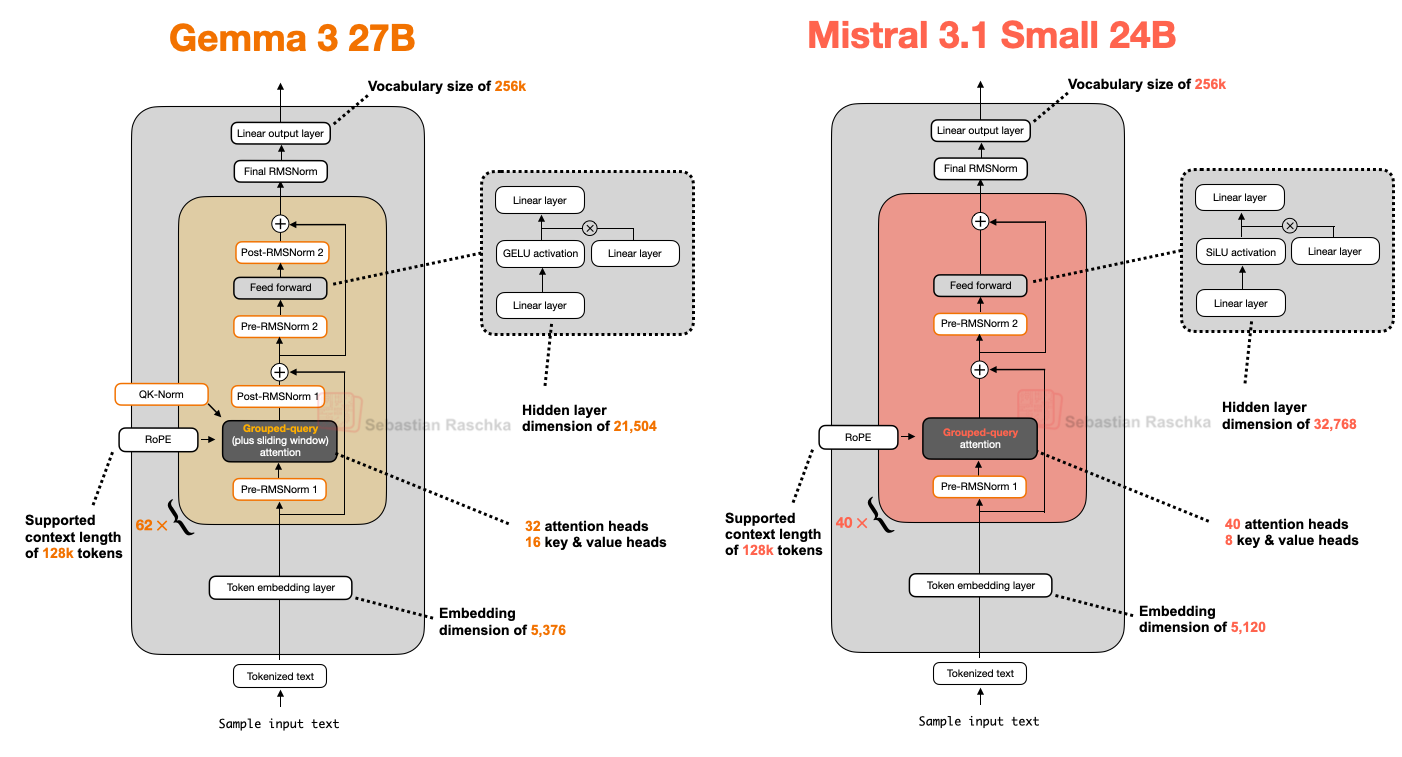

Mistral Small 3.1 24B 於 3 月在 Gemma 3 之後不久發佈,值得注意的是,它在多個基準測試中(除了數學)優於 Gemma 3 27B,同時速度更快。

Mistral Small 3.1 推理延遲低於 Gemma 3 的原因可能歸功於其自定義分詞器(tokenizer),以及縮減了 KV 快取和層數。除此之外,它是一個標準架構,如下圖所示。

有趣的是,早期的 Mistral 模型曾利用過滑動窗口注意力,但如果我們查看官方 Model Hub 配置文件中的默認設置(“sliding_window”: null),他們似乎在 Mistral Small 3.1 中放棄了它。此外,模型說明中也未提及。

因此,由於 Mistral 使用常規的分組查詢注意力,而非像 Gemma 3 那樣帶有滑動窗口的分組查詢注意力,或許由於能夠使用更優化的代碼(即 FlashAttention),還有額外的推理計算節省。例如,我推測雖然滑動窗口注意力減少了內存使用,但它不一定能減少推理延遲,而這正是 Mistral Small 3.1 所關注的。

5. Llama 4

本文早些時候對混合專家 (MoE) 的廣泛介紹再次發揮了作用。Llama 4 也採用了 MoE 方法,除此之外遵循相對標準的架構,與 DeepSeek V3 非常相似,如下圖所示。(Llama 4 包含原生多模態支持,類似於 Gemma 和 Mistral 等模型。然而,由於本文專注於語言建模,我們僅關注文本模型。)

雖然 Llama 4 Maverick 架構整體看起來與 DeepSeek V3 非常相似,但仍有一些有趣的差異值得強調。

首先,Llama 4 使用與其前身類似的分組查詢注意力,而 DeepSeek V3 使用我們在本文開頭討論過的多頭潛在注意力。現在,DeepSeek V3 和 Llama 4 Maverick 都是非常龐大的架構,DeepSeek V3 的總參數數量約大 68%。然而,憑藉 370 億個活動參數,DeepSeek V3 的活動參數數量是 Llama 4 Maverick (17B) 的兩倍多。

與 DeepSeek V3(9 個活動專家,每個隱藏層大小為 2,048)相比,Llama 4 Maverick 使用了更經典的 MoE 設置,專家數量較少但體積較大(2 個活動專家,每個隱藏層大小為 8,192)。此外,DeepSeek 在每個 Transformer 區塊(前 3 個除外)中都使用 MoE 層,而 Llama 4 則在每隔一個 Transformer 區塊中交替使用 MoE 和稠密模塊。

鑑於架構之間存在許多細微差異,很難確定它們對最終模型性能的確切影響。然而,主要的結論是 MoE 架構在 2025 年的人氣顯著上升。

6. Qwen3

Qwen 團隊始終如一地提供高質量的開源權重 LLM。當我協助共同指導 NeurIPS 2023 的 LLM 效率挑戰賽時,我記得頂尖的獲勝方案全都是基於 Qwen2 的。

現在,Qwen3 是另一個在各自尺寸類別中位居排行榜前列的熱門模型系列。共有 7 個稠密模型:0.6B、1.7B、4B、8B、14B 和 32B。還有 2 個 MoE 模型:30B-A3B 和 235B-A22B。

(順便提一下,請注意「Qwen3」中間沒有空格並非拼寫錯誤;我只是試圖保留 Qwen 開發者選擇的原始拼寫。)

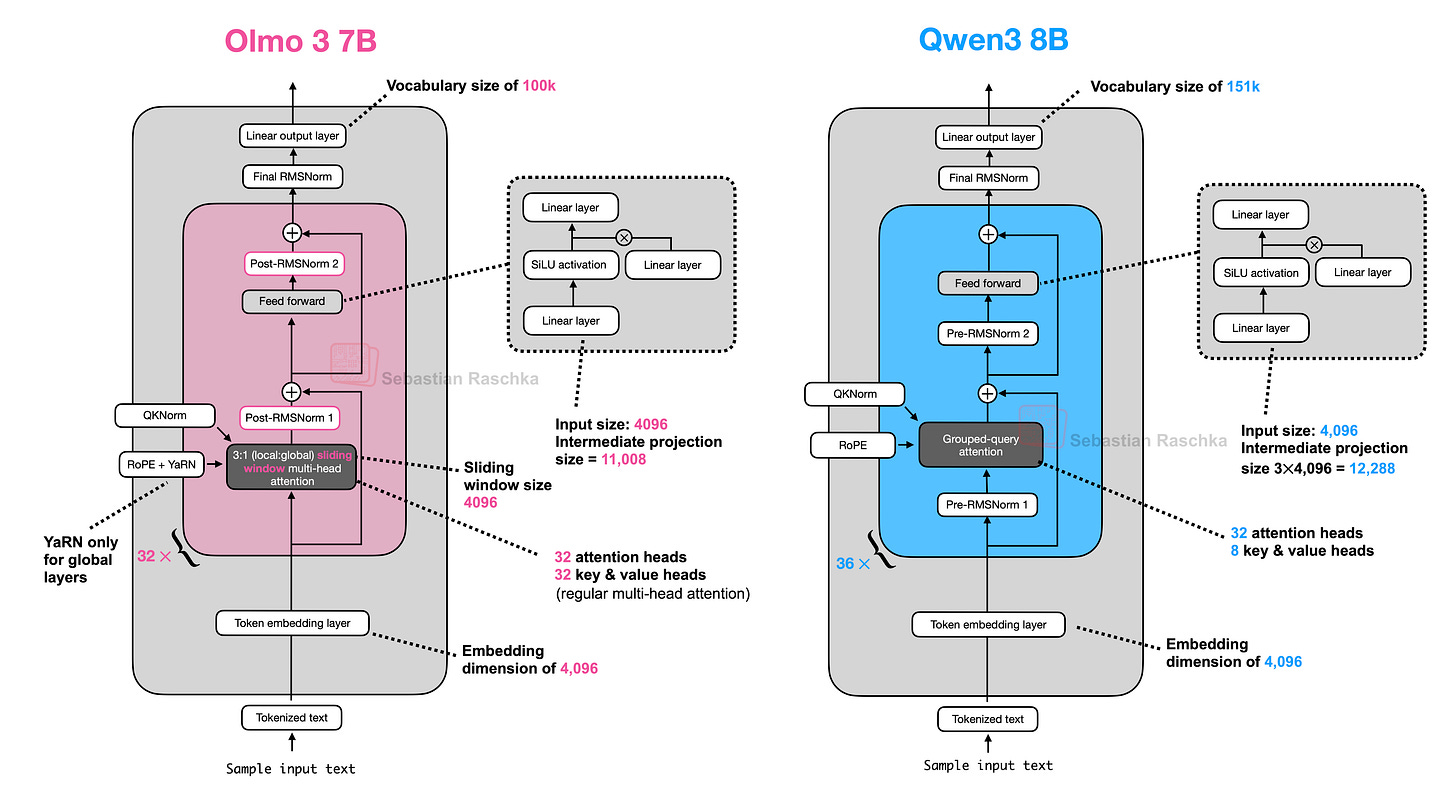

6.1 Qwen3 (稠密版)

讓我們首先討論稠密模型架構。截至撰寫本文時,0.6B 模型很可能是目前市面上最小的當代開源權重模型。根據我的個人經驗,考慮到其微小的尺寸,它的表現非常出色。如果您計劃在本地運行,它具有極佳的 Token/秒吞吐量和較低的內存佔用。更重要的是,由於其體積小,它也很容易在本地進行訓練(出於教學目的)。

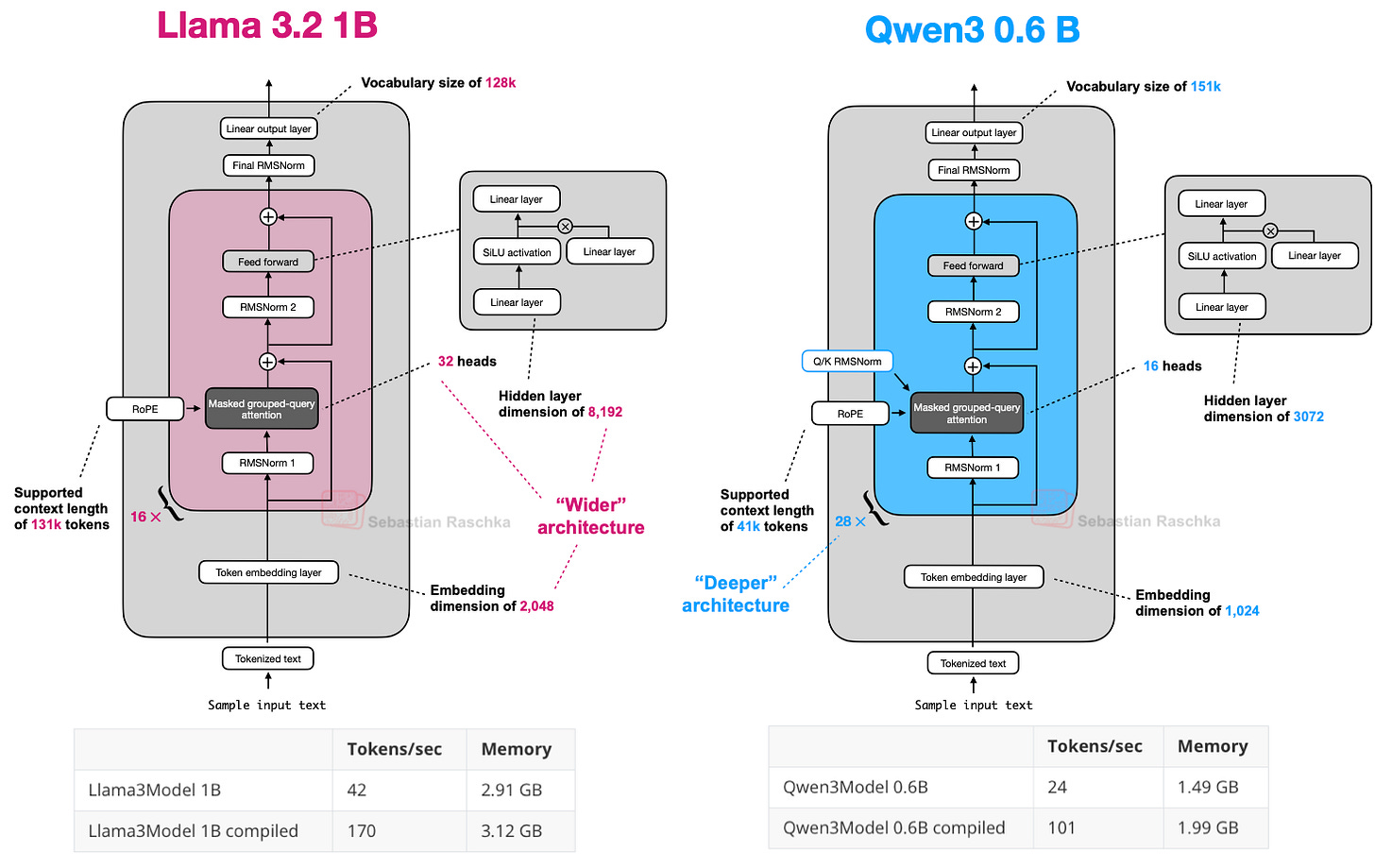

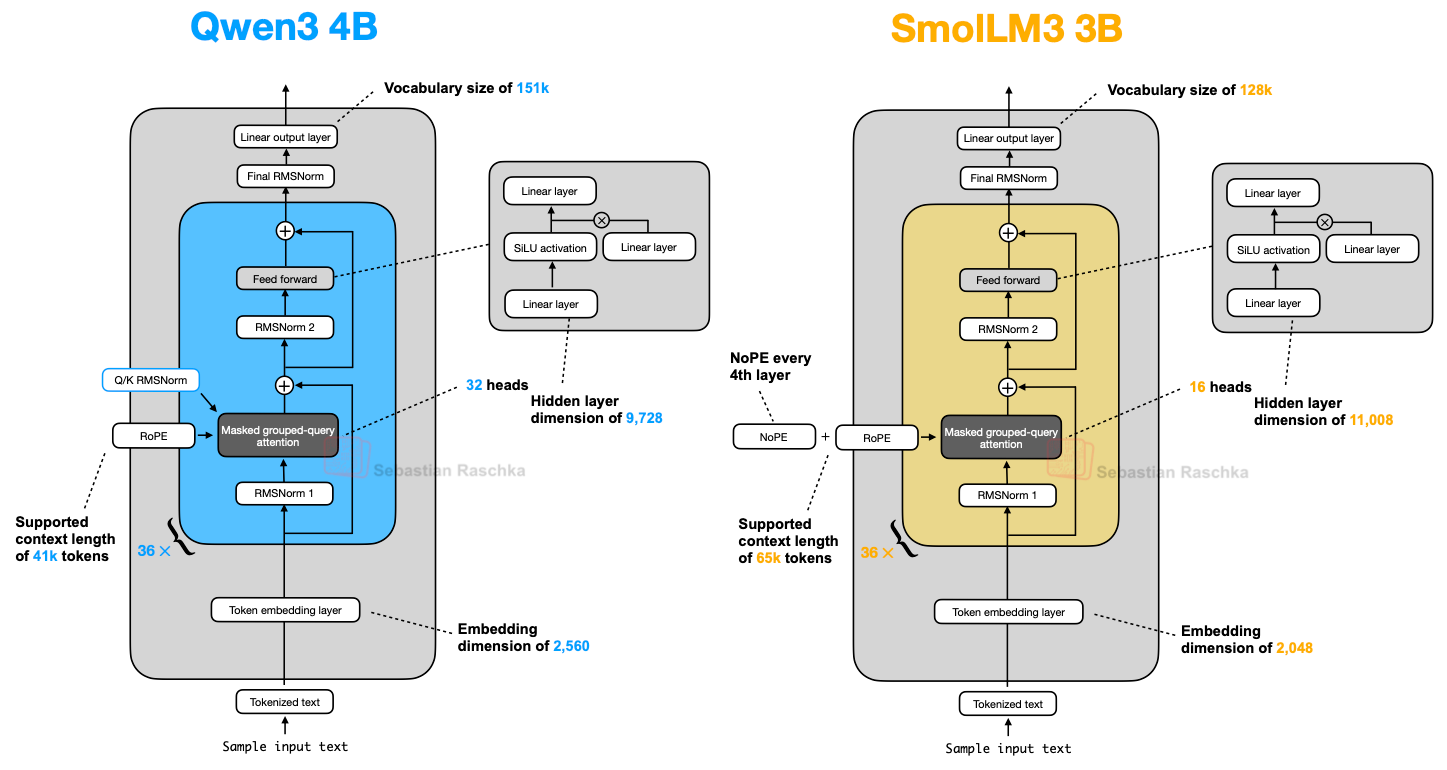

因此,在大多數用途上,Qwen3 0.6B 已經取代了 Llama 3 1B。這兩種架構的比較如下所示。

如果您對不依賴外部第三方 LLM 庫、具有可讀性的 Qwen3 實現感興趣,我最近從零開始實現了 Qwen3(使用純 PyTorch)。

上圖中的計算性能數據是基於我在 A100 GPU 上運行的從零開始 PyTorch 實現。可以看出,Qwen3 具有更小的內存佔用,因為它整體架構更小,而且使用了更小的隱藏層和更少的注意力頭。然而,它比 Llama 3 使用了更多的 Transformer 區塊,這導致運行時間較慢(Token/秒生成速度較低)。

6.2 Qwen3 (MoE 版)

如前所述,Qwen3 還有兩種 MoE 版本:30B-A3B 和 235B-A22B。為什麼有些架構(如 Qwen3)會同時提供常規(稠密)和 MoE(稀疏)變體?

如本文開頭所述,MoE 變體有助於在給定大型基礎模型的情況下降低推理成本。提供稠密和 MoE 兩個版本,可以讓用戶根據自己的目標和限制靈活選擇。

稠密模型通常在各種硬件上更容易進行微調、部署和優化。

另一方面,MoE 模型針對擴展推理進行了優化。例如,在固定的推理預算下,它們可以實現更高的整體模型容量(即訓練期間由於體積更大而吸收更多知識),而不會成比例地增加推理成本。

通過發佈這兩種類型,Qwen3 系列可以支持更廣泛的使用場景:稠密模型用於穩健性、簡單性和微調,而 MoE 模型用於大規模的高效服務。

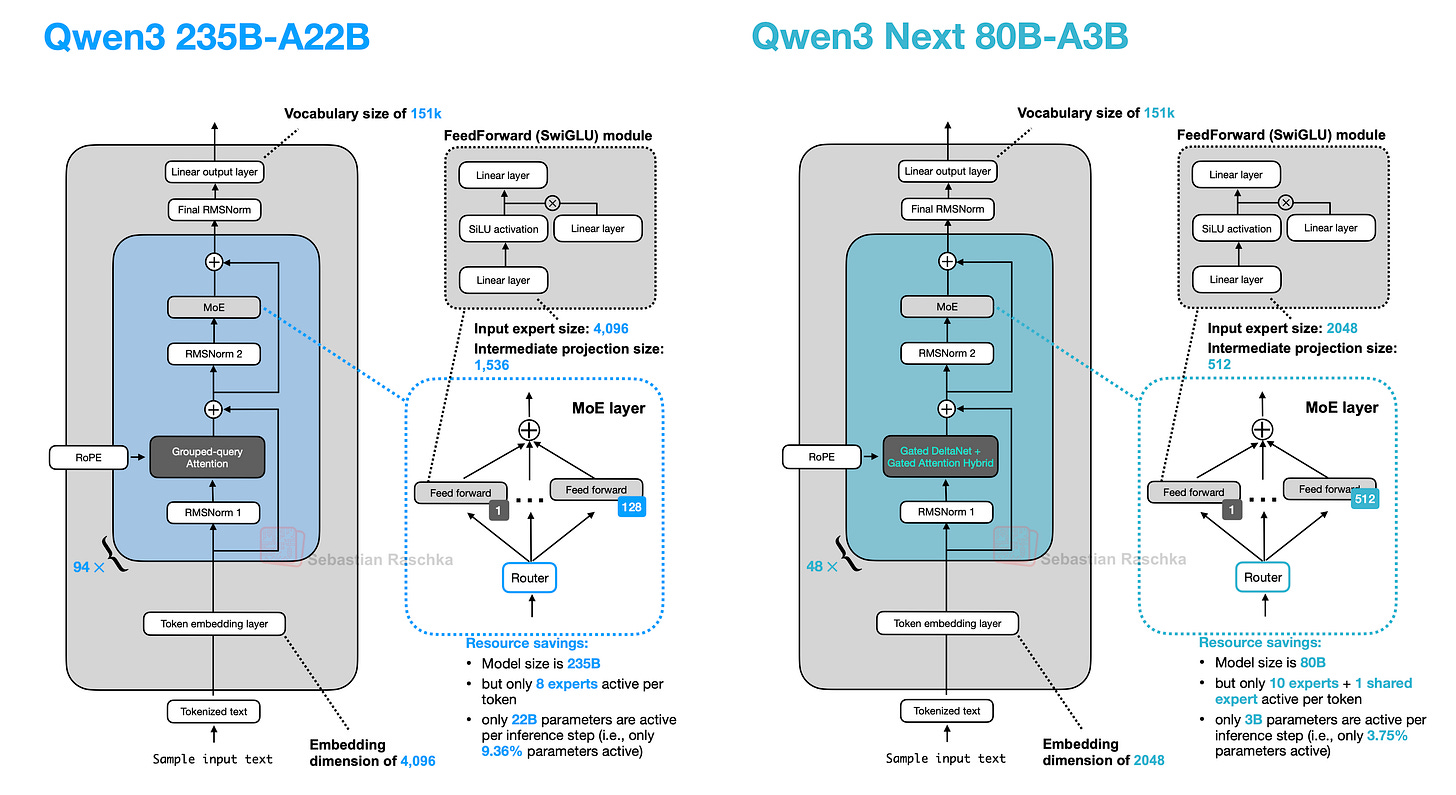

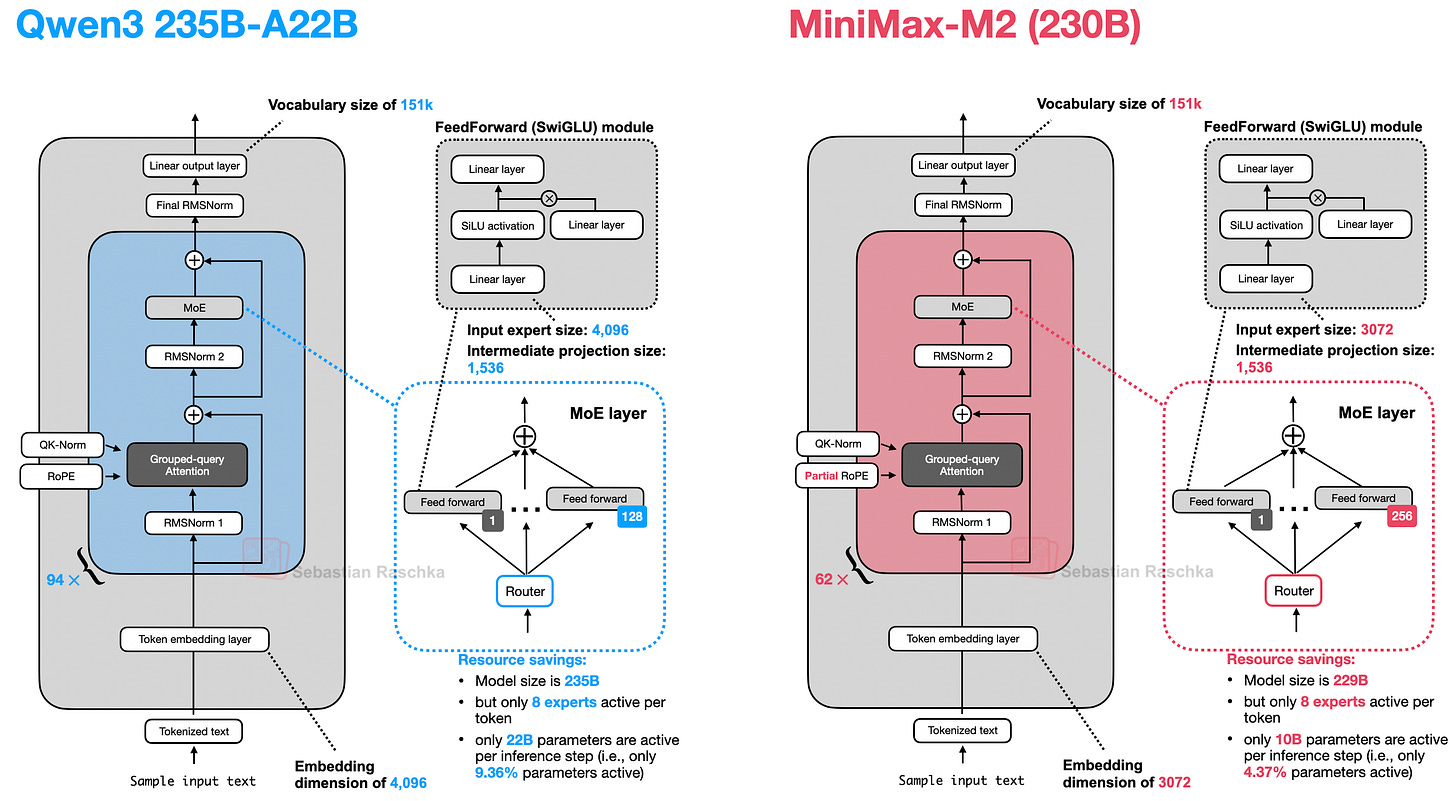

為了總結本節,讓我們看看 Qwen3 235B-A22B(注意 A22B 代表「22B 活動參數」)與 DeepSeek V3 的對比,後者的活動參數幾乎是其兩倍 (37B)。

如上圖所示,DeepSeek V3 和 Qwen3 235B-A22B 的架構驚人地相似。值得注意的是,Qwen3 模型不再使用共享專家(早期的 Qwen 模型,如 Qwen2.5-MoE,確實使用了共享專家)。

遺憾的是,Qwen3 團隊並未透露他們放棄共享專家的原因。如果讓我猜測,或許在他們將專家數量從 2 個(在 Qwen2.5-MoE 中)增加到 8 個(在 Qwen3 中)時,對於他們的設置來說,訓練穩定性已不再需要共享專家。這樣他們就能通過僅使用 8 個而非 8+1 個專家來節省額外的計算/內存成本。(然而,這並不能解釋為什麼 DeepSeek V3 仍然保留其共享專家。)

更新:Qwen3 的開發者之一 Junyang Lin 回應如下:

當時我們沒有發現共享專家有足夠顯著的改進,而且我們擔心共享專家會導致推理優化方面的問題。老實說,這個問題沒有直接的答案。

7. SmolLM3

SmolLM3 可能遠不如本文涵蓋的其他 LLM 受歡迎,但我認為將其納入其中仍然很有趣,因為它在相對小巧方便的 30 億參數模型尺寸下提供了非常好的建模性能,介於 1.7B 和 4B 的 Qwen3 模型之間,如下圖所示。

此外,它還分享了大量的訓練細節,類似於 OLMo,這非常罕見且總是令人讚賞!

如下方的架構對比圖所示,SmolLM3 的架構看起來相當標準。然而,最有趣的方面或許是它對 NoPE(無位置嵌入)的使用。

7.1 無位置嵌入 (NoPE)

在 LLM 語境中,NoPE 是一個較早的想法,可以追溯到 2023 年的一篇論文(《The Impact of Positional Encoding on Length Generalization in Transformers》),旨在移除顯式的位置信息注入(如早期 GPT 架構中的經典絕對位置嵌入層或現在的 RoPE)。

在基於 Transformer 的 LLM 中,位置編碼通常是必要的,因為自注意力機制在處理 Token 時與順序無關。絕對位置嵌入通過添加一個額外的嵌入層來解決這個問題,該層為 Token 嵌入添加信息。

另一方面,RoPE 通過相對於 Token 位置旋轉查詢和鍵向量來解決這個問題。

然而,在 NoPE 層中,完全不添加此類位置信號:既不固定,也不學習,也不相對。什麼都沒有。

儘管沒有位置嵌入,模型仍然知道哪些 Token 在前,這要歸功於因果注意力掩碼(causal attention mask)。該掩碼防止每個 Token 關注未來的 Token。因此,位於位置 t 的 Token 只能看到位置 ≤ t 的 Token,這保留了自回歸順序。

因此,雖然沒有顯式添加位置信息,但模型結構中仍隱含著一種方向感,而 LLM 在常規的基於梯度下降的訓練中,如果發現這對優化目標有利,就可以學會利用它。(欲了解更多信息,請查看 NoPE 論文的定理。)

總體而言,NoPE 論文不僅發現不需要注入位置信息,還發現 NoPE 具有更好的長度泛化能力,這意味著 LLM 的回答性能隨序列長度增加而下降的程度較小,如下圖所示。

請注意,上述實驗是使用約 1 億個參數的相對較小的 GPT 風格模型和相對較小的上下文尺寸進行的。目前尚不清楚這些發現如何推廣到更大的當代 LLM。

出於這個原因,SmolLM3 團隊可能僅在每 4 層中「應用」一次 NoPE(或者說省略 RoPE)。

8. Kimi K2 與 Kimi K2 Thinking

Kimi K2 最近在 AI 社區引起了巨大轟動,因為它是一款性能極其出色的開源權重模型。根據基準測試,它與 Google 的 Gemini、Anthropic 的 Claude 和 OpenAI 的 ChatGPT 等頂尖專有模型不相上下。

一個顯著特點是它使用了相對較新的 Muon 優化器變體而非 AdamW。據我所知,這是 Muon 首次被用於此規模的生產模型(此前僅顯示其可擴展至 16B)。這產生了非常漂亮的訓練損失曲線,這可能幫助該模型躍升至上述基準測試的頂端。

雖然有人評論說損失曲線異常平滑(因為缺乏尖峰),但我認為它並非異常平滑(例如,參見下圖中 OLMo 2 的損失曲線;此外,梯度的 L2 範數可能是追蹤訓練穩定性更好的指標)。然而,令人矚目的是損失曲線衰減得有多好。

不過,正如本文引言中提到的,訓練方法是另一個話題。

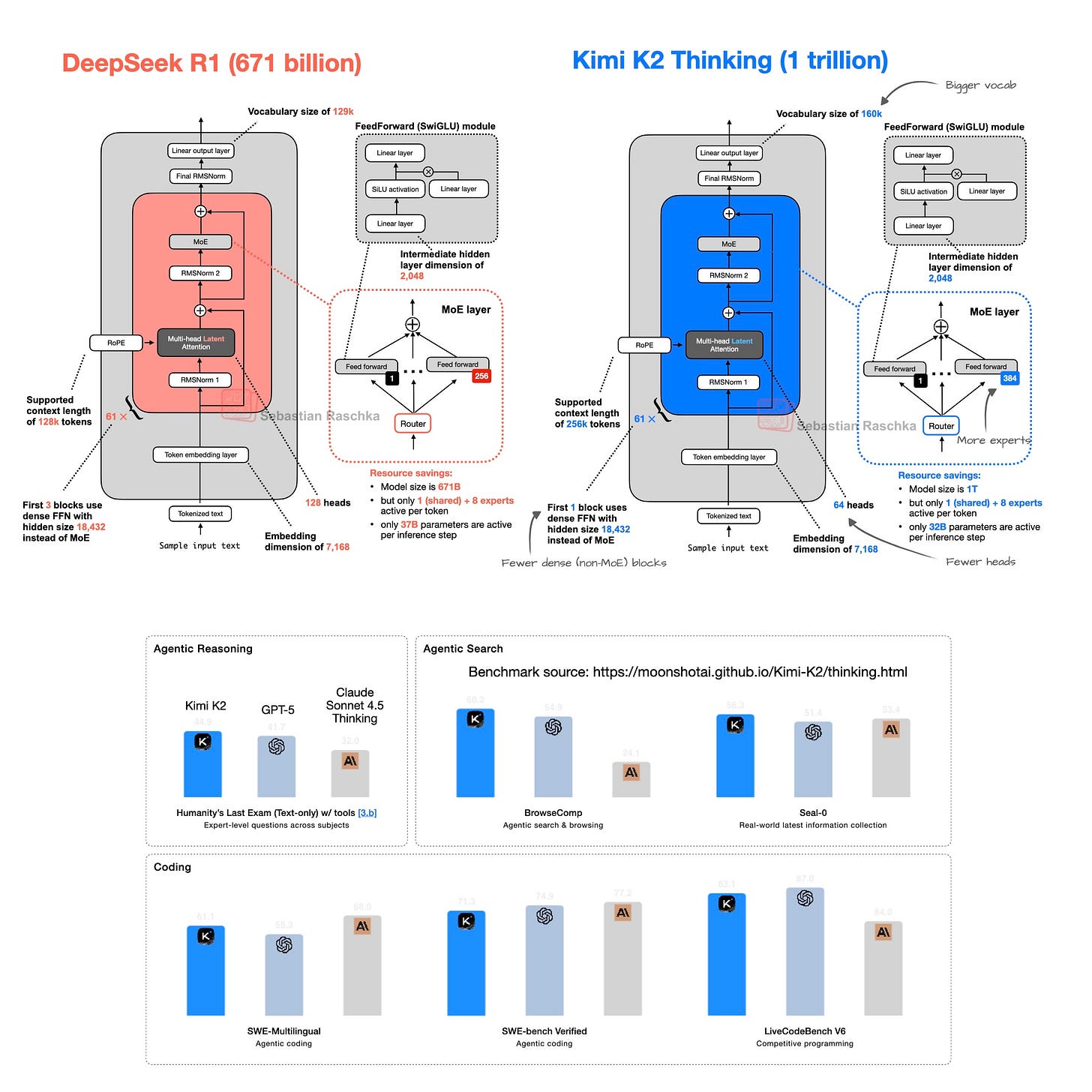

該模型本身擁有 1 兆(1 trillion)參數,確實令人印象深刻。

截至撰寫本文時,它可能是這一代最大的 LLM(考慮到 Llama 4 Behemoth 尚未發佈,專有 LLM 不計入內,且 Google 的 1.6 兆 Switch Transformer 是來自不同世代的編碼器-解碼器架構)。

這也形成了一個圓滿的循環,因為 Kimi K2 使用了我們在本文開頭介紹的 DeepSeek V3 架構,只是他們把它做得更大,如下圖所示。

如上圖所示,Kimi K2 基本上與 DeepSeek V3 相同,不同之處在於它在 MoE 模塊中使用了更多專家,而在多頭潛在注意力 (MLA) 模塊中使用了更少的頭。

Kimi K2 並非憑空而來。早期的 Kimi 1.5 模型在《Kimi k1.5: Scaling Reinforcement Learning with LLMs》論文中討論過,同樣令人印象深刻。然而,它運氣不佳,DeepSeek R1 模型論文恰好在同一天(1 月 22 日)發表。此外,據我所知,Kimi 1.5 的權重從未公開分享過。

因此,Kimi K2 團隊很可能吸取了這些教訓,並在 DeepSeek R2 發佈之前將 Kimi K2 作為開源權重模型分享。截至撰寫本文時,Kimi K2 是最令人印象深刻的開源權重模型。

更新:2025 年 11 月 6 日,Kimi K2 團隊還發佈了他們新的「Thinking」模型變體。架構與上述 Kimi K2 相比沒有變化,除了他們將上下文尺寸從 128k 擴展到了 256k。

根據 Kimi 團隊分享的基準測試,該模型的性能超過了領先的專有 LLM。(遺憾的是,沒有與 DeepSeek R1 的直接比較。)

9. GPT-OSS

OpenAI 發佈了 gpt-oss-120b 和 gpt-oss-20b,這是自 2019 年 GPT-2 以來他們的首批開源權重模型,大約在我寫完這篇文章的一週後。由於 OpenAI 的開源權重模型備受期待,我更新了本文以包含它們。我將簡要介紹這一部分,但我還寫了另一篇更詳細的文章,專門討論 gpt-oss 模型:

從 GPT-2 到 gpt-oss:分析架構進展

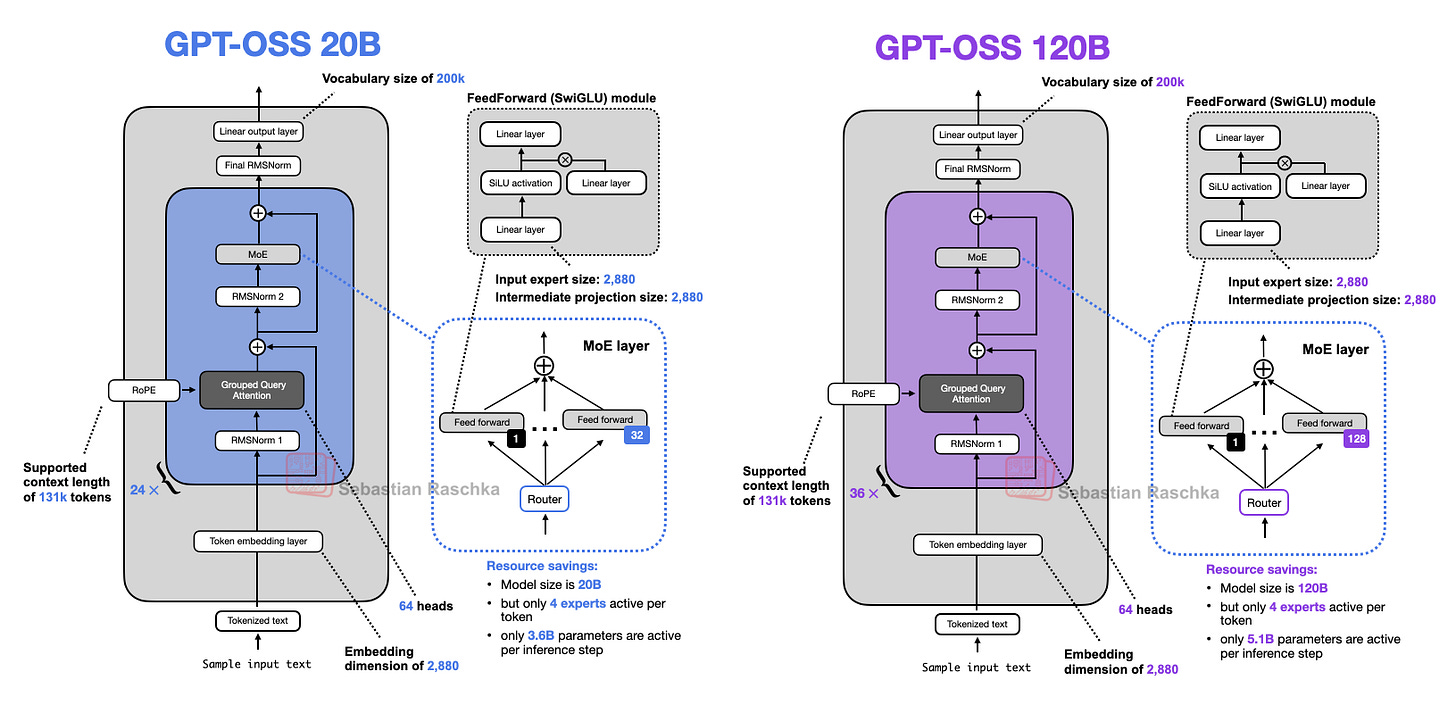

在總結有趣的細節之前,讓我們首先概覽這兩個模型:gpt-oss-20b 和 gpt-oss-120b,如圖 26 所示。

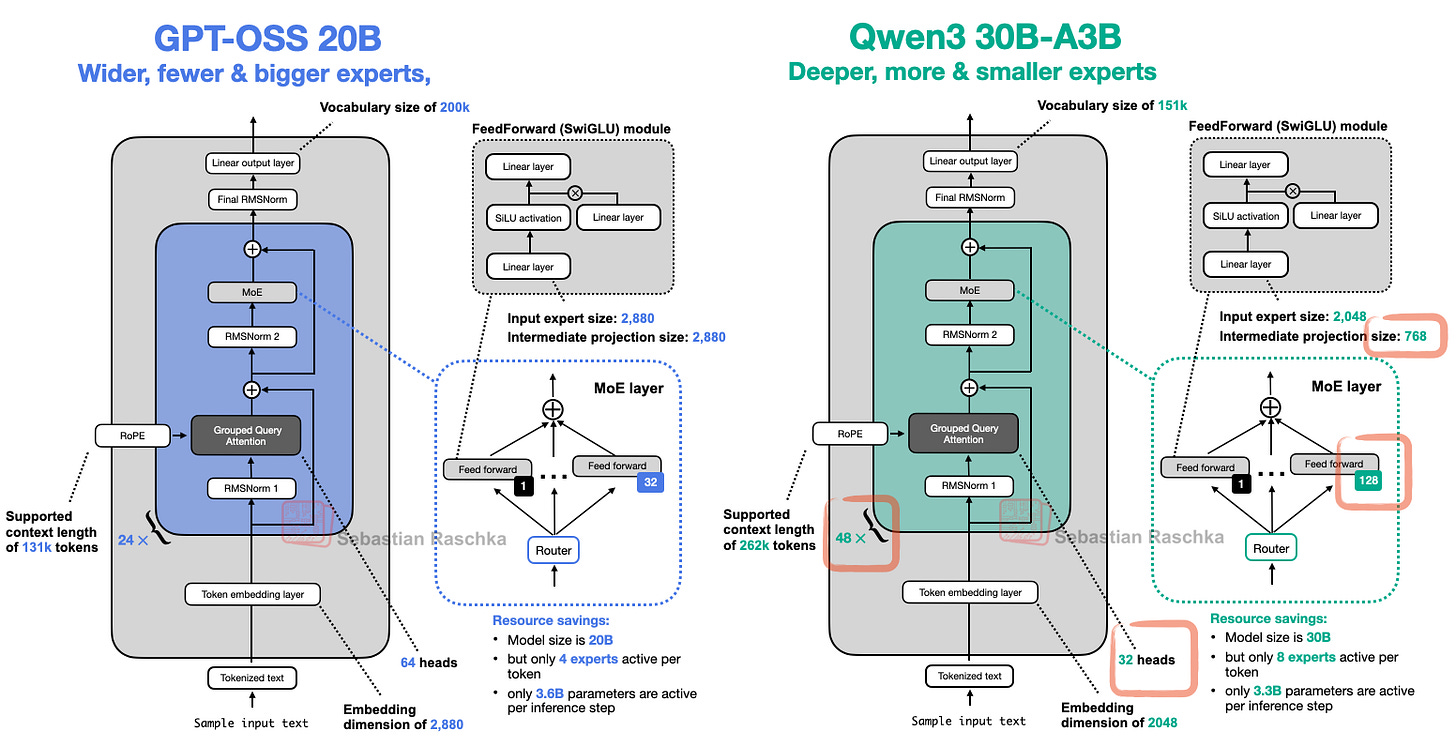

觀察圖 26,該架構包含了我們在之前討論過的其他架構中看到的所有熟悉組件。例如,圖 27 將較小的 gpt-oss 架構與 Qwen3 30B-A3B 並列,後者也是一個具有相似活動參數數量的 MoE 模型(gpt-oss 有 3.6B 活動參數,Qwen3 30B-A3B 有 3.3B)。

圖 27 中未顯示的一個方面是 gpt-oss 使用了滑動窗口注意力(類似於 Gemma 3,但每隔一層使用一次,而非採用 5:1 的比例)。

9.1 寬度與深度

圖 27 顯示 gpt-oss 和 Qwen3 使用了相似的組件。但如果我們仔細觀察這兩個模型,會發現 Qwen3 是一個深得多的架構,擁有 48 個 Transformer 區塊,而非 24 個。

另一方面,gpt-oss 是一個寬得多的架構:

嵌入維度為 2880 而非 2048

中間專家(前饋)投影維度同樣為 2880 而非 768

同樣值得注意的是,gpt-oss 使用了兩倍數量的注意力頭,但這並不會直接增加模型的寬度。寬度是由嵌入維度決定的。

在給定固定參數數量的情況下,一種方法是否比另一種更有優勢?根據經驗,更深的模型具有更大的靈活性,但由於爆炸和消失梯度問題(RMSNorm 和快捷連接旨在緩解這些問題),訓練起來可能更困難。

更寬的架構優點在於推理期間速度更快(具有更高的 Token/秒吞吐量),因為在更高的內存成本下具有更好的並行性。

在建模性能方面,遺憾的是我目前還不知道有任何良好的「蘋果對蘋果」比較(即保持參數大小和數據集不變),除了 Gemma 2 論文中的一項消融研究(表 9),該研究發現對於 9B 參數的架構,較寬的設置略優於較深的設置。在 4 個基準測試中,較寬的模型獲得了 52.0 的平均分,而較深的模型獲得了 50.8 的平均分。

9.2 少數大專家與多數小專家

如上方圖 27 所示,值得注意的是 gpt-oss 的專家數量出奇地少(32 個而非 128 個),且每個 Token 僅使用 4 個而非 8 個活動專家。然而,每個專家的體積比 Qwen3 中的專家大得多。

這很有趣,因為最近的趨勢和發展指向更多、更小的模型是有益的。在總參數大小不變的情況下,這種變化在下方來自 DeepSeekMoE 論文的圖 28 中得到了很好的說明。

值得注意的是,與 DeepSeek 的模型不同,gpt-oss 和 Qwen3 都沒有使用共享專家。

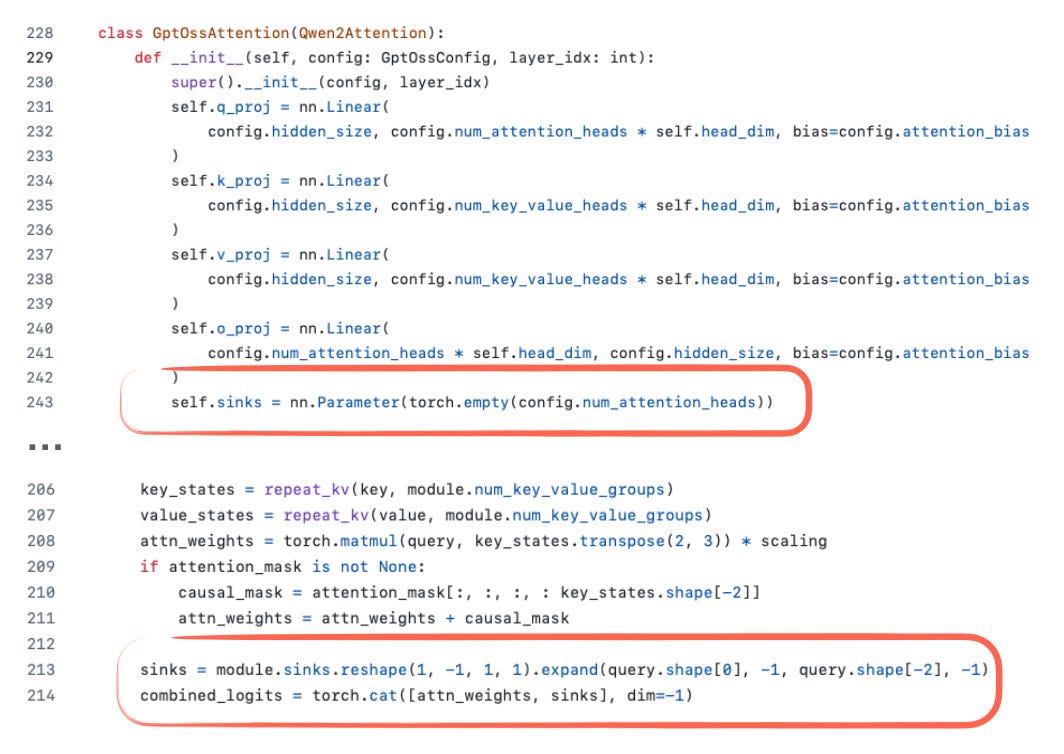

9.3 注意力偏置與注意力匯 (Attention Sinks)

gpt-oss 和 Qwen3 都使用分組查詢注意力。主要區別在於 gpt-oss 如前所述,在每隔一層中通過滑動窗口注意力限制了上下文大小。

然而,有一個引起我注意的有趣細節。gpt-oss 似乎為注意力權重使用了偏置單元(bias units),如圖 29 所示。

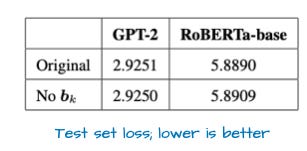

自 GPT-2 時代以來,我就沒見過使用這些偏置單元了,它們通常被認為是多餘的。事實上,我發現最近的一篇論文從數學上證明了這對於鍵變換 (k_proj) 至少是成立的。此外,實證結果顯示,使用和不使用偏置單元之間幾乎沒有區別(見下方圖 30)。

您可能已經注意到的另一個細節是圖 30 代碼截圖中對匯(sinks)的定義。在一般模型中,注意力匯是放置在序列開頭的特殊「始終被關注」的 Token,用於穩定注意力,這在長上下文場景中特別有用。也就是說,如果上下文變得很長,開頭的這個特殊被關注 Token 仍然會被關注,它可以學會存儲一些關於整個序列的通用有用信息。(我認為這最初是在《Efficient Streaming Language Models with Attention Sinks》論文中提出的。)

在 gpt-oss 的實現中,注意力匯並非輸入序列中的實際 Token。相反,它們是為每個頭學習的偏置對數(bias logits),被附加到注意力分數中(圖 31)。目標與上述注意力匯相同,但無需修改分詞後的輸入。

欲了解關於 gpt-oss 及其與 GPT-2 比較的更多信息,請參閱我的另一篇 gpt-oss 文章:

從 GPT-2 到 gpt-oss:分析架構進展

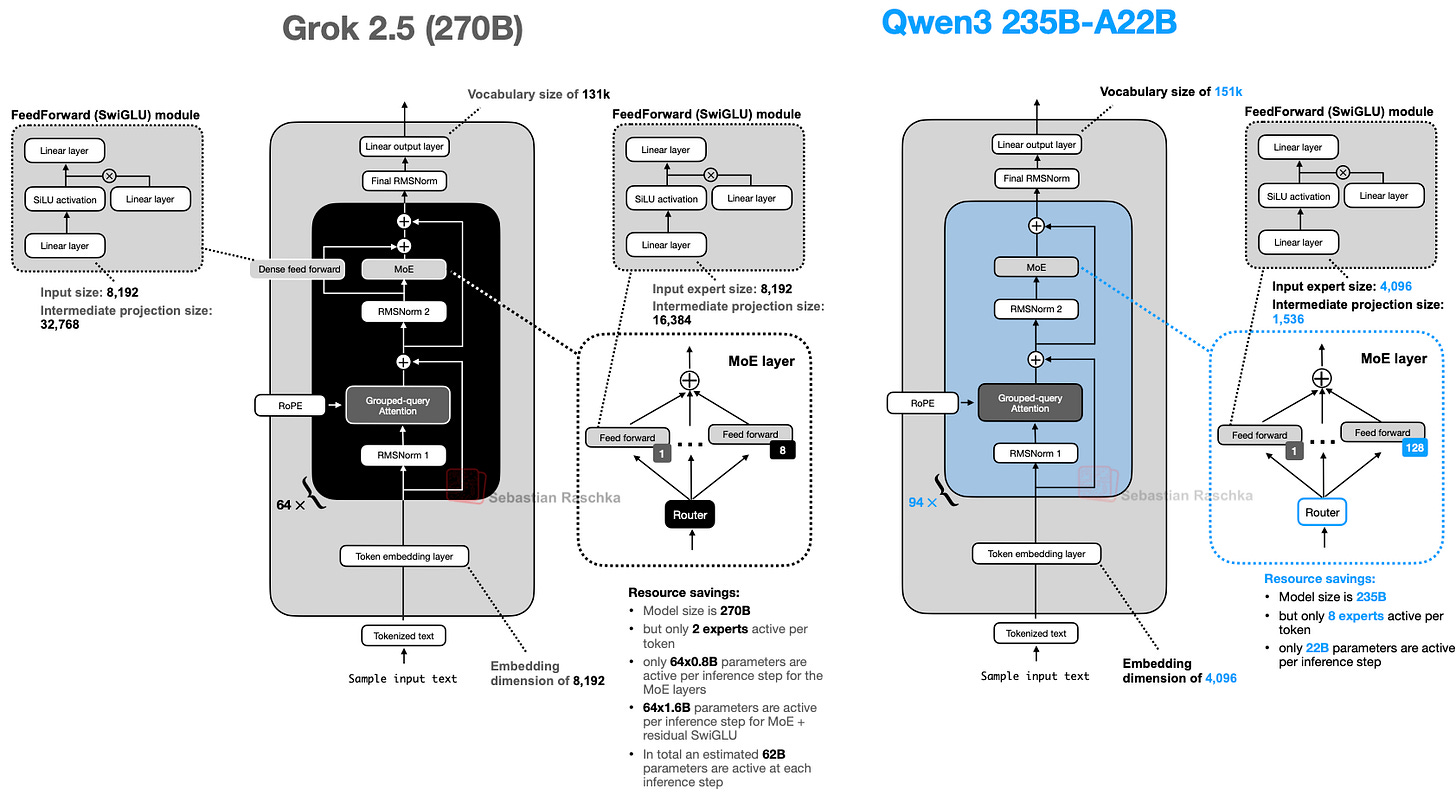

10. Grok 2.5

在我這篇文章上線幾週後,xAI 發佈了其 2700 億參數 Grok 2.5 模型的權重。

我認為將其納入此處是值得的,因為 Grok 2.5 是 xAI 去年的旗艦生產模型。到目前為止,我們討論的所有模型從一開始就是作為開源權重模型發佈的。例如,gpt-oss 可能不是 GPT-4 的開源克隆,而是專門為開源社區訓練的自定義模型。

通過 Grok 2.5,我們得以罕見地窺見一個真實的生產系統,即使它是去年的。

從架構上看,Grok 2.5 整體看起來相當標準(圖 32),但有一些值得注意的細節。

例如,Grok 2.5 使用了少數大專家(8 個),這反映了一種較舊的趨勢。如前所述,DeepSeekMoE 論文等更近期的設計傾向於使用更多的小專家(這也出現在 Qwen3 中)。

另一個有趣的選擇是使用了相當於共享專家的組件。圖 32 左側顯示的額外 SwiGLU 模塊充當始終開啟的共享專家。它與經典的共享專家設計不完全相同,因為其中間維度翻倍了,但理念是一致的。(我仍然覺得 Qwen3 省略共享專家很有趣,看看 Qwen4 及以後的模型是否會改變這一點將會很有意思。)

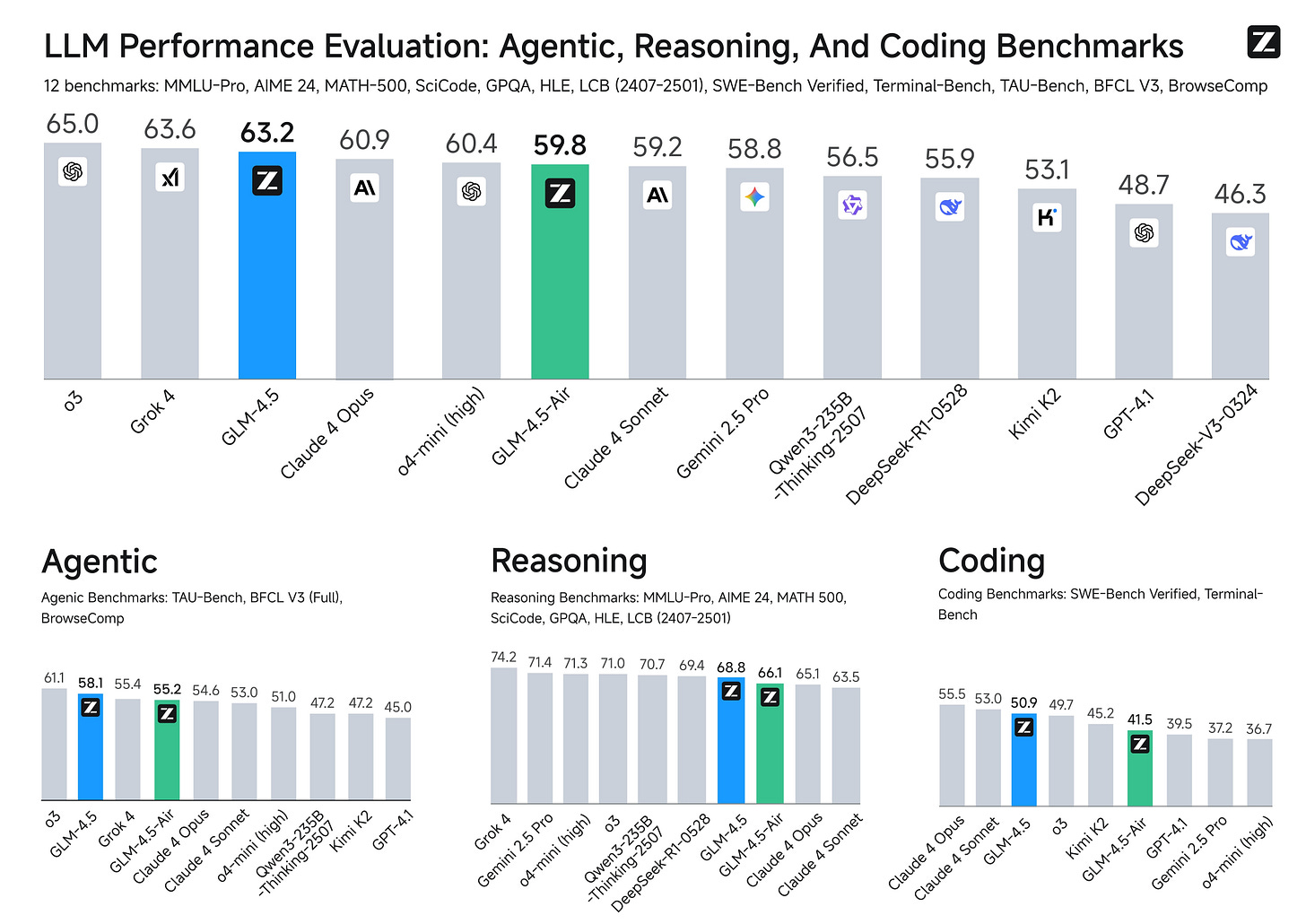

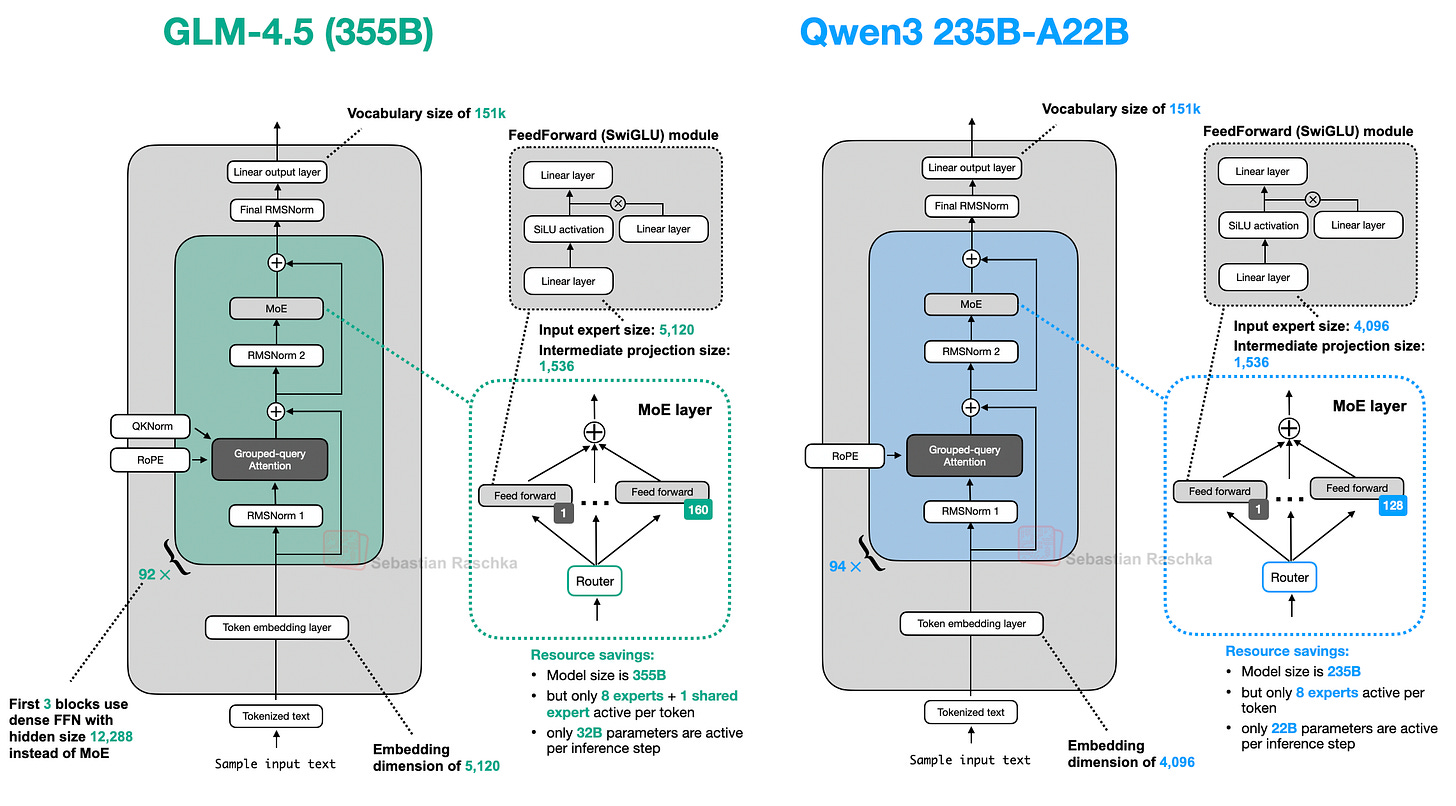

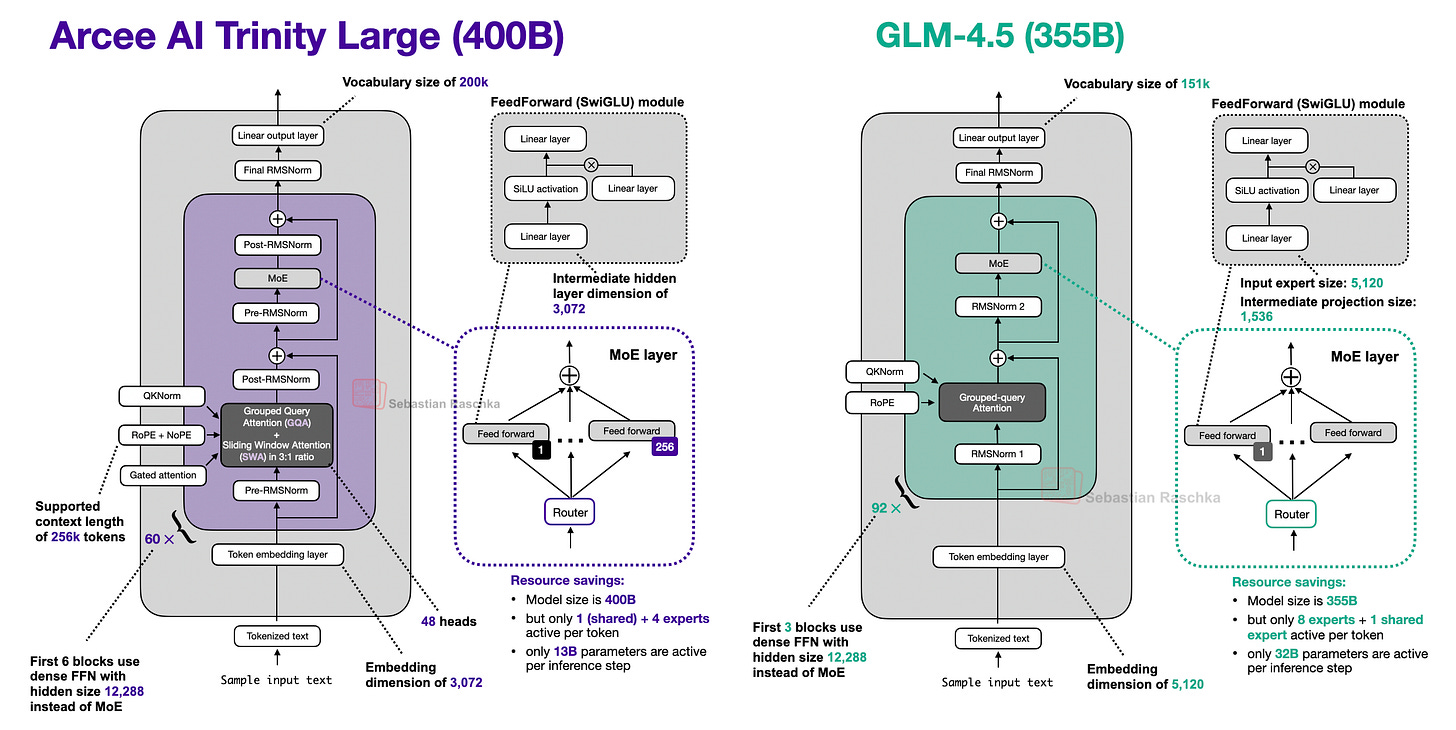

11. GLM-4.5

GLM-4.5 是今年的另一個重大發佈。

它是一款指令/推理混合模型,類似於 Qwen3,但針對函數調用(function calling)和智能體(agent)風格的上下文進行了更好的優化。

如圖 34 所示,GLM-4.5 有兩個變體。旗艦級 3550 億參數模型在 12 個基準測試中的平均表現超過了 Claude 4 Opus,僅略落後於 OpenAI 的 o3 和 xAI 的 Grok 4。還有 GLM-4.5-Air,這是一個更緊湊的 1060 億參數版本,其性能僅略低於 355B 模型。

圖 35 將 355B 架構與 Qwen3 進行了比較。

兩者的設計大體相似,但 GLM-4.5 採用了 DeepSeek V3 率先引入的一種結構選擇:在混合專家 (MoE) 區塊之前放置 3 個稠密層。為什麼?在大型 MoE 系統中,從幾個稠密層開始可以提高收斂穩定性和整體性能。如果立即引入 MoE 路由,稀疏專家選擇的不穩定性可能會干擾早期的句法和語義特徵提取。因此,可以說通過保持初始層為稠密層,可以確保模型在路由決策開始塑造更高級別的處理之前,形成穩定的低級表示。

此外,GLM-4.5 與 DeepSeek V3 類似,也使用了共享專家(而 Qwen3 則沒有)。

(有趣的是,GLM-4.5 也保留了 GPT-2 和 gpt-oss 中使用的注意力偏置機制。)

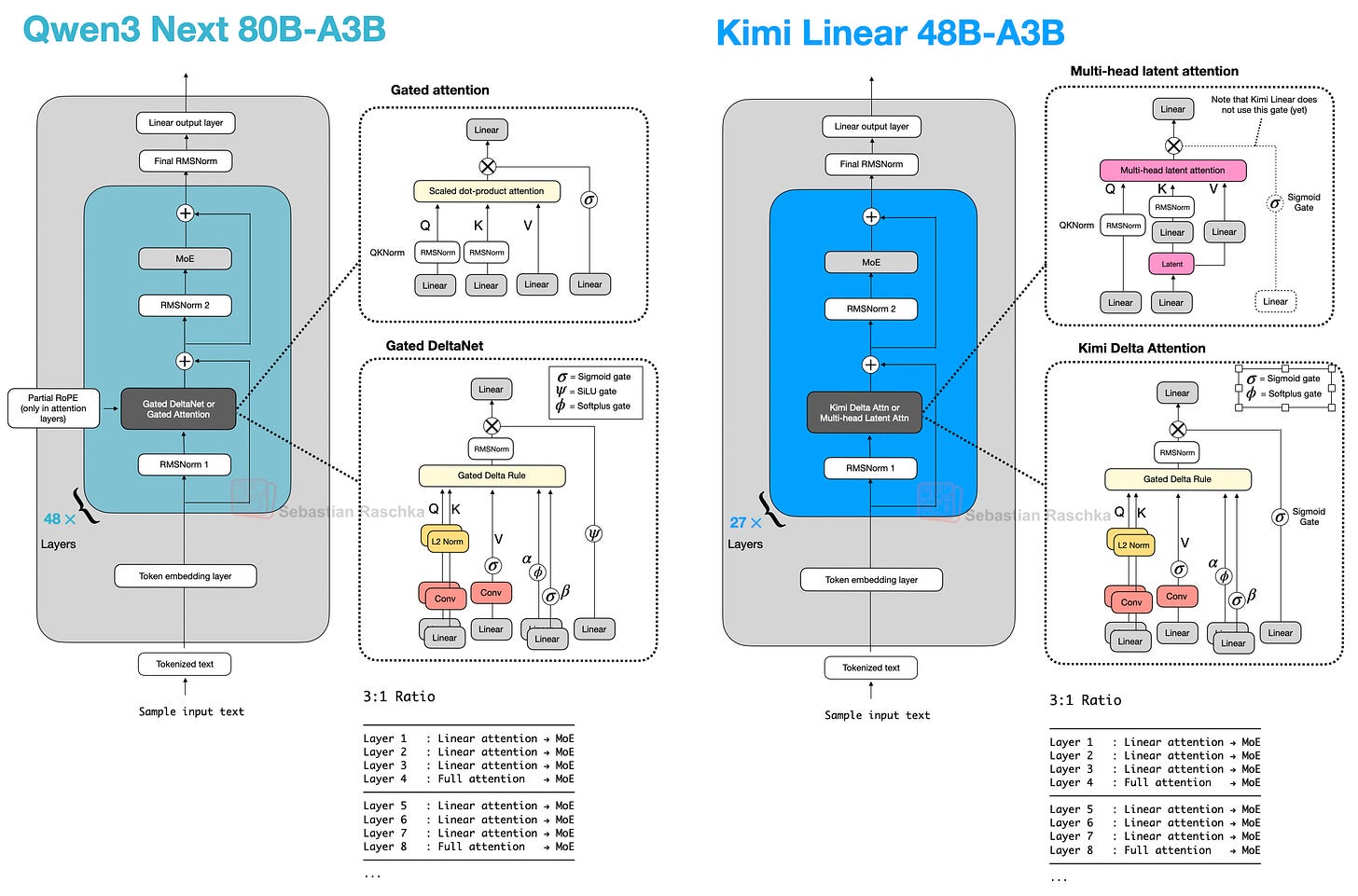

12. Qwen3-Next

2025 年 9 月 11 日,Qwen3 團隊發佈了 Qwen3 Next 80B-A3B(圖 35),提供 Instruct 和 Thinking 兩個版本。雖然其設計基於之前討論過的 Qwen3 架構,但我將其作為一個單獨的條目列出,以保持圖表編號一致,並引起對其設計變化的一些關注。

12.1 專家大小與數量

新的 Qwen3 Next 架構之所以脫穎而出,是因為儘管其體積比之前的 235B-A22B 模型小 3 倍(圖 35),但它引入了四倍數量的專家,甚至增加了一個共享專家。這兩個設計選擇(高專家數量和包含共享專家)都是我在這次發佈之前強調過的未來方向,特別是在我在頂部鏈接的影片版本文章中。

12.2 Gated DeltaNet + Gated Attention 混合機制

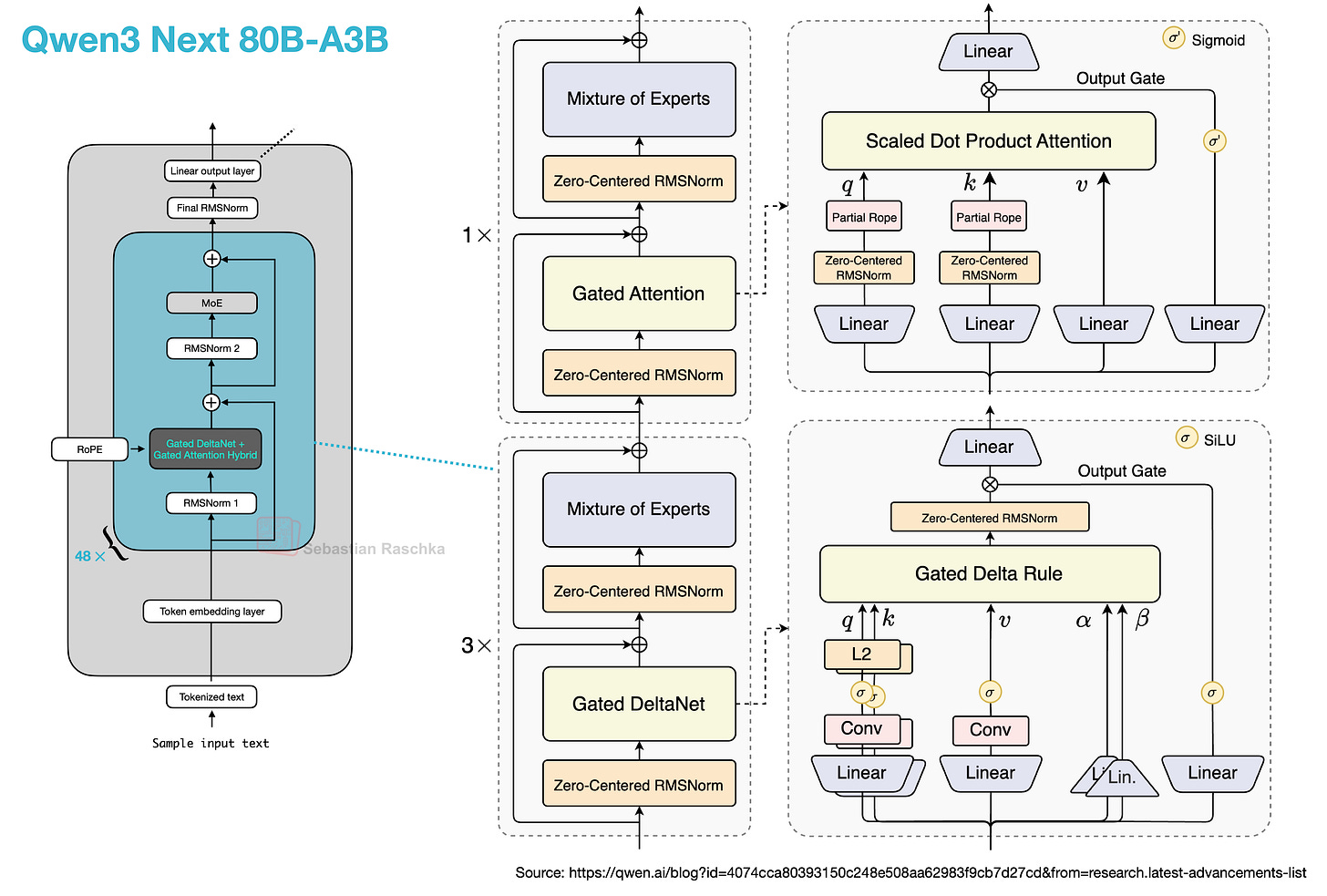

另一個亮點是他們用 Gated DeltaNet + Gated Attention 混合機制取代了常規的注意力機制,這有助於在內存使用方面實現原生的 262k Token 上下文長度(之前的 235B-A22B 模型原生支持 32k,通過 YaRN 縮放支持 131k)。

那麼這種新的注意力混合機制是如何運作的?與分組查詢注意力 (GQA) 相比(GQA 仍是標準的縮放點積注意力,通過在查詢頭組之間共享 K/V 來削減 KV 快取大小和內存帶寬,如前所述,但其解碼成本和快取仍隨序列長度增長),他們的混合機制以 3:1 的比例混合了 Gated DeltaNet 區塊和 Gated Attention 區塊,如圖 36 所示。

我們可以將 Gated Attention 區塊看作是可以在 GQA 中使用的標準縮放點積注意力,但在此基礎上進行了一些調整。Gated Attention 與普通 GQA 區塊的主要區別在於:

一個輸出門(由 Sigmoid 控制,通常是逐通道的),在注意力結果加回殘差之前對其進行縮放;

用於 QKNorm 的零中心 RMSNorm,而非標準 RMSNorm;

部分 RoPE(僅在維度的子集上應用)。

請注意,這些本質上只是對 GQA 的穩定性改進。

Gated DeltaNet 則是一個更顯著的變化。在 DeltaNet 區塊中,q、k、v 和兩個門 (α, β) 由帶有歸一化的線性層和輕量級卷積層產生,該層用快速權重 Delta 規則更新取代了注意力。

然而,權衡之處在於 DeltaNet 提供的基於內容的檢索精度低於完整注意力,這就是為什麼保留了一個 Gated Attention 層的原因。

鑑於注意力呈二次方增長,加入 DeltaNet 組件是為了幫助提高內存效率。在「線性時間、無快取」家族中,DeltaNet 區塊本質上是 Mamba 的替代方案。Mamba 通過學習的狀態空間濾波器(本質上是隨時間變化的動態卷積)來保持狀態。DeltaNet 則保持一個由 α 和 β 更新的小型快速權重內存,並用 q 讀取,小卷積僅用於幫助形成 q、k、v、α、β。

12.3 多 Token 預測 (Multi-Token Prediction)

上述兩個小節描述了兩個旨在提高效率的設計決策。既然好事成三,Qwen3 還在上面添加了另一項效率技術:多 Token 預測 (MTP)。

(請注意,DeepSeek V3 和 V3.2,以及後來的 GLM-4.5 和 MiniMax-M2 都在訓練期間使用 MTP;然而,由於它是一項訓練技術,我沒有在架構比較中明確討論它。)

多 Token 預測訓練 LLM 在每一步預測多個未來 Token,而非僅預測一個。在這裡,在每個位置 t,額外的小頭(線性層)輸出 t+1...t+k 的對數,我們對這些偏移量求交叉熵損失之和(在 MTP 論文中,研究人員建議 k=4)。這種額外的信號加速了訓練,而推理時仍可保持一次生成一個 Token。然而,額外的頭可以用於投機性多 Token 解碼(speculative multi-token decoding),這似乎是 Qwen3-Next 所做的,不過細節仍然較少:

Qwen3-Next 引入了原生多 Token 預測 (MTP) 機制,這不僅產生了一個對投機解碼具有高接受率的 MTP 模塊,還增強了整體性能。此外,Qwen3-Next 專門優化了 MTP 的多步推理性能,通過保持訓練和推理一致性的多步訓練,進一步提高了投機解碼在真實場景中的接受率。來源:Qwen3-Next 博客文章

12.4 Qwen3-Coder-Next

2026 年 2 月初,Qwen3 團隊分享了 80B 的 Qwen3-Coder-Next 模型(3B 活動參數),該模型因在編碼任務上超越了 DeepSeek V3.2 (37B 活動) 以及 Kimi K2.5 和 GLM-7.5 (均為 32B 活動) 等大得多的模型而登上頭條。

此外,Qwen3-Coder-Next 的 SWE-Bench Pro 表現與 Claude-Sonnet-4.5 大致持平(僅略低於 Claude-Opus-4.5),這對於一個開源權重模型來說非常令人印象深刻!

請注意,Qwen3-Coder-Next 背後的架構與我們上面討論的 Qwen3-Next 80B 完全相同(事實上,他們使用 Qwen3-Next 作為基礎模型來訓練 Qwen3-Coder-Next)。由於這是一篇關於 LLM 架構的文章,訓練細節超出了範圍。不過,感興趣的讀者可以在 GitHub 上找到他們詳盡的技術報告。

13. MiniMax-M2

最近,開源權重 LLM 開發者分享了其核心架構的效率優化版本。一個例子是 Qwen3-Next(見上一節),它用快速的 Gated DeltaNet 模塊替換了一些全注意力區塊。另一個例子是 DeepSeek V3.2,它使用了稀疏注意力(sparse attention),這是一種線性注意力變體,以犧牲部分建模性能為代價來換取計算性能的提升(我計劃在即將發表的文章中更詳細地介紹這一機制)。

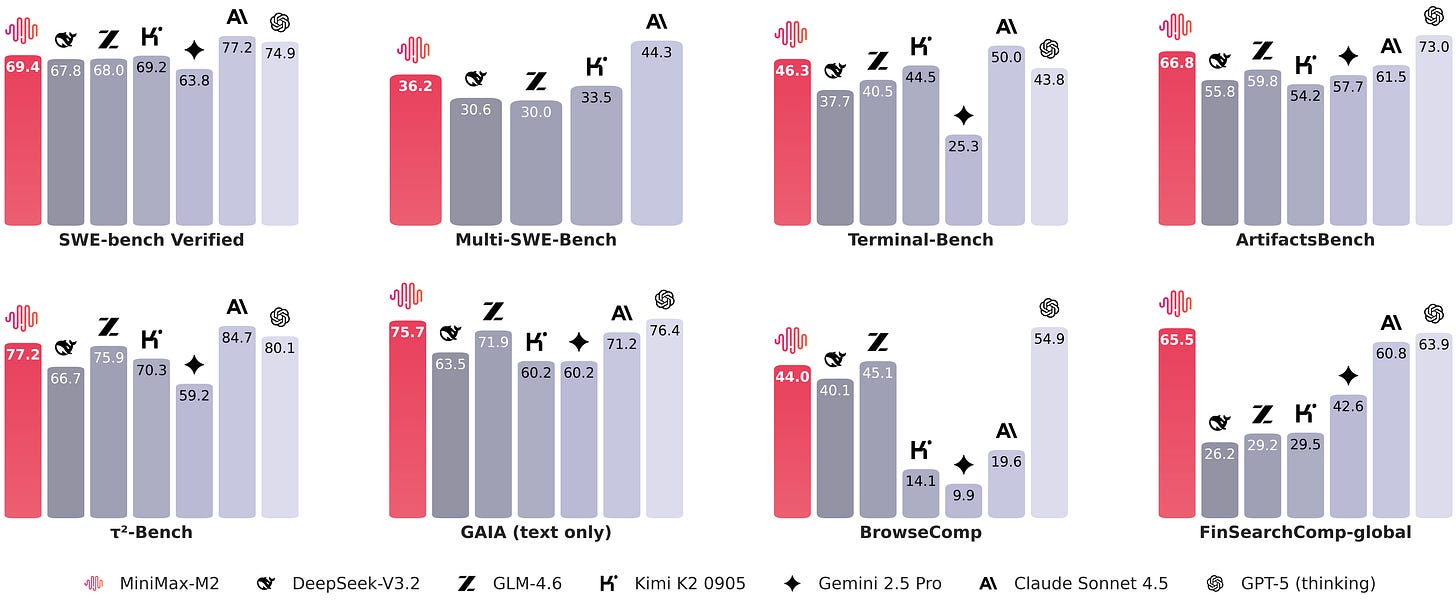

現在,MiniMax-M1 與上述模型屬於同一類別,因為它使用了一種線性注意力變體(Lightning Attention),提供了優於常規(全)注意力的效率。我最初沒有涵蓋 MiniMax M1,因為它不像這裡討論的其他一些模型那樣受歡迎。然而,他們新發佈的 MiniMax-M2 目前被認為是最好的開源權重模型(根據基準測試表現),這使得它不容忽視。

如下方的概覽圖所示,我將 MiniMax-M2 與其他解碼器風格的 Transformer LLM 歸為一類,因為它沒有使用 MiniMax-M1 中提出的高效 Lightning Attention 變體。相反,開發者回到了使用全注意力,可能是為了提高建模(和基準測試)性能。

總體而言,MiniMax-M2 與 Qwen3 驚人地相似。除了改變層數、大小等之外,它總體上使用了相同的組件。

13.1 逐層 QK-Norm (Per-Layer QK-Norm)

或許這裡唯一值得注意的亮點是 MiniMax-M2 使用了所謂的「逐層」QK-Norm 而非普通的 QK-Norm。仔細查看代碼可以發現,它在注意力機制內部是這樣實現的:

這裡,hidden_size 等於拼接後的頭(num_heads * head_dim),因此 RMSNorm 有一個縮放向量,為每個頭(以及每個頭維度)提供不同的參數。

因此,「逐層」意味著 RMSNorm(如前所述用於 QK-Norm)在每個 Transformer 區塊中定義(如常規 QK-Norm),但此外,它不是在注意力頭之間重複使用,而是為每個注意力頭提供唯一的 QK-Norm。

模型配置文件還包含滑動窗口注意力設置(類似於第 3 節中的 Gemma 3),但與第 4 節討論的 Mistral 3.1 一樣,它默認是禁用的。

除此之外,除了逐層 QK-Norm,架構與 Qwen3 非常相似,如下圖所示。

13.2 MoE 稀疏性

其他有趣的細節如圖所示,包括他們沒有使用共享專家(類似於 Qwen3 但不同於 Qwen3-Next)。如前所述,在我看來,共享專家很有用,因為它們減少了其他專家之間的冗餘。

此外,從上圖可以明顯看出,MiniMax-M2 的「稀疏度」是 Qwen3 的兩倍。也就是說,在與 Qwen3 235B-A22B 大致相同的大小下,MiniMax-M2 每個 Token 只有 10B 而非 22B 的活動專家(即 MiniMax-M2 在每個推理步驟中使用了 4.37% 的參數,而 Qwen3 使用了 9.36% 的活動 Token)。

13.3 部分 RoPE (Partial RoPE)

最後,與 MiniMax-M1 類似,MiniMax-M2 在注意力模塊內部使用「部分」而非全 RoPE 來編碼位置信息。與常規 RoPE 類似,旋轉是在應用 QK-Norm 後應用於查詢和鍵的。

這裡的部分 RoPE 意味著每個頭只有前 rotary_dim 個通道獲得旋轉位置編碼,其餘的 head_dim - rotary_dim 個通道保持不變。

在官方 M1 README 文件中,開發者提到:

旋轉位置嵌入 (RoPE) 應用於一半的注意力頭維度,基礎頻率為 10,000,000

我們可以將其想像如下:

在上面的概念圖中,「r」表示旋轉(位置編碼)維度,破折號是未觸動的維度。

這樣做的意義何在?在 M1 論文中,開發者指出:

……在 softmax 注意力的一半維度上實現 RoPE 可以實現長度外推而不會降低性能。

我的推測是,這可以防止長序列(特別是那些比訓練數據集中最長文檔還要長的序列)出現「過多」的旋轉。也就是說,這裡的理由可能是:不旋轉總比模型在訓練中未見過的「糟糕」或「過於極端」的旋轉要好。

14. Kimi Linear

最近,線性注意力機制為了提高 LLM 效率而再次興起。

《Attention Is All You Need》(2017) 論文中引入的注意力機制,即縮放點積注意力,仍然是當今 LLM 中最受歡迎的注意力變體。除了傳統的多頭注意力外,它還被用於更高效的變體,如分組查詢注意力、滑動窗口注意力和多頭潛在注意力。

14.1 傳統注意力與二次方成本

原始注意力機制隨序列長度呈二次方縮放:

這是因為查詢 (Q)、鍵 (K) 和值 (V) 是 n×d 矩陣,其中 d 是嵌入維度(一個超參數),n 是序列長度(即 Token 數量)。

您可以在我的另一篇文章中找到關於注意力的更多細節:

理解並編寫 LLM 中的自注意力、多頭注意力、因果注意力與交叉注意力

14.2 線性注意力

線性注意力變體已經存在很長時間了,我記得在 2020 年代看過大量論文。例如,我記得最早的一篇是 2020 年的《Transformers are RNNs: Fast Autoregressive Transformers with Linear Attention》論文,研究人員在其中對注意力機制進行了近似:

這裡,φ(·) 是一個核特徵函數,設置為 φ(x) = elu(x) + 1。

這種近似是高效的,因為它避免了顯式計算 n × n 注意力矩陣 QK^T。它不是執行所有成對的 Token 交互(這會耗費 O(n^2d) 的時間和內存)。

我不想在這些舊嘗試上停留太久。但底線是,它們將時間和內存複雜度從 O(n^2) 降低到 O(n),使注意力在長序列中更加高效。

然而,它們從未真正流行起來,因為它們降低了模型準確性,而且我從未真正見過這些變體應用於開源的尖端 LLM 中。

14.3 線性注意力的復興

在今年下半年,線性注意力變體出現了一點復興。第一個值得注意的模型是帶有 Lightning Attention 的 MiniMax-M1,這是一個 456B 參數的混合專家 (MoE) 模型,具有 46B 活動參數,於 6 月份推出。

隨後在 8 月,Qwen3 團隊推出了 Qwen3-Next,我在上面進行了更詳細的討論。接著在 9 月,DeepSeek 團隊宣佈了 DeepSeek V3.2。這三個模型(MiniMax-M1、Qwen3-Next、DeepSeek V3.2)在其大部分或所有層中,都用高效的線性變體取代了傳統的二次方注意力變體。

有趣的是,最近出現了一個轉折:MiniMax 團隊發佈了他們新的 230B 參數 M2 模型(在第 13 節討論),卻沒有使用線性注意力,而是回到了常規注意力。該團隊表示,線性注意力在生產級 LLM 中很棘手。它在處理常規提示時似乎表現良好,但在推理和多輪對話任務中準確性較差,而這些任務不僅對常規聊天會話很重要,對智能體應用也至關重要。

這本可以成為一個轉折點,表明線性注意力或許不值得追求。然而,事情變得更有趣了。10 月,Kimi 團隊發佈了他們帶有線性注意力的新 Kimi Linear 模型。

側記:我本可以將 Qwen3-Next 和 Kimi Linear 與概覽圖中的其他 Transformer-狀態空間模型 (SSM) 混合體歸為一類。就個人而言,我將這些其他 Transformer-SSM 混合體視為帶有 Transformer 組件的 SSM,而我將這裡討論的模型(Qwen3-Next 和 Kimi Linear)視為帶有 SSM 組件的 Transformer。然而,既然我已經將 IBM Granite 4.0 和 NVIDIA Nemotron Nano 2 列在 Transformer-SSM 框中,將它們放入同一個類別也是有道理的。

14.4 Kimi Linear vs. Qwen3-Next

Kimi Linear 與 Qwen3-Next 在結構上有幾處相似之點。兩款模型都依賴於混合注意力策略。具體來說,它們將輕量級線性注意力與較重的全注意力層相結合。具體而言,兩者都採用 3:1 的比例,這意味著每三個採用線性 Gated DeltaNet 變體的 Transformer 區塊,就有一個區塊使用全注意力,如下圖所示。

Gated DeltaNet 是一種線性注意力變體,靈感來自循環神經網絡,包括來自《Gated Delta Networks: Improving Mamba2 with Delta Rule》論文的門控機制。從某種意義上說,Gated DeltaNet 是帶有 Mamba 風格門控的 DeltaNet,而 DeltaNet 是一種線性注意力機制。由於本文的概覽性質,DeltaNet 將是未來另一篇文章的好主題。

請注意,上圖中 Kimi Linear 部分故意省略了 RoPE 框。Kimi 在多頭潛在注意力 (MLA) 層(全局注意力)中應用了 NoPE(無位置嵌入)。正如作者所述,這讓 MLA 在推理時作為純多查詢注意力運行,並避免了長上下文縮放時的 RoPE 重新調整(位置偏置據稱由 Kimi Delta Attention 區塊處理)。欲了解關於 MLA 和多查詢注意力(分組查詢注意力的一種特例)的更多信息,請參閱我的《大型 LLM 架構大比拼》文章。

此外,我還在這裡寫了更多關於 Gated DeltaNet 的內容。

14.5 Kimi Delta Attention

Kimi Linear 通過 Kimi Delta Attention (KDA) 機制修改了 Qwen3-Next 的線性注意力機制,這本質上是 Gated DeltaNet 的改進。Qwen3-Next 應用標量門(每個注意力頭一個值)來控制內存衰減率,而 Kimi Linear 則為每個特徵維度替換為逐通道門控。據作者稱,這提供了對內存的更多控制,進而改善了長上下文推理。

此外,對於全注意力層,Kimi Linear 將 Qwen3-Next 的門控注意力層(本質上是帶有輸出門控的標準多頭注意力層)替換為多頭潛在注意力 (MLA)。這與我們之前在 DeepSeek V3/R1 部分討論過的 MLA 機制相同,但增加了一個門。(回顧一下,MLA 壓縮了鍵/值空間以減小 KV 快取大小。)

目前還沒有與 Qwen3-Next 的直接比較,但與《Gated DeltaNet》論文中的 Gated DeltaNet-H1 模型(本質上是帶有滑動窗口注意力的 Gated DeltaNet)相比,Kimi Linear 在保持相同 Token 生成速度的同時實現了更高的建模準確性。

此外,根據 DeepSeek-V2 論文中的消融研究,當超參數經過精心選擇時,MLA 與常規全注意力不相上下。

而 Kimi Linear 在長上下文和推理基準測試中表現優異,這一事實使得線性注意力變體再次成為大型尖端模型的希望。話雖如此,Kimi Linear 雖然有 48B 參數,但比 Kimi K2 小 20 倍。Kimi 團隊是否會在即將推出的 K3 模型中採用這種方法,將會非常有趣。

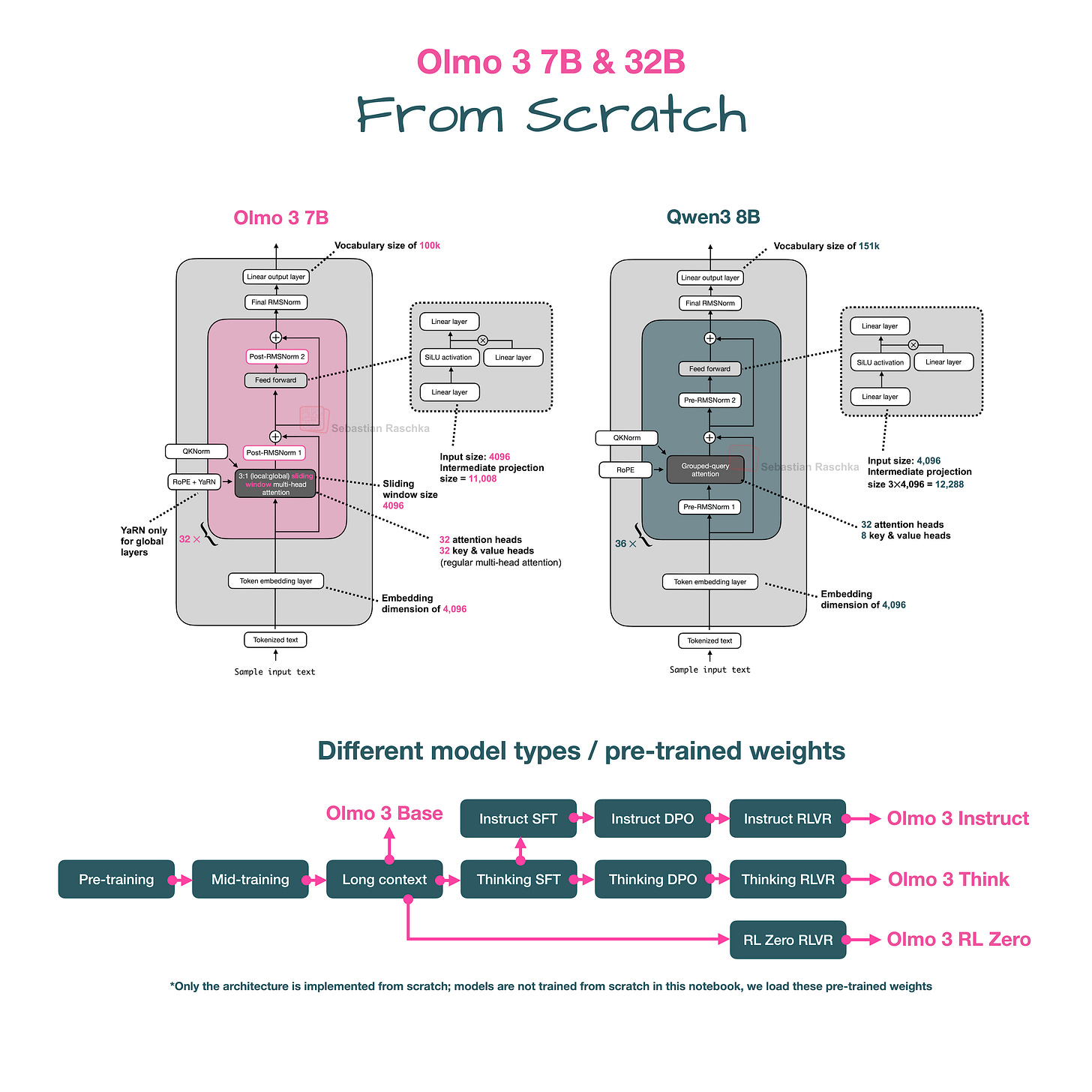

15. Olmo 3 Thinking

Allen AI 於 11 月 20 日發佈了新的 Olmo 3 7B 和 32B 模型。(官方拼寫從 OLMo 改為 Olmo,因此我在本節中將採用此拼寫。)

如前所述,Olmo 模型總是很有趣,因為它們是完全開源的。在這裡,這意味著團隊還分享了詳細的訓練報告、多個檢查點、關於訓練數據的信息等等。換句話說,Olmo 模型是完全透明的。

這一次,Olmo 套件還提供了一種額外的推理模型版本(與基礎和指令模型並列),Olmo 3 的技術報告中有很多關於訓練的有趣細節。然而,既然這是一篇關於架構比較的文章,本節僅關注 Olmo 3 的架構。

與 Olmo 3 最接近的比較模型是 Qwen3,因為 Qwen3 系列有兩個尺寸相似的模型,且 Qwen3 模型具有相似的性能。

首先,讓我們看看兩者中較小的一個,Olmo 3 7B。

我們可以看到,Olmo 3 的架構與 Qwen3 相對相似。然而,值得注意的是,這本質上可能是受 Olmo 2 前身的啟發,而非 Qwen3。

與 Olmo 2 類似,Olmo 3 仍然使用 Post-Norm 而非 Pre-Norm,因為他們在 Olmo 2 論文中發現這能穩定訓練。

有趣的是,7B 模型仍然使用與 Olmo 2 類似的多頭注意力。然而,為了提高效率並縮小 KV 快取大小,他們現在使用了滑動窗口注意力(例如,類似於 Gemma 3)。

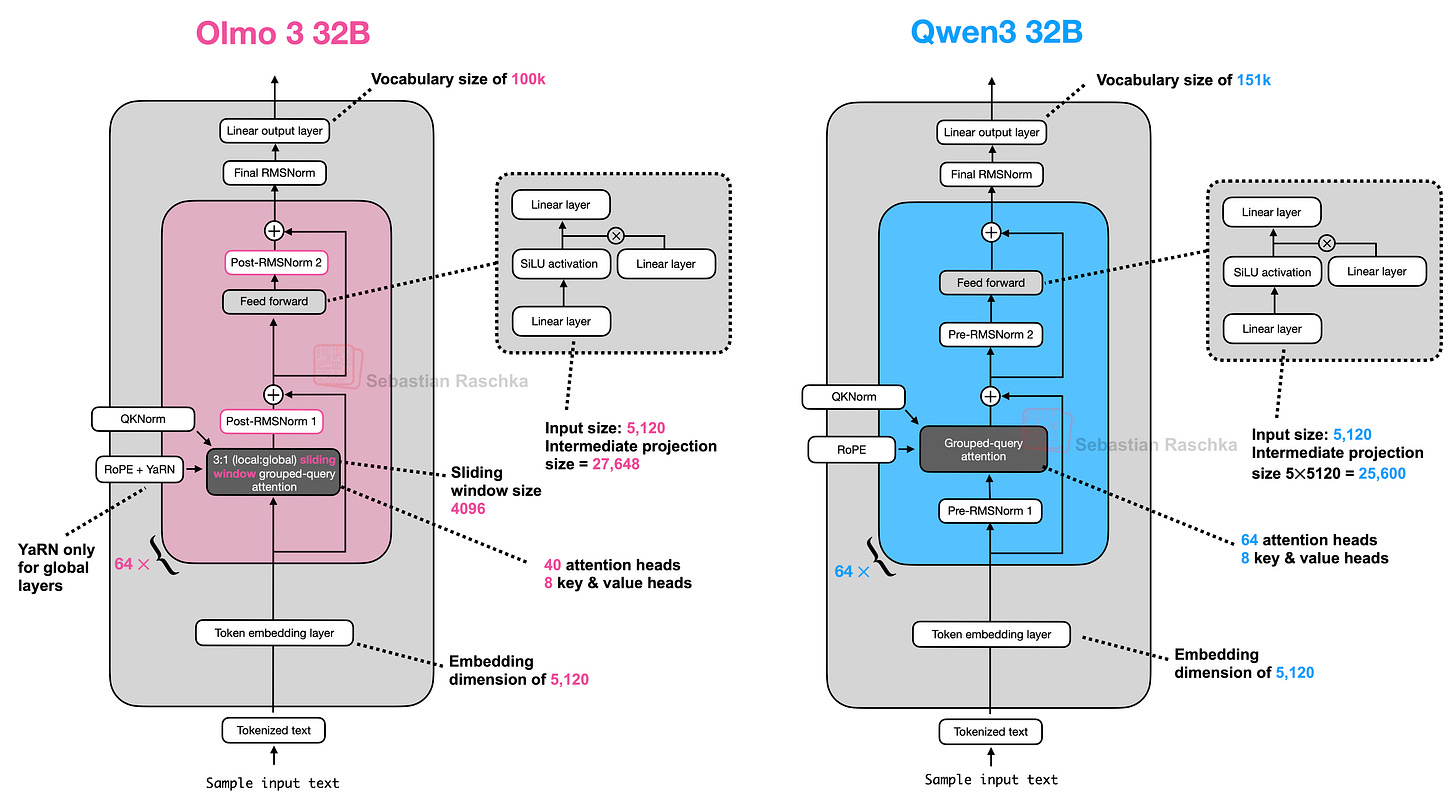

接下來,讓我們看看 32B 模型。

總體而言,它是相同的架構,只是按比例放大了。此外,比例(例如從輸入到前饋層的中間大小,等等)與 Qwen3 大致匹配。

我的猜測是,由於詞彙量較小,架構最初比 Qwen3 稍小,然後他們將中間大小擴展從 Qwen 3 的 5 倍增加到 Olmo 3 的 5.4 倍,以便擁有一個 32B 模型進行直接比較。

此外,請注意 32B 模型使用的是分組查詢注意力。

最後一個小細節或許是 Olmo 3 使用 YaRN 進行上下文擴展,以支持 64k 的上下文長度,但僅用於全局(非滑動窗口注意力)層。(YaRN 本質上是一種精細的 RoPE 重新縮放技術,有助於在長上下文尺寸下更好地保持模型質量。)

在 Qwen3 中,YaRN 是可選的,可將原生上下文從 32k Token 擴展到 131k Token。

如果您對額外的架構細節感興趣,我在這裡的一個獨立筆記本中從零開始實現了 Olmo 3。

16. DeepSeek V3.2

這篇文章從 DeepSeek V3 開始,它是在 2024 年 12 月發佈的。那時有多個 DeepSeek 版本發佈,但我基本上跳過了它們,因為它們不像 DeepSeek V3 和 DeepSeek R1 那樣是重大的旗艦模型發佈。

然而,DeepSeek V3.2 是一個非常重大的發佈,因為它在某些基準測試中與目前的 GPT-5.1 和 Gemini 3.0 Pro 模型不相上下。

架構總體上與 DeepSeek V3 相似,但他們增加了一種稀疏注意力機制以提高效率。

我最初計劃為本文寫一節關於 DeepSeek V3.2 的簡短內容,但它變成了一篇超過 5000 字的文章,所以我將其移至一篇單獨的文章,鏈接如下:

DeepSeek 模型技術之旅:從 V3 到 V3.2

17. Mistral 3

2025 年 12 月 2 日,即 DeepSeek V3.2 發佈後的第二天,Mistral 團隊發佈了他們新的 Mistral 3 模型套件。這包括三個較小的稠密模型(3B、8B 和 14B),名稱為 Ministral 3,以及他們新的旗艦模型 Mistral 3 Large,這是一個 675B 參數的 MoE(活動參數為 41B)。更具體地說,Mistral 3 Large 模型由以下部分組成:

一個擁有 673B 參數、39B 活動參數的 MoE 語言模型

一個 2.5B 的視覺編碼器

(由於本文專注於 LLM 方面,我們將在本節中忽略視覺編碼器。不過,我或許應該在某個時候更新我的多模態 LLM 文章。)

首先,有趣的是,這是自 2023 年 Mixtral 以來 Mistral 的首個 MoE(在本文早些時候,我寫過 Mistral 放棄了 MoE,而去年的 DeepSeek V3 引領了 MoE 的復興)。

發佈博客文章稱,所有尺寸的模型都提供基礎、指令和推理變體,這很好。然而,其 675B 模型的推理版本尚未推出。

另一個有趣的細節是,根據他們的公告,Mistral 在這裡與 NVIDIA 合作,優化了 Blackwell 芯片上的 Token/秒吞吐量。這很好,因為這意味著 Ministral 模型在我的 DGX Spark 上運行速度會比同類模型快一點(我還需要測試一下)。

除了 Mistral 3 的 Token/秒速度優勢外,基於質量基準測試,雖然其較小的模型 Ministral 看起來與 Qwen3 不相上下。較大的旗艦模型則與 DeepSeek V3.1 相當。

由於 Mistral 3 的發佈僅在 DeepSeek V3.2 發佈後的一天,他們在文章中沒有包含任何 V3.2 的比較(除了 LMArena Elo 分數,DeepSeek V3.2 以 1423 對 1418 略微領先)。

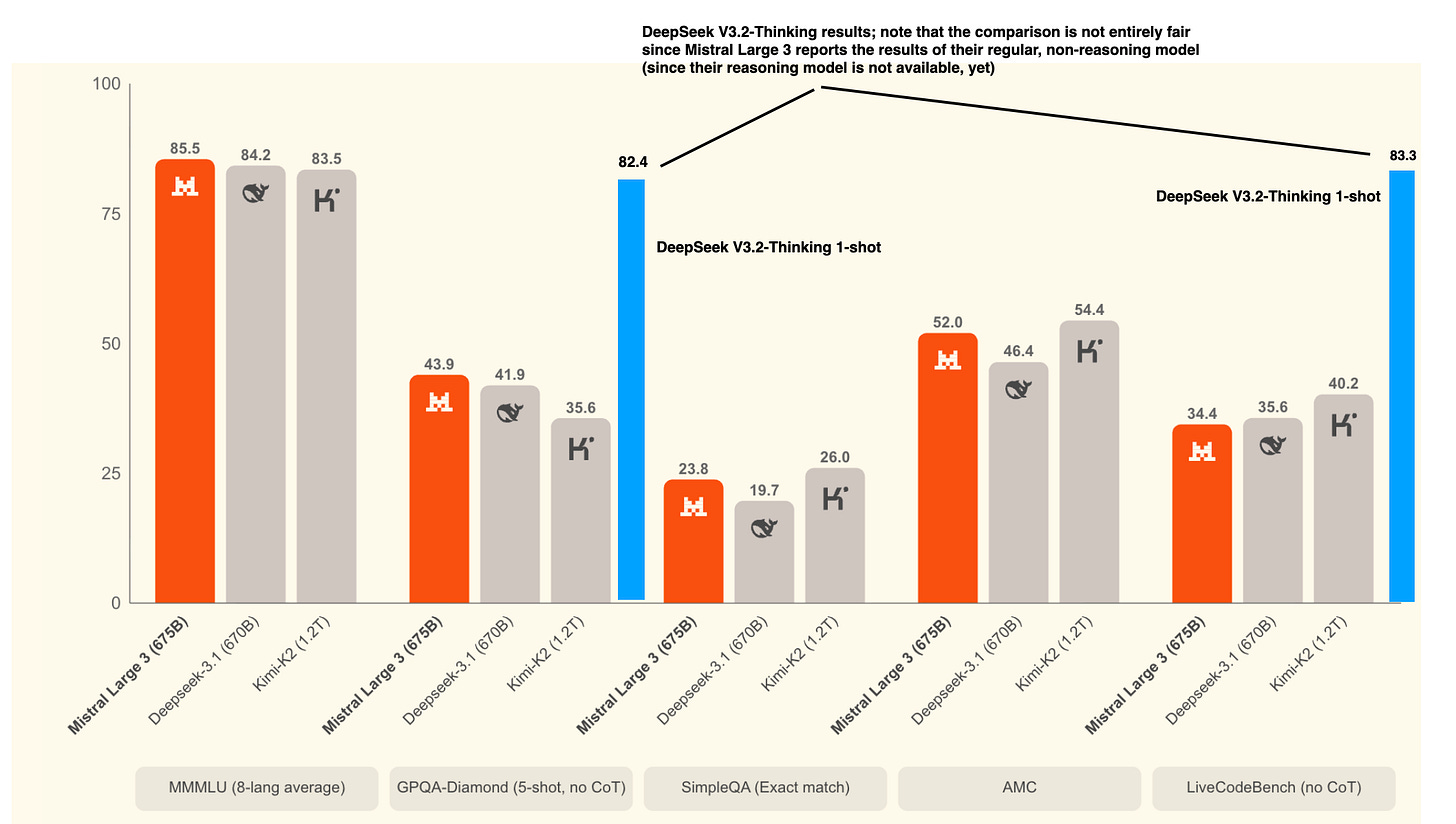

遺憾的是,目前無法進行「蘋果對蘋果」的比較,因為 Mistral 3 Large 目前還沒有推理模型,而 DeepSeek V3.2 沒有分享其非思考模式的基準測試結果,但如果您感到好奇,我將 DeepSeek V3.2-Thinking 的數據(來自 DeepSeek V3.2 報告)疊加到了 Mistral 3 Large 的基準測試圖表中。

觀察 Mistral Large 3 Instruct 模型及其旁邊的 DeepSeek V3.2-Thinking 模型(數據來自 DeepSeek V3.2 論文),V3.2-Thinking 模型顯然要好得多。因此,我正在關注 Mistral 3 Large Thinking 的發佈,並期待看到更新後的圖表!

所以,目前我會說,得益於優化,Mistral 3 Large 是成本效益高、低延遲部署的絕佳候選者。如果您想最大化回答質量,DeepSeek V3.2-Thinking 則非常出色。Mistral 3 Large 的另一個賣點是它還提供多模態支持(DeepSeek V3.2 僅限文本)。

順便說一下,我在本節中對 DeepSeek V3.2 的關注源於這些模型發佈時間如此接近,僅相隔一天。此外,它們的大小幾乎相同,分別為 671B 和 673B,這使得比較非常有趣!

遺憾的是,沒有包含更多關於模型開發信息的技術報告。然而,既然它是一個開源權重模型,我們確實可以在 Hugging Face hub 上分析模型權重。那麼,讓我們仔細看看 Mistral 3 Large。

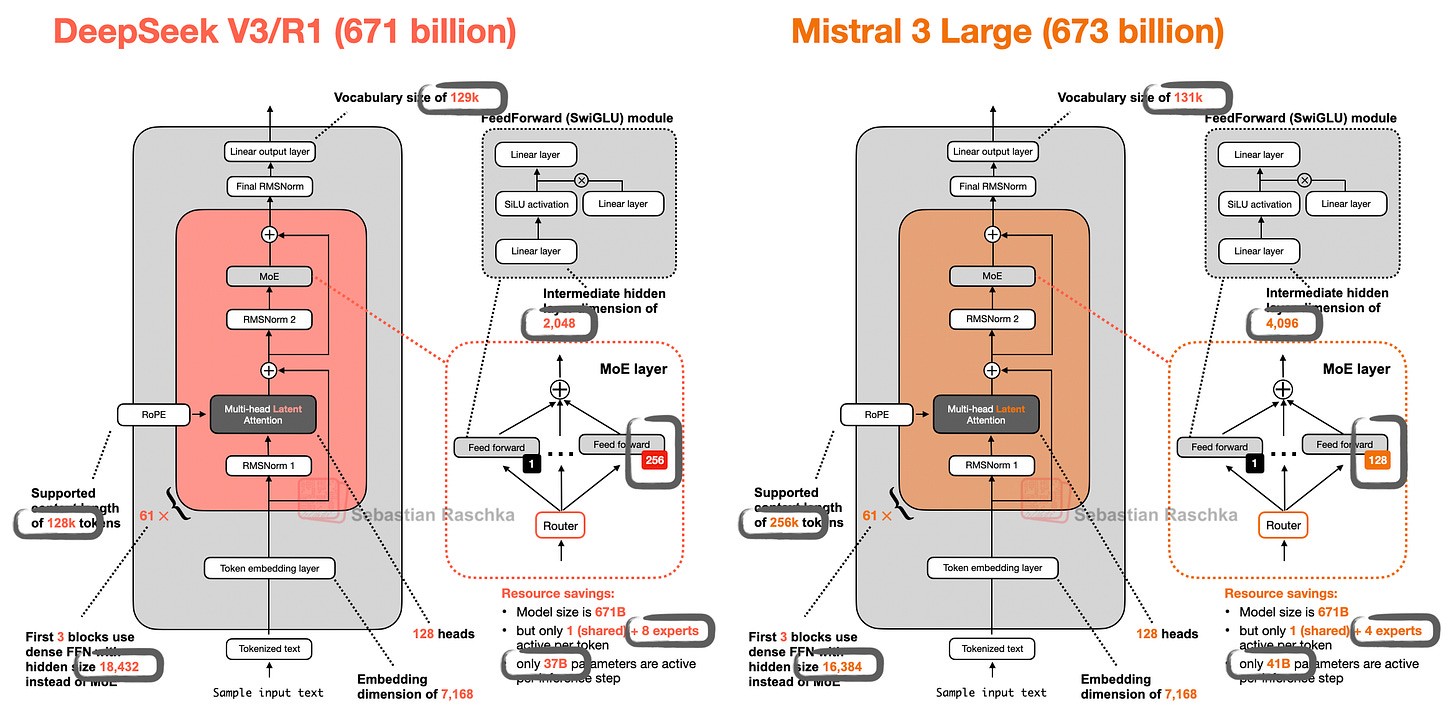

事實證明,Mistral 3 Large 的架構與 DeepSeek V3 和 V3.1 完全相同!唯一的區別是他們將專家的規模增加了 2 倍,同時將專家的數量減少了相同的倍數。

然而,雖然它實際上是相同的架構,但 Mistral 團隊很可能是從零開始訓練 Mistral 3,而不是從 DeepSeek V3 初始化並進一步訓練,因為 Mistral 使用了自己的分詞器。

繼 Kimi K2 之後,Mistral 3 現在是第二個使用 DeepSeek V3 架構的模型系列。然而,Kimi K2 團隊將模型大小從 671B 擴展到了 1 兆,而 Mistral 3 團隊僅更改了專家大小比例,並增加了一個視覺編碼器以支持多模態。但是,為什麼不呢?我認為 DeepSeek V3 是一個非常紮實的架構設計,此外它還有這些不錯的 MoE 和 MLA 效率特性。所以,既然沒壞,為什麼要改呢?如今很多秘訣都在於訓練流水線以及推理縮放策略。

18. Nemotron 3

本文並非詳盡列出市面上所有的 LLM。為了保持篇幅可控,我專注於主要的亮點。這裡的「亮點」意味著它們要麼非常受歡迎,要麼表現非常好,要麼具有有趣的架構組件。

話雖如此,是時候終於將 NVIDIA 的一款模型加入這個名單了。NVIDIA 剛剛在 2025 年 12 月 15 日發佈了 Nemotron 系列的最新成員 Nemotron 3。Nemotron 的優點在於,它不僅提供開源權重和技術報告,NVIDIA 還分享了數據集和訓練代碼,類似於 Olmo 3。

根據公告文章,Nemotron 3 有三種尺寸:

-

Nano (30B-A3B),

-

Super (100B),

-

以及 Ultra (500B)。

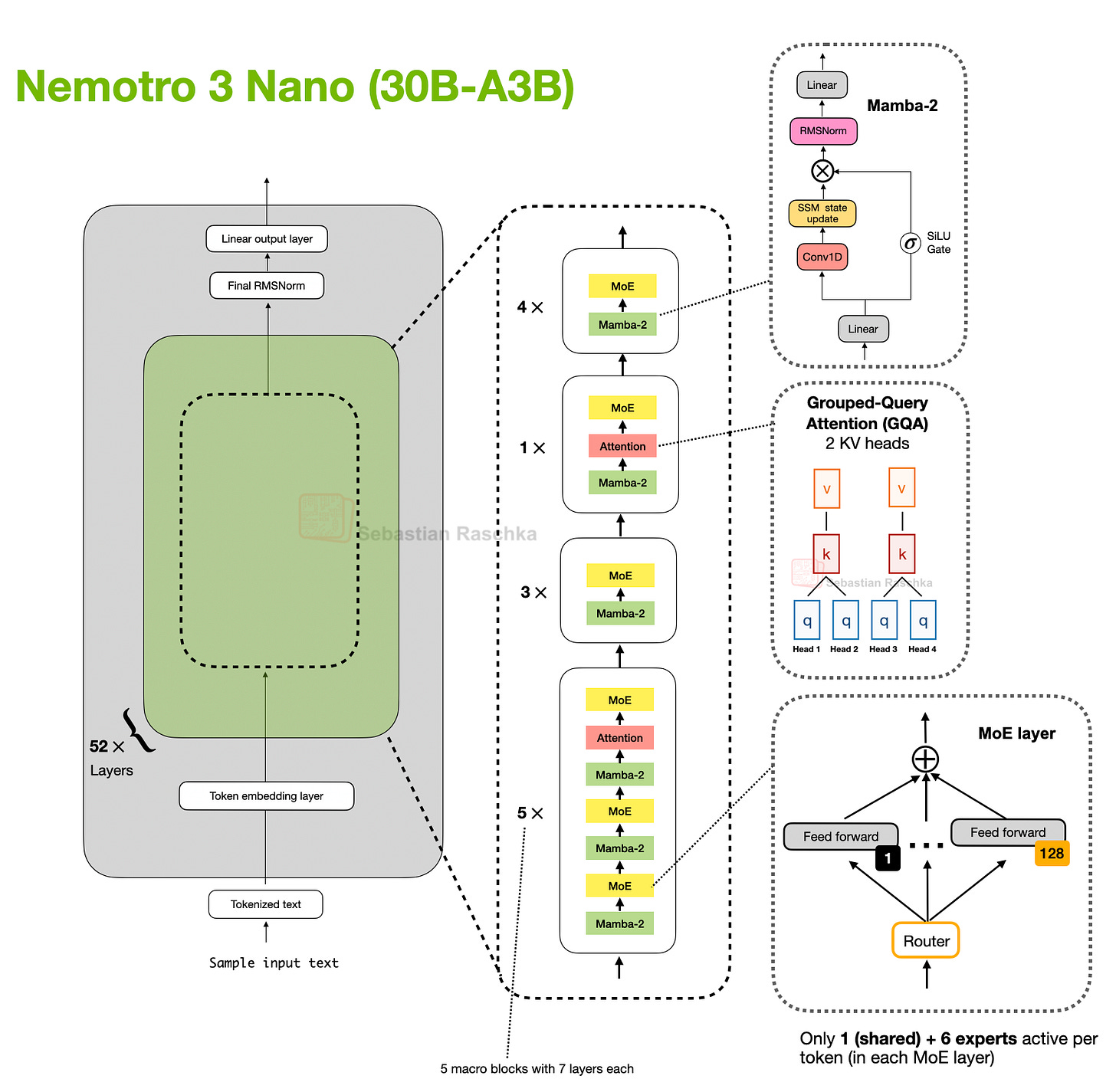

從架構上看,這些模型是混合專家 (MoE) Mamba-Transformer 混合架構。截至撰寫本文時(12 月 17 日),僅有 Nano 模型作為開源權重模型發佈,因此下文的討論將集中在它身上,如下圖所示。

如上圖所示,Nemotron 3 Nano (30B-A3B) 是一個 52 層的混合 Mamba-Transformer 模型,它將 Mamba-2 序列建模區塊與稀疏混合專家 (MoE) 前饋層交錯,且僅在很小一部分層中使用自注意力。上圖中包含很多內容,但簡而言之,該架構被組織成 13 個宏區塊(macro blocks),帶有重複的 Mamba-2 → MoE 子區塊,外加幾個分組查詢注意力層。總之,如果我們將宏區塊和子區塊相乘,該架構共有 52 層。

關於 MoE 模塊,每個 MoE 層包含 128 個專家,但每個 Token 僅激活 1 個共享專家和 6 個路由專家。

Mamba-2 層本身就需要一整篇文章來解釋(或許是以後的一個主題)。但目前在概念上,您可以將它們視為類似於 Qwen3-Next 和 Kimi-Linear 使用的 Gated DeltaNet 方法,我在上面介紹過。您也可以在我的另一篇《超越標準 LLM》文章中閱讀更多相關內容:

超越標準 LLM

Gated DeltaNet 和 Mamba-2 層之間的相似之處在於,兩者都用門控狀態空間更新取代了標準注意力。這種狀態空間風格模塊背後的理念是,它保持一個運行的隱藏狀態,並通過學習的門混合新輸入。與注意力相比,它隨輸入序列長度呈線性而非二次方縮放。

這款架構真正令人興奮的地方在於,與同等規模的純 Transformer 架構相比,它具有非常好的性能,同時實現了更高的 Token/秒吞吐量。

總體而言,這是一個有趣的方向,在僅使用少數注意力層方面甚至比 Qwen3-Next 和 Kimi-Linear 更極端。然而,Transformer 架構的優勢之一是其在(真正)大規模下的表現。我很好奇 Nemotron 3 Super,尤其是 Ultra,將如何與 DeepSeek V3.2 等模型競爭。

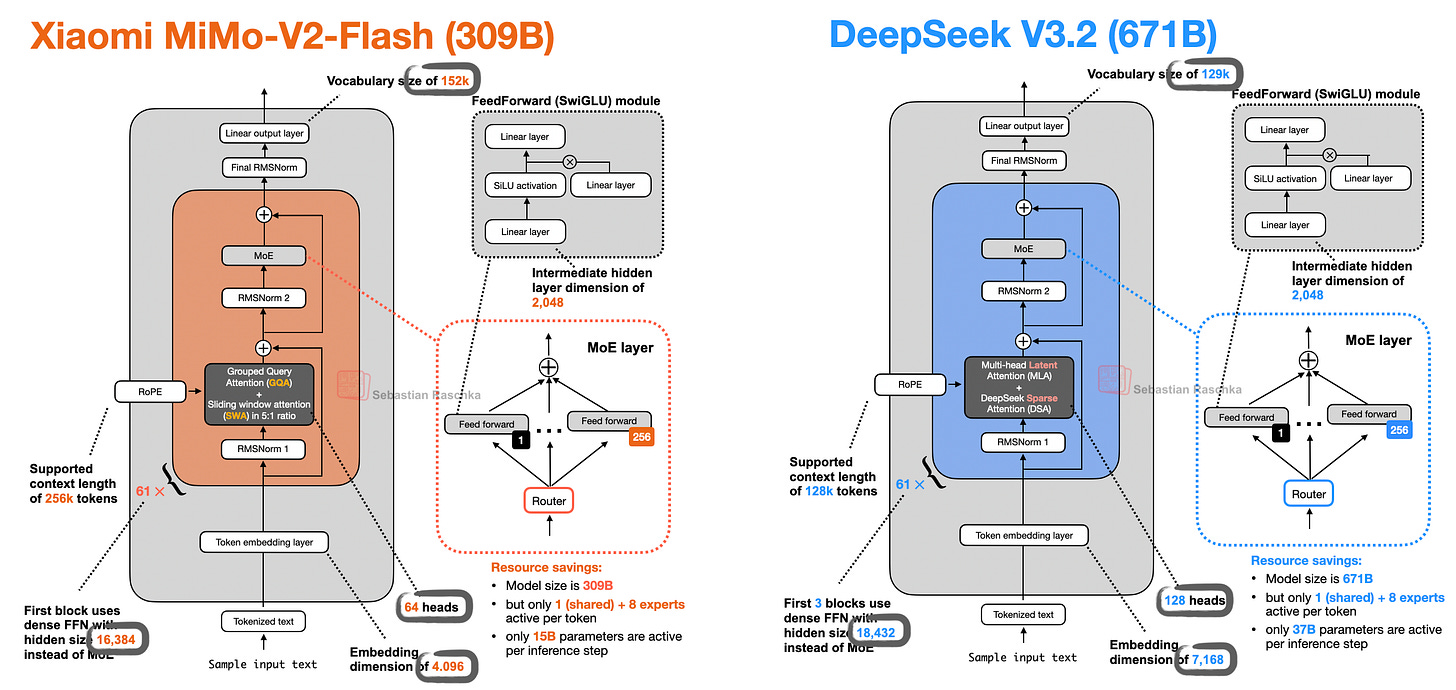

19. 小米 MiMo-V2-Flash

2025 年 12 月還有另一個令人印象深刻的參賽者。小米發佈了他們最新的小米 MiMo-V2-Flash,其基準測試性能與 DeepSeek V3.2 相匹配,而參數僅為其一半,且推理速度更快。這是一個 309B 的混合專家 (MoE) 模型,每個 Token 有 15 個活動參數。

有趣的是,它以 5:1 的比例將滑動窗口注意力 (SWA) 與全局(常規)注意力結合使用,類似於 Gemma 3(見第 3 節)。然而,它使用了更激進的滑動窗口大小 (128),比 Gemma 3 (1024) 小 8 倍。

根據我的知識,這是迄今為止最大的滑動窗口注意力模型。

此外,小米模型還使用了多 Token 預測 (MTP),如第 12.3 節所述。

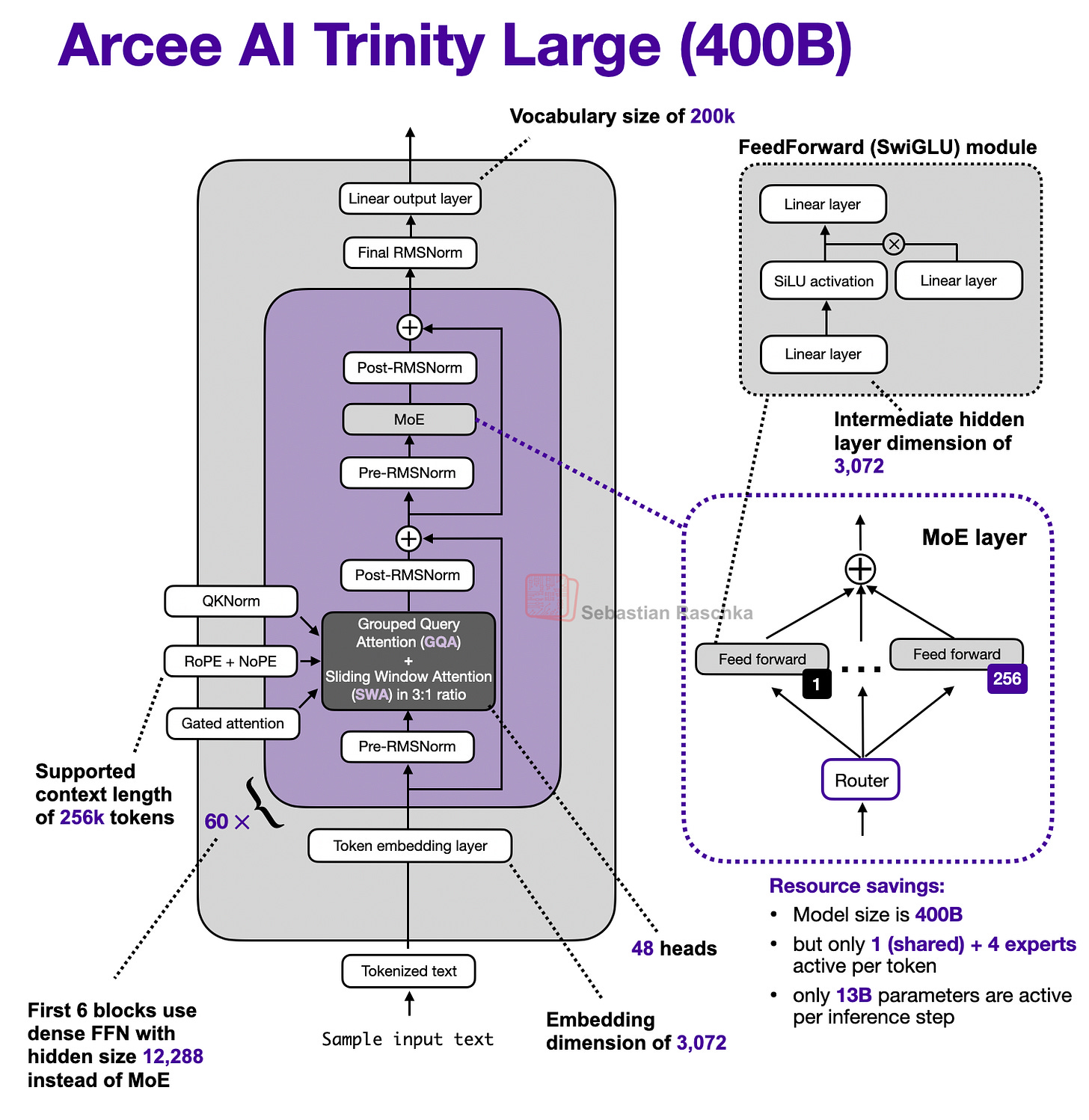

20. Arcee AI Trinity Large

距離上一次 LLM 架構更新已經有一段時間了。1 月 27 日,Arcee AI(一家我之前沒關注過的公司)開始在模型中心發佈其開源權重 400B Trinity Large LLM 的版本,以及兩個較小的變體。

他們的旗艦大型模型是一個 400B 參數的 MoE(活動參數為 13B)。兩個較小的變體是 Trinity Mini(26B,活動參數為 3B)和 Trinity Nano(6B,活動參數為 1B)。

除了模型權重外,Arcee AI 還發佈了一份包含大量細節的精美技術報告。

那麼,讓我們仔細看看 400B 旗艦模型。下圖將其與之前討論過的 GLM 4.5(第 11 節)進行了比較,後者或許是最相似的,且體積也相對較小。此外,Trinity 技術報告顯示,Trinity Large 和 GLM-4.5 基礎模型的建模性能幾乎完全相同(我假設他們沒有與更近期的基礎模型進行比較,是因為現在許多公司僅分享其微調後的模型)。

但我們可以看到,Trinity 模型中添加了幾個有趣的架構組件。

首先,有像之前的 Gemma 3、Olmo 3、小米 MiMo 等模型那樣交替的局部:全局(滑動窗口)注意力層。但他們沒有使用 Gemma 3 和小米常用的 5:1 比例,而是選擇了與 Olmo 3 類似的 3:1 比例,以及相對較大的 4096 滑動窗口大小(也與 Olmo 3 相似)。

除了 QK-Norm(第 2 節,Olmo 2 涵蓋)外,他們還在全局層中使用了 NoPE(我們在第 7 節 SmolLM3 中討論過 NoPE)。

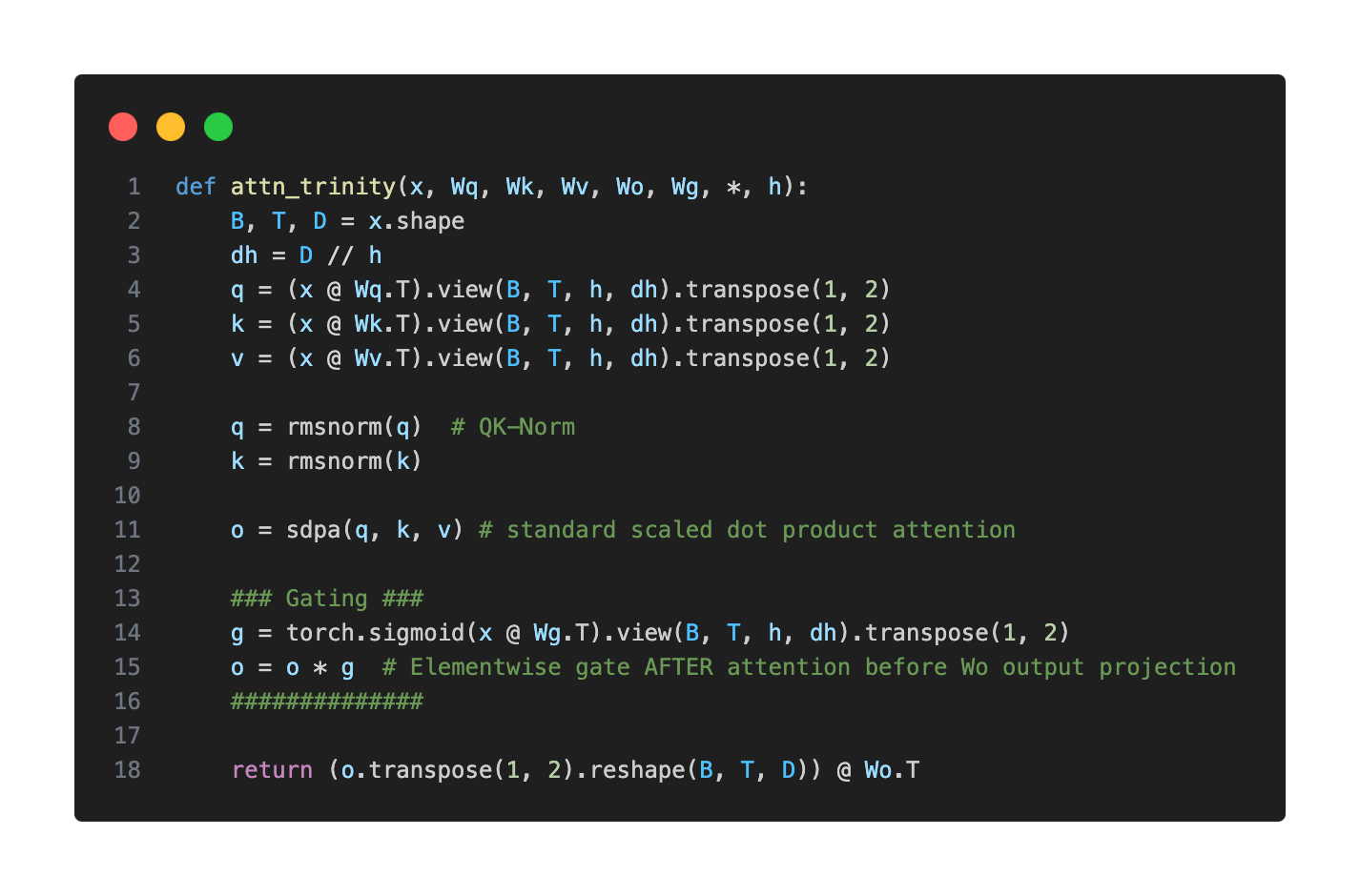

他們還有一種門控注意力形式。他們沒有使用完整的 GatedDeltaNet(第 12 節討論過),但使用了與 Qwen3-Next 注意力機制中類似的門控。

但他們修改了標準注意力,在輸出線性投影之前為縮放點積添加了元素級門控(如下圖所示),這減少了注意力匯並改善了長序列泛化。此外,這也有助於訓練穩定性。

您可能已經注意到在之前的 Trinity Large 架構圖中使用了四個(而非兩個)RMSNorm 層。這是他們所謂的「深度縮放三明治歸一化」(depth-scaled sandwich norm),它基於之前的研究,但我以前在主要架構中沒見過。總體而言,它看起來像 Gemma 3 風格的 RMSNorm 放置,但這裡的轉折在於,(每個區塊中)第二個 RMSNorm 的增益是深度縮放的,這意味著它被初始化為約 1 / sqrt(L)(L 為總層數)。因此,在訓練初期,殘差更新開始時很小,並隨著模型學習正確的比例而增長。

MoE 是一個類似 DeepSeek 的 MoE,有很多小專家,但將其變得更粗糙,這有助於提高推理吞吐量(這也是我們在 Mistral 3 Large 採用 DeepSeek V3 架構時看到的)。

最後,還有一些關於訓練改進的有趣細節(一種新的 MoE 負載均衡策略和另一種使用 MuOpt 優化器的方法),但由於這是一篇架構文章,這些超出了範圍。

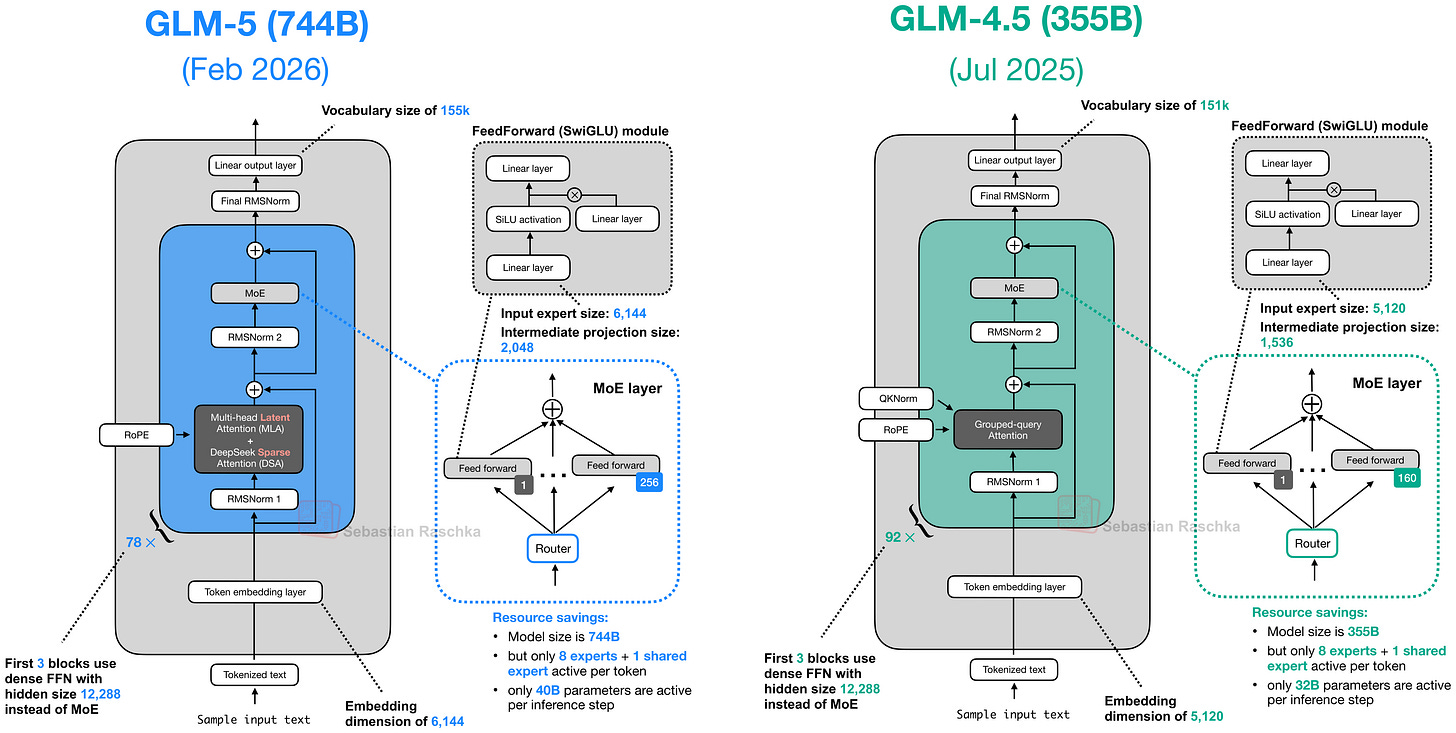

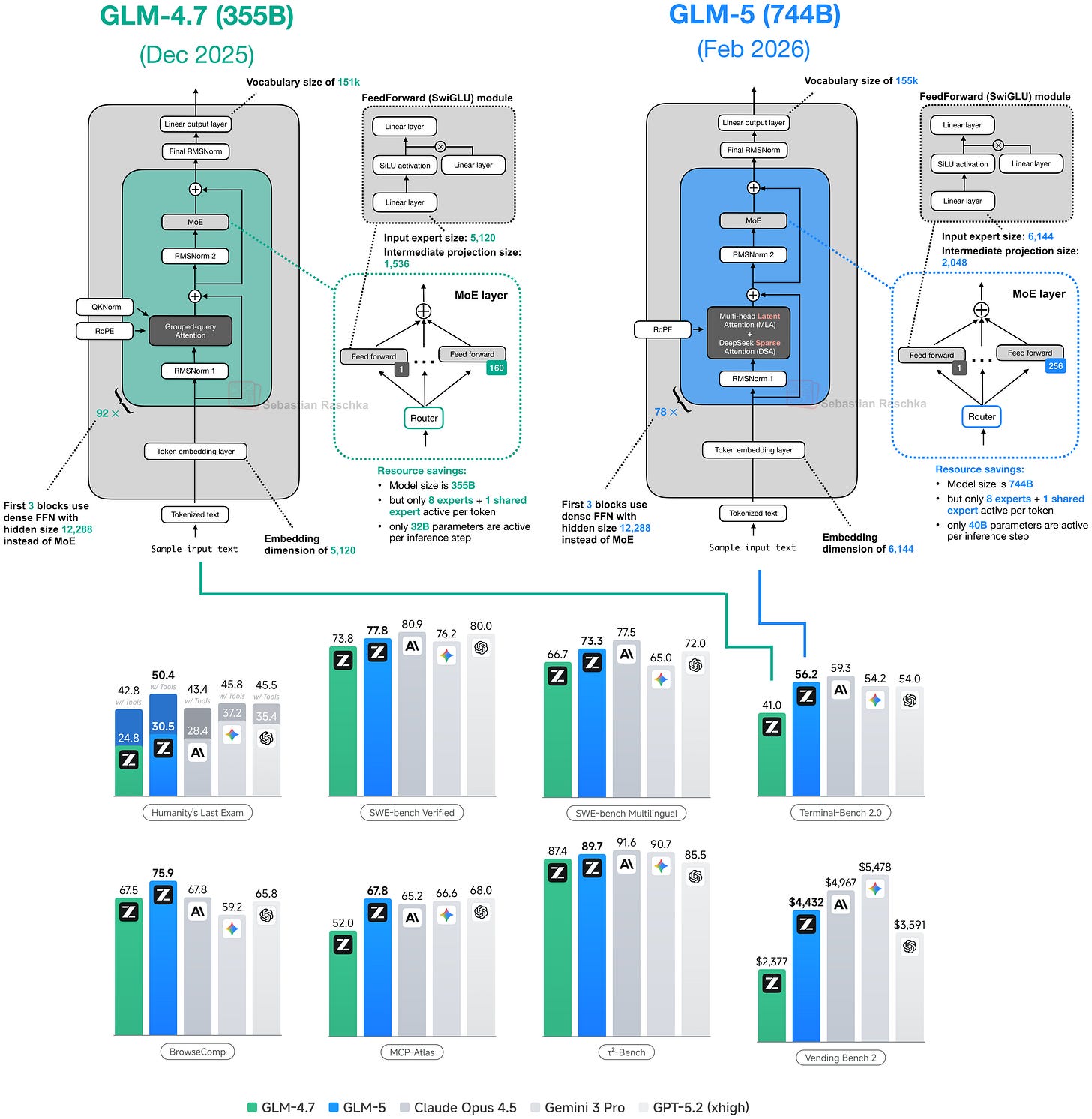

21. GLM-5

農曆新年已成為一個出奇可靠的強大開源權重發佈窗口。例如,GLM-4 和 Qwen 1.5 於 2024 年 1 月和 2 月發佈,DeepSeek R1 和 Qwen 2.5 於 2025 年發佈。

今年,z.AI(智譜 AI)在 2026 年 2 月 11 日推出了 GLM-5(再次相對較早),大約在 2 月 17 日農曆新年的前一週。

與我之前在本文中涵蓋的 GLM-4.5 模型(見第 11 節,2025 年夏季發佈)相比,其繼任者 GLM-5 的規模翻了一倍:從 355B 參數增加到 744B,將其推向了 DeepSeek-V3.2 和 Kimi K2 之間的領域。

與 GLM-4.5 類似,GLM-5 是一個混合專家(第 1.2 節)模型,每個 Token 的活動參數數量僅略微增加:GLM-5 為 40B,而 GLM-4.5 為 32B。

有趣的是,如上方圖 56 所示,GLM-5 採用了 DeepSeek 的多頭潛在注意力(MLA,見第 1.1 節)以及 DeepSeek 稀疏注意力(我在 DeepSeek V3.2 文章中更詳細地介紹過)。這些修改的動機是為了降低處理長上下文時的推理成本。

除此之外,架構相對相似。規模的增加主要是由於擁有更多專家(256 個而非 160 個)並略微增加了層的大小。例如,嵌入維度和專家大小現在為 6,144(高於 5,120),中間投影大小也從 1,536 略微增加到 2,048。有趣的是,層數(Transformer 區塊)從 92x 減少到 78x。我假設這是為了降低推理成本並使模型更快(因為層深度無法並行化)。

我通常不在這裡包含基準測試,因為本文專注於架構。如果我要包含訓練細節和評估,這篇文章的範圍和長度將會失控。話雖如此,我看到我在 2025 年 7 月包含了 GLM-4.5 的基準測試,所以我將在這裡再破例一次,因為基準測試看起來確實令人印象深刻,且與所有主要的旗艦 LLM 產品(GPT-5.2 extra-high、Gemini Pro 3 和 Claude 4.6 Opus)不相上下。但同樣值得強調的是,基準測試性能並不一定等於現實世界的表現。

22. 更多 2026 年 2 月發佈:從 Kimi K2.5 到 Tiny Aya

總之,在 2026 年 1 月至 2 月期間,共有 10 個有趣的開源權重 LLM 發佈:

Arcee AI 的 Trinity Large (2026 年 1 月 27 日)

月之暗面 (Moonshot AI) 的 Kimi K2.5 (2026 年 1 月 27 日)

階躍星辰 (StepFun) Step 3.5 Flash (2026 年 2 月 1 日)

Qwen3-Coder-Next (2026 年 2 月 3 日)

z.AI 的 GLM-5 (2026 年 2 月 12 日)

MiniMax M2.5 (2026 年 2 月 12 日)

南北極 (Nanbeige) 4.1 3B (2026 年 2 月 13 日)

Qwen 3.5 (2026 年 2 月 15 日)

螞蟻集團的 Ling 2.5 1T & Ring 2.5 1T (2026 年 2 月 16 日)

Cohere 的 Tiny Aya (2026 年 2 月 17 日)

Sarvam 30B 和 105B (2026 年 3 月 6 日)

我在第 19 節和第 20 節中介紹了 Arcee AI 的 Trinity Large 和 z.AI 的 GLM-5。然而,由於 1 月至 2 月期間有大量內容需要涵蓋,我寫了一篇單獨的文章,其中包含關於上述 10 個架構的更多信息:

經過這麼多年,LLM 的發佈仍然令人興奮,我很好奇接下來會發生什麼!

這本雜誌是一個個人的熱情項目,您的支持有助於維持它的生命力。

如果您想支持我的工作,請考慮我的《Build a Large Language Model (From Scratch)》一書或其後續作品《Build a Reasoning Model (From Scratch)》。(我相信您會從中獲益良多;它們深入解釋了 LLM 的工作原理,這是在其他地方找不到的。)

感謝您的閱讀,並感謝您支持獨立研究!

如果您閱讀了這本書並有幾分鐘空閒時間,我將非常感激您的簡短評論。這對我們作者幫助很大!

您的支持意義重大!謝謝!

相關文章