提升推理模型能力的推論端運算縮放方法

本文探討了推理優化大型語言模型的最新研究進展,特別關注自 DeepSeek R1 發佈以來出現的推論端運算縮放技術。

LLM 推理模型推論現狀

提升推理模型的推論時計算量擴展方法(Inference-Time Compute Scaling Methods)

提升大型語言模型(LLM)的推理能力已成為 2025 年最熱門的話題之一,這是有充分理由的。更強的推理能力使 LLM 能夠應對更複雜的問題,使其在用戶關心的廣泛任務中表現更出色。

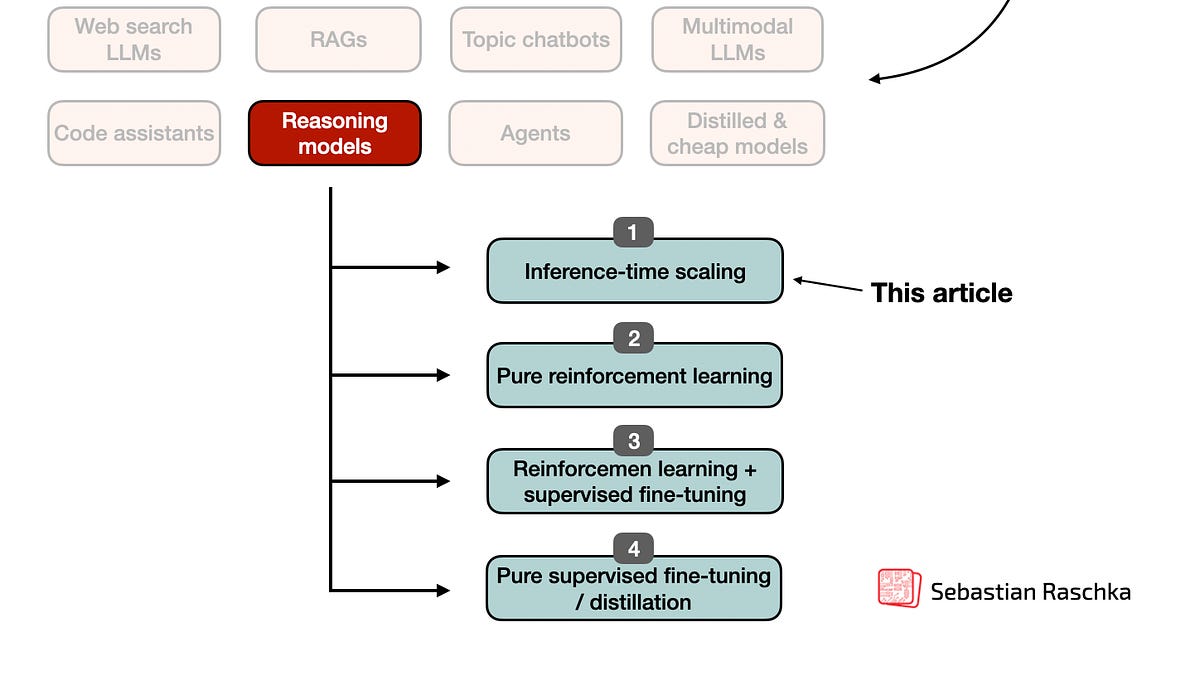

在過去幾週內,研究人員分享了大量提升推理能力的新策略,包括擴展推論時計算量(inference-time compute scaling)、強化學習(reinforcement learning)、監督式微調(supervised fine-tuning)和蒸餾(distillation)。許多方法結合了這些技術以達到更好的效果。

本文探討了推理優化 LLM 的最新研究進展,特別關注自 DeepSeek R1 發布以來湧現的推論時計算量擴展技術。

在 LLM 中實現與改進推理:四大主要類別

由於大多數讀者可能已經熟悉 LLM 推理模型,我將簡短定義:基於 LLM 的推理模型是旨在通過生成中間步驟或結構化「思考」過程來解決多步驟問題的 LLM。與僅分享最終答案的簡單問答 LLM 不同,推理模型會明確顯示其思考過程或在內部處理,這有助於它們在謎題、編程挑戰和數學問題等複雜任務中表現更好。

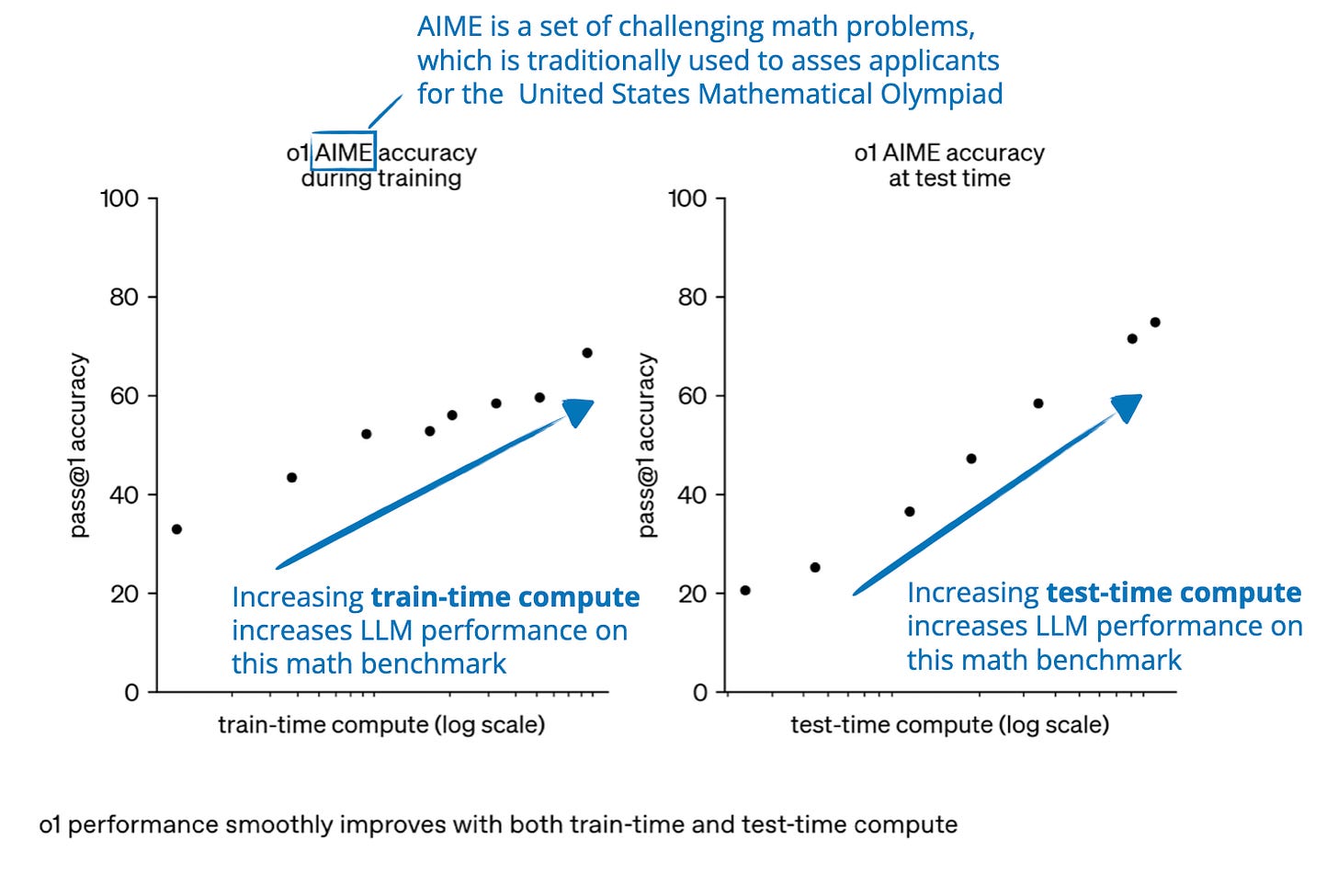

一般而言,提升推理能力有兩大策略:(1) 增加訓練時計算量,或 (2) 增加推論時計算量,也稱為推論時擴展(inference-time scaling)或測試時擴展(test-time scaling)。(推論計算量是指在訓練完成後,為響應用戶查詢而生成模型輸出所需的處理能力。)

請注意,上圖看起來像是我們透過「訓練時計算」或「測試時計算」其中之一來改進推理。然而,LLM 通常設計為結合密集的訓練時計算(廣泛的訓練或微調,通常配合強化學習或專門數據)和增加的測試時計算(允許模型在推論期間「思考更久」或執行額外計算)來提升推理能力。

為了理解推理模型是如何開發和改進的,我認為將不同技術分開來看仍然很有用。在我之前的文章《理解推理 LLM》(Understanding Reasoning LLMs)中,我討論了將其細分為四個類別,如下圖所示。

上圖中的方法 2-4 通常會產生較長的響應,因為它們在輸出中包含了中間步驟和解釋。由於推論成本隨響應長度擴展(例如,兩倍長的響應需要兩倍的計算量),這些訓練方法本質上與推論擴展相關聯。然而,在推論時計算量擴展這一節中,我專門關注那些明確調節生成 Token 數量的技術,無論是透過額外的採樣策略、自我修正機制還是其他方法。

在本文中,我將重點放在 2025 年 1 月 22 日 DeepSeek R1 發布後,專注於擴展推論時計算量的有趣新研究論文和模型發布。(原本我想在本文中涵蓋所有類別的方法,但由於篇幅過長,我決定將來另外發布一篇專注於訓練時計算方法的文章。)

在我們深入研究推論時計算量擴展方法以及推理模型在該類別中的各項進展之前,讓我至少先簡要概述所有不同的類別。

- 推論時計算量擴展(Inference-time compute scaling)

此類別包括在推論時提升模型推理能力的方法,無需訓練或修改底層模型權重。核心思想是以增加計算資源換取性能提升,透過思維鏈(CoT)推理和各種採樣程序等技術,使固定模型也具備更強的能力。

雖然我將推論時計算量擴展單獨分類以專注於此背景下的方法,但值得注意的是,這種技術可以應用於任何 LLM。例如,OpenAI 使用強化學習開發了其 o1 模型,然後額外利用了推論時計算量擴展。有趣的是,正如我在之前關於推理模型的文章中所討論的,DeepSeek R1 論文明確將常見的推論時擴展方法(如基於過程獎勵模型和基於蒙地卡羅樹搜尋的方法)歸類為「不成功的嘗試」。這表明 DeepSeek 除了利用 R1 模型自然傾向生成較長響應(這作為 V3 基礎模型的一種隱式推論時擴展形式)之外,並未明確使用這些技術。然而,由於顯式推論時擴展通常實現在應用層而非 LLM 內部,DeepSeek 承認他們可以輕鬆地將其整合到 R1 的部署或應用中。

- 純強化學習(Pure reinforcement learning)

這種方法完全專注於強化學習(RL)來開發或改進推理能力。它通常涉及使用來自數學或編程領域的可驗證獎勵信號來訓練模型。雖然 RL 允許模型發展出更具策略性的思考和自我改進能力,但也面臨著獎勵作弊(reward hacking)、不穩定性和高計算成本等挑戰。

- 強化學習與監督式微調(Reinforcement learning and supervised fine-tuning)

這種混合方法將 RL 與監督式微調(SFT)相結合,以實現比純 RL 更穩定且更具泛化性的改進。通常,模型首先在高品質的指令數據上進行 SFT 訓練,然後再使用 RL 進一步精煉以優化特定行為。

- 監督式微調與模型蒸餾(Supervised fine-tuning and model distillation)

這種方法透過在高品質的標記數據集上進行指令微調(SFT)來提升模型的推理能力。如果這個高品質數據集是由較大的 LLM 生成的,那麼這種方法在 LLM 背景下也被稱為「知識蒸餾」或簡稱「蒸餾」。但請注意,這與深度學習中的傳統知識蒸餾略有不同,傳統方法通常涉及使用較大教師模型的輸出(標籤)以及 Logits 來訓練較小的模型。

Ahead of AI 是一份讀者支持的出版物。如需接收新文章並支持我的工作,請考慮成為免費或付費訂閱者。

推論時計算量擴展方法

前一節已簡要總結了推論時計算量擴展。在討論該類別的近期研究之前,讓我更詳細地描述一下推論時擴展。

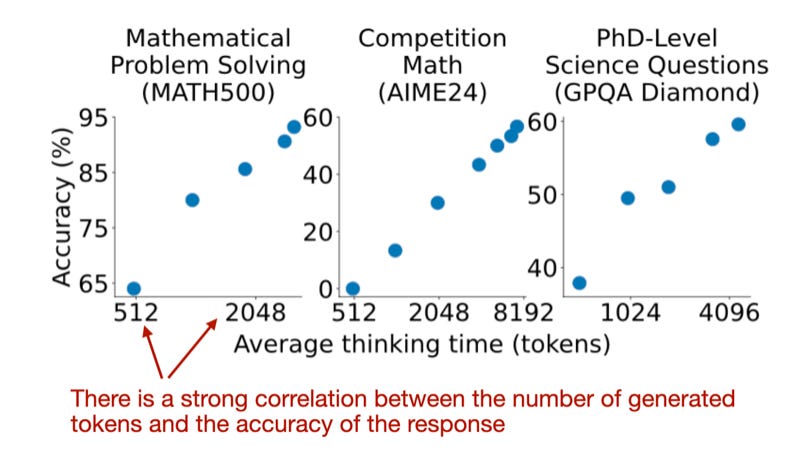

推論時擴展透過在推論期間增加計算資源(「計算量」)來提升 LLM 的推理能力。為什麼這能提升推理能力,可以用一個簡單的類比:人類在有更多時間思考時會給出更好的回答,同樣地,LLM 也可以透過鼓勵在生成過程中進行更多「思考」的技術來改進。

這裡的一種方法是提示工程(prompt engineering),例如思維鏈(CoT)提示,其中像「一步步思考」這樣的短語會引導模型生成中間推理步驟。這提升了處理複雜問題的準確性,但對於簡單的事實查詢則是不必要的。由於 CoT 提示會生成更多 Token,它們實際上使推論變得更昂貴。

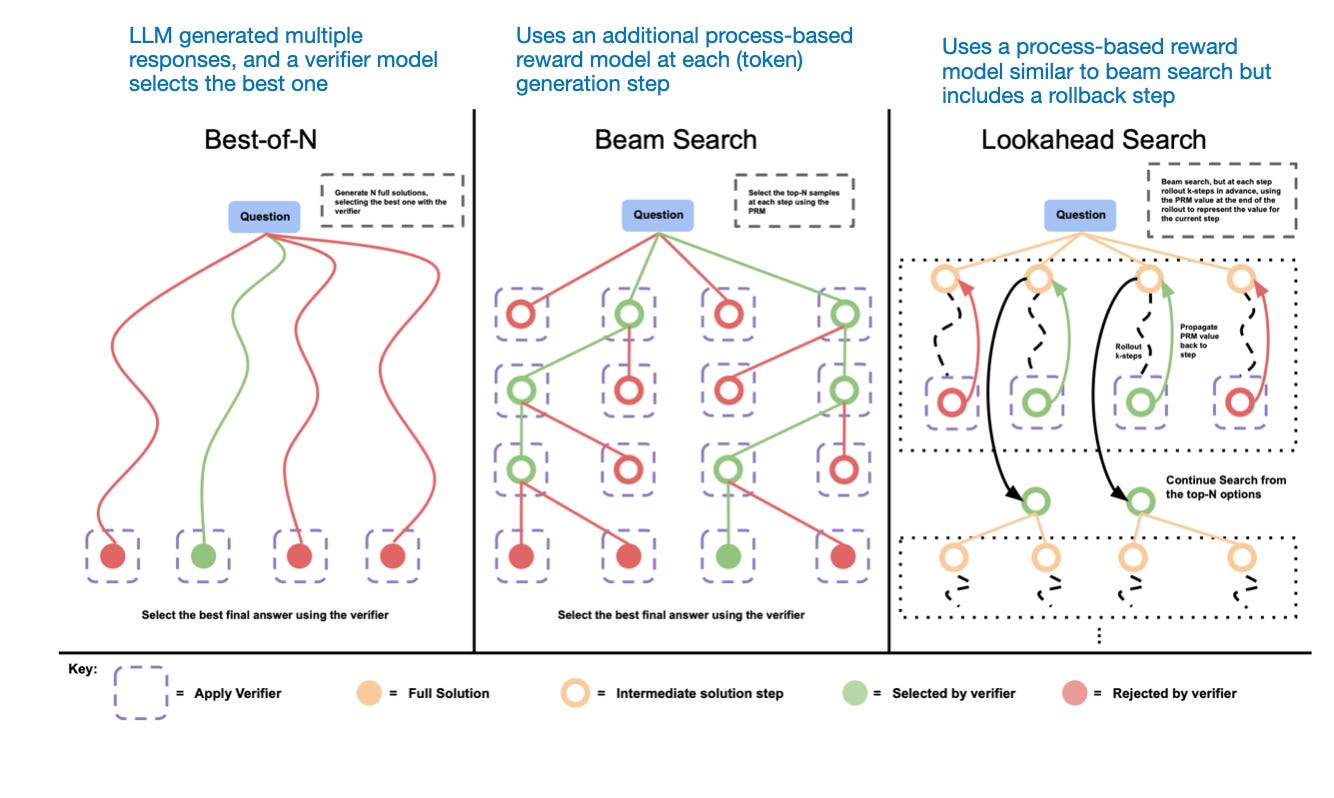

另一種方法涉及投票和搜尋策略,例如多數投票(majority voting)或束搜尋(beam search),這些策略透過選擇最佳輸出來精煉響應。

1. "s1: Simple test-time scaling"

本文剩餘部分將專注於推論時擴展類別中提升 LLM 推理能力的最新研究進展。讓我從詳細討論一篇作為推論時擴展範例的論文開始。

該類別中近期有趣的論文之一是《s1: Simple Test-Time Scaling》(2025 年 1 月 31 日),它引入了所謂的「Wait」Token,這可以被視為前述「一步步思考」提示修改的更現代版本。

請注意,這涉及監督式微調(SFT)來生成初始模型,因此它不是純粹的推論時擴展方法。然而,最終目標是透過推論時擴展來主動控制推理行為;因此,我將這篇論文歸入「1. 推論時計算量擴展」類別。

簡而言之,他們的方法分為兩部分:

- 創建一個精選的 SFT 數據集,包含 1,000 個帶有推理軌跡的訓練範例。

- 透過以下方式控制響應長度:

a) 附加「Wait」Token 以引導 LLM 生成更長的響應、進行自我驗證和自我修正,或者

b) 透過添加思考結束標記(「Final Answer:」)來停止生成。他們將這種長度控制稱為「預算強制」(budget forcing)。

預算強制可以被視為一種順序推論擴展技術,因為它仍然一次生成一個 Token(只是數量更多)。相比之下,我們有像多數投票這樣的並行技術,它們聚合多個獨立的完成結果。

他們發現他們的預算強制方法比我討論過的其他推論擴展技術(如多數投票)更有效。如果要批評或改進,我希望能看到更複雜的並行推論擴展方法的結果,例如束搜尋、前瞻搜尋,或是 Google 去年在《Scaling LLM Test-Time Compute Optimally Can Be More Effective Than Scaling Model Parameters》論文中描述的最佳計算優化搜尋。甚至是與經典順序方法如思維鏈提示(「一步步思考」)的簡單比較。

無論如何,這是一篇非常有趣的研究和方法!

備註:為什麼是「Wait」Token?我猜測研究人員是受到了 DeepSeek-R1 論文中「頓悟時刻」(Aha moment)圖表的啟發,研究人員在那裡看到 LLM 會想出類似「等等,等等。等等。這是我可以在這裡標記的一個頓悟時刻」之類的內容,這表明純強化學習可以誘導 LLM 的推理行為。

有趣的是,他們還嘗試了其他 Token 如「Hmm」,但發現「Wait」的表現略好。

其他值得注意的推論時計算量擴展研究論文

由於這個月推理模型研究領域非常活躍,我需要保持對其他論文的總結相對簡短,以控制本文的長度。因此,以下是與推論時計算量擴展相關的其他有趣研究文章的簡要總結,按發布日期升序排列。

如前所述,並非所有這些文章都完全屬於推論時計算量擴展類別,因為其中一些也涉及特定訓練。然而,這些論文的共同點是,控制推論時計算量是一種特定的作用機制。(我將在未來的文章中涵蓋的許多蒸餾或 SFT 方法會導致更長的響應,這可以被視為推論時計算量擴展的一種形式。然而,它們在推論期間並不主動控制長度,這使得這些方法與此處涵蓋的方法有所不同。)

2. Test-Time Preference Optimization

📄 1 月 22 日,《Test-Time Preference Optimization: On-the-Fly Alignment via Iterative Textual Feedback》,https://arxiv.org/abs/2501.12895

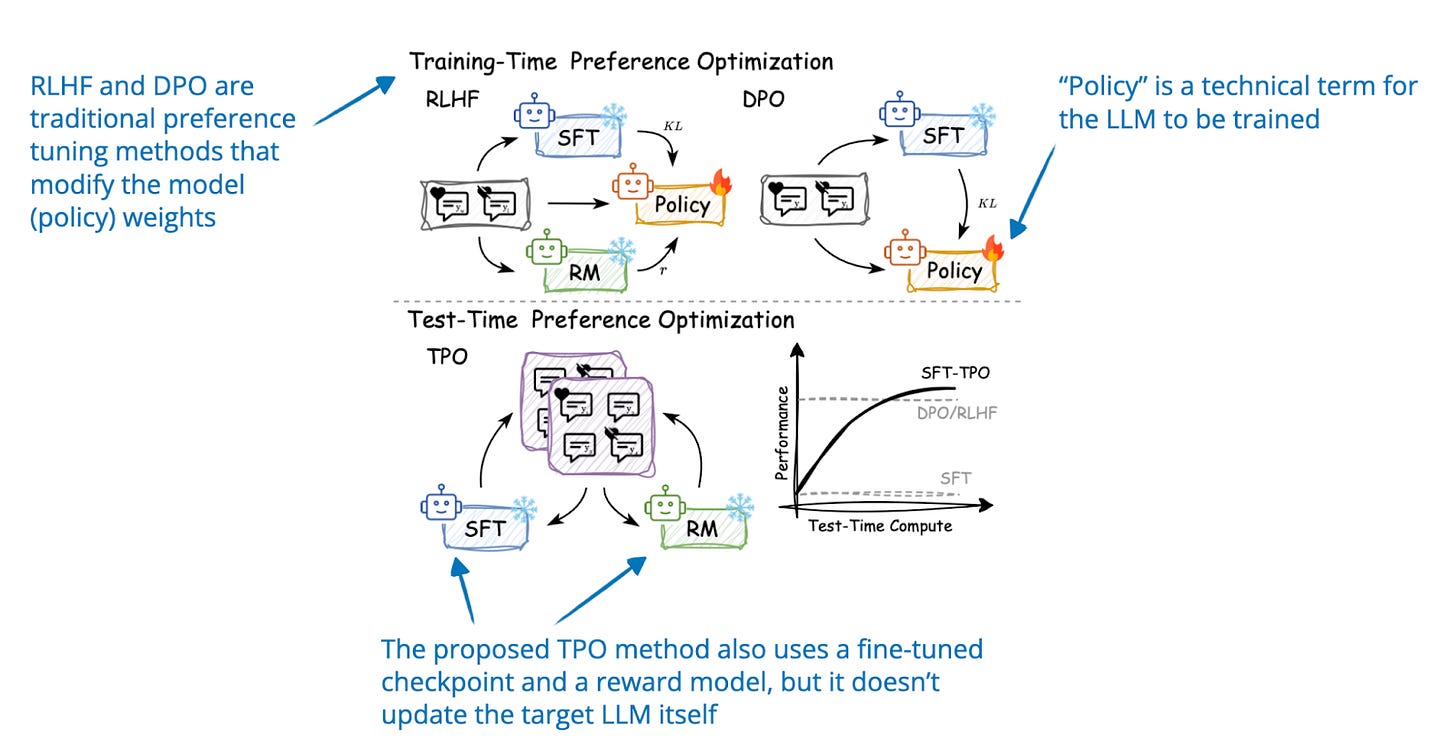

測試時偏好優化(TPO)是一個迭代過程,在推論期間將 LLM 輸出與人類偏好對齊(無需更改其底層模型權重)。在每次迭代中,模型:

- 為給定提示生成多個響應。

- 使用獎勵模型對響應進行評分,選擇得分最高和最低的作為「選中」和「拒絕」的響應。

- 提示模型比較並評論「選中」和「拒絕」的響應。

- 透過將評論轉換為文本建議來更新原始模型響應,從而精煉輸出。

透過迭代執行步驟 1-4,模型會精煉其原始響應。

3. Thoughts Are All Over the Place

📄 1 月 30 日,《Thoughts Are All Over the Place: On the Underthinking of o1-Like LLMs》,https://arxiv.org/abs/2501.18585

研究人員探索了一種稱為「思考不足」(underthinking)的現象,即推理模型頻繁在推理路徑之間切換,而不是完全專注於探索有前景的路徑,這降低了問題解決的準確性。

為了應對這種「思考不足」問題,他們引入了一種稱為「思考切換懲罰」(TIP)的方法,該方法修改思考切換 Token 的 Logits,以阻止過早的推理路徑轉換。

他們的方法不需要模型微調,並在多個具挑戰性的測試集上憑經驗提升了準確性。

4. Trading Inference-Time Compute for Adversarial Robustness

📄 1 月 31 日,《Trading Inference-Time Compute for Adversarial Robustness》,https://arxiv.org/abs/2501.18841

在許多情況下,增加推論時計算量可以降低攻擊成功率,從而提升推理 LLM 的對抗魯棒性。與對抗訓練不同,此方法不需要任何特殊訓練,也不需要預先了解特定的攻擊類型。

然而,也存在一些重要的例外。例如,在涉及策略模糊性或漏洞利用的設置中,改進效果有限。此外,推理帶來的魯棒性提升可能會被「少思考」(Think Less)和「書呆子狙擊」(Nerd Sniping)等新攻擊策略所削弱。

因此,雖然這些發現表明擴展推論時計算量可以提高 LLM 的安全性,但這本身並不是對抗魯棒性的完整解決方案。

5. Chain-of-Associated-Thoughts

📄 2 月 4 日,《CoAT: Chain-of-Associated-Thoughts Framework for Enhancing Large Language Models Reasoning》,https://arxiv.org/abs/2502.02390

研究人員將經典的蒙地卡羅樹搜尋推論時擴展與「聯想記憶」相結合,後者在探索推理路徑期間作為 LLM 的知識庫。利用這種所謂的聯想記憶,LLM 在生成響應期間更容易考慮早期的推理路徑並使用動態變化的信息。

6. Step Back to Leap Forward

📄 2 月 6 日,《Step Back to Leap Forward: Self-Backtracking for Boosting Reasoning of Language Models》,https://arxiv.org/abs/2502.0440

本文提出了一種自我回溯(self-backtracking)機制,允許 LLM 透過在訓練和推論期間學習何時以及何處回溯來提升其推理能力。雖然訓練涉及教導模型使用 <backtrack> Token 識別並修正次優的推理路徑,但其核心貢獻在於推論時的樹狀搜尋,該搜尋利用這種學到的回溯能力來探索替代解決方案。

獨特之處在於,這種探索不依賴於外部獎勵模型(不同於我在本文「1. 推論時計算量擴展方法」節開頭提到的使用基於過程獎勵模型的搜尋方法)。

我將這篇論文放在這裡,是因為它高度專注於所提出的回溯推論時擴展方法,該方法透過動態調整搜尋深度和廣度來提升推理能力,而不是從根本上改變訓練範式(儘管需要使用 <backtrack> Token 進行訓練)。

7. Scaling up Test-Time Compute with Latent Reasoning

📄 2 月 7 日,《Scaling up Test-Time Compute with Latent Reasoning: A Recurrent Depth Approach》,https://arxiv.org/abs/2502.05171

研究人員並非透過生成更多 Token 來提升推理能力,而是提出了一種透過在潛在空間(latent space)中迭代循環深度區塊(recurrent depth block)來擴展推論時計算量的模型。該區塊的功能類似於 RNN 中的隱藏狀態,允許模型在不需要更長 Token 輸出的情況下精煉其推理。

然而,一個關鍵缺點是缺乏明確的推理步驟,這(在我看來)對於人類的可解釋性非常有用,也是思維鏈方法的一大優勢。

8. Can a 1B LLM Surpass a 405B LLM?

📄 2 月 10 日,《Can 1B LLM Surpass 405B LLM? Rethinking Compute-Optimal Test-Time Scaling》,https://arxiv.org/abs/2502.06703

許多推論時擴展技術依賴於採樣,這需要過程獎勵模型(PRM)來選擇最佳解決方案。本文系統地分析了推論時計算量擴展如何與 PRM 和問題難度相互作用。

研究人員開發了一種計算優化的擴展策略,可適應 PRM、策略模型和任務複雜性的選擇。他們的結果顯示,透過正確的推論時擴展方法,一個 1B 參數的模型可以超越缺乏推論時擴展的 405B Llama 3 模型。

同樣地,他們展示了帶有推論時擴展的 7B 模型如何在保持更高推論效率的同時超越 DeepSeek-R1。

這些發現強調了推論時擴展如何顯著提升 LLM,使得小型 LLM 在擁有正確的推論計算預算時,可以超越大得多的模型。

9. Learning to Reason from Feedback at Test-Time

📄 2 月 16 日,《Learning to Reason from Feedback at Test-Time》,https://www.arxiv.org/abs/2502.12521

這很難歸類為推論時或訓練時方法,因為它在推論時優化 LLM,改變其權重參數。

因此,這篇論文探索了一種讓 LLM 在推論時從錯誤中學習的方法,而無需在提示中存儲失敗的嘗試(這會變得很昂貴)。不同於透過在上下文中添加先前嘗試(順序修訂)或盲目生成新答案(並行採樣)來精煉答案的通常方法,這種方法在推論時更新模型的權重。

為了實現這一點,作者引入了 OpTune,這是一個小型、可訓練的優化器,它根據模型在先前嘗試中所犯的錯誤來更新模型權重。這意味著模型會記住自己做錯了什麼,而無需在提示/上下文中保留錯誤答案。

10. Inference-Time Computations for LLM Reasoning and Planning

📄 2 月 18 日,《Inference-Time Computations for LLM Reasoning and Planning: A Benchmark and Insights》,https://www.arxiv.org/abs/2502.12521

本文對推理和規劃任務的各種推論時計算量擴展技術進行了基準測試,重點分析了它們在計算成本與性能之間的權衡。

作者評估了多種技術——如思維鏈(Chain-of-Thought)、思維樹(Tree-of-Thought)以及將推理視為規劃(Reasoning as Planning),涵蓋了算術、邏輯、常識、算法推理和規劃等 11 個任務。

主要發現是,雖然擴展推論時計算可以提升推理能力,但沒有任何單一技術能在所有任務中始終優於其他技術。

11. Inner Thinking Transformer

📄 2 月 19 日,《Inner Thinking Transformer: Leveraging Dynamic Depth Scaling to Foster Adaptive Internal Thinking》,https://arxiv.org/abs/2502.13842

內部思考 Transformer(ITT)在推論期間動態分配更多計算量。ITT 不像標準 Transformer 架構的 LLM 那樣對所有 Token 使用固定深度(= 使用相同數量的層),而是採用自適應 Token 路由(Adaptive Token Routing)為困難的 Token 分配更多計算量。這些困難的 Token 會多次通過同一層以進行額外處理,從而增加了這些困難 Token 的推論計算預算。

12. Test Time Scaling for Code Generation

📄 2 月 20 日,《S*: Test Time Scaling for Code Generation》,https://arxiv.org/abs/2502.14382

推論時擴展可以透過並行擴展(生成多個答案)、順序擴展(迭代精煉答案)或兩者結合來實現,正如 Google 在 2024 年夏季的論文(《Scaling LLM Test-Time Compute Optimally can be More Effective than Scaling Model Parameters》)中所述。

S* 是一種專為代碼生成設計的測試時計算量擴展方法,它同時改進了並行擴展(生成多個解決方案)和順序擴展(迭代調試)。

該方法分為兩個階段運行:

第一階段:生成

模型生成多個代碼解決方案,並利用問題提示中提供的執行結果和測試案例進行迭代精煉。

這就像一場編程競賽,模型提交解決方案、運行測試並修正錯誤:

- 模型生成多個候選解決方案。

- 每個解決方案都在公共測試案例(預定義的輸入-輸出對)上執行。

- 如果解決方案失敗(輸出錯誤或崩潰),模型會分析執行結果(錯誤、輸出)並修改代碼以改進它。

- 這個精煉過程持續迭代,直到模型找到通過測試案例的解決方案。

例如,假設要求模型實現一個函數 is_even(n),對於偶數返回 True,否則返回 False。

模型的第一次嘗試可能是:

def is_even(n):

return n % 2

模型使用公共測試案例測試此實現:

is_even(2)-> 預期True,得到0(失敗)is_even(4)-> 預期True,得到0(失敗)

在查看結果後,模型意識到 4 % 2 返回 0 而不是 True,因此它修改了函數:

def is_even(n):

return n % 2 == 0

現在函數通過了所有公共測試,完成了調試階段。

第二階段:選擇

一旦多個解決方案通過了公共測試,模型必須選擇最佳的一個(如果可能)。在這裡,S* 引入了自適應輸入合成以避免隨機挑選:

- 模型比較兩個都通過了公共測試的解決方案。

- 它問自己:「我能否生成一個輸入,揭示這些解決方案之間的差異?」

- 它創建一個新的測試輸入,並在其上運行兩個解決方案。

- 如果一個解決方案產生正確輸出而另一個失敗,模型選擇較好的那個。

- 如果兩個解決方案行為完全相同,模型隨機挑選一個。

例如,考慮 is_perfect_square(n) 的兩種不同實現:

- 解決方案 A:使用

math.isqrt - 解決方案 B:使用

n**0.5 == int(n**0.5)

兩者都通過了簡單範例的測試案例:

is_perfect_square(4)->Trueis_perfect_square(9)->True

但當 LLM 生成邊際案例時,我們可以看到其中一個失敗(例如由於浮點數精度問題),因此模型在這種情況下會選擇解決方案 A。

13. Chain of Draft

📄 2 月 25 日,《Chain of Draft: Thinking Faster by Writing Less》,https://arxiv.org/abs/2502.18600

研究人員觀察到,雖然推理 LLM 經常生成冗長的逐步解釋,但人類通常依賴於僅捕捉關鍵信息的簡明草稿。

受此啟發,他們提出了草稿鏈(Chain of Draft, CoD),這是一種提示策略,透過生成極簡但信息豐富的中間步驟來減少冗長。因此,從某種意義上說,這是一種推論時擴展方法,它透過生成更少的 Token 來提高推論時擴展的效率。

從結果來看,CoD 似乎幾乎與標準提示一樣簡短,但準確度卻與思維鏈(CoT)提示相當。正如我之前提到的,在我看來,推理模型的優勢之一是用戶可以閱讀推理軌跡來學習並更好地評估/信任響應。CoD 在某種程度上削弱了這一優勢。然而,在不需要冗長中間步驟的情況下,它可能非常方便,因為它在保持 CoT 準確性的同時加快了生成速度。

14. Better Feedback and Edit Models

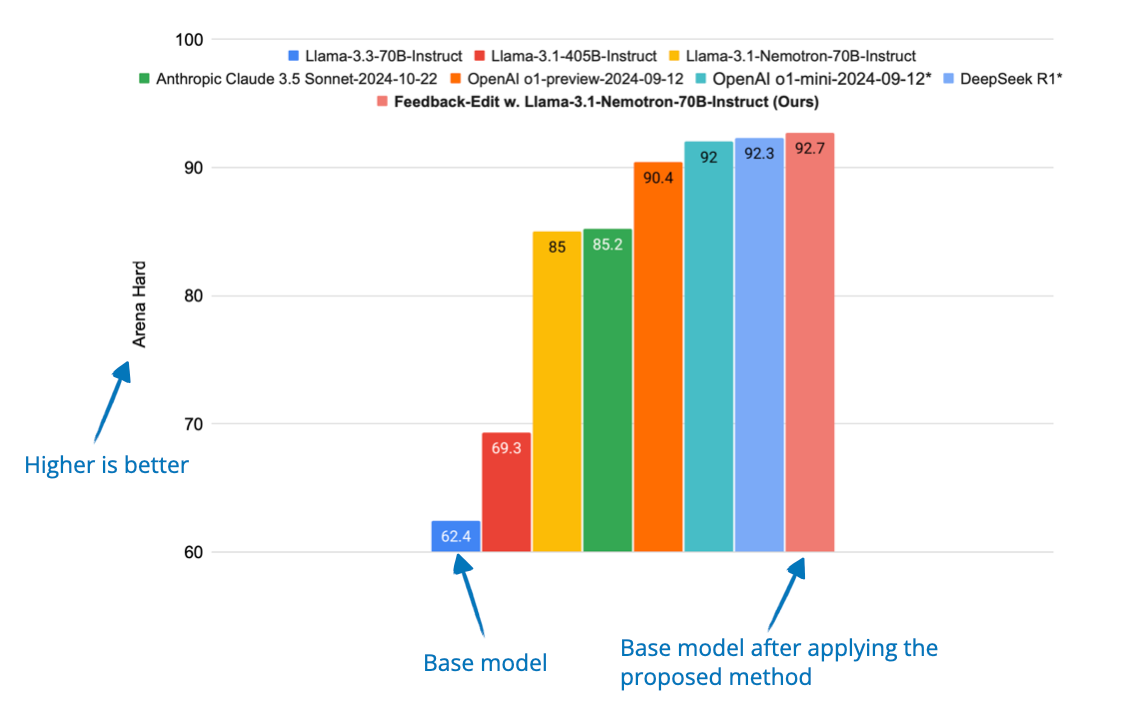

📄 3 月 6 日,《Dedicated Feedback and Edit Models Empower Inference-Time Scaling for Open-Ended General-Domain Tasks》,https://arxiv.org/abs/2503.04378

許多擴展推論時推理的技術依賴於具有可驗證答案的任務(如可以檢查的數學和代碼),這使得它們難以應用於寫作和一般問題解決等開放式任務。

為了應對可驗證答案方面的限制,研究人員開發了一個系統,其中一個模型生成初始響應,另一個模型提供反饋(「反饋模型」),第三個模型根據該反饋精煉響應(「編輯模型」)。

他們使用大量人工標註的響應和反饋數據集來訓練這些專門的「反饋」和「編輯」模型。這些模型隨後透過在推論時生成更好的反饋並進行更有效的編輯來幫助改進響應。

Ahead of AI 是一份讀者支持的出版物。如需接收新文章並支持我的工作,請考慮成為免費或付費訂閱者。

結論

推論時計算量擴展已成為今年最熱門的研究課題之一,旨在無需修改模型權重的情況下提升大型語言模型的推理能力。

我上面總結的許多技術範圍廣泛,從簡單的基於 Token 的干預(如「Wait」Token)到複雜的基於搜尋和優化的策略(如測試時偏好優化和聯想思維鏈)。

從大局來看,一個反覆出現的主題是,增加推論時的計算量可以讓相對較小的模型在推理基準測試上,與標準方法相比取得實質性的進步。

這表明推論策略可以幫助縮小較小、更具成本效益的模型與其較大競爭對手之間的性能差距。

成本警告

警告在於,推論時擴展會增加推論成本,因此是使用具有大量推論擴展的小型模型,還是訓練一個較大的模型並在較少或不使用推論擴展的情況下使用它,這是一道必須根據模型使用量來計算的數學題。

舉例來說,使用大量推論時擴展的 o1 模型,實際上仍然比可能更大且可能不使用推論時擴展的 GPT-4.5 模型略微便宜。

(觀察 GPT-4.5 在使用 o1 或 o3 風格的推論時擴展後表現如何將會非常有趣。)

哪種技術?

然而,推論時計算量擴展並非萬靈丹。雖然蒙地卡羅樹搜尋、自我回溯和動態深度擴展等方法可以顯著提升推理性能,但其有效性仍取決於任務和難度。正如早期的一篇論文所示,沒有任何一種推論時計算量擴展技術能在所有任務中表現最佳。

此外,許多這些方法是以響應延遲換取推理能力的提升,而緩慢的響應對某些用戶來說可能很煩人。例如,如果我有簡單的任務,由於響應時間更快,我通常會從 o1 切換回 GPT-4o。

下一步是什麼

展望未來,我認為今年我們將看到更多圍繞「透過推論時計算量擴展實現推理」研究的兩大主要分支:

- 純粹以開發最強模型、登頂基準測試為中心的研究。

- 關注在不同推理任務中平衡成本與性能權衡的研究。

無論如何,推論時計算量擴展的優點在於它可以應用於任何類型的現有 LLM,使其在特定任務中表現更好。

按需思考(Thinking on Demand)

工業界一個有趣的趨勢是我所稱的「按需思考」。在 DeepSeek R1 發布後,感覺各家公司都在爭先恐後地為其產品添加推理能力。

這裡一個有趣的進展是,大多數 LLM 提供商開始為用戶提供啟用或禁用思考的選項。雖然具體機制尚未公開分享,但很可能是同一個模型下調了推論時計算量的擴展程度。

例如,Claude 3.7 Sonnet 和 Grok 3 現在都有一個用戶可以為其模型啟用的「思考」功能,而 OpenAI 則要求用戶在模型之間切換。例如,如果他們想使用顯式推理模型,則需在 GPT-4o/4.5 和 o1/o3-mini 之間切換。然而,OpenAI 執行長提到 GPT-4.5 可能是他們最後一個沒有顯式推理或「思考」模式的模型。在開源方面,甚至 IBM 也為其 Granite 模型添加了顯式的「思考」切換開關。

總體而言,無論是透過推論時還是訓練時計算量擴展來添加推理能力,都是 2025 年 LLM 邁出的一大步。

隨著時間推移,我預計推理將不再被視為一項可選或特殊的功能,而是會成為標準配置,就像現在指令微調或 RLHF 微調模型已成為原始預訓練模型之上的常態一樣。

如前所述,由於推理研究活動非常活躍,本文僅專注於推論時計算量長度。在未來的文章中,我計劃涵蓋所有有趣的推理訓練時計算量擴展方法。

本雜誌是一個個人熱情項目。為了支持我作為一名獨立研究員,請考慮購買我的書《Build a Large Language Model (From Scratch)》,或註冊付費訂閱。

如果您閱讀了這本書並有幾分鐘空閒時間,我將非常感謝您的簡短評論。這對我們作者幫助很大!

您的支持意義重大!謝謝!

相關文章